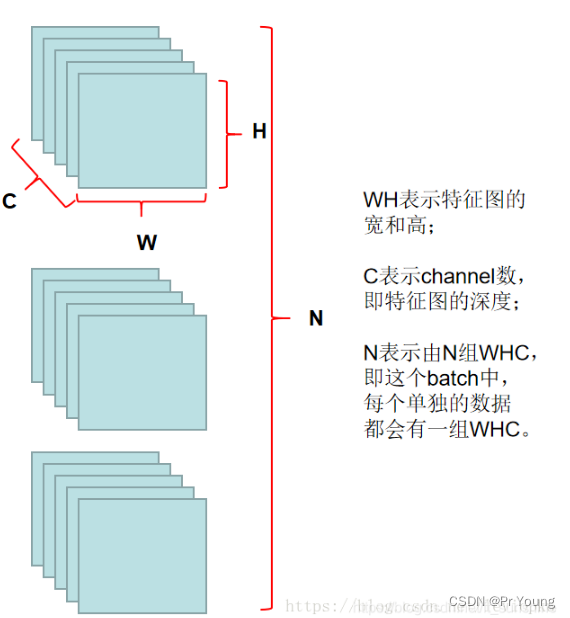

求出一组数据的均值和方差,使用求出来的均值和方差对这组数据进行归一化(标准化),使得均值为0,方差为1

假设一个输入数据集一列的数据,其值范围为0到10,另一列的值范围为100,000到10,00,000

建模时将这些值作为特征组合时,最终会出现误差

通过归一化,创建新的数值来保持这两列呈现类似的分布,比如正态分布。

常见的归一化方法有:Batch Normalization(BN),Layer Normalization(LN)

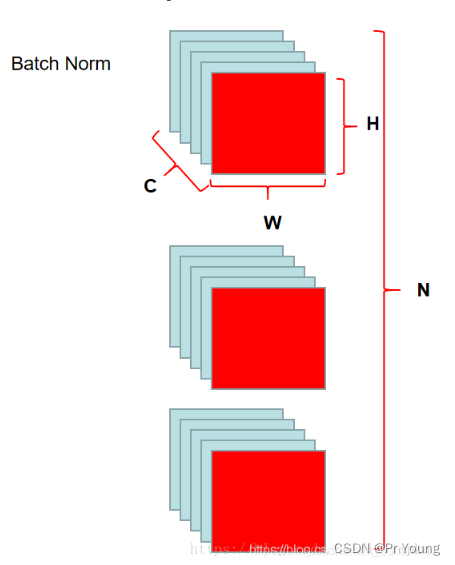

BN就是在N(图片数量)上做归一化(纵向规范化)

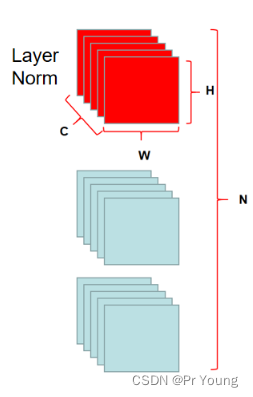

LN是在C(通道数)上做归一化(横向规范化)

BN是在batch size样本上各个维度做标准化的,所以size越大肯定越能得出合理的μ和σ来做标准化,因此BN比较依赖size的大小

Layer Normalization是在每个样本内部做标准化,跟size没关系

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?