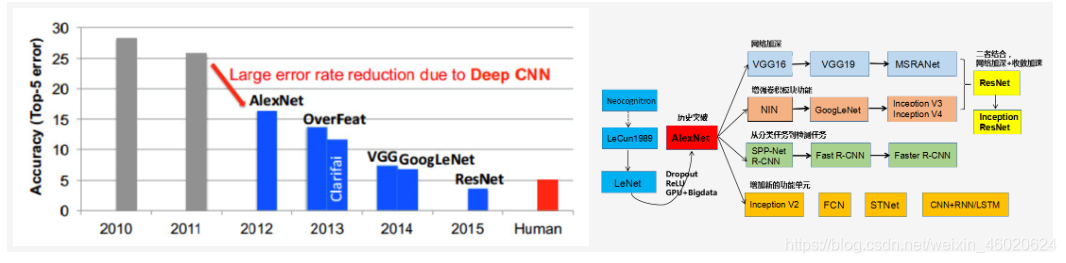

深度神经网络

深度学习网络与更常见的单一隐藏层神经网络的区别在于深度,深度学 习网络中,每一个节点层在前一层输出的基础上学习识别一组特定的特征。 随着神经网络深度增加,节点所能识别的特征也就越来越复杂。

普通全连接神经网络的缺点

参数太多,在cifar-10的数据集中,只有32 * 32 * 3,就会有这么多权重,如果说更大的图片,比如200 * 200 * 3就需要120000多个,这完全是浪费资源

没有利用像素之间位置信息,对于图像识别任务来说, 每个像素与周围的像素都是联系比较紧密的。

层数限制

卷积神经如何?

神经网络(neural networks)的基本组成包括输入层、隐藏层、输出层。而卷积神经网络的特点在于隐藏层分为卷积层和池化层(pooling layer,又叫下采样层)。

- 卷积层:通过在原始图像上平移来提取特征,每一个特征就是一个特征映射

- 池化层:通过特征后稀疏参数来减少学习的参数,降低网络的复杂度,(最大池化和平均池化)

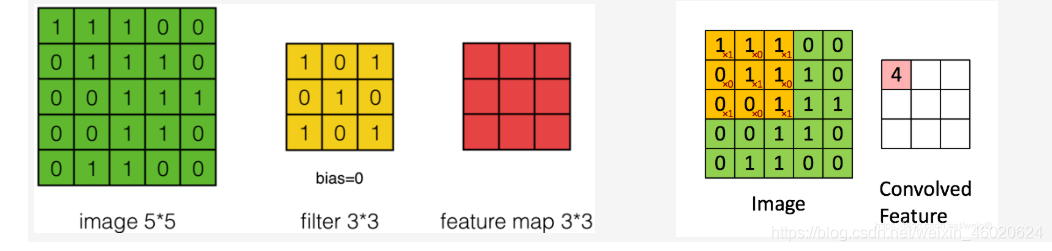

对于一张输入图片, 将其转化为矩阵, 矩阵的元素为对应的像素值. 假设有一个 5×5 5 的图像,使用一个 3×3 的卷积核进行卷积,可得到一个 3×3 的特征图. 卷积核也称为滤波器(Filter).

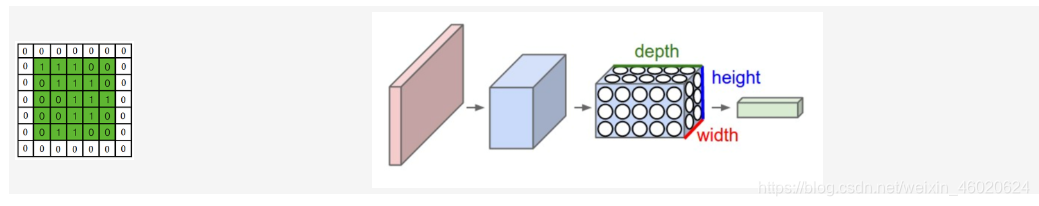

黄色的区域表示卷积核在输入矩阵中滑动, 每滑动到一个位置, 将对应数字相乘并求和, 得到一个特征图矩阵的元素. 注意到, 动图中卷积核每次滑动了一个单位, 实际上滑动的幅度可以根据需要进行调整. 如果滑动步幅大于 1, 则卷积核有可能无法恰好滑到边缘, 针对这种情况, 可在矩阵最外层补零, 补一层零后的矩阵如下图所示:

卷积核在提取特征映射时的动作称之为padding(零填充),由于移动步长不

一定能整出整张图的像素宽度。其中有两种方式,SAME和VALID

- SAME:越过边缘取样,取样的面积和输入图像的像素宽度一致。

- VALID:不越过边缘取样,取样的面积小于输入人的图像的像素宽度

本文深入探讨了深度神经网络与传统神经网络的区别,特别是在图像识别任务中的应用。文章详细解释了卷积神经网络(CNN)的工作原理,包括卷积层和平铺层的作用,以及如何通过滤波器提取图像特征。

本文深入探讨了深度神经网络与传统神经网络的区别,特别是在图像识别任务中的应用。文章详细解释了卷积神经网络(CNN)的工作原理,包括卷积层和平铺层的作用,以及如何通过滤波器提取图像特征。

4742

4742

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?