一、性能怪兽-Nginx概念深入浅出

Nginx是目前负载均衡技术中的主流方案,几乎绝大部分项目都会使用它,Nginx是一个轻量级的高性能HTTP反向代理服务器,同时它也是一个通用类型的代理服务器,支持绝大部分协议,如TCP、UDP、SMTP、HTTPS等。

Nginx与之前谈及的《Redis》相同,都是基于多路复用模型构建出的产物,因此它与Redis同样具备资源占用少、并发支持高的特点,在理论上单节点的Nginx同时支持5W并发连接,而实际生产环境中,硬件基础到位再结合简单调优后确实能达到该数值。

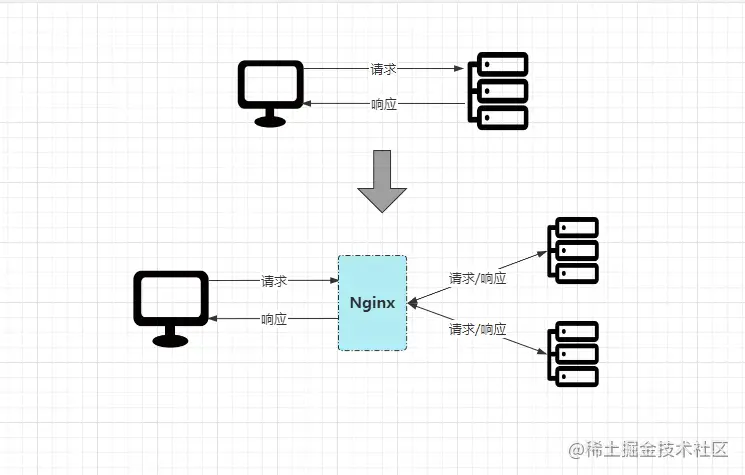

先来看看Nginx引入前后,客户端请求处理流程的对比:

原本客户端是直接请求目标服务器,由目标服务器直接完成请求处理工作,但加入Nginx后,所有的请求会先经过Nginx,再由其进行分发到具体的服务器处理,处理完成后再返回Nginx,最后由Nginx将最终的响应结果返回给客户端。

了解了Nginx的基本概念后,再来快速搭建一下环境,以及了解一些Nginx的高级特性,如动静分离、资源压缩、缓存配置、IP黑名单、高可用保障等。

二、Nginx环境搭建

❶首先创建Nginx的目录并进入:

[root@localhost]# mkdir /soft && mkdir /soft/nginx/

[root@localhost]# cd /soft/nginx/

复制代码❷下载Nginx的安装包,可以通过FTP工具上传离线环境包,也可通过wget命令在线获取安装包:

[root@localhost]# wget https://nginx.org/download/nginx-1.21.6.tar.gz

复制代码没有wget命令的可通过yum命令安装:

[root@localhost]# yum -y install wget

复制代码❸解压Nginx的压缩包:

[root@localhost]# tar -xvzf nginx-1.21.6.tar.gz

复制代码❹下载并安装Nginx所需的依赖库和包:

[root@localhost]# yum install --downloadonly --downloaddir=/soft/nginx/ gcc-c++

[root@localhost]# yum install --downloadonly --downloaddir=/soft/nginx/ pcre pcre-devel4

[root@localhost]# yum install --downloadonly --downloaddir=/soft/nginx/ zlib zlib-devel

[root@localhost]# yum install --downloadonly --downloaddir=/soft/nginx/ openssl openssl-devel

复制代码也可以通过yum命令一键下载(推荐上面哪种方式):

[root@localhost]# yum -y install gcc zlib zlib-devel pcre-devel openssl openssl-devel

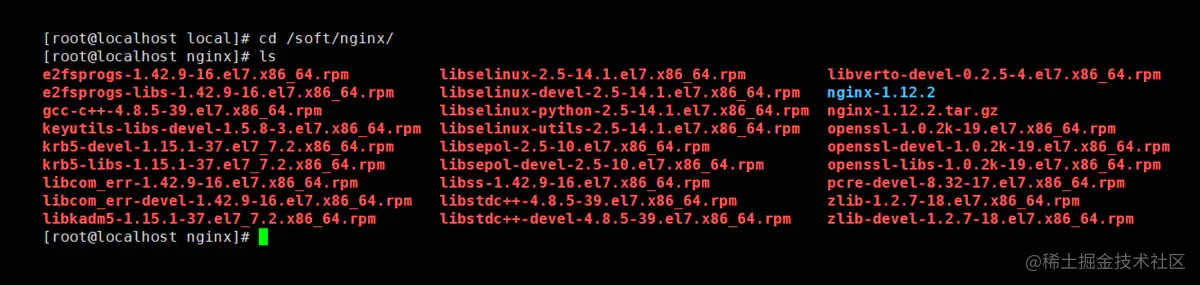

复制代码执行完成后,然后ls查看目录文件,会看一大堆依赖:

紧接着通过rpm命令依次将依赖包一个个构建,或者通过如下指令一键安装所有依赖包:

[root@localhost]# rpm -ivh --nodeps *.rpm

复制代码❺进入解压后的nginx目录,然后执行Nginx的配置脚本,为后续的安装提前配置好环境,默认位于/usr/local/nginx/目录下(可自定义目录):

[root@localhost]# cd nginx-1.21.6

[root@localhost]# ./configure --prefix=/soft/nginx/

复制代码❻编译并安装Nginx:

[root@localhost]# make && make install

复制代码❼最后回到前面的/soft/nginx/目录,输入ls即可看见安装nginx完成后生成的文件。

❽修改安装后生成的conf目录下的nginx.conf配置文件:

[root@localhost]# vi conf/nginx.conf

修改端口号:listen 80;

修改IP地址:server_name 你当前机器的本地IP(线上配置域名);

复制代码❾制定配置文件并启动Nginx:

[root@localhost]# sbin/nginx -c conf/nginx.conf

[root@localhost]# ps aux | grep nginx

复制代码Nginx其他操作命令:

sbin/nginx -t -c conf/nginx.conf # 检测配置文件是否正常

sbin/nginx -s reload -c conf/nginx.conf # 修改配置后平滑重启

sbin/nginx -s quit # 优雅关闭Nginx,会在执行完当前的任务后再退出

sbin/nginx -s stop # 强制终止Nginx,不管当前是否有任务在执行

复制代码❿开放80端口,并更新防火墙:

[root@localhost]# firewall-cmd --zone=public --add-port=80/tcp --permanent

[root@localhost]# firewall-cmd --reload

[root@localhost]# firewall-cmd --zone=public --list-ports

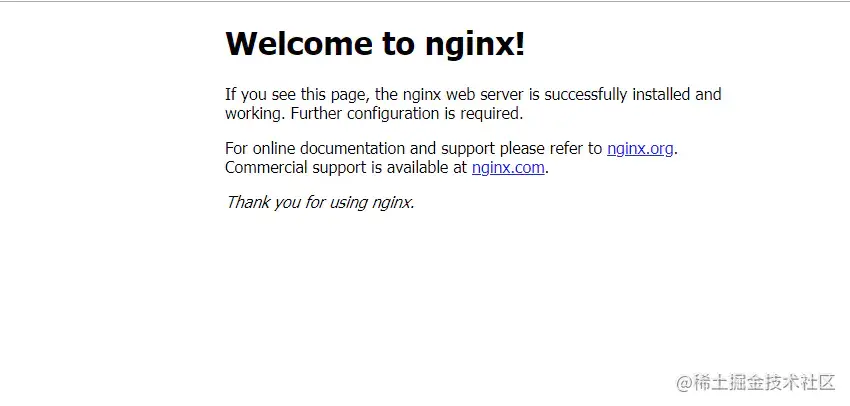

复制代码⓫在Windows/Mac的浏览器中,直接输入刚刚配置的IP地址访问Nginx:

最终看到如上的Nginx欢迎界面,代表Nginx安装完成。

三、Nginx反向代理-负载均衡

首先通过SpringBoot+Freemarker快速搭建一个WEB项目:springboot-web-nginx,然后在该项目中,创建一个IndexNginxController.java文件,逻辑如下:

@Controller

public class IndexNginxController {

@Value("${server.port}")

private String port;

@RequestMapping("/")

public ModelAndView index(){

ModelAndView model = new ModelAndView();

model.addObject("port", port);

model.setViewName("index");

return model;

}

}

复制代码在该Controller类中,存在一个成员变量:port,它的值即是从application.properties配置文件中获取server.port值。当出现访问/资源的请求时,跳转前端index页面,并将该值携带返回。

前端的index.ftl文件代码如下:

<html>

<head>

<title>Nginx演示页面</title>

<link href="nginx_style.css" rel="stylesheet" type="text/css"/>

</head>

<body>

<div style="border: 2px solid red;margin: auto;width: 800px;text-align: center">

<div id="nginx_title">

<h1>欢迎来到熊猫高级会所,我是竹子${port}号!</h1>

</div>

</div>

</body>

</html>

复制代码从上可以看出其逻辑并不复杂,仅是从响应中获取了port输出。

OK~,前提工作准备就绪后,再简单修改一下nginx.conf的配置即可:

upstream nginx_boot{

# 30s内检查心跳发送两次包,未回复就代表该机器宕机,请求分发权重比为1:2

server 192.168.0.000:8080 weight=100 max_fails=2 fail_timeout=30s;

server 192.168.0.000:8090 weight=200 max_fails=2 fail_timeout=30s;

# 这里的IP请配置成你WEB服务所在的机器IP

}

server {

location / {

root html;

# 配置一下index的地址,最后加上index.ftl。

index index.html index.htm index.jsp index.ftl;

proxy_set_header Host $host;

proxy_set_header X-Real-IP $remote_addr;

proxy_set_header X-Forwarded-For $proxy_add_x_forwarded_for;

# 请求交给名为nginx_boot的upstream上

proxy_pass http://nginx_boot;

}

}

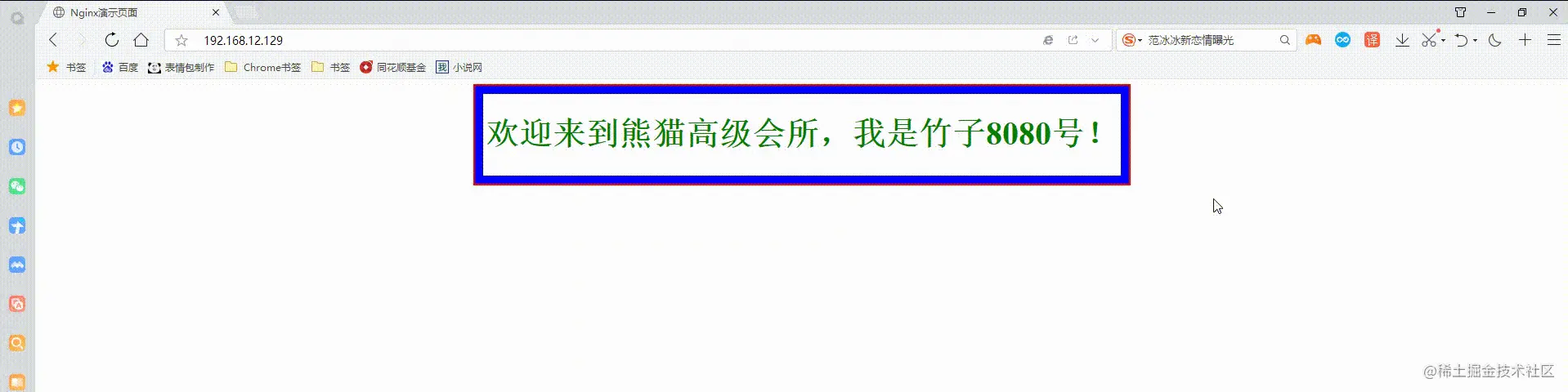

复制代码至此,所有的前提工作准备就绪,紧接着再启动Nginx,然后再启动两个web服务,第一个WEB服务启动时,在application.properties配置文件中,将端口号改为8080,第二个WEB服务启动时,将其端口号改为8090。

最终来看看效果:

因为配置了请求分发的权重,8080、8090的权重比为2:1,因此请求会根据权重比均摊到每台机器,也就是8080一次、8090两次、8080一次......

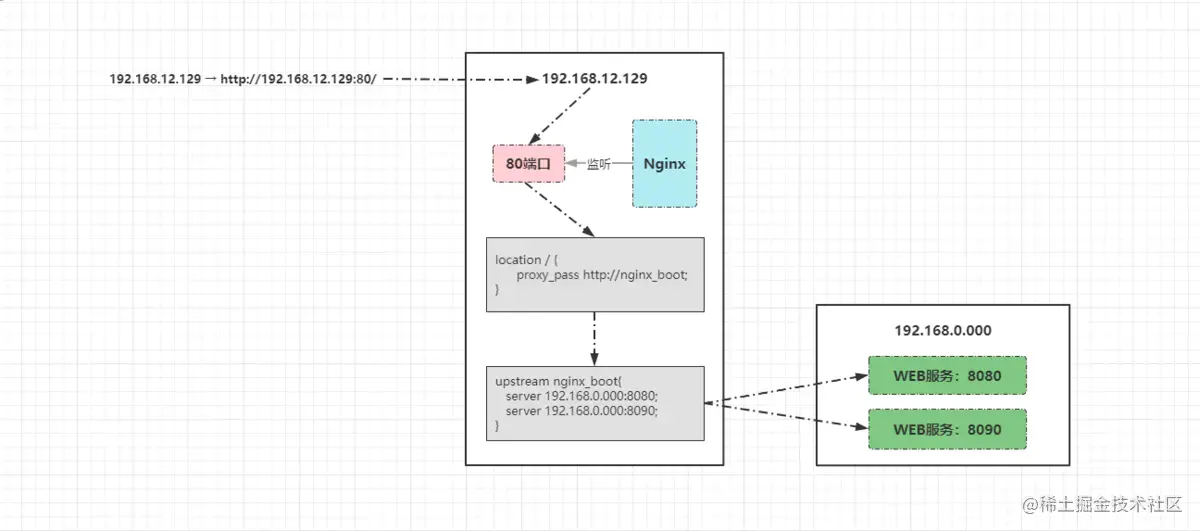

Nginx请求分发原理

客户端发出的请求192.168.12.129最终会转变为:http://192.168.12.129:80/,然后再向目标IP发起请求,流程如下:

- 由于Nginx监听了192.168.12.129的80端口,所以最终该请求会找到Nginx进程;

- Nginx首先会根据配置的location规则进行匹配,根据客户端的请求路径/,会定位到location /{}规则;

- 然后根据该location中配置的proxy_pass会再找到名为nginx_boot的upstream;

- 最后根据upstream中的配置信息,将请求转发到运行WEB服务的机器处理,由于配置了多个WEB服务,且配置了权重值,因此Nginx会依次根据权重比分发请求。

四、Nginx动静分离

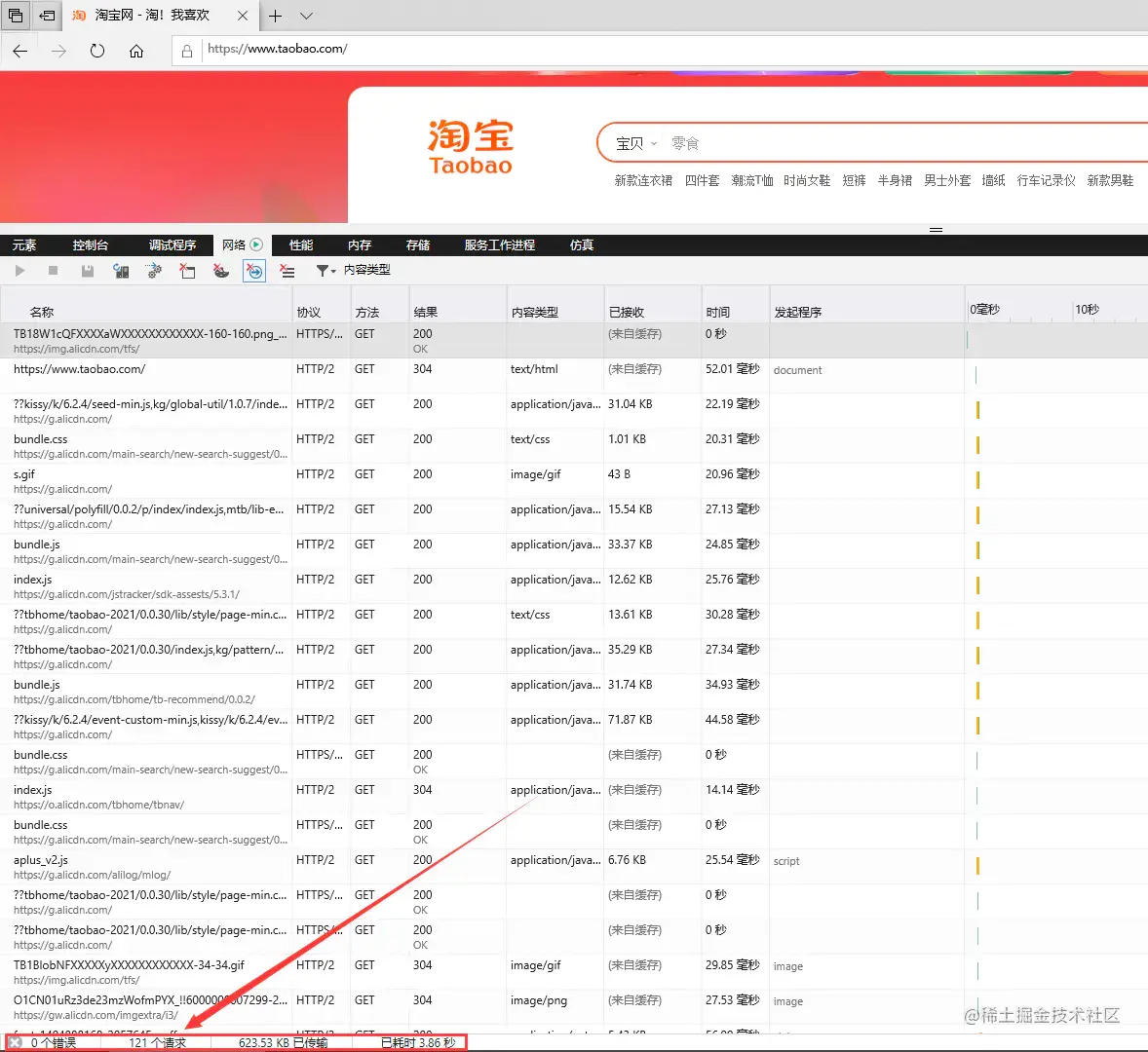

动静分离应该是听的次数较多的性能优化方案,那先思考一个问题:为什么需要做动静分离呢?它带来的好处是什么? 其实这个问题也并不难回答,当你搞懂了网站的本质后,自然就理解了动静分离的重要性。先来以淘宝为例分析看看:

当浏览器输入www.taobao.com访问淘宝首页时,打开开发者调试工具可以很明显的看到,首页加载会出现100+的请求数,而正常项目开发时,静态资源一般会放入到resources/static/目录下:

在项目上线部署时,这些静态资源会一起打成包,那此时思考一个问题:假设淘宝也是这样干的,那么首页加载时的请求最终会去到哪儿被处理? 答案毋庸置疑,首页100+的所有请求都会来到部署WEB服务的机器处理,那则代表着一个客户端请求淘宝首页,就会对后端服务器造成100+的并发请求。毫无疑问,这对于后端服务器的压力是尤为巨大的。

但此时不妨分析看看,首页100+的请求中,是不是至少有60+是属于*.js、*.css、*.html、*.jpg.....这类静态资源的请求呢?答案是Yes。

既然有这么多请求属于静态的,这些资源大概率情况下,长时间也不会出现变动,那为何还要让这些请求到后端再处理呢?能不能在此之前就提前处理掉?当然OK,因此经过分析之后能够明确一点:做了动静分离之后,至少能够让后端服务减少一半以上

本文深入介绍了Nginx的性能优势和关键特性,包括反向代理、负载均衡、动静分离、资源压缩、缓存机制、IP黑白名单、跨域配置、防盗链设计和大文件传输。通过实例演示了Nginx的环境搭建、配置以及性能优化,强调了其在提高系统吞吐和响应速度方面的作用。同时,探讨了Nginx的高可用性,利用Keepalived实现主从热备,确保服务的连续性。

本文深入介绍了Nginx的性能优势和关键特性,包括反向代理、负载均衡、动静分离、资源压缩、缓存机制、IP黑白名单、跨域配置、防盗链设计和大文件传输。通过实例演示了Nginx的环境搭建、配置以及性能优化,强调了其在提高系统吞吐和响应速度方面的作用。同时,探讨了Nginx的高可用性,利用Keepalived实现主从热备,确保服务的连续性。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

9169

9169

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?