通常CNN网络在卷积层之后会接上若干个全连接层, 将卷积层产生的特征图(feature map)映射成一个固定长度的特征向量。以AlexNet为代表的经典CNN结构适合于图像级的分类和回归任务,因为它们最后都期望得到整个输入图像的一个数值描述(概率),比如AlexNet的ImageNet模型输出一个1000维的向量表示输入图像属于每一类的概率(softmax归一化)。

核心思想

该论文包含了当下CNN的三个思潮

-

不含全连接层(fc)的全卷积(fully conv)网络。可适应任意尺寸输入。

-

增大数据尺寸的反卷积(deconv)层。能够输出精细的结果。

-

结合不同深度层结果的跳级(skip)结构。同时确保鲁棒性和精确性。

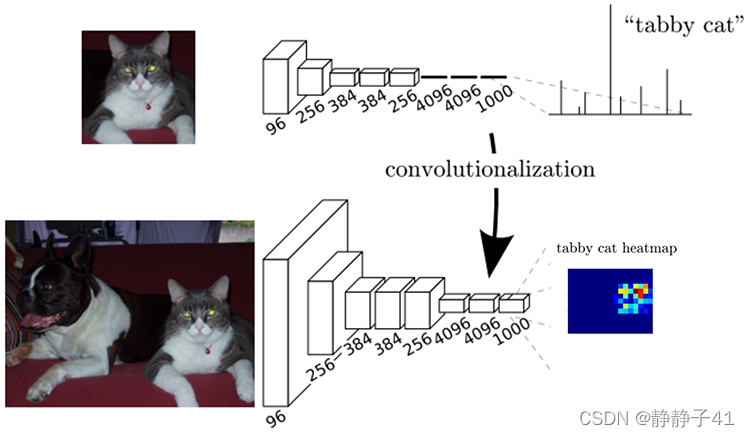

FCN将传统CNN中的全连接层转化成一个个的卷积层。如下图所示,在传统的CNN结构中,前5层是卷积层,第6层和第7层分别是一个长度为4096的一维向量,第8层是长度为1000的一维向量,分别对应1000个类别的概率。FCN将这3层表示为卷积层,卷积核的大小(通道数,宽,高)分别为(4096,7,7)、(4096,1,1)、(1000,1,1)。所有的层都是卷积层,故称为全卷积网络。

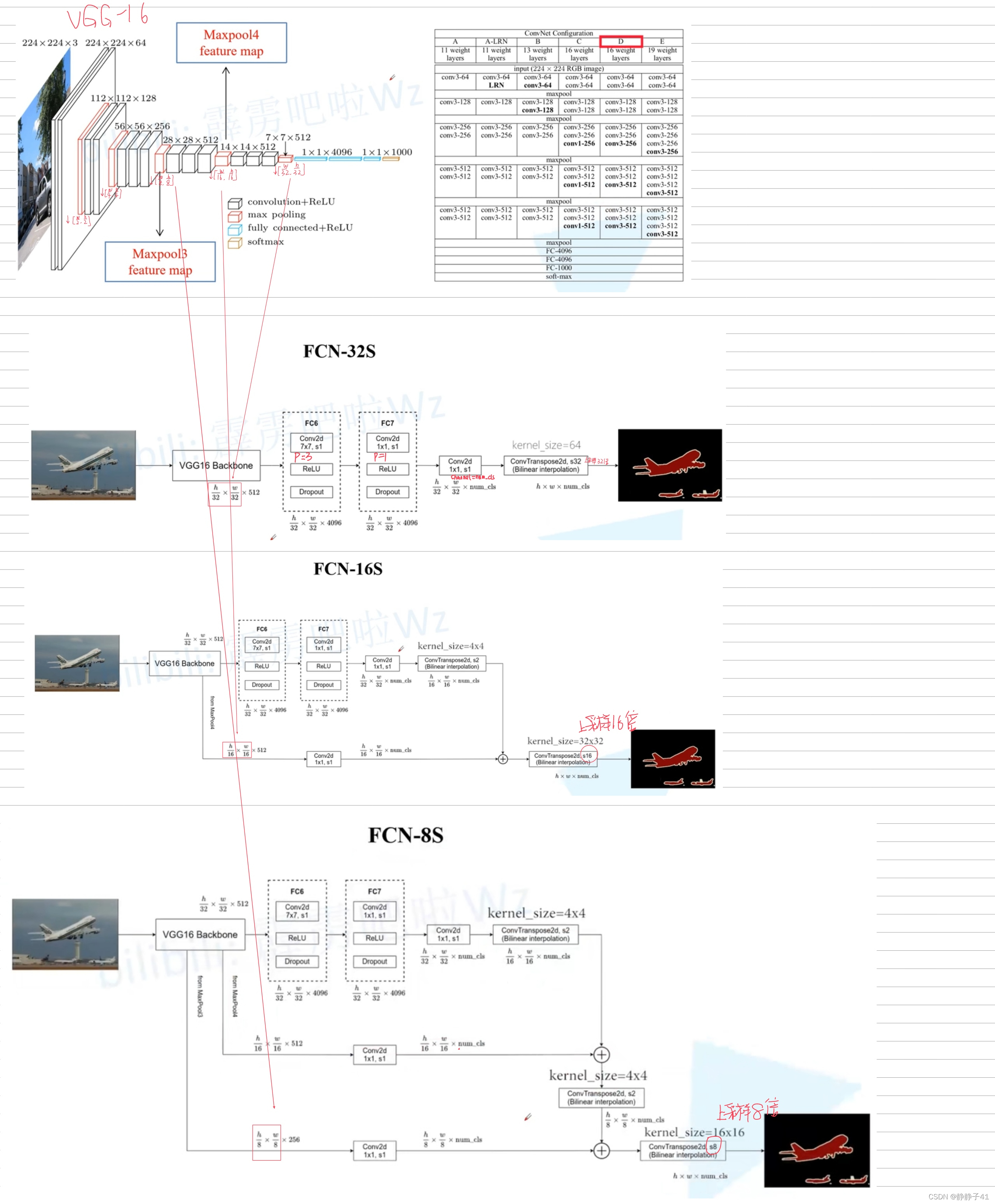

以VGG-16为backbone的FCN

网络结构如下。输入可为任意尺寸图像彩色图像;输出与输入尺寸相同,深度为:20类目标+背景=21。 (在PASCAL数据集上进行的,PASCAL一共20类)

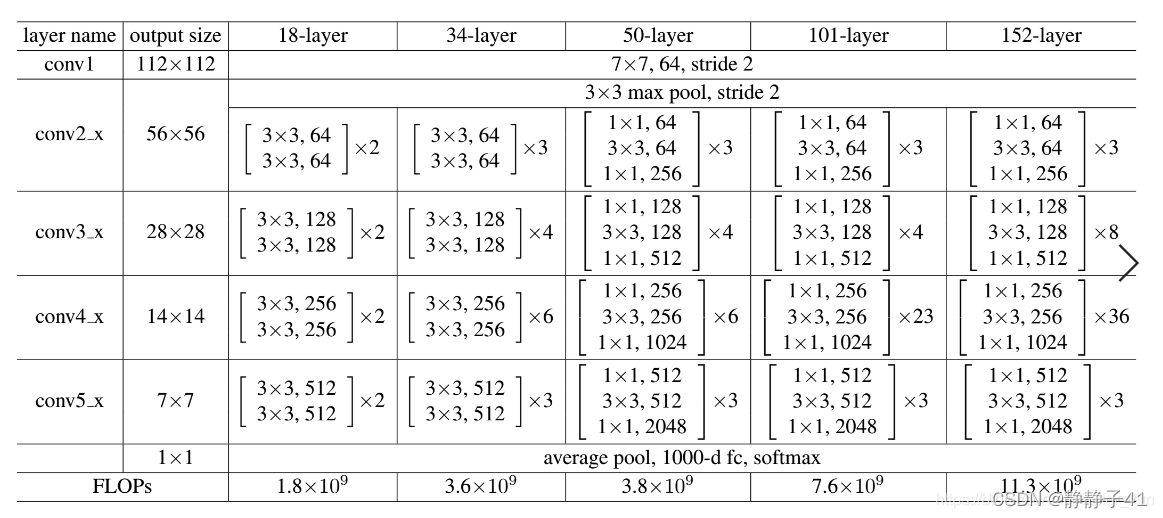

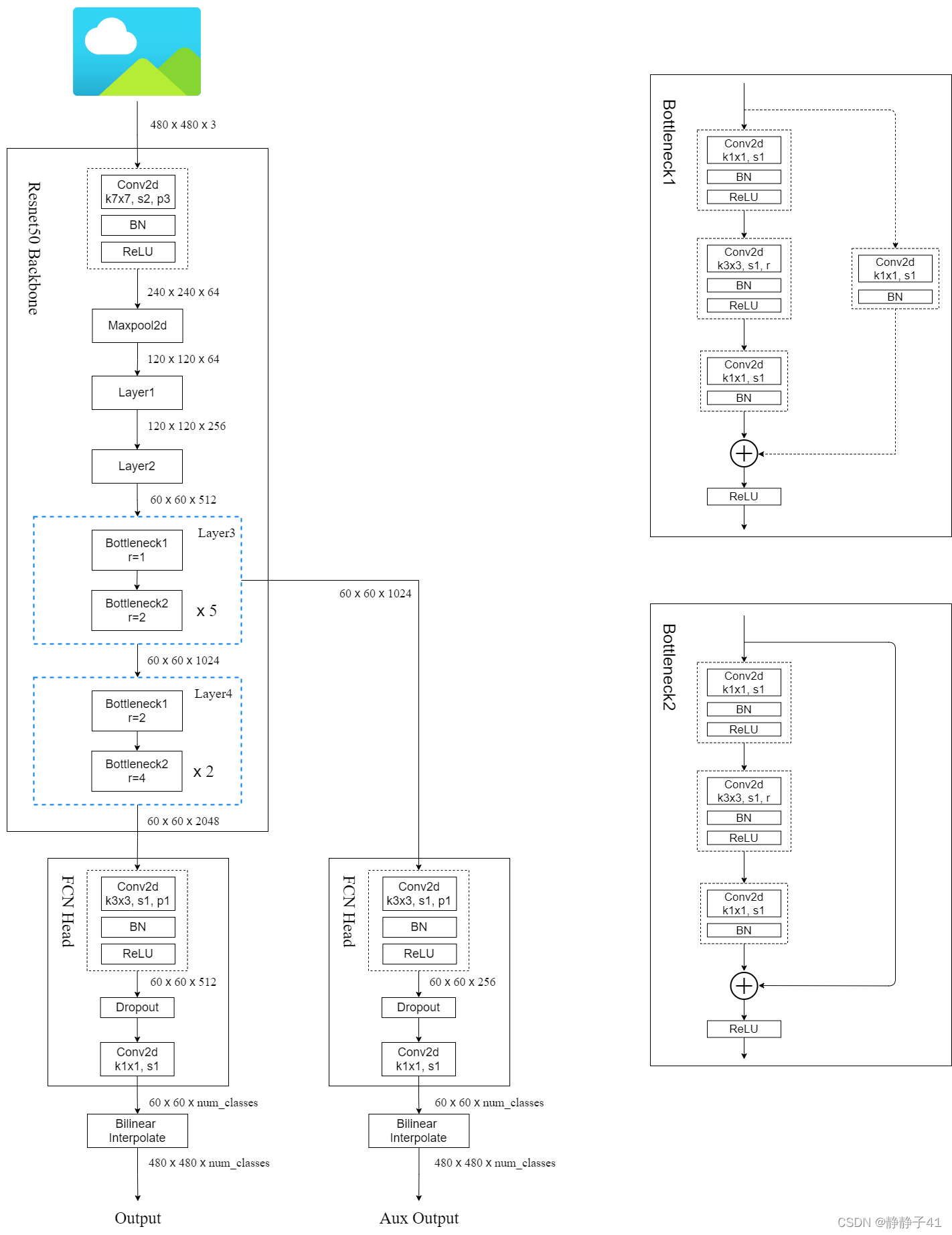

以ResNet-50为backbone的FCN

1129

1129

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?