- 训练误差:学习器在训练集上的误差

- 误差:学习器的实际预测输出与样本的真实输出之间的差异

- 错误率:把分类错误的样本数占样本总数的比例

- 泛化误差:在新样本上的误差

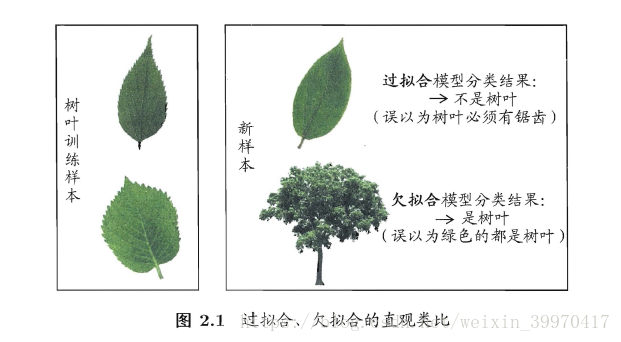

- 过拟合:当学习器把训练样本学得"太好"了的时候,很可能巳经把训练样本自身的一些特点当作了所有潜在样本都会具有的一般性质,这样就会导致泛化性能下降这种现象在机器学习中称为"过拟合" (overfitting).

误差评估方法:

"留出法" (hold-out)直接将数据集D 划分为两个互斥的集合?其中一个集合作为训练集5,另一个作为测试集T, 即D=BUT, 5 门T= 正~.在S 上训练出模型后,用T 来评估其测试误差,作为对泛化误差的估计.

分层采样:

评估结果的保真性(fidelity):

"交叉验证法" (cross validation):先将数据集D 划分为k 个大小相似的互斥子集, 即D = D1 U D2υ... U Dk, Di n Dj = ø (í 手j ) . 每个子集Di 都尽可能保持数据分布的一致性,即从D 中通过分层采样得到. 然后,每次用k-1 个子集的并集作为训练集?余F 的那个子集作为测试集;这样就可获得k组训练/测试集,从而可进行k 次训练和测试? 最终返回的是这k 个测试结果的均值显然,交叉验证法评估结果的稳定性和保真性在很大程度上取决于k的取值,为强调这一点,通常把交叉验证法称为" k 折交叉验证" (k-fold crossvalidat ion). k 最常用的取值是10 ,此时称为1 0 折交叉验证; 其他常用的k 值有5、20 等;

数据集:我们通常把学得模型在实际使用中遇到的数据称为测试数据,为了加以区分,模型评估与选择中用于评估测试的数据集常称为"验证集" (validation set). 例如,在研究对比不同算法的泛化性能时,我们用测试集上的判别效果来估计模型在实际使用时的泛化能力,而把训练数据另外划分为训练集和验证集,基于验证集上的性能来进行模型选择和调参.

自助法:自助法在数据集较小、难以有效划分训练/测试集时很有用;此外,自助法能从初始数据集中产生多个不同的训练集,这对集成学习等方法有很大的好处.然而,自助法产生的数据集改变了初始数据集的分布,这会引入估计偏差;

性能度量(performance measure):对学习器的泛化性能进行评估,不仅需要有效可行的实验估计方法,还需要有衡量模型泛化能力的评价标准,这就是性能度量;

- 回归任务最常用的性能度量是"均方误差" (mean squared error):

- 对于数据分布Ð 和概率密度函数p(.) , 均方误差可描述为:

- 错误率和精度:这是分类任务中最常用的两种性能度量,既适用于二分类任务,也适用于多分类任务.错误率是分类错误的样本数占样本总数的比例,精度则是分类正确的样本数占样本总数的比例;

- 查准率和查全率(precision and recall):以查准率为纵轴、查全率为横轴作图,就得到了查准率-查全率曲线,简称" P-R 曲线",

本文介绍了机器学习中的关键概念,包括训练误差、泛化误差、过拟合等,并详细阐述了评估学习器性能的方法,如留出法、交叉验证法及自助法。同时,文中还讨论了几种常见的性能度量指标。

本文介绍了机器学习中的关键概念,包括训练误差、泛化误差、过拟合等,并详细阐述了评估学习器性能的方法,如留出法、交叉验证法及自助法。同时,文中还讨论了几种常见的性能度量指标。

295

295

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?