运行代码如下

package spark.regressionAnalysis

/**

* 随机梯度下降法(stochastic gradient descent,SGD)

* SGD是最速梯度下降法的变种。

* 使用最速梯度下降法,将进行N次迭代,直到目标函数收敛,或者到达某个既定的收敛界限。

* 每次迭代都将对m个样本进行计算,计算量大。

* 为了简便计算,SGD每次迭代仅对一个样本计算梯度,直到收敛。

* 随机梯度下降,即(最快速从紫金山山顶下去)

*

* Created by eric on 16-7-10.

*/

import scala.collection.mutable.HashMap

object SGD {

val data = HashMap[Int,Int]() //创建数据集

def getData():HashMap[Int,Int] = {//生成数据集内容

for(i <- 1 to 50){ //创建50个数据

data += (i -> (16*i))//写入公式y=16x

}

data //返回数据集

}

var θ:Double = 0 //第一步假设θ为0

var α:Double = 0.1 //设置步进系数,每次下降的幅度大小

def sgd(x:Double,y:Double) = {//设置迭代公式

θ = θ - α * ( (θ*x) - y) //迭代公式

}

def main(args: Array[String]) {

val dataSource = getData() //获取数据集

dataSource.foreach(myMap =>{//开始迭代

sgd(myMap._1,myMap._2)//输入数据

})

println("最终结果θ值为 " + θ)//显示结果

}

}

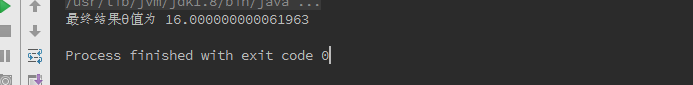

结果如图

本文介绍了一种机器学习中常用的优化算法——随机梯度下降法(SGD),并提供了一个使用Scala实现的具体实例。通过该示例,读者可以了解SGD的工作原理及其实现过程。

本文介绍了一种机器学习中常用的优化算法——随机梯度下降法(SGD),并提供了一个使用Scala实现的具体实例。通过该示例,读者可以了解SGD的工作原理及其实现过程。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?