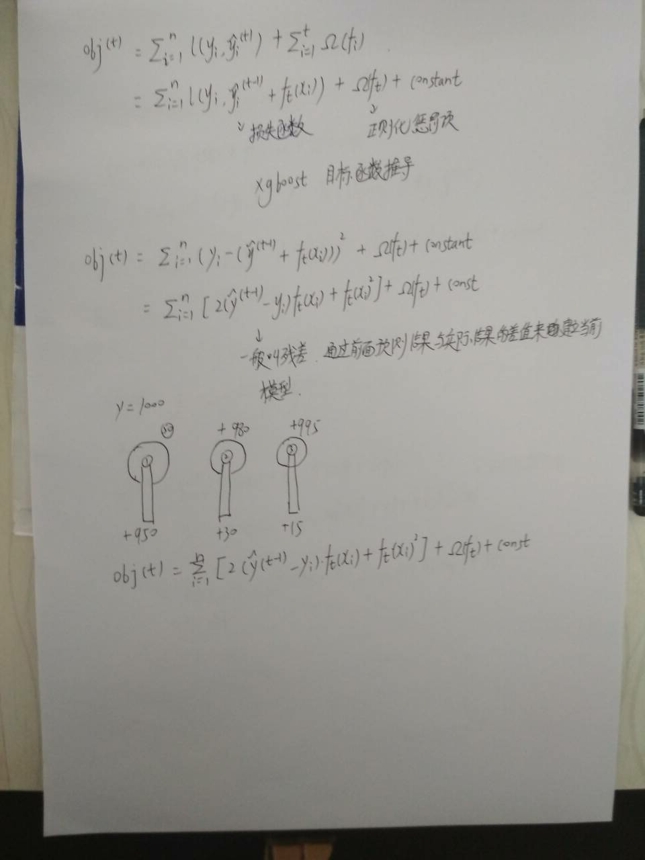

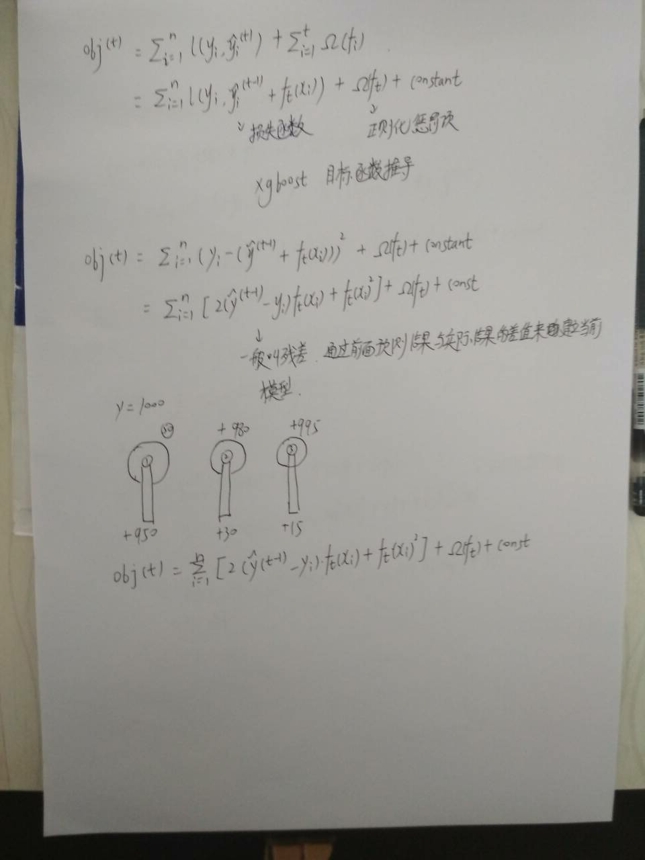

1.构造损失函数的目标函数

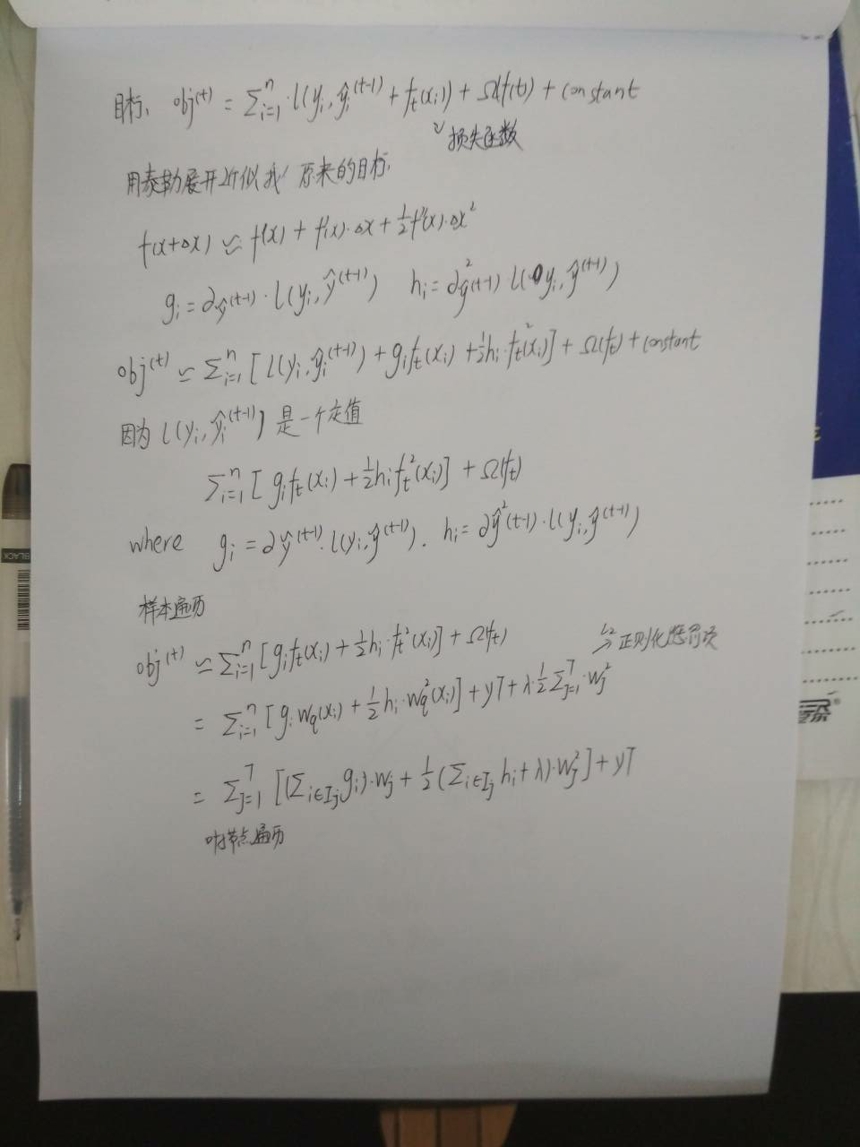

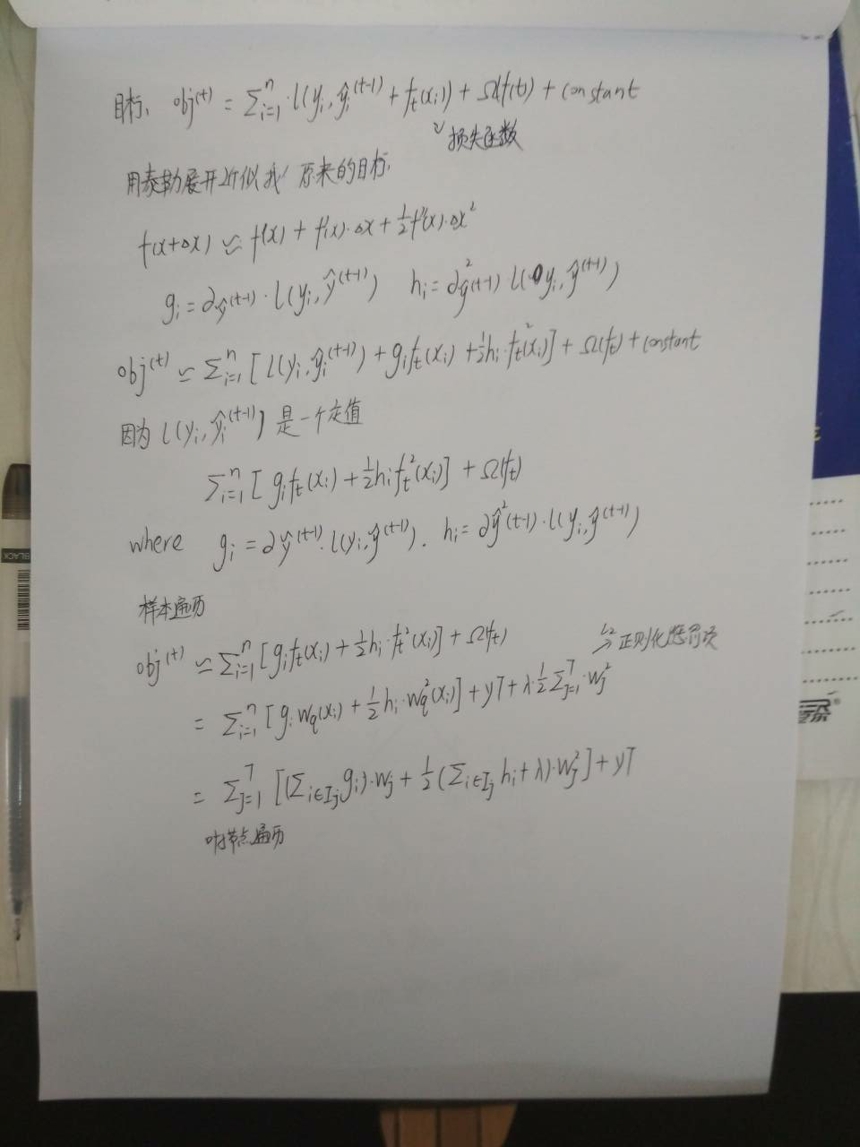

2.对目标函数进行泰勒展开

3.把样本遍历转换成叶子节点遍历,合并正则化惩罚项

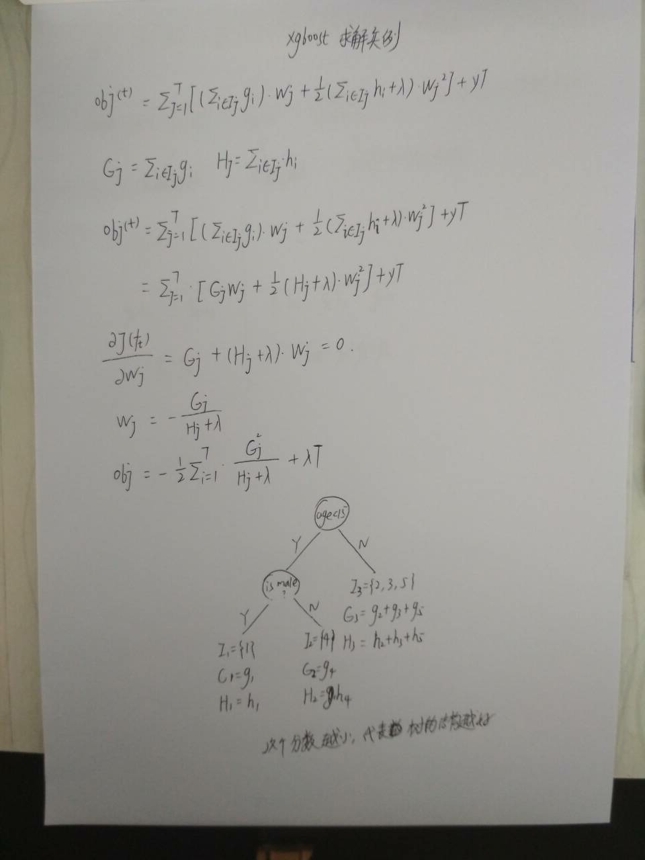

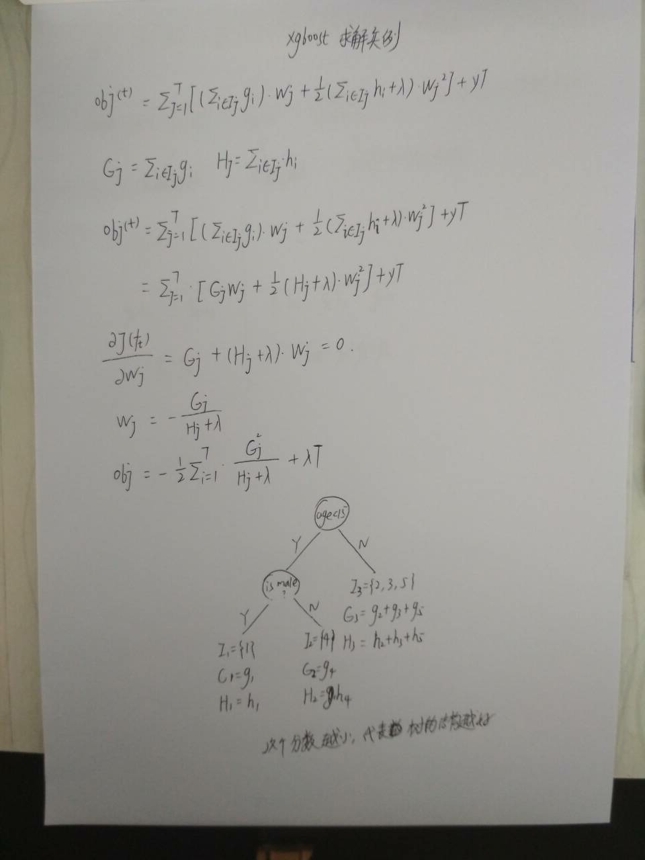

4.求wj进行求导,使得当目标函数等于0时的wj的值

5.将求解得到的wj反导入方程中,解得最终的目标函数

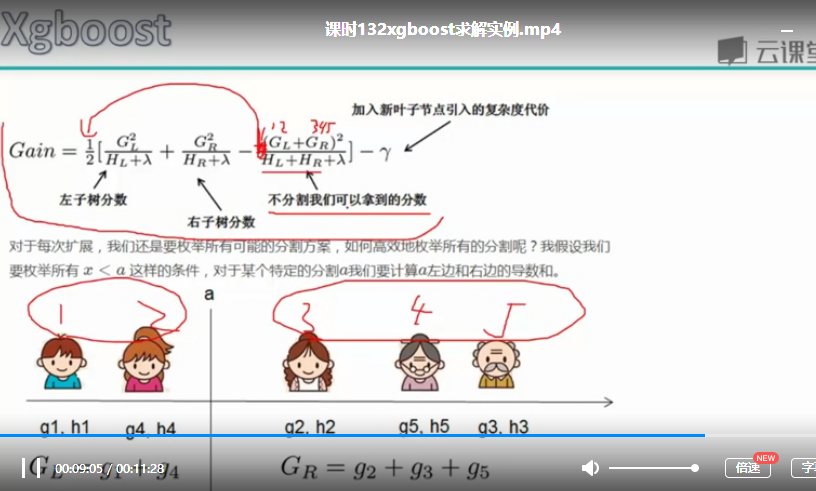

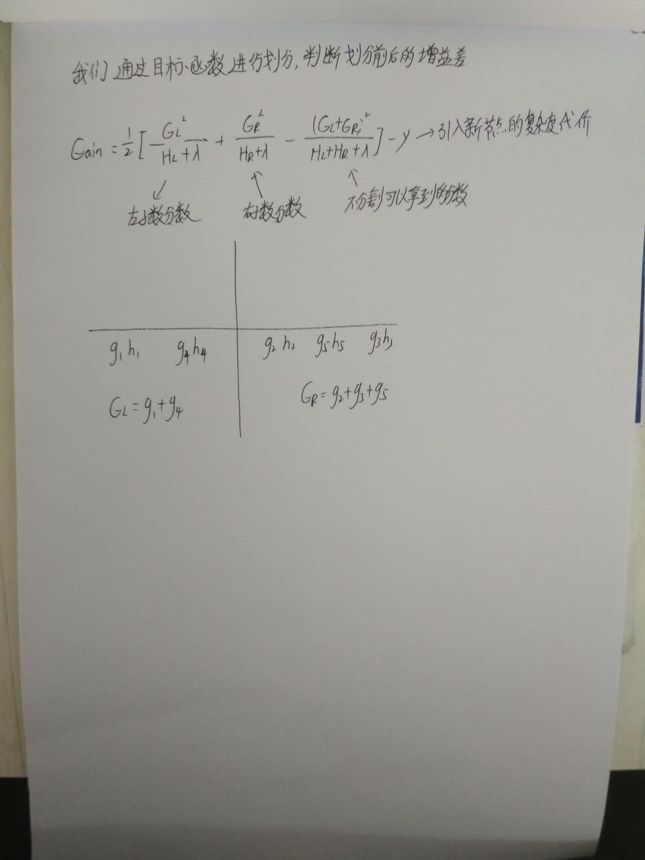

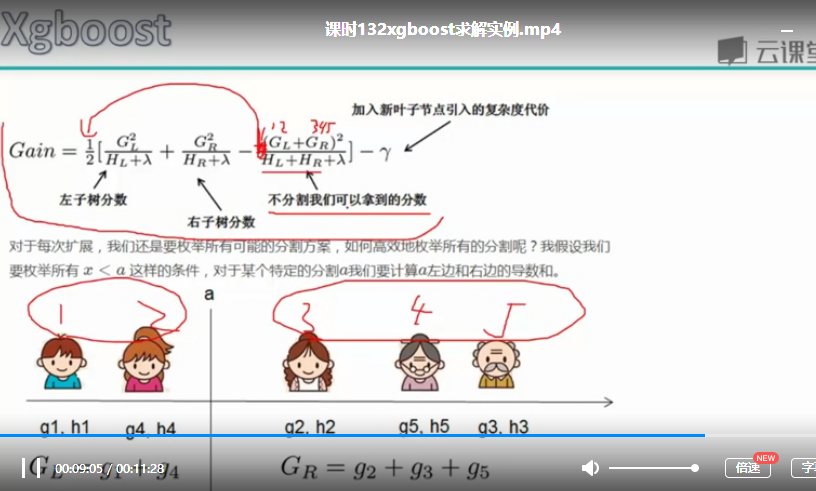

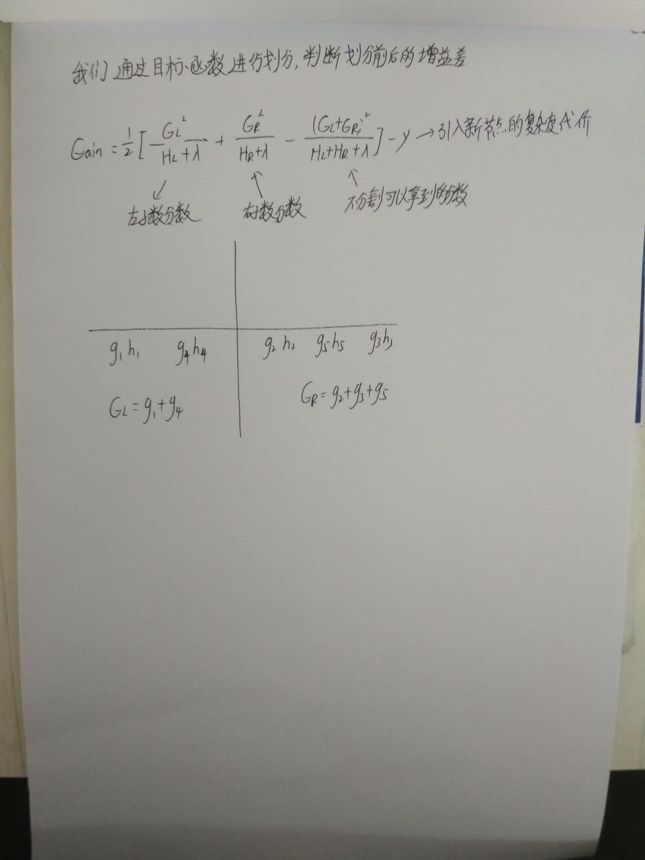

6.对样本进行分割时,用分割前的目标函数的值-分割后左右子树的目标函数的值,来划分得到最大的分割情况,以此来判断分割的界限

xgboost依据的是一种残差思想

以下是推导过程

实例说明

本文详细解析了XGBoost算法的工作原理,包括构造损失函数、泰勒展开、叶子节点遍历、正则化惩罚项的合并,以及通过求导找到最优参数的过程。并通过实例展示了如何利用目标函数值的变化进行样本分割,实现最大信息增益。

本文详细解析了XGBoost算法的工作原理,包括构造损失函数、泰勒展开、叶子节点遍历、正则化惩罚项的合并,以及通过求导找到最优参数的过程。并通过实例展示了如何利用目标函数值的变化进行样本分割,实现最大信息增益。

1.构造损失函数的目标函数

2.对目标函数进行泰勒展开

3.把样本遍历转换成叶子节点遍历,合并正则化惩罚项

4.求wj进行求导,使得当目标函数等于0时的wj的值

5.将求解得到的wj反导入方程中,解得最终的目标函数

6.对样本进行分割时,用分割前的目标函数的值-分割后左右子树的目标函数的值,来划分得到最大的分割情况,以此来判断分割的界限

xgboost依据的是一种残差思想

以下是推导过程

实例说明

转载于:https://www.cnblogs.com/my-love-is-python/p/9786390.html

1万+

1万+

714

714

473

473

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?