关于robots.txt文件:搜索引擎通过一种程序robot(又称spider),自动访问互联网上的网页并获取网页信 息。您可以在您的网站中创建一个纯文本文件robots.txt,在这个文件中声明该网站中不想被robot 访问的部分,这样,该网站的部分或全部内容就可以不被搜索引擎收录了,或者指定搜索引擎只收录指定的内容。

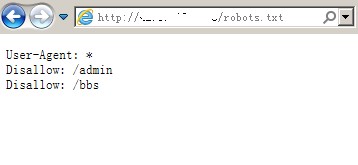

访问www.linuxidc.com/ robots.txt,可以得知我们网站中存在/admin和/bbs,其中/admin是关于后台管理的目录,把这个路径轻易的暴漏显然是不太安全的,下面我们可以通过禁止访问.txt类型的文件来,增加网站的安全性。

修改nginx.conf文件,vim /usr/local/nginx/conf/nginx.conf

location ~* \.(txt|doc)$ {

root /usr/local/nginx/html;

deny all;

}

指定403.html文件的配置信息

error_page 403 /403.html;

location = /403.html {

root html;

}

重新加载配置文件

/usr/local/nginx/sbin/nginx -s reload

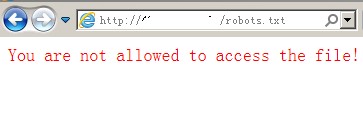

再次访问www.linuxidc.com/ robots.txt,发现提示无法访问该文件了。

通过这种方法可以在某种程度上保护网站安全,避免黑客通过访问robots.txt猜到我们网站的目录结构或者说有哪些真实存在的目录和文件。

当然还可以禁止其他指定类型的文件比如.doc、.xsl等等,方法是同样的。

转自:

http://www.linuxidc.com/Linux/2013-04/82365.htm

本文介绍如何通过修改Nginx配置文件来保护网站的robots.txt文件,防止敏感信息泄露,增强网站安全性。

本文介绍如何通过修改Nginx配置文件来保护网站的robots.txt文件,防止敏感信息泄露,增强网站安全性。

2358

2358

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?