此笔记源于台湾大学林轩田老师《机器学习基石》《机器学习技法》

我们已经学习过PLA算法,所谓的线性模型就是:计算核心为![]() 。PLA是一种分类方法,这里介绍线性回归方法(与概率与统计中的线性回归相同)。

。PLA是一种分类方法,这里介绍线性回归方法(与概率与统计中的线性回归相同)。

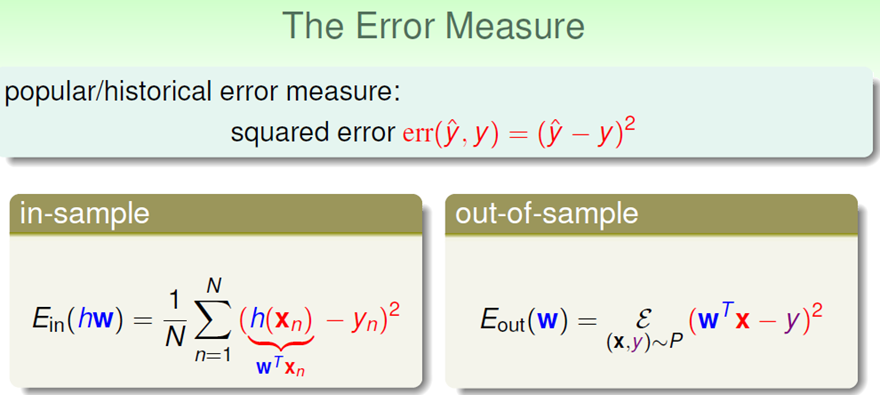

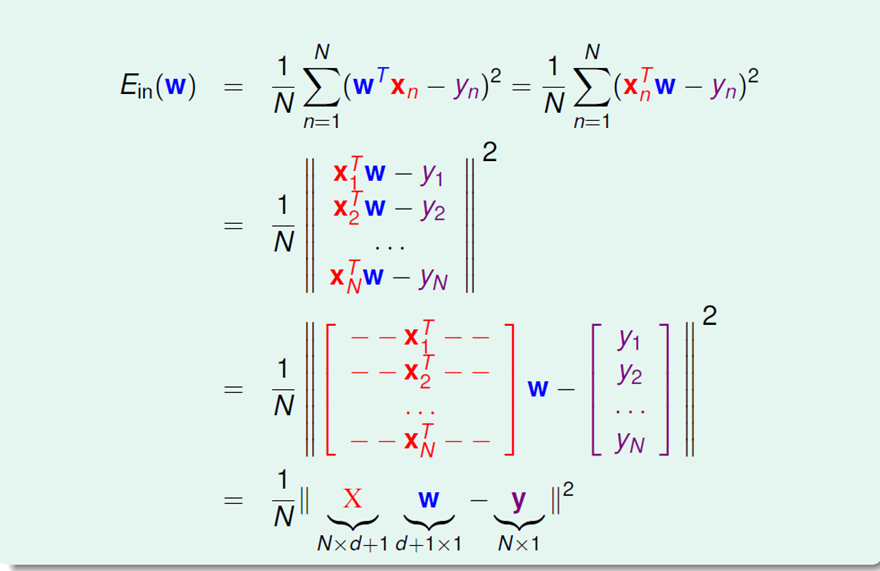

我们需要最小化Ein。

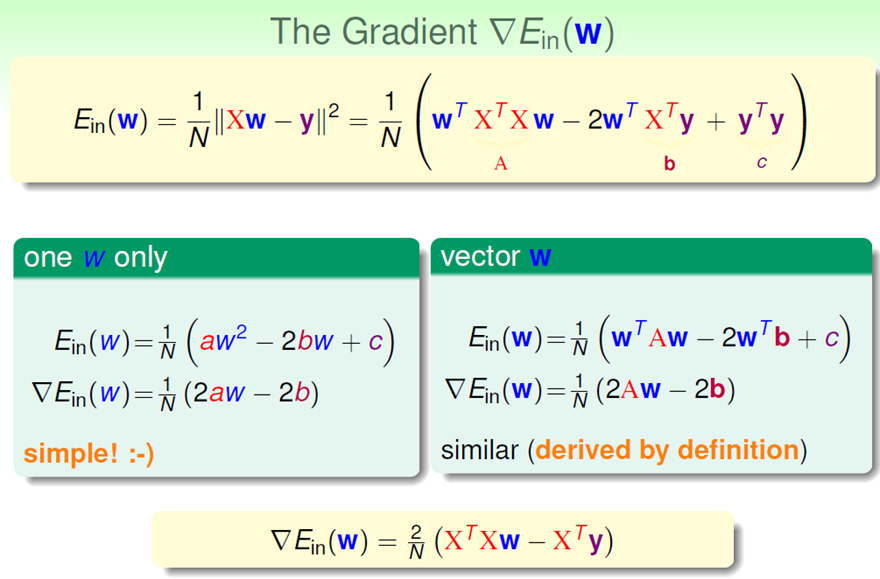

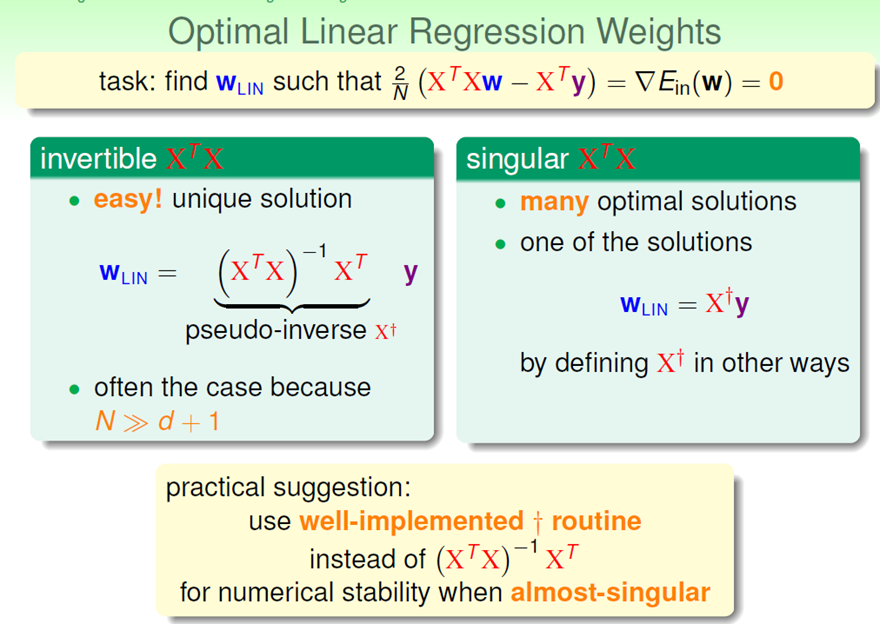

通过上式,可以看出Ein是continuous,differentiabl,convex函数,所以想让Ein最小,只需要让Ein的梯度(微分)等于0即可。

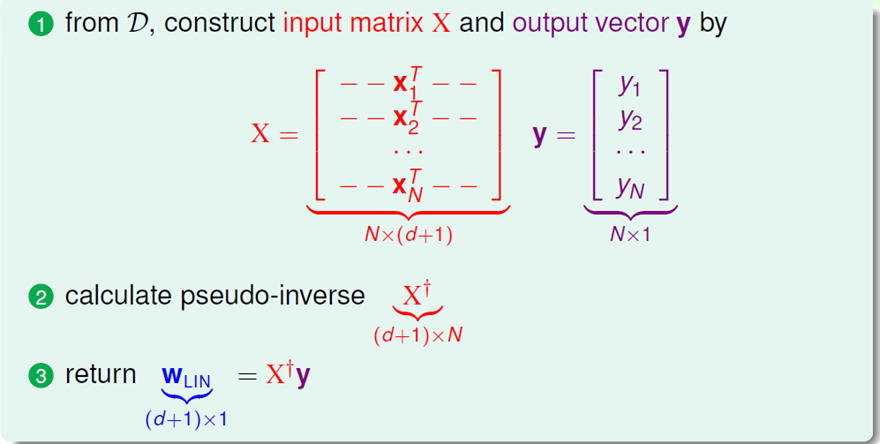

总结一下Linear Regression算法:

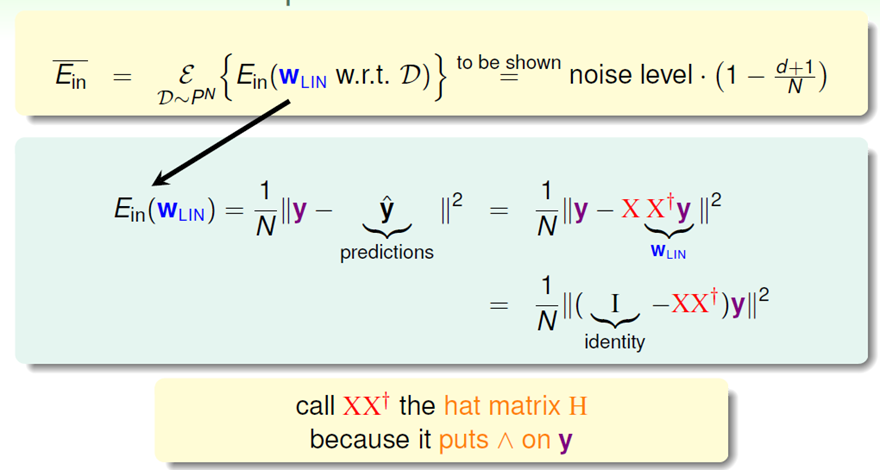

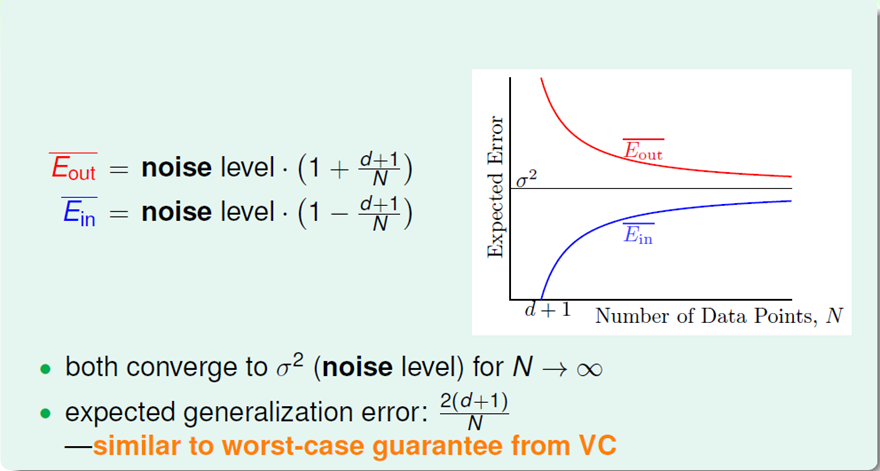

这里我们可以通过概率知识,求得Ein的大小:

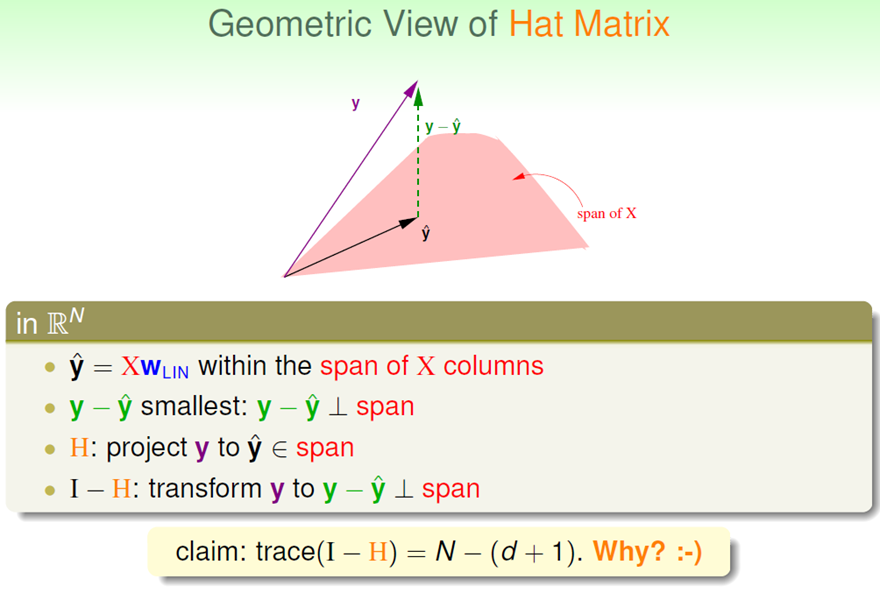

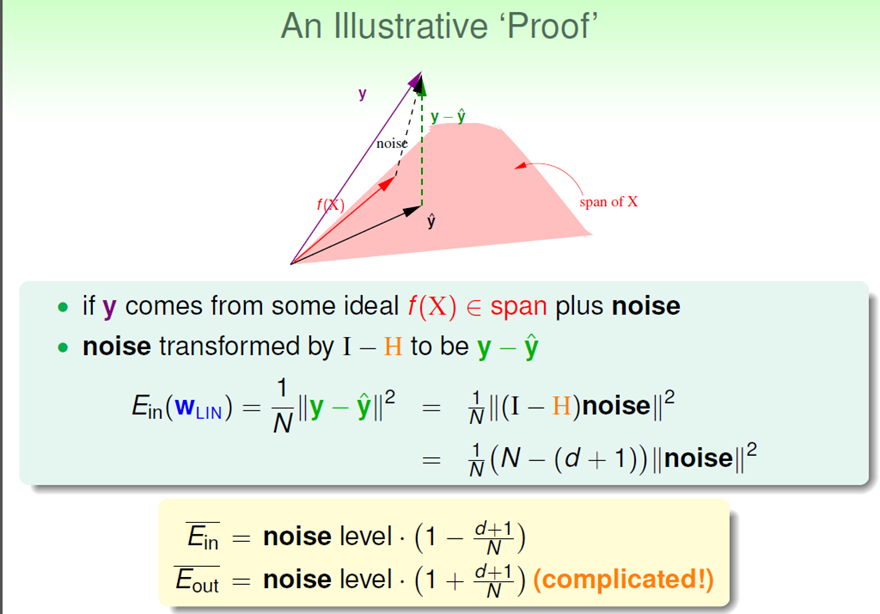

对于上面这一张PPT:所有的向量都在N维空间里,由(d+1)个N维x张成的span最多是d+1维的,H也是d+1维的,H将N维空间中的向量投影到span{X}中,而(I-H)将向量投影到与span{X}垂直的空间中,所以有trace(I-H)=N-(d+1)。(具体的可用数学证明)。

本文介绍了线性回归的基本概念及其在机器学习中的应用。基于台湾大学林轩田老师的课程内容,详细解析了线性回归的计算原理及如何通过梯度下降等方法来最小化误差函数Ein。同时探讨了在高维空间中向量的投影问题。

本文介绍了线性回归的基本概念及其在机器学习中的应用。基于台湾大学林轩田老师的课程内容,详细解析了线性回归的计算原理及如何通过梯度下降等方法来最小化误差函数Ein。同时探讨了在高维空间中向量的投影问题。

![clip_image002[6] clip_image002[6]](https://i-blog.csdnimg.cn/blog_migrate/9307270097f900cd903d524ed35a4285.png)

5万+

5万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?