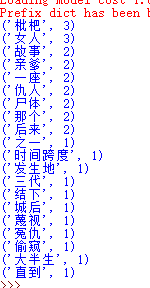

import jieba txt=open('test.txt','r',encoding='utf-8').read() words=list(jieba.cut(txt)) exc={'我们','可是','自己','他们','一个',} keys=set(words) keys=keys-exc dic={}#定义一个空字典 for i in keys: if len(i)==1: continue else: dic[i]=words.count(i) wc=list(dic.items()) wc.sort(key=lambda x:x[1],reverse=True)#排序 for i in range(20): print(wc[i])

本文介绍了一种使用Python的jieba库进行中文文本分词的方法,并展示了如何统计分词后的词频,排除一些常用词汇后,通过词频排序找出最重要的关键词。

本文介绍了一种使用Python的jieba库进行中文文本分词的方法,并展示了如何统计分词后的词频,排除一些常用词汇后,通过词频排序找出最重要的关键词。

707

707

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?