1、异(加下划线是工程上的不同)

(1)两者损失函数不一样

(2)LR无约束、SVM有约束

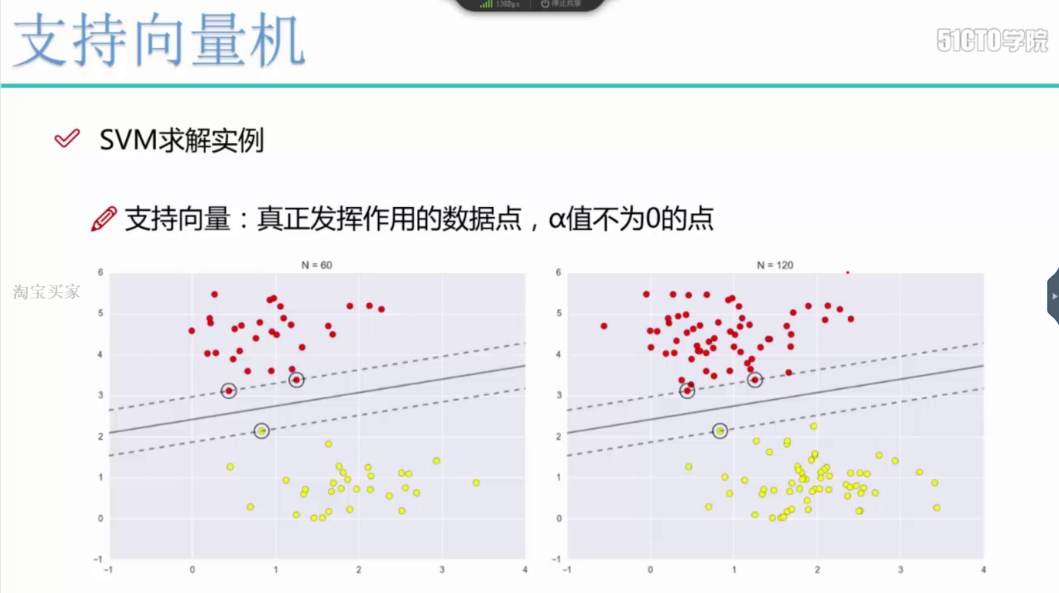

(3)SVM仅考虑支持向量。

(4)LR的可解释性更强,SVM先投影到更高维分类再投影到低维空间。

(5)SVM不能给出概率结果。

(6)SVM是自带有约束条件的正则,泛化能力比LR好。LR是无约束正则。

(7)SVM在处理非线性问题比LR更好更快。实际上差不多,SVM常用的核函数为高斯核和非线性核函数。LR也可以映射到高维,但SVM采用核函数映射到高维更快。

2、同

(1)都是二分类

(2)都采用正则化

本文详细比较了逻辑回归(LR)和支持向量机(SVM)两种机器学习方法的区别与联系,包括它们的损失函数、约束条件、支持向量使用、可解释性、核函数应用及非线性问题处理等方面的异同。

本文详细比较了逻辑回归(LR)和支持向量机(SVM)两种机器学习方法的区别与联系,包括它们的损失函数、约束条件、支持向量使用、可解释性、核函数应用及非线性问题处理等方面的异同。

913

913

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?