说到网站数据的爬取,目前为止我见过最复杂的就是天猫了,现在我想对它进行整站的爬取

我们先来看下天猫主页的界面

天猫页面很明显是动态页面 所以我们需要用selenium模块

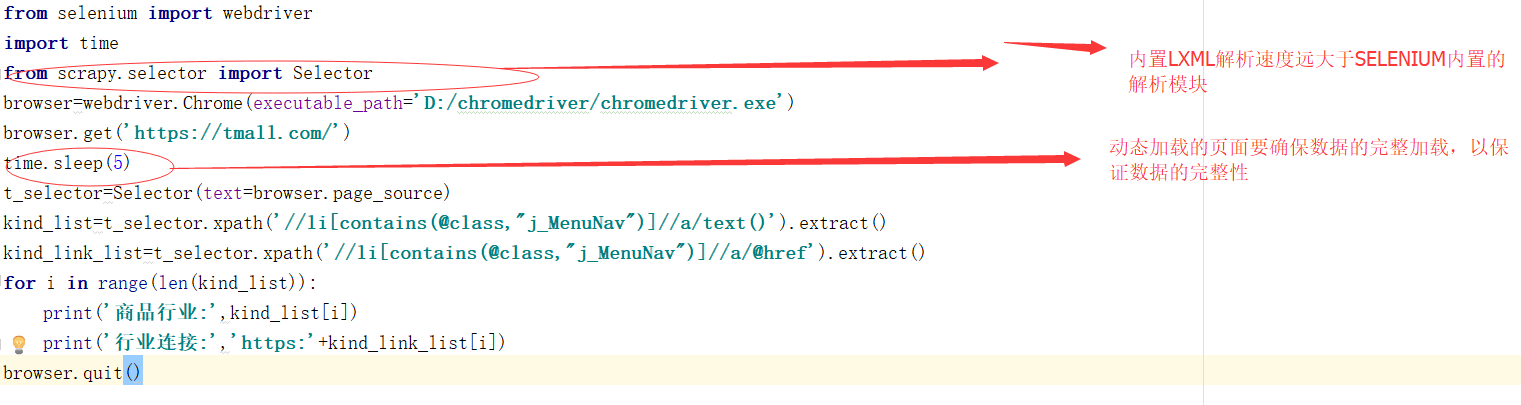

首先我们抓取下行业列表,留作之后的深度爬取

我们来看下结果:

看到商品链接和行业列表的完美展现了吧

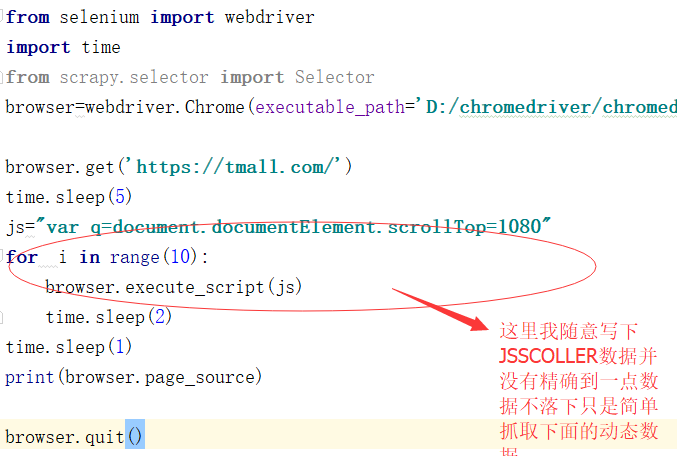

可是当前页面并没抓取完毕,我们现在看下首页还有什么内容

我们顺带抓取下发先并没有我们想要的东西,说明页面没有抓取完毕,熟悉网站制作的同僚们因该知道这样的页面都是用OVERFLOW:hidden的方式来做的布局,所以我们可以利用JS的SCOLLER事件来进行动态加载获取当前整个页面的源码

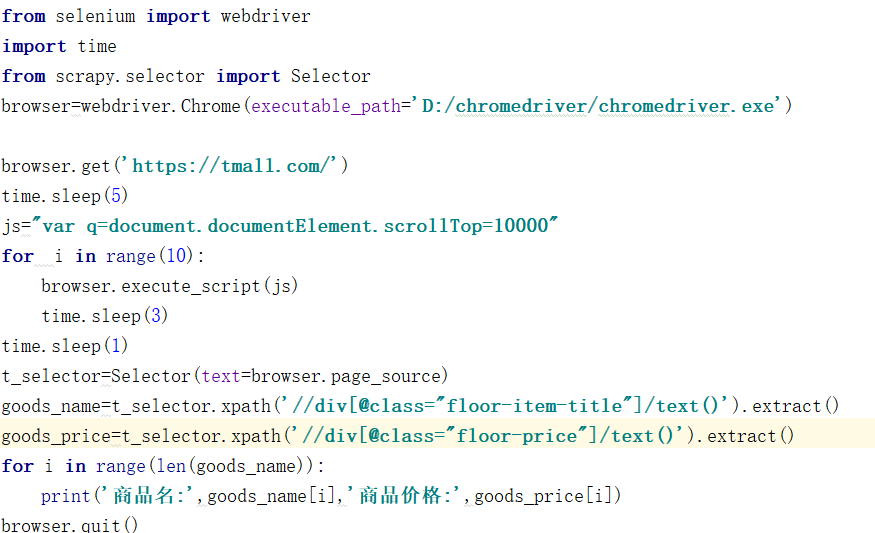

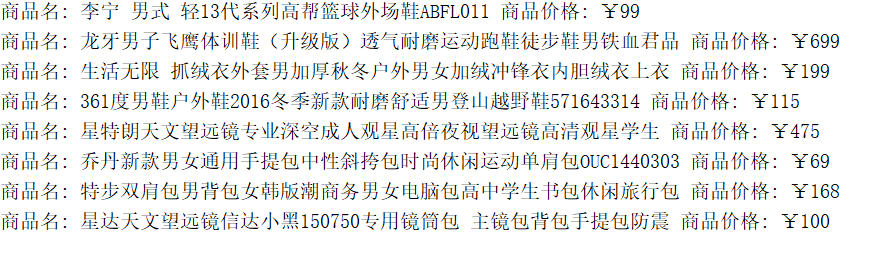

我们把打印的源码拿下来分析下抓取优惠卷的价格和提供商品的价格

我们把打印的源码拿下来分析下抓取优惠卷的价格和提供商品的价格

由于我的网络和设置的数值过大所以数据加载的不完整:

看下结果:

好好调整一下 就可以获取所有数据

天猫网页动态数据爬取

天猫网页动态数据爬取

本文介绍使用Selenium模块对天猫网站动态加载内容进行爬取的方法。通过抓取行业列表和商品链接,再利用JS SCOLLER事件实现整页源码获取。最后展示了如何抓取优惠券价格和商品价格。

本文介绍使用Selenium模块对天猫网站动态加载内容进行爬取的方法。通过抓取行业列表和商品链接,再利用JS SCOLLER事件实现整页源码获取。最后展示了如何抓取优惠券价格和商品价格。

7026

7026

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?