1.本质就是前向步进算法和加法模型,每一步计算分类器权重alpha和基分类器。

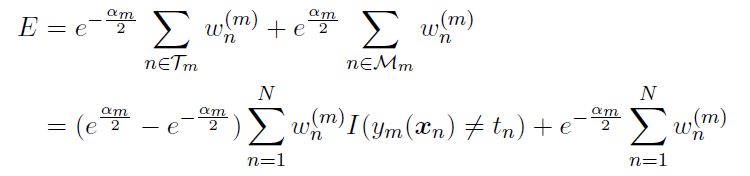

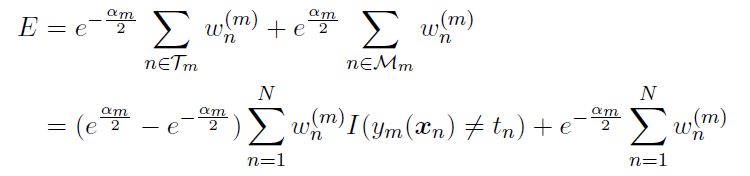

2.总体降低指数误差函数,转化为每一步降低分类误差率。

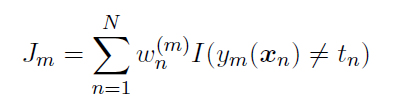

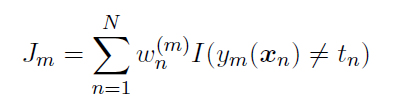

因为右边可以看作常数,所以相当于对这个进行优化

但是这一步可能做到最优吗?

如果是最优,那么左边这一项为0,为0?全部分类正确?

本文探讨了AdaBoost算法的本质,即前向步进算法与加法模型的结合,并深入讨论了如何通过逐步优化来降低指数误差函数,从而实现分类误差率的最小化。

本文探讨了AdaBoost算法的本质,即前向步进算法与加法模型的结合,并深入讨论了如何通过逐步优化来降低指数误差函数,从而实现分类误差率的最小化。

1.本质就是前向步进算法和加法模型,每一步计算分类器权重alpha和基分类器。

2.总体降低指数误差函数,转化为每一步降低分类误差率。

因为右边可以看作常数,所以相当于对这个进行优化

但是这一步可能做到最优吗?

如果是最优,那么左边这一项为0,为0?全部分类正确?

转载于:https://www.cnblogs.com/mdumpling/p/8649198.html

283

283

731

731

766

766

681

681

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?