本系列笔记内容参考来源为李航《统计学习方法》

参考:

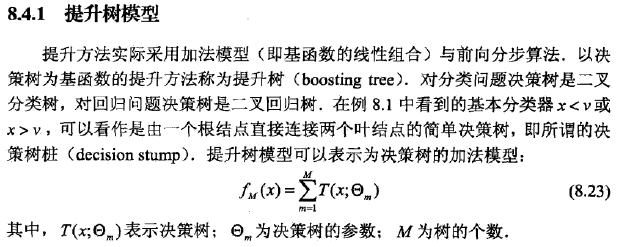

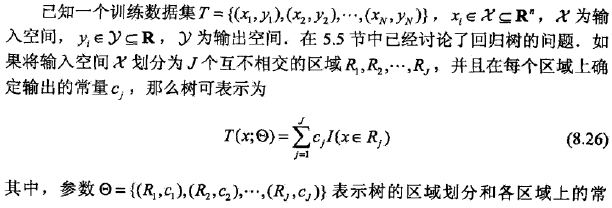

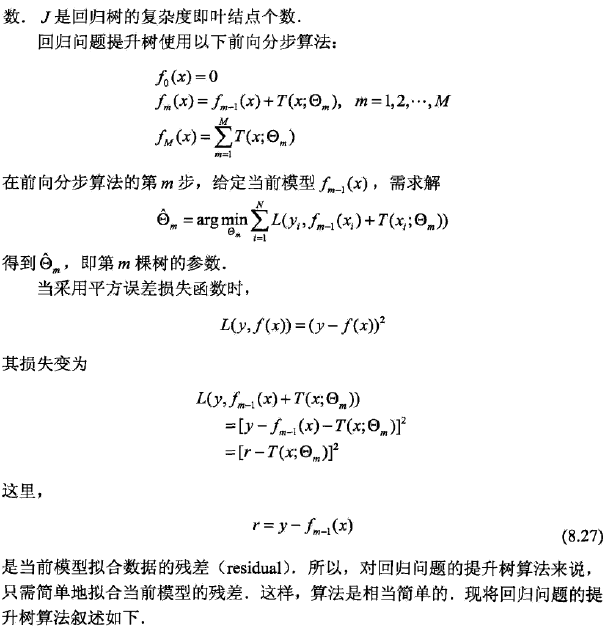

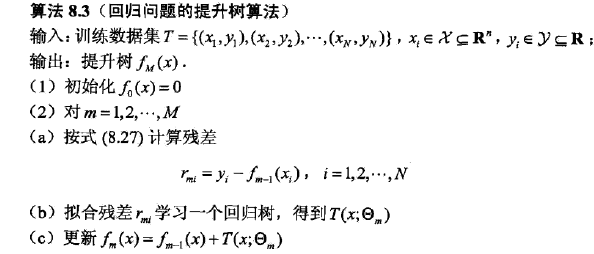

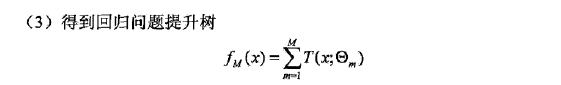

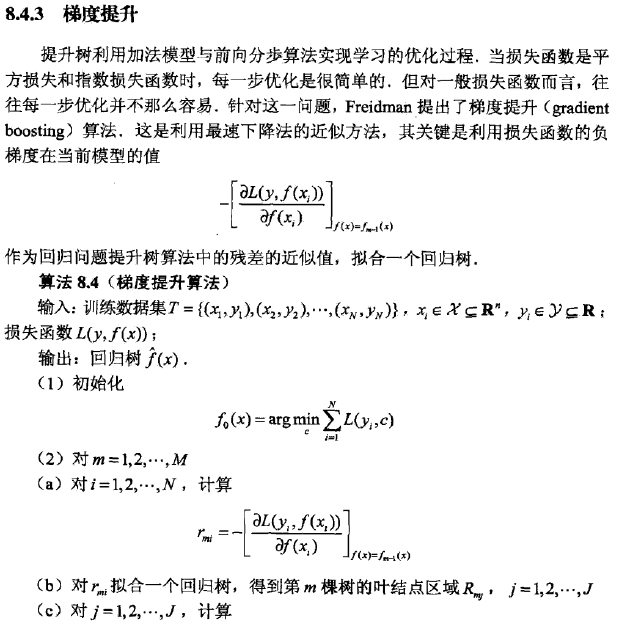

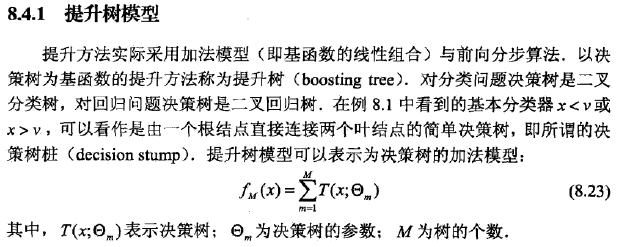

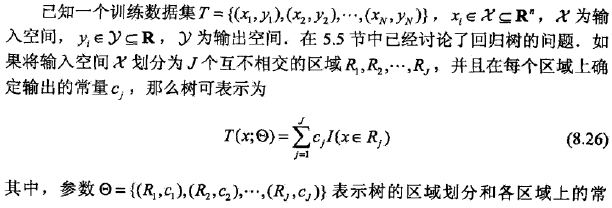

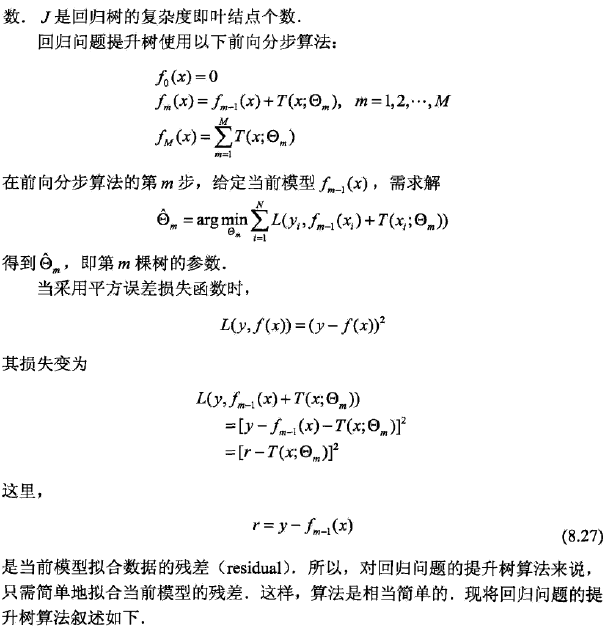

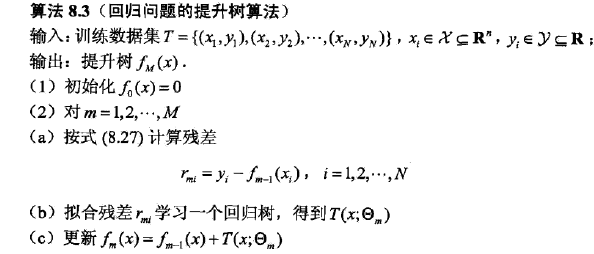

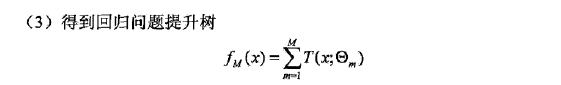

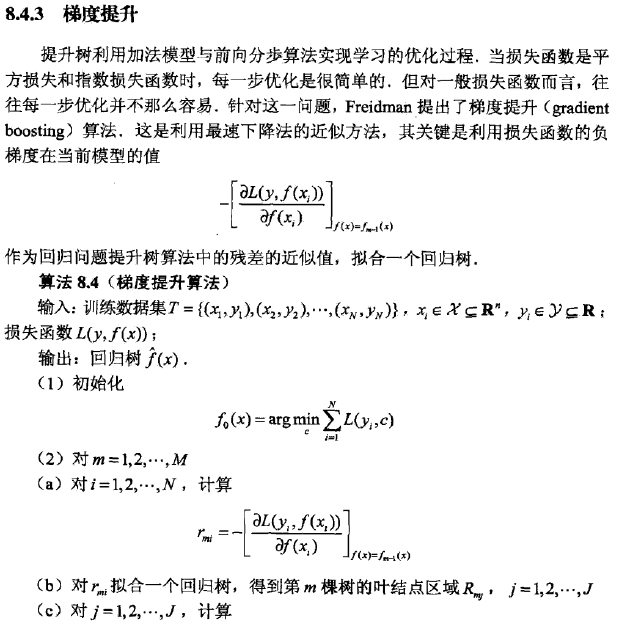

补充提升树内容

GBDT:梯度提升决策树

Boosting主要关注降低偏差,因此Boosting能基于泛化性能相当弱的学习器构建出很强的集成,Bagging主要关注降低方差,因此它在不剪枝的决策树、神经网络等学习器上效用更加明显。

参考:

https://www.jianshu.com/p/005a4e6ac775

本文深入探讨了Adaboost算法的原理与推导,同时补充介绍了提升树(GBDT)的相关内容,强调了Boosting与Bagging在降低偏差与方差上的不同作用。

本文深入探讨了Adaboost算法的原理与推导,同时补充介绍了提升树(GBDT)的相关内容,强调了Boosting与Bagging在降低偏差与方差上的不同作用。

本系列笔记内容参考来源为李航《统计学习方法》

参考:

补充提升树内容

Boosting主要关注降低偏差,因此Boosting能基于泛化性能相当弱的学习器构建出很强的集成,Bagging主要关注降低方差,因此它在不剪枝的决策树、神经网络等学习器上效用更加明显。

参考:

https://www.jianshu.com/p/005a4e6ac775

转载于:https://www.cnblogs.com/wwf828/p/9925907.html

2530

2530

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?