1.中软国际华南区技术总监曾老师还会来上两次课,同学们希望曾老师讲些什么内容?

在工作上一般用python操作什么,python的实际应用之类的,也可以虚拟一个项目来进行实践。

2.中文分词

- 下载一中文长篇小说,并转换成UTF-8编码。

- 使用jieba库,进行中文词频统计,输出TOP20的词及出现次数。

- **排除一些无意义词、合并同一词。

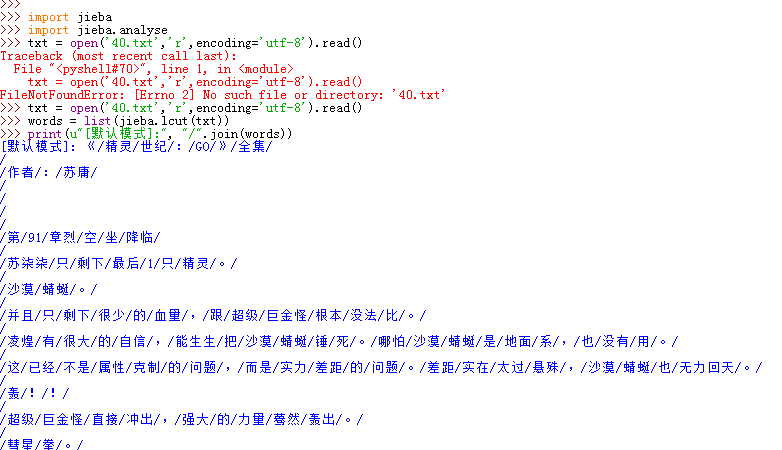

import jieba import jieba.analyse txt = open('40.txt','r',encoding='utf-8').read() words = list(jieba.lcut(txt)) print(u"[默认模式]:", "/".join(words))

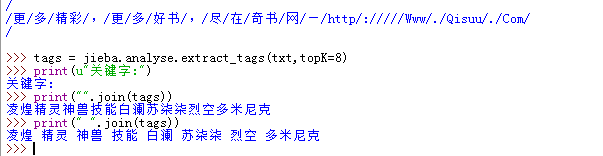

tags = jieba.analyse.extract_tags(txt, topK=20) print(" ".join(tags))

1159

1159

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?