.中文分词

- 下载一中文长篇小说,并转换成UTF-8编码。

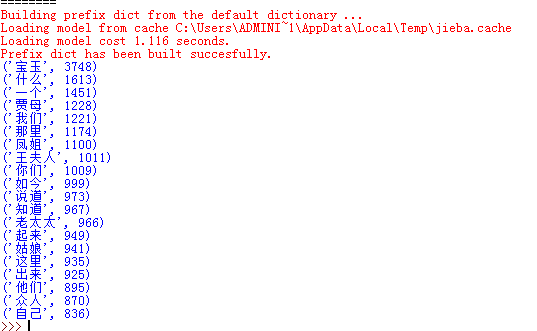

- 使用jieba库,进行中文词频统计,输出TOP20的词及出现次数。

- 排除一些无意义词、合并同一词。

- 对词频统计结果做简单的解读。

import jieba fo=open('G:\大三上\管理信息系统\9.29\红楼梦 1.txt','r',encoding='UTF-8') str=fo.read() fo.close() words=list(jieba.cut(str))#分词 dic={} for w in words: if len(w)==1: continue else: dic[w]=dic.get(w,0)+1 wc=list(dic.items()) wc.sort(key=lambda x:x[1],reverse=True) for i in range(20): print(wc[i])

《红楼梦》中文分词与词频统计

《红楼梦》中文分词与词频统计

本文介绍了一种使用Python的jieba库对《红楼梦》进行中文分词并统计词频的方法。通过下载《红楼梦》全文并转换为UTF-8编码,实现了对文本的分词处理,并统计了出现频率最高的前20个词语。

本文介绍了一种使用Python的jieba库对《红楼梦》进行中文分词并统计词频的方法。通过下载《红楼梦》全文并转换为UTF-8编码,实现了对文本的分词处理,并统计了出现频率最高的前20个词语。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?