一、修改hadoop的配置文件(五个)

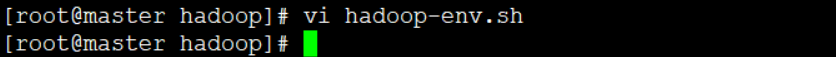

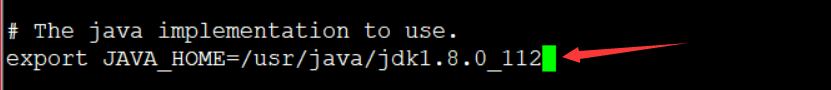

• 修改hadoop-env.sh

• 修改core-site.xml

<configuration><!--用来指定HDFS的老大(NameNode)的地址-->

<property>

<name>fs.defaultFS</name>

<value>hdfs://master:9000</value>

</property>

<!--用来指定Hadoop运行时产生文件存放目录-->

<property>

<name>hadoop.tmp.dir</name>

<value>/master/hadoop-2.6.4/tmp</value>

</property>

</configuration>

• 修改hdfs-site.xml

<configuration><!--指定HDFS存储数据副本的数量-->

<property>

<name>dfs.replication</name>

<value>1</value>

</property>

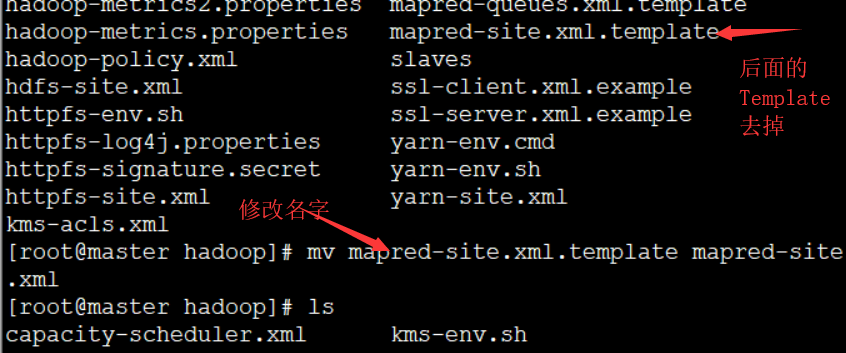

• 修改mapred-site.xml(mv mapred-site.xml.template mapred-site.xml)

<configuration>

<--告诉Hadoop以后MR运行在YARN上

<property>

<name>papreduce.framework.name</name>

<value>yarn</value>

</property>

• yarn-site.xml

<configuration><!--NodeManager获取数据的方式是shuffle-->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!--指定yarn的老大(ResourceManager)的地址-->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>master</value>

</property>

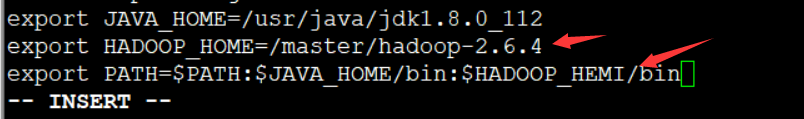

二、配置Hadoop环境变量并启动

1. 把Hadoop中的bin添加到环境变量中,使得在任何地方都能运行

刷新匹配值source /etc/profile

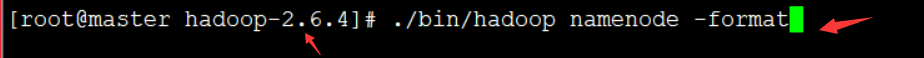

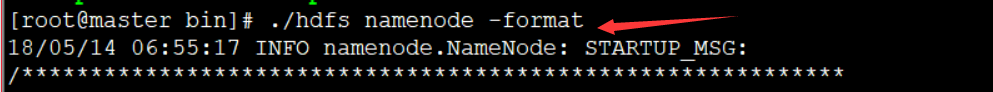

2.初始化HDFS(格式化文件系统)

这个所说过时了,但可以用,当然了现在用这个命令,它已经归类到hdfs下了

3.启动HDFS和YARN

先启动HDFSsbin/start-dfs.sh

再启动YARN

sbin/start-yarn.sh

本文介绍了Hadoop集群的基本配置步骤,包括修改五个关键配置文件(hadoop-env.sh、core-site.xml、hdfs-site.xml、mapred-site.xml及yarn-site.xml),以及设置环境变量和启动HDFS与YARN的方法。

本文介绍了Hadoop集群的基本配置步骤,包括修改五个关键配置文件(hadoop-env.sh、core-site.xml、hdfs-site.xml、mapred-site.xml及yarn-site.xml),以及设置环境变量和启动HDFS与YARN的方法。

5346

5346

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?