urllib是python自带的模块,使用时直接导入即可,不需要下载安装。在写爬虫时,需要用到urllib模块下的request模块。下面我们通过一个简单的例子来进行说明。

from urllib import request

url = r"http://www.baidu.com/"

# 发送请求,获取响应信息

response = request.urlopen(url).read()

print(response)

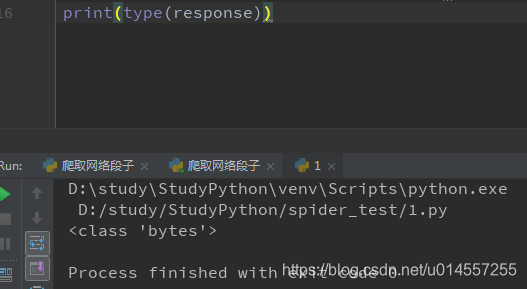

上面我们获取了百度首页的信息:首先定义一个url,之后发送请求,获取响应信息,其中read()函数用于读取返回的内容(如果不添加read()函数,则只返回响应状态码)。此时,我们获取的信息中中文是以一个中间状态的二进制(字节码)显示的,查看响应信息字符类型,返回结果为:

那么,如何将中文正常显示呢?我们使用decode()函数对响应内容进行解码:

response = request.urlopen(url).read().decode() #解码

此时再执行程序,响应信息中的中文就可以正常显示了。

本文介绍了Python自带的urllib模块,写爬虫时会用到其下的request模块。通过获取百度首页信息的例子说明,先定义url、发送请求获取响应信息,读取内容时中文以二进制显示,使用decode()函数对响应内容解码后,中文可正常显示。

本文介绍了Python自带的urllib模块,写爬虫时会用到其下的request模块。通过获取百度首页信息的例子说明,先定义url、发送请求获取响应信息,读取内容时中文以二进制显示,使用decode()函数对响应内容解码后,中文可正常显示。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?