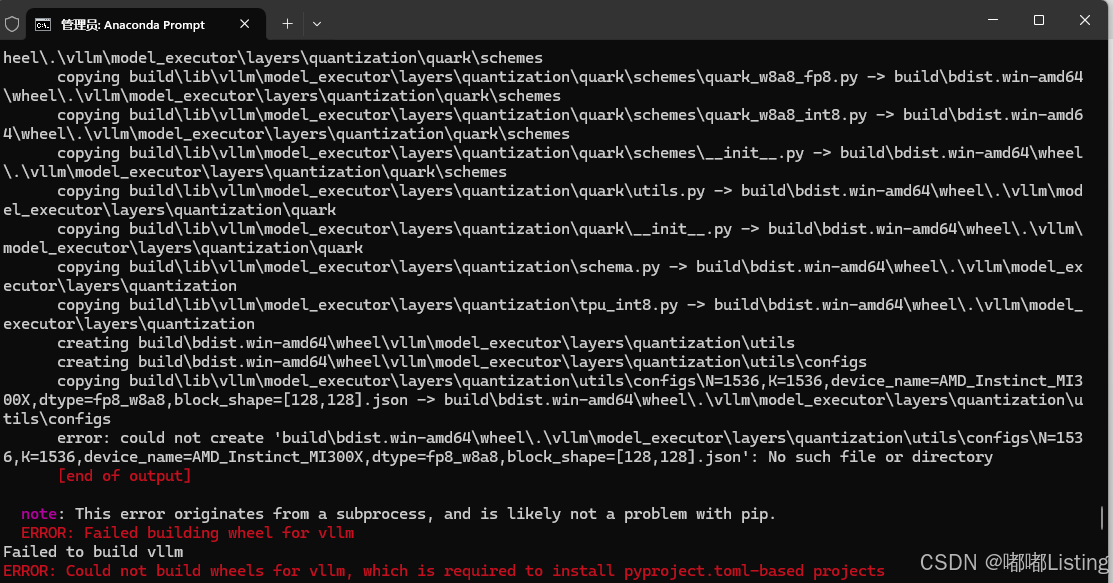

尝试1:

pip install pyproject -i https://mirrors.tuna.tsinghua.edu.cn/pypi/web/simple

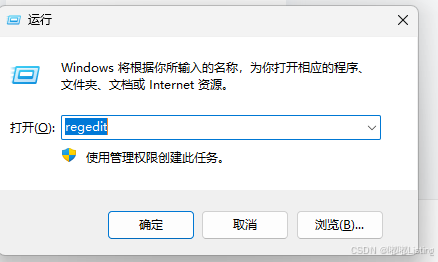

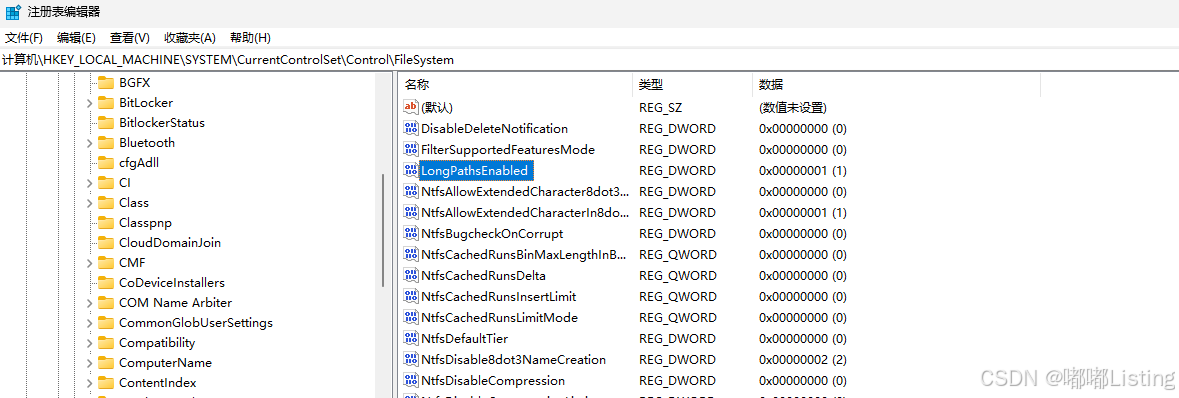

解决2:

\HKEY_LOCAL_MACHINE\SYSTEM\CurrentControlSet\Control\FileSystem路径下的变量 LongPathsEnabled, 将其置为 1

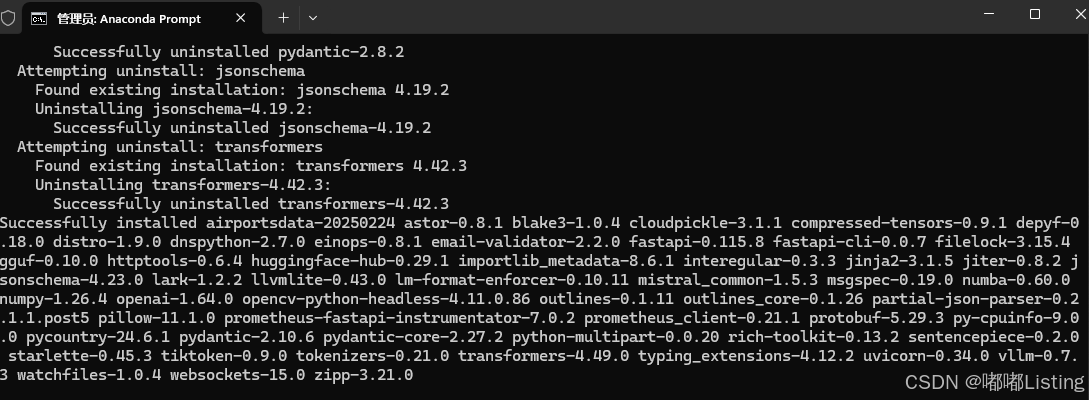

运行:

pip install vllm --no-cache-dir --use-pep517 -i https://pypi.tuna.tsinghua.edu.cn/simple

4175

4175

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?