自然语言数据可以看成一种特殊的时间序列数据。对于这种时序数据的采样主要有有随机采样和相邻采样两种方式。两者都需要确定一个batch的样本数量batch_size和每个样本的时间步长num_steps。

随机采样

步骤:语料库corpus_indices的长度为nnn,首先按照时间步长确定可能的样本的起始索引,可能的样本起始索引最后被随机打散。这里注意:采样的单个样本的最后一个单词不可能是序列的最后一个字(否则,就没有输入子序列所对应的输出子序列)

num_examples = (len(corpus_indices) - 1) // num_steps

#下取整,得到不重叠情况下的样本个数

print("num_examples:"+str(num_examples))

example_indices = [i * num_steps for i in range(num_examples)]

#每个样本的第一个字符在corpus_indices中的下标

random.shuffle(example_indices)

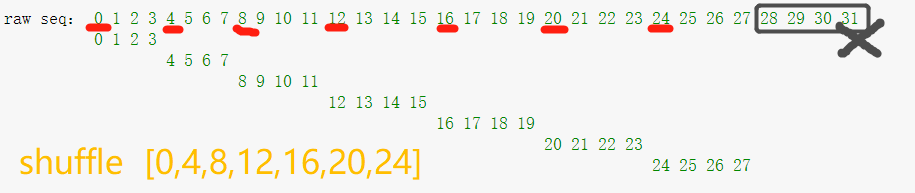

如图所示:对于一个长度为32序列0,1,2,…,31,时间步长取4,batch大小取3时,有效长度只有28。

这里的随机化是指单个batch内部的样本是随机抽取的,在一个batch内部如果起始索引相邻则样本可能相邻。值得注意的是,相邻的两个batch在原始序列上不一定相邻。取决于起始索引被随机化的情况。

import torch

import random

def data_iter_random(corpus_indices, batch_size, num_steps, devic

本文探讨了自然语言处理中时间序列数据的两种主要采样方法:随机采样和相邻采样。通过详细解释每种方法的实现过程,包括如何确定样本数量、时间步长以及如何生成训练批次,帮助读者理解其在实际应用中的作用。

本文探讨了自然语言处理中时间序列数据的两种主要采样方法:随机采样和相邻采样。通过详细解释每种方法的实现过程,包括如何确定样本数量、时间步长以及如何生成训练批次,帮助读者理解其在实际应用中的作用。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1243

1243

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?