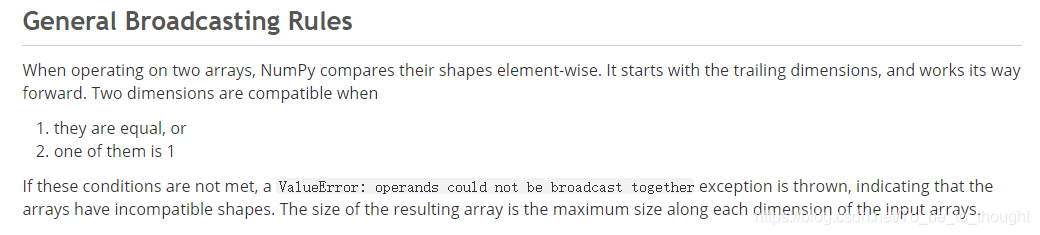

广播(broadcast)规则

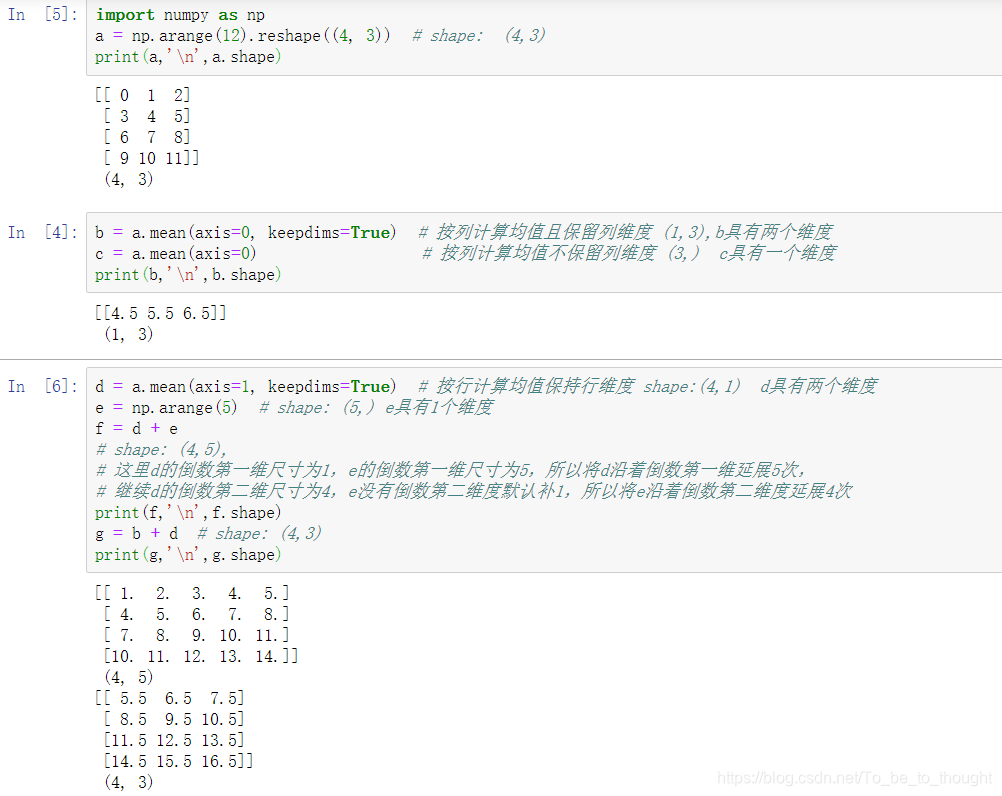

对于两个数组,对于它们的维度元组倒序看,当两者在当前维度的尺寸相等或者有一个为1,则在当前维度兼容,只需要将尺寸为1的按照另一个较大的尺寸在该维度延展。如果某一个数组没有对应维度时则用1来补。高维度矩阵广播也可以按照这个来分析。

示例

Pytorch中的视图方法(view)

def squared_loss(y_hat, y):

return (y_hat - y.view(y_hat.size()))

#case analysis

1. y_hat.view(-1) - y)

2. (y_hat - y.view(-1))

3. (y_hat - y.view(y_hat.shape))

4. (y_hat - y.view(-1, 1))

首先要明确两个变量模型估计值y_hat和真实值y的输入shape,

y_hat是通过严格矩阵运算得到的所以shape为

(

n

,

1

)

(n,1)

(n,1),而y的shape为

(

n

,

)

(n,)

(n,)这时就需要来统一它们的shape,所以1,3,4都是统一shape的操作,考虑情形2如下,显然错误。

(

n

,

1

)

−

(

n

,

)

⟶

(

n

,

n

)

(n,1)-(n,) \longrightarrow(n,n)

(n,1)−(n,)⟶(n,n)

本文详细解析了广播规则在数组操作中的应用,特别是在PyTorch中如何使用视图方法统一不同形状张量的维度,确保矩阵运算的正确进行。通过具体示例,展示了如何避免因形状不匹配导致的计算错误。

本文详细解析了广播规则在数组操作中的应用,特别是在PyTorch中如何使用视图方法统一不同形状张量的维度,确保矩阵运算的正确进行。通过具体示例,展示了如何避免因形状不匹配导致的计算错误。

1万+

1万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?