自Stable Diffusion发布以来,AI写真一直是AIGC界的热门话题。

AI写真为摄影师和艺术家提供了全新的创作工具。通过AI技术,艺术家可以轻松实现复杂的图像效果,如风格迁移、图像合成等,AI写真能够在短时间内完成传统摄影师和设计师需要耗费大量时间和精力才能实现的效果。

从这篇文章开始,我将陆续介绍使用Stable Diffusion进行AI写真的方式方法,用到的工具包括 Stable Diffusion WebUI 和 ComfyUI,感兴趣的同学请及时关注,以免错过重要信息。

本文介绍使用 IP-Adapter-FaceId 进行AI写真创作的方法。这种方法使用来自面部识别模型的面孔ID嵌入,而不是CLIP图像嵌入;另外,这种方法还使用LoRA来提高ID一致性。IP-Adapter-FaceID仅凭文本提示就可以根据一张面孔生成各种风格的图像。

效果演示

像不像先不说,我们先来看看好不好看(大家猜猜她是谁?):

实现原理

AI写真是利用人工智能技术生成或增强的照片。这种技术结合了计算机视觉、深度学习和图像处理等先进的算法,使得机器能够自动生成、修复、增强或编辑照片。

具体来说,目前AI写真的实现方式大概有如下几种:

- 使用ControlNet:ControlNet为Stable Diffusion提供了一些精细控制能力,它可以从参考图片中提取一些特征信息,比如人脸、姿势、色彩、线稿等等,然后在生成的图片中应用这些信息,从而在AI写真中达到精细的人物形象控制效果。

- 结合换脸技术:先使用SD、Midjourney等AI绘画工具生成若干符合场景或风格要求的人物图片,然后再使用AI换脸技术更换图片中的人物面部形象,从而实现AI写真的目的。

- 训练LoRA模型:LoRA本身一种模型微调技术,可以让模型在某方面的生成能力得到大幅增强。对于AI写真,我们先准备若干张目标人物或者风格的图片,然后使用工具训练出特定人物的LoRA模型,最后使用这个LoRA模型即可生成目标人物在各种场景、各种风格下的逼真图像。

为了更好的艺术效果,我们还可以使用专用的摄影模型、风格模型,搭配精细的提示词,实现特定的艺术效果。

使用 IP-Adapter-FaceId

这里以 Stable Diffusion WebUI 为例,ComfyUI 的使用示例见下文。

因为 IP-Adapter-FaceId 在 SDXL算法中的效果不太好,所以本文将使用 SD 1.5 模型进行演示。

打开“文生图”页面,首先我们需要选择SD基础模型、设置提示词和负向提示。模型下载方式见文末资源下载。

这几个参数我介绍下注意事项:

- SD基础模型:建议选择真实风格、摄影风格的模型,以更加贴近现实;

- 正向提示词:你想要的画面内容,我们可以使用 IP-Adapter-FaceId 的LoRA模型 ,加强图像生成对人物面部特征的识别。

- 反向提示词:不想要的画面内容,因为AI绘画中的人手经常画不好,所以我在这里写一个 hands,让生成的图片中尽量不要出现人手。

然后我们需要设置一些采样参数,采样器大家选择自己常用的即可,这里我使用的是 DPM++ 2M,调度器选择的是 Karras,采样步数 27,这个搭配比较适合细节优化。

其它参数也介绍下:

- 图片的宽度和高度根据自己的需要设置,不要设置的太大,图片越大,生成的越慢。如果特别需要大图,可以在生成完毕之后,再到高清化中进行放大。

- 生成次数:使用当前的参数生成几次。

- 每次数量:每次生成时,同时生成几张图片。显存小不要修改,显存大的同学可以设置的大点。

上边已经把 Stable Diffusion 的基础参数设置完了,下边开始设置 IP-Adapter-FaceId 的参数。在 Stable Diffusion WebUI 中,IP-Adapter-FaceId 基于 ControlNet 提供面部特征提取和生成控制。

在“文生图”页面下方,启用一个 ControlNet单元,上传一张参考图片(现在你应该知道效果图中是谁了),如下图所示:

建议每次都勾选“完美匹配像素”,这样可以让ControlNet提取的图片特征更符合生成参数中设置的图片宽度和高度。

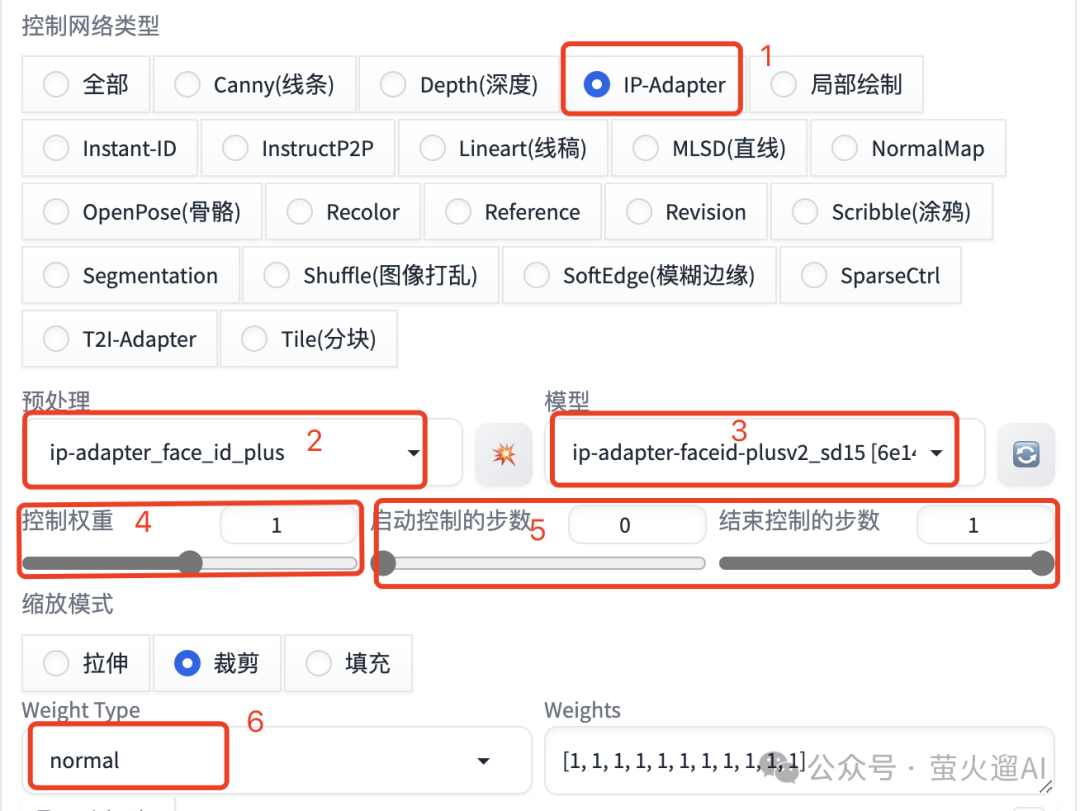

接着我们设置 IP-Adapter 的更多参数,如下图所示:

- 控制网络类型:勾选“IP-Adapter”

- 预处理器:选择“ip-adapter_face_id_plus”,如果没有这个预处理器,请更新ControlNet插件到最新版本。预处理器模型需要下载,下载方式见文末。

- 模型:选择“ip-adapter-faceid-plusv2_sd15”,模型需要下载,下载方式见文末。

- 控制权重:ControlNet对生成图片的影响力,值越大生成图片越遵从ControlNet的控制,用于精细控制,一般默认即可。

- 控制步数:在生成图片的第几步介入和退出ControlNet控制,用于精细控制,一般默认即可。

- Weight Type:高级权重参数,可以控制图片的风格和构图迁移效果,比如只迁移构图,或者只迁移风格。因为我们主要参考面部特征,所以这里使用默认的 normal 即可。

最后,我们只要点击“生成”,静待写真图生成就好了。

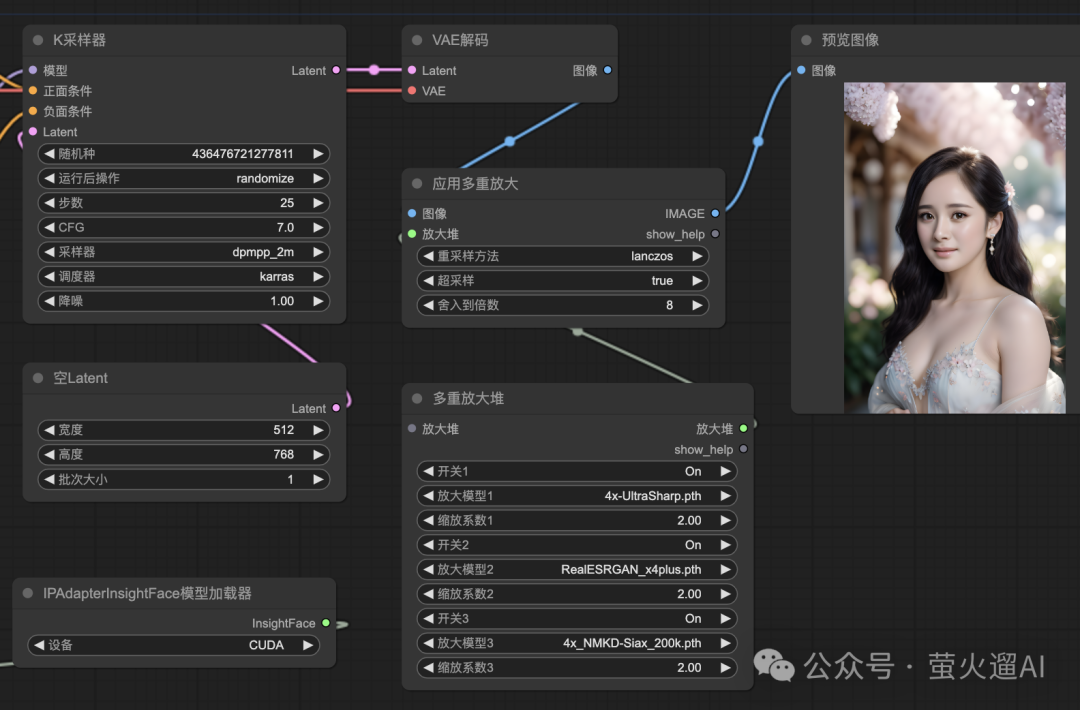

使用 ComfyUI 工作流

在 ComfyUI 中使用 IP-Adapter-FaceId 时,需要安装一些插件,主要就是这个:https://github.com/cubiq/ComfyUI_IPAdapter_plus,不方便访问外网的同学可以到文末下载我整理的资源。

需要的可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

1.stable diffusion安装包 (全套教程文末领取哈)

随着技术的迭代,目前 Stable Diffusion 已经能够生成非常艺术化的图片了,完全有赶超人类的架势,已经有不少工作被这类服务替代,比如制作一个 logo 图片,画一张虚拟老婆照片,画质堪比相机。

最新 Stable Diffusion 除了有win多个版本,就算说底端的显卡也能玩了哦!此外还带来了Mac版本,仅支持macOS 12.3或更高版本。

2.stable diffusion视频合集

我们在学习的时候,往往书籍代码难以理解,阅读困难,这时候视频教程教程是就很适合了,生动形象加上案例实战,一步步带你入门stable diffusion,科学有趣才能更方便的学习下去。

3.stable diffusion模型下载

stable diffusion往往一开始使用时图片等无法达到理想的生成效果,这时则需要通过使用大量训练数据,调整模型的超参数(如学习率、训练轮数、模型大小等),可以使得模型更好地适应数据集,并生成更加真实、准确、高质量的图像。

4.stable diffusion提示词

提示词是构建由文本到图像模型解释和理解的单词的过程。可以把它理解为你告诉 AI 模型要画什么而需要说的语言,整个SD学习过程中都离不开这本提示词手册。

5.AIGC视频教程合集

观看全面零基础学习视频,看视频学习是最快捷也是最有效果的方式,跟着视频中老师的思路,从基础到深入,还是很容易入门的。

实战案例

纸上得来终觉浅,要学会跟着视频一起敲,要动手实操,才能将自己的所学运用到实际当中去,这时候可以搞点实战案例来学习。

这份完整版的学习资料已经上传优快云,朋友们如果需要可以微信扫描下方优快云官方认证二维码免费领取【保证100%免费】

Stable Diffusion实现AI写真创作方法

Stable Diffusion实现AI写真创作方法

1992

1992

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?