智能家居:用于控制家用设备的多模态交互

摘要

本文提出了一种新颖的多模态交互系统,该系统为身体活动能力受限的人群提供了三种交互模式,以实现对智能家居系统的监控与控制。第一种模式基于脑机接口(BCI,Brain Computer Interface),通过使用非侵入式神念科技可穿戴设备的表面脑电图电极(EEG)实现,该脑机接口的控制由人眼的眨眼来完成。第二种模式基于语音识别系统,用户通过对话系统发出语音命令进行操作。第三种模式基于移动设备上的可配置触摸屏。这三种交互模式可根据用户需求灵活切换。

多模态交互系统允许通过在资源受限的嵌入式系统上实现的家庭网关来控制家用设备和家用电器,该家庭网关负责将多模态界面检测到的用户命令应用到相应的家用设备。命令集可根据不同用户的需求和能力进行配置和扩展。在本研究中,开发了该系统的原型以验证交互模式。该系统为具有不同用户配置文件的用户提供了充分且易于理解的操作。我们的初步测试表明,对于身体活动能力受限的用户,多模态控制是有效的。

CCS概念

• 以人为本的计算 ➝ 人机交互 ➝ 交互范式 ➝ 自然语言接口

关键词

多模态交互,眨眼,脑控交互,语音助手,触摸界面

ACM 参考格式:

米格尔·A·孔特雷拉斯‐卡斯塔涅达、胡安·A·奥尔加多‐特里萨、贡萨洛·蓬博萨‐洪内斯、帕特里夏·帕德罗斯基‐罗德里格斯和弗朗西斯科·L·古铁雷斯‐韦拉。2019年。智能家居:家用设备控制的多模态交互。收录于第二十届国际人机交互会议(Interacción 2019),2019年6月25日至28日,西班牙吉普斯夸省多诺斯蒂亚。ACM,美国纽约州纽约市,8页 https://doi.org/10.1145/3335595.3335636

1 引言

近年来,市场上推出的许多设备都旨在通过使用新颖且创新的界面来改进和简化人机交互(HCI)[1]。这一演变得以体现。例如,传统的(手动)按钮已被遥控器取代,尤其是在基于用户的交互模态中,如手势界面[2]–[4]和语音 [5]。

然而,最大的挑战在于将不同设备集成到同一控制系统中,无论其交互模态和/或制造商如何。

总体而言,多模态多用户系统的开发必须采用全民设计范式,以便针对不同类型的用户简化系统的使用,充分考虑他们在文化、社会习俗、年龄等方面的差异。特别是,一个有趣的研究方向是创建新型的多模态系统,为身体行动受限的用户提供支持或帮助,使其能够在无需额外辅助的情况下与家用设备进行交互 [6],[7]。因此,在系统中引入设计适应性和可访问性功能,可以使这类用户在家庭或办公室环境中实现有效的交互。

已发表多项研究,这些研究使用非侵入性肌电图(EMG)和脑电图(EEG)电极来实现对用户命令的识别 [6],允许出于个人或课堂教学目的,免费复制或分发本作品的全部或部分内容,但不得以营利或商业利益为目的进行复制或分发,且所有副本须在首页注明本声明及完整引用信息。本作品中第三方组件的版权必须予以尊重。其他所有用途请联络版权所有者/作者。Interacción 2019,2019年6月25日至28日,西班牙吉普斯夸省多诺斯蒂亚 © 2019 版权由版权所有者/作者持有。出版权利授权予ACM。ACM ISBN 978‐1‐4503‐7176‐6/19/06…$15.00 https://doi.org/10.1145/3335595.3335636

本文档由 funstory.ai 的开源 PDF 翻译库 BabelDOC v0.5.10 (http://yadt.io) 翻译,本仓库正在积极的建设当中,欢迎 star 和关注。

INTERACCIÓN 2019年,2019年6月,西班牙吉普斯夸省多诺斯蒂亚 M. Contreras‐Castañeda 等

[8],[9]。为了实现这一点,这些系统通过肌肉活动(例如手势)[10]或脑活动[8],[11]来管理和识别模式或模式序列,以替代键盘输入。在基于手势的自然界面中,每个手势被映射到一个特定的用户命令[7],[12]。可以构建更复杂的手势语言,用于定义控制系统的用户命令,特别是用于控制家用设备[2],[13]。相反,在脑机接口(BCI)系统中,用户命令可以通过控制眼球运动[14],[15]或通过识别检测眼睛眨眼的模式[16]来获取。此外,眨眼信号单位可在脑机接口系统中用于建立瘫痪或运动障碍疾病患者之间通过计算机作为媒介将文本转换为语音的通信[9],[11]。

Hawley 等人 [5]提出了一种针对严重言语障碍人群的对话系统,该系统以语音识别系统作为交互模态,可捕捉语音输入并将其通过文本转语音方式发送给接收者。交互模态的组合也已成为研究课题,例如通过智能手机 [17]将脑机接口与语音结合到一个应用程序中。在这种情况下,通过网页浏览器实现对网站的导航,并结合由EEG电极捕获信号的模式识别来完成操作。

在本研究中,开发了一种专为身体活动能力受限人群控制家用设备而设计的多模态、多用户系统。该系统包含三种可互换的交互模态,以适应不同用户的需求和能力。第一种基于使用名为神念科技的可穿戴设备上的EEG电极检测眨眼信号;第二种基于语音识别,利用对话系统实现;最后一种基于触摸,通过智能手机上运行的应用程序在用户的移动设备屏幕上实现。

所开发的系统可配置且可定制,能够考虑技能、能力、年龄或偏好等个体差异。用户在系统运行过程中可以切换交互模态,并根据自身需求调整每种模态的执行方式。该原型系统名为SmartHome,基于人机对话,通过特定模态捕捉用户命令,并将其处理为智能家居系统中的具体操作。

本文的结构如下:第二节描述了系统架构及其组成部分,第三节探讨了每种交互模式(眨眼、语音和触摸)的实现,第四节解释了如何实现对用户的适应性,第六节包含了实验结果,最后第七节阐述了结论和未来工作。

2 系统架构

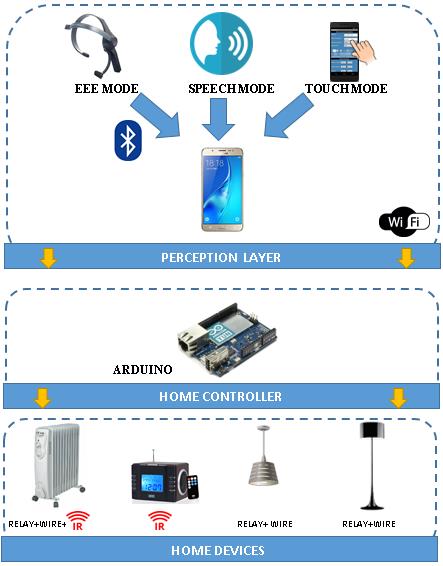

系统架构由三个层次结构组成,如图1所示。

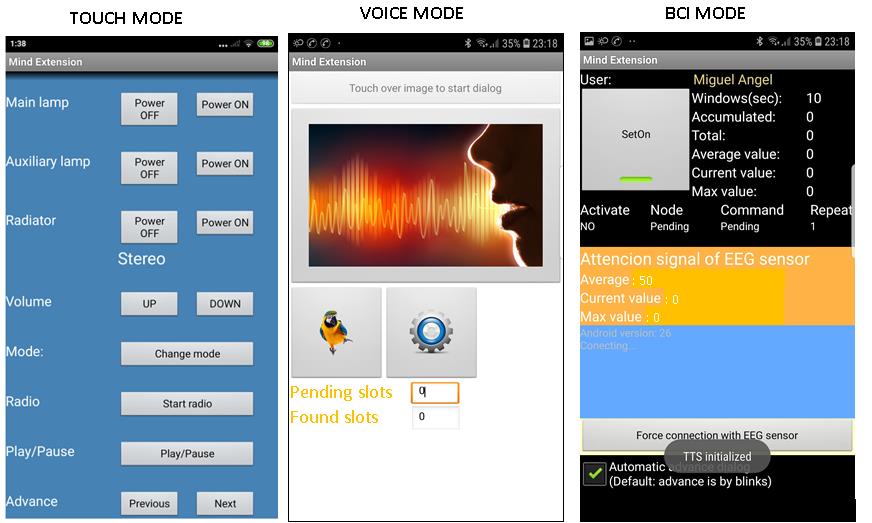

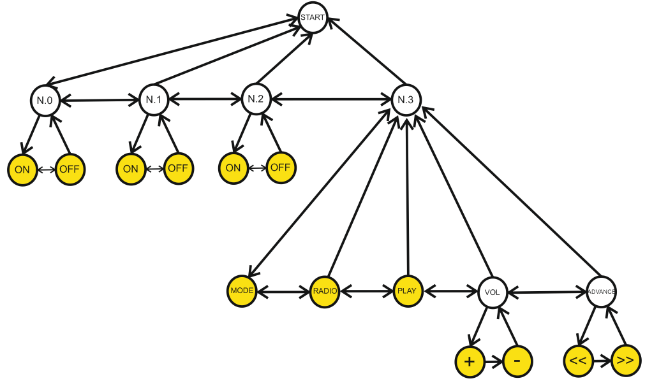

感知层 :负责捕捉用户与系统的交互,并对这些信息进行后续处理获取相应的用户命令以应用于智能家居系统。用户交互可以通过三种方式实现:(a) 脑机接口模式,(b) 语音模式和(c) 触摸模式。图2总结了智能家居系统中定义的用于不同交互模式的操作方式。

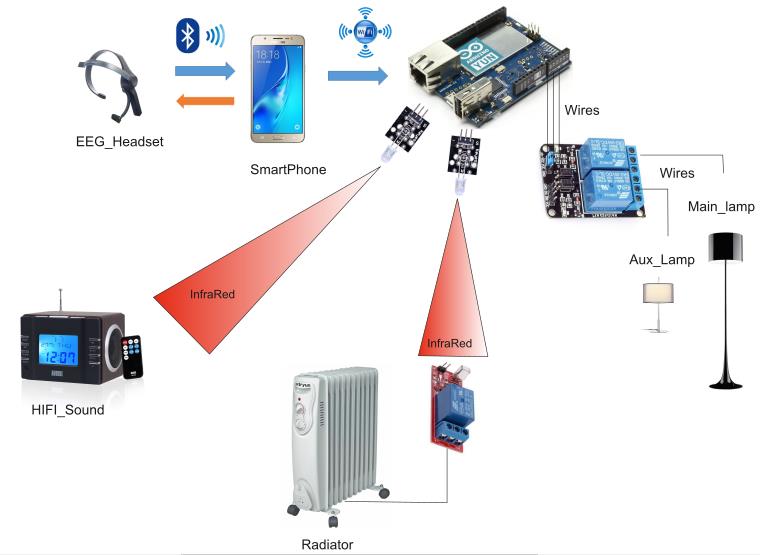

交互模式在移动应用(应用程序)上实现,该应用运行于位于家居房间固定位置的智能手机设备上。然后,该应用程序提供交互模式,捕获用户交互,处理感知到的数据以生成要发送给家庭控制器的用户命令,并最终管理可使用系统的多用户。换句话说,该智能手机可被视为系统的一个固定嵌入式组成部分,而非通常意义上的个人设备。

在语音模式下,语音识别系统会捕捉并处理用户说出的话语,以识别可能的语音命令,并将其映射到相应的用户命令。如果命令不完整,智能手机中实现的对话系统会尝试与用户开始对话,直到用户命令完成为止。

在触摸模式下,应用程序在触摸屏上提供一组按钮,用户可以选择这些按钮来执行特定的用户命令。这些按钮和相应的屏幕可以根据每个用户进行个性化设置。

家庭控制器层:它包含家庭网关,负责接收来自智能手机的用户命令,并将控制操作执行到特定的家用设备。因此,家庭网关在感知层和家用设备层之间起到桥梁作用。在本研究中,家庭网关是完全在基于Arduino平台并配备Yun扩展板以实现TCP‐IP连接 (无线网络和以太网)的资源受限的嵌入式系统上开发,用于接收来自智能手机的用户命令。另一方面,该嵌入式系统包含通用输入输出(GPIO)和红外控制器,分别用于直接控制家用设备或通过红外通信进行控制。家庭网关可使用电池供电,因此具备能量自给能力。

| Node | 设备 | Comm | Type |

|---|---|---|---|

| 节点 0 | 主灯 | 继电器 | 开/关 |

| 节点 1 | 辅助灯 | 继电器 | 开/关 |

| 节点 2 | 散热器 | irDA | 红外数据协会命令 |

| 节点3 | 高保真音响 | irDA | 红外数据协会命令 |

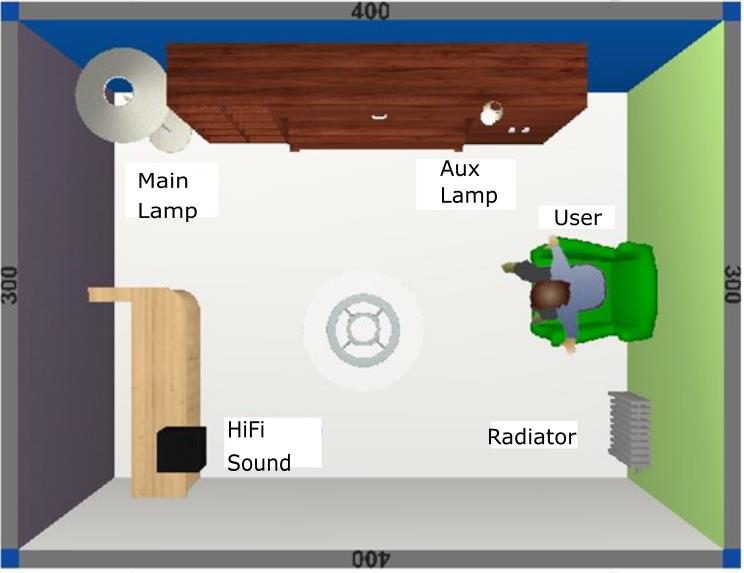

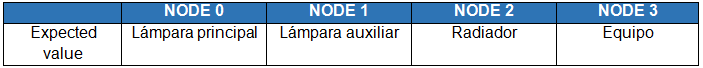

家庭设备层 :它由简单和复杂的家用设备(执行器)组成,例如散热器、灯、百叶窗和高保真设备(图4)。一些需要 220伏电源的家用设备连接到耦合继电器,而其他设备则通过红外通信进行控制。在原型开发中,选定了四种家用设备:主灯、辅助灯、散热器和高保真音响。表1显示了所选家用设备的集合、用于连接的通信协议以及要应用的命令类型。

3 操作模式的实现

3.1 脑机接口的操作

本文所描述的脑机接口控制基于眨眼时产生的视觉诱发电位(VEP)或视觉诱发电位(VER)。视觉诱发电位是大脑作为对刺激的即时反应而产生的电信号,响应于一次眨眼光照的突然变化。然后,通过VEP分析可以获知用户眨眼的次数。此外,视觉诱发电位(VEP)可用于定义一个二进制通信系统,以区分两个数值:眨眼,不眨眼。这是我们的脑机接口控制实现的基础。

Barea等人的研究[14]表明,当眨眼强度更大时,视觉诱发电位(VEP)更强烈。此外,当用户朝不同方向进行眼球运动时,会发现不同的额外的VEP电位。因此,用户的自发性眼球运动可能会在信号中引入持续的假阳性。在这种情况下,应进行数据滤波以避免这些误报。

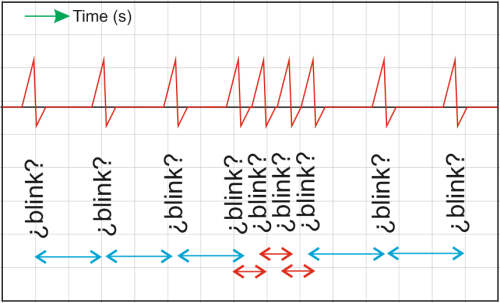

另一方面,尽管用户保持注视固定,但眨眼频率也可能发生变化,从而难以确定真正的眨眼。因此,为了稳定信号,已部署一个周期性定时器来监测在时间窗口内可能发生的单个视觉诱发电位(VEP)。时间窗口和周期可以进行调整,以便更好地适应每个用户的规律脉冲出现情况。这使得可以忽略发生过快或过慢的眨眼(图6)。

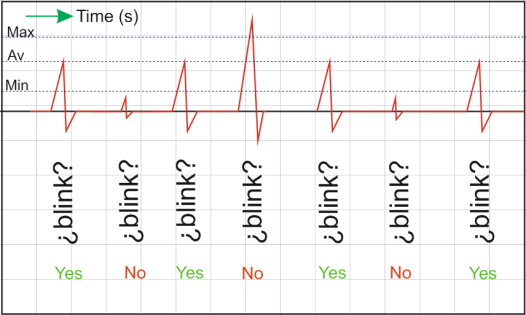

可以根据平均眨眼幅度(ABA)应用另一个滤波器,以控制眨眼的幅度。该滤波器可避免幅度超出最小值和最大值范围的眨眼。在本例中,使用 NeuroSky MindWave 系统进行眨眼检测的数值设置在 0到100 之间。每位用户在不同时间可能达到不同的 ABA。因此,为了根据系统使用情况获得可靠行为,必须针对每位用户和每次会话调整检测时间。系统使用时间越长,眨眼数值将越可靠(见图7)。

为了在系统使用中获得可接受程度的个性化,必须考虑环境因素(如光线、环境温度等)和位置因素(如传感器在用户身上的位置、注意力水平、身体状态等)。这些被视为关键的因素可能导致不一致性问题,并引发未得到妥善控制的误报情况。在脑机接口系统中,NeuroSky MindWave 系统另一个重要的设置特征是用户的注意力或专注值。该值可作为参考,用于判断用户是否达到了适当的最低注意力值,以确认其完成的眨眼是否有效。

考虑到本研究中应用的上述滤波器和限制,可以获得稳定的VEP信号。脑机接口可以通过将特定命令与眨眼发生次数进行映射(例如,两次眨眼表示打开灯),或通过结合眨眼之间的短暂停顿和长停顿来配置。然而,在第一种情况下,仅能表示有限数量的特定命令;而在第二种情况下,用户必须学习带有短/长停顿的复杂的眨眼序列。

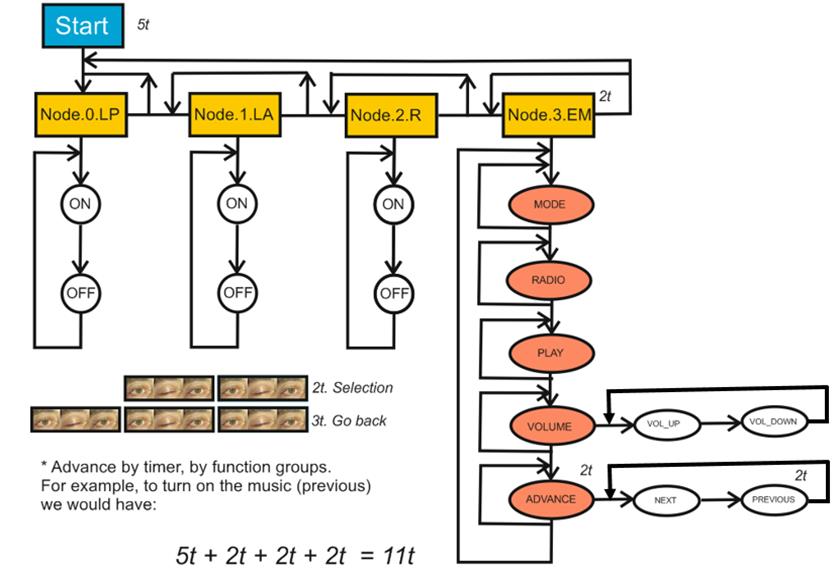

因此,本研究定义了一种语言,将眨眼的发生与语音助手的参与相结合。这种新语言更为简单,使用有限次数的眨眼来构建用户命令。每个用户命令由三个或四个元素组成:(a)开始,用于表示命令的起始;(b)设备,用于识别要选择的设备;(c)功能,用于定义操作类型;最后(d)值,用于指定具体的操作。如果某个设备只有一个功能,则无需包含该功能。图8展示了如何根据该语言的语法构建所有用户命令,从而最大限度地减少所需的眨眼次数。

在此方法中,每个“t”表示用户以恒定速率完成的一次有效眨眼。用户命令的第一个元素是起始元素,需要执行5t。为了避免连续眨眼给用户带来的疲劳和不适,眨眼检测结合了语音助手的参与。语音助手按照循环依次说出每个设备(在图8中指定为节点)的名称,每两个名称之间有短暂停顿。只有当用户执行2t时,才会选中该设备。随后,语音助手重新开始,依次说出功能(节点3)或数值(其他任意节点),各项目之间同样有停顿。用户可通过再次执行2t来选择所需的功能或数值。当数值被指定后,用户命令构建完成,该命令将被发送至家庭控制器。例如,要增加音频设备的音量,用户总共需执行11次眨眼信号单位:5t用于启动命令,2t用于进入并选择设备,2t用于选择音量功能,最后2t用于选择具体数值(如音量增大、音量减小)。

为了简化重复命令的构建,当选择一个值后,语音助手会重复上一次选择的值,以便用户有机会再次选择。因此,将生成另一个用户命令并发送至家庭控制器。在任何时候,用户都可以通过执行3次眨眼而非2次眨眼来返回。

3.2 语音输入系统

本研究中使用的语音助手系统基于谷歌技术。该系统利用基于谷歌云的自动语音识别(ASR)或语音转文本(STT),实现对语音命令的识别,并将其映射为用户命令。此外,文本转语音(TTS)将文本转换为语音输出,当无法识别用户命令或检测到的信息不完整时,帮助对话系统提示用户完成用户命令。

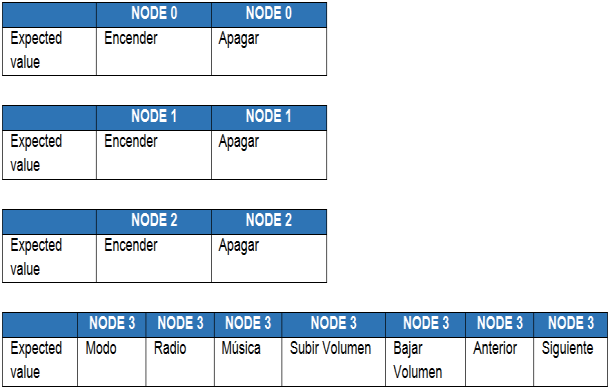

要使用语音助手实现控制,用户命令只需要由槽位分组的两个元素。首先,槽位1表示所选设备,而槽位2表示所选命令。每个槽位由不同节点分类的预期数值组成。槽位2的预期数值(节点)取决于槽位1中选择的节点。图9显示了每个槽位按节点分类的预期数值。

如果需要额外的数值,用户可以直接添加。每个新槽位将执行新的命令。在构建用户命令并添加槽位的过程中,系统会向用户询问所需的节点(期望值),并检查该期望值是否可以与命令关联。

3.3 触摸模式

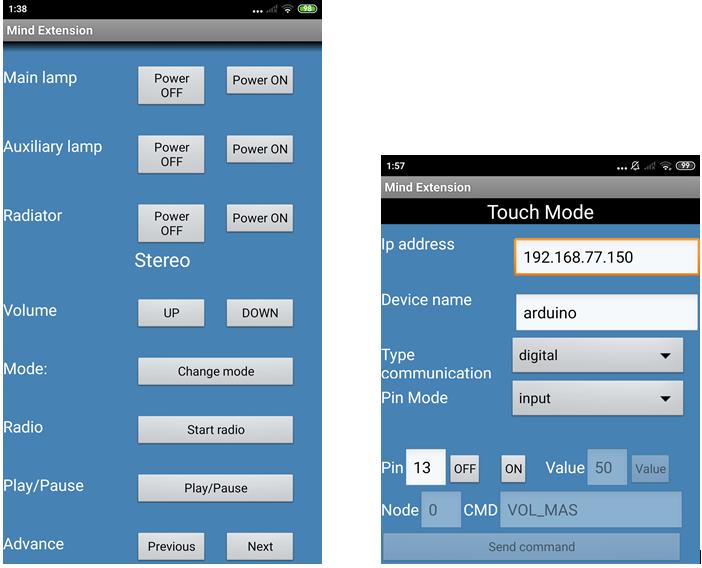

触摸模式已为安卓(多种移动设备的主要操作系统)进行了编程。它使用触摸屏作为用户与系统进行交互的媒介。事实上,用户无需使用多个遥控器(每台设备一个),而是可以在同一屏幕上直接选择并操作多个设备。通过这种方式,智能手机变成了万能遥控器,如图10所示。

在触摸模式下,用户有多种可执行操作,例如控制不同设备(如灯、散热器等)、更改配置(如Arduino IP)、设置设备名称、指示连接PIN码以及定义设备的开关状态等。综上所述,屏幕上显示特定按钮以涵盖用户对家用设备可执行的所有可能命令。鉴于此,并考虑到每位用户的个人需求可能不同,系统实现了个性化配置层,以帮助用户配置用户命令。因此,该应用程序支持针对多用户的系统配置与适配。

4 个性化和用户体验

多模态可以提供替代模态,同时不限制系统功能,从而增强辅助效果针对那些能够在特定界面上操作但对其他界面存在使用困难的人群,例如身体活动能力受限的人。

智能家居系统的开发以用户为中心。因此,满足人为因素是主要目标,尤其是要最大化每个界面上的用户体验。这从两个方面影响系统:每种交互模态的适应性,以及自由选择更合适的交互模态的权利。因此,用户可以根据自身的偏好、认知技能、身体能力、兴趣和需求,定义自己的个人档案,并确定界面设置,以自定义每种模态的工作方式。

为了支持每位用户,系统插入了多个参数以自定义操作模式以及用户类型,这些参数均可在应用程序中进行配置。这些数据存储在应用程序自身的数据库中,因为同一智能手机设备可能由不同的用户使用(未来这些数据也可以存储到云系统中)。每位用户都将拥有自己的配置。

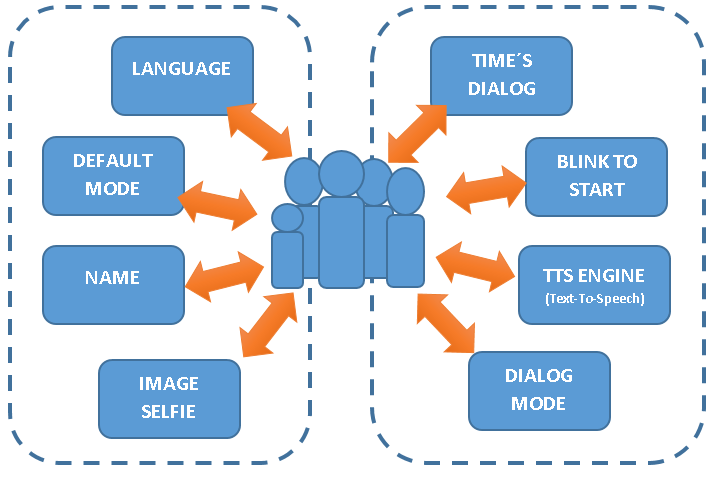

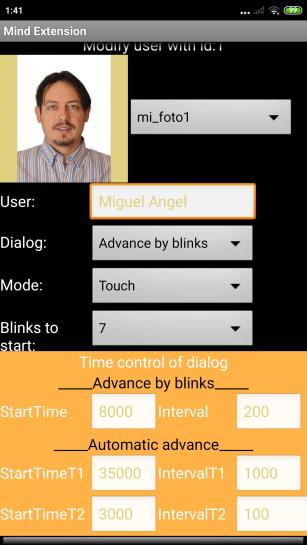

大部分定制化工作集中在脑机接口模式,因为根据配置的不同,系统可能会带来更好或更差的用户体验。图11总结了对应用程序进行的主要定制化,涉及用户数据(左)和交互模式配置(右)。用户数据包括与用户相关的全局定制化,例如姓名、照片、语言和默认操作模式。相比之下,交互模式的配置则包含影响系统性能的参数,例如在脑机接口模式中用于开始操作的眨眼次数,或语音模式所使用的文本转语音引擎。

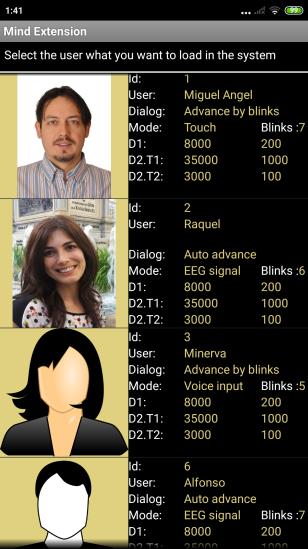

截至目前,该应用程序的配置只能通过触摸模式进行设置。默认情况下,用户可以加载预定义配置文件,之后可以修改任何参数。图12显示了两位不同用户(Miguel和 Raquel)在眨眼次数以启动、对话类型或操作模式等方面的数值不同的配置截图。当选择一个用户时,应用程序会显示交互模式的默认配置,并提供修改所有参数的选项。

5 用户命令

用户命令的处理、识别和选择对于由智能家居控制的家用设备的正确运行至关重要。无论采用何种交互模态,我们都可以以相同的方式构建每个用户命令,以便简化向家庭控制器的传输以及在家用设备中执行操作。用户命令基于前述部分所述的语言。

用户命令管理的最佳调整受到Pomboza和Holgado提出的手势控制树(GCT)概念的影响[10], ,获得了一个类似于图13所示的控制GCT。用户命令的元素——开始、设备、功能和值——通过树形描述进行存储。

为了保持相同的树结构,用户命令可以转换为URI,以将用户命令发送至家庭控制器。该URI由一个URN构成,该URN在其内部包含路径包括表示设备的节点、表示功能的节点,最后是数值。

6 个结果

实验室的用户对该系统进行了初步测试,以确定为本研究开发的原型的整体行为(图15)。仅针对最后一类用户进行了孤立的测试。然而,仍需对不同类型的用户进行深入评估,包括具有不同类型身体活动能力受限的人群。

根据初步测试,多模态交互系统的原型运行正常且可靠。在测试过程中,所有交互模式均在同一会话期间进行了测试。在不同交互模式(眨眼、语音和触摸)之间切换所需时间较短,且不受所选模式的影响。系统的学习过程以及通过不同交互模式定义用户命令的过程相对较快,随着使用时间的增加,操作错误减少(与典型的红外遥控器使用情况非常相似)。

| Mode | 用户´的配置文件 |

|---|---|

| 眨眼 | 身体活动能力受限的人或人们 残疾 安静的人或无法使用声音的人 其他 |

| 语音 |

身体活动能力受限或 残疾人。

难以使用智能手机的人。 其他 |

| 触摸 |

通常使用智能手机且希望操作简便的人 将多个设备统一为一个的方法。

其他 |

根据所选模式,具有不同需求、兴趣、认知技能、身体能力或偏好的人们可以在相对较短的时间内适应系统。根据我们的初步测试,表2中列出了智能家居最常见用途的分类。

在脑机接口模式下,系统最初性能较差,但在适当调整时间窗口后,系统实现了更高效的行为。最初的限制在于对用户命令起始元素的眨眼识别检测。默认情况下,设置了5秒的时间窗口,用于检测至少5次眨眼(图16)。这一限制有助于避免无意的眨眼。然而,每个用户都可以调整此配置值以及其他参数。

在脑机接口模式下,语音助手参与构建用户命令可能会显著影响执行相应命令所需的时间,因为它将眨眼选择(输入)与语音助手的听写(输出)结合在一起。原因在于,在根据图8构建用户命令的过程中,语音助手持续处于激活状态:(a)在用户通过两次眨眼选择某个元素之前,循环听写可能的备选元素;(b)听写用户进行两次眨眼后选择相应元素。表3显示了构建家用设备用户命令所需的最佳命令执行时间(从交互开始到执行为止),这些设备见表1。

| 用户命令 | 最佳时间(秒) |

|---|---|

| 启动,LP,开 | 17,17 |

| 启动.LP.关 | 21,37 |

| 启动.LA.开 | 22,48 |

| 启动.LA.关 | 24,55 |

| 启动.R.开启 | 24,12 |

| 启动.R.关闭 | 27,59 |

| 启动.EM.模式 | 30,58 |

| 启动.EM.收音机 | 34,13 |

| 启动.EM.播放_暂停 | 39,48 |

| 启动.EM.音量.调高 | 50,51 |

| START.EM.VOLUME.VOL_DOWN | 57,42 |

| START.EM.ADVANCE.NEXT | 55,10 |

| START.EM.ADVANCE.PREVIOUS | 58,54 |

用户交互过程中出现的错误眨眼也可能影响命令执行时间。在某些情况下,通过应用第3节中讨论的滤波器,可以减少误报(不希望发生的眨眼)的数量。在此情况下,GCT的实现、检测以及所需眨眼次数均已优化至最高效的状态(默认配置)。当用户注意力不集中或感到疲劳时,也可能出现错误。经验表明,随着用户与系统的交互增加,误报 tends to 减少,从而改善自动对话选项,并实现更短的命令执行时间。

7 结论与未来工作

本文展示了如何将通过EEG电极采集的生物信号与触摸屏或语音助手等其他交互模式相结合,以控制由一组家用设备组成的智能家居系统。因此,开发并测试了一种包含三种交互模式(眨眼、语音助手和触摸屏)的多模态交互系统,并在多用户环境下进行了验证。该系统尤其适用于身体活动能力受限的人群。

眨眼已被用作一种新的交互形式,并被证明是有效的。但一些与新界面相关的参数,如眨眼频率、平均眨眼幅度或时间窗口,应根据每位用户的舒适度进行调整。所实现的控制结构基于Pomboza & Holgado [10],提出的模型,该模型可适应控制系统的不同交互类型。然而,控制树仍可进一步改进和定制。

从该原型的实施和所进行的初步测试中吸取的经验教训出发,我们希望采用新的、更优的方法来改进原型,以过滤和消除脑机接口模式中的误报问题,以及推进与其他交互模式(语音和触摸)的集成,特别是针对具有不同类型身体活动能力受限的人群。未来的工作将针对这类用户对系统进行深入评估。

283

283

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?