1.1 统计学习

步骤

1. 得到一个有限的训练数据集合

2. 确定模型的假设空间,也就是所有的备选模型

3. 确定模型选择的准则,即学习的策略

4. 实现求解最优模型的算法

5. 通过学习方法选择最优模型

6. 利用学习的最优模型对新数据进行预测或分析

1.2 监督学习

监督学习分为学习和预测两个过程,由学习系统与预测系统完成。在学习过程中,学习系统利用给定的训练数据集,通过学习得到一个模型,表示为条件概率分布或者决策函数。

决策函数就是学习完成后得出的一个确定的模型,给定一个x,它输出一个y,这个y就是学习后的预测结果,可能和实际有偏差;而条件概率分布是得到多个概率值下的不同结果,这些结果每个代表不同的预测,加起来总概率为1,一般取概率最大值为预测结果(图像识别中的先验框中的数字就是概率最大的预测结果)。

1.3 统计学习三要素

三要素分别为:模型、策略和算法

模型

模型的假设空间包含所有可能的条件概率分布或决策函数。

策略

损失函数

损失函数有四种:0-1损失函数、平方损失函数、绝对损失函数和对数损失函数

经验风险最小化

结构风险最小化

1.4 模型评估与模型选择

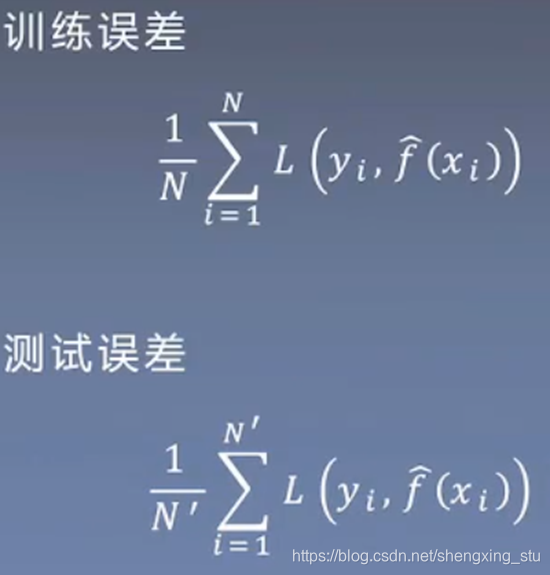

训练误差与测试误差

训练误差是模型关于训练数据集的平均损失

测试误差是模型关于测试数据集的平均损失

过拟合与模型选择

如果一味追求提高对训练数据的预测能力,所选模型的复杂度往往会比真模型更高,这种现象称为过拟合。过拟合是指学习时选择的模型所包含的参数过多,以至于出现这一模型对已知数据预测得很好,但对位置的数据预测得很差得想想,可以说模型选择目的是避免过拟合并提高模型的预测能力。

1.5 正则化与交叉验证

正则化时结构风险最小化策略的实现,是在经验风险上加一个正则化项或罚项。正则化一般是模型复杂度的单调递增函数,模型越复杂,正则化值就越大。

交叉验证

随机将数据集切分为三部分,分别为训练集、验证集和测试集。训练集用来训练模型,验证机用于模型的选择,而测试集用于最终对学习方法的评估,选择对验证集有最小预测误差的模型。

交叉验证包括简单交叉验证、S折交叉验证和留意交叉验证。

1.6 泛化能力

学习的泛化能力是指由该方法学习到的模型对未知数据的预测能力,是学习方法本质上重要的性质。

定理1.1 泛化误差上界

1.7 生成模型与判别模型

1.8 分类问题

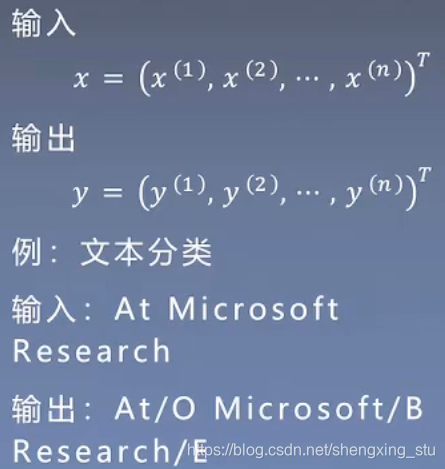

1.9 标注问题

本文深入探讨了统计学习的过程,包括从训练数据中学习模型,使用监督学习的决策函数或条件概率分布,以及模型评估与选择。重点介绍了模型的三要素——模型、策略(如损失函数和风险最小化)和算法。正则化作为防止过拟合的手段,以及交叉验证在选择最佳模型中的作用。此外,还讨论了泛化能力,即模型对未知数据的预测能力,以及生成模型与判别模型的区别。最后,提到了分类问题和标注问题在机器学习中的重要性。

本文深入探讨了统计学习的过程,包括从训练数据中学习模型,使用监督学习的决策函数或条件概率分布,以及模型评估与选择。重点介绍了模型的三要素——模型、策略(如损失函数和风险最小化)和算法。正则化作为防止过拟合的手段,以及交叉验证在选择最佳模型中的作用。此外,还讨论了泛化能力,即模型对未知数据的预测能力,以及生成模型与判别模型的区别。最后,提到了分类问题和标注问题在机器学习中的重要性。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?