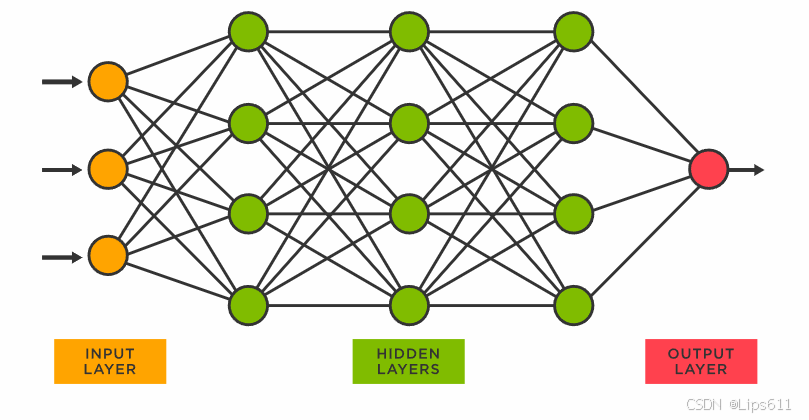

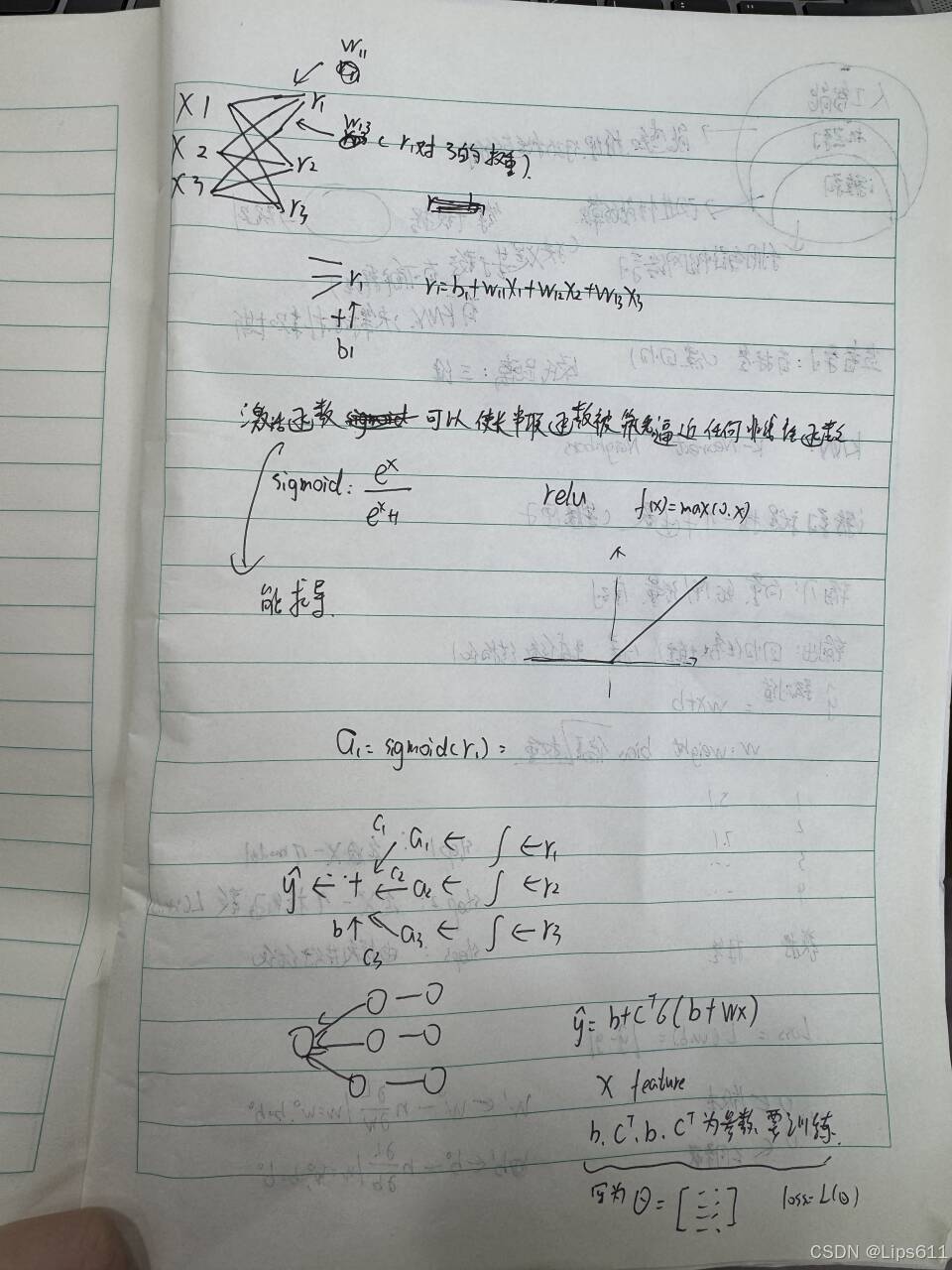

神经网络图像例如:

由输入层、隐藏层、输出层组成,常常说神经网络层数是指隐藏层和输出层的和。

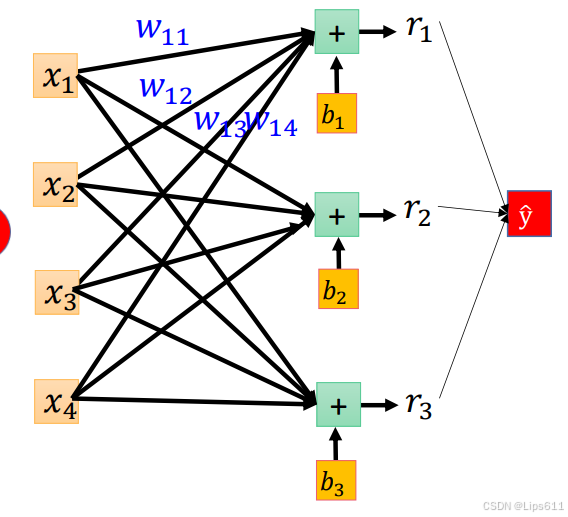

X序列是输入,得到每一个隐藏层的r序列数字都是r=b+,得到y帽为预测值。

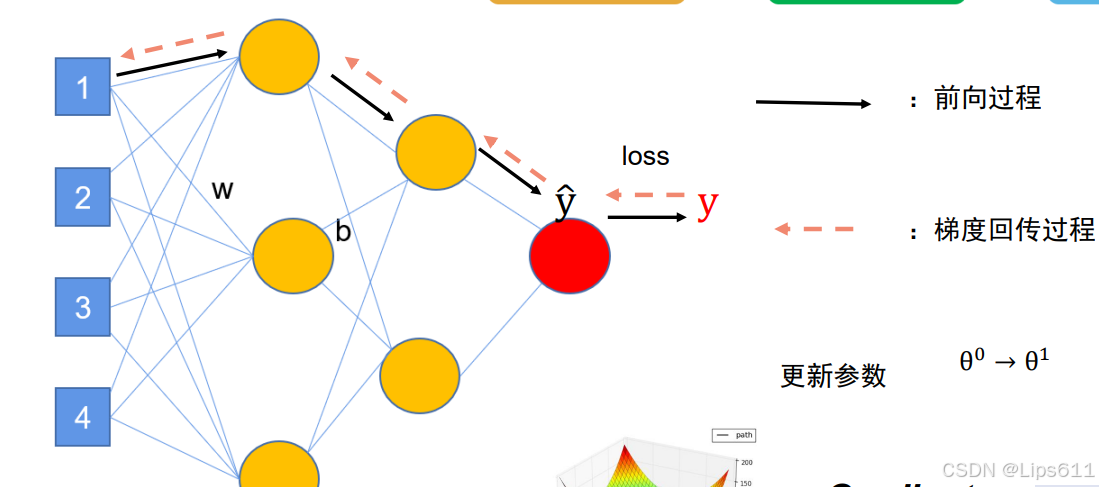

y为目标结果,这里通常要引入一个叫做损失函数loss的定义,为L(w,b)=|y-y帽|。

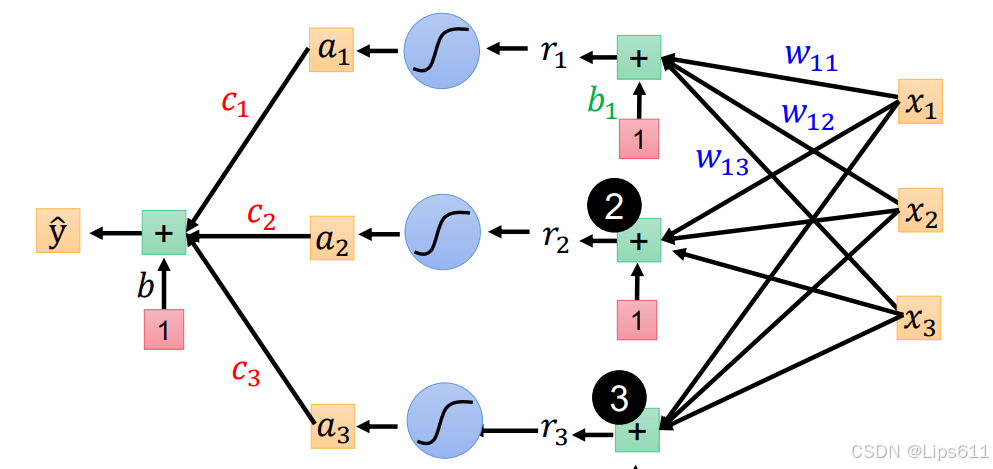

激活函数:引入激活函数之后,由于激活函数都是非线性的,这样就给神经元引入了非线性元素,使得神经网络可以逼近任何非线性函数,这样使得神经网络应用到更多非线性模型中,常见的激活函数有sigmoid和relu,激活函数通常是可以求导的,这也为反向传播起到作用

激活函数的位置往往位于已经计算好的r序列之后,用于调整线性的结果,更好拟合测试集。可以这样理解激活函数的作用:人体内手指的神经元到大脑的神经元不是一根连接而成,而是很多根依次传递电信号,但倘若没有激活函数在其中进行调整,这些串联在一起的神经元得到的结果跟一根直接传递没有实质区别,起不到非线性的函数图像结果。

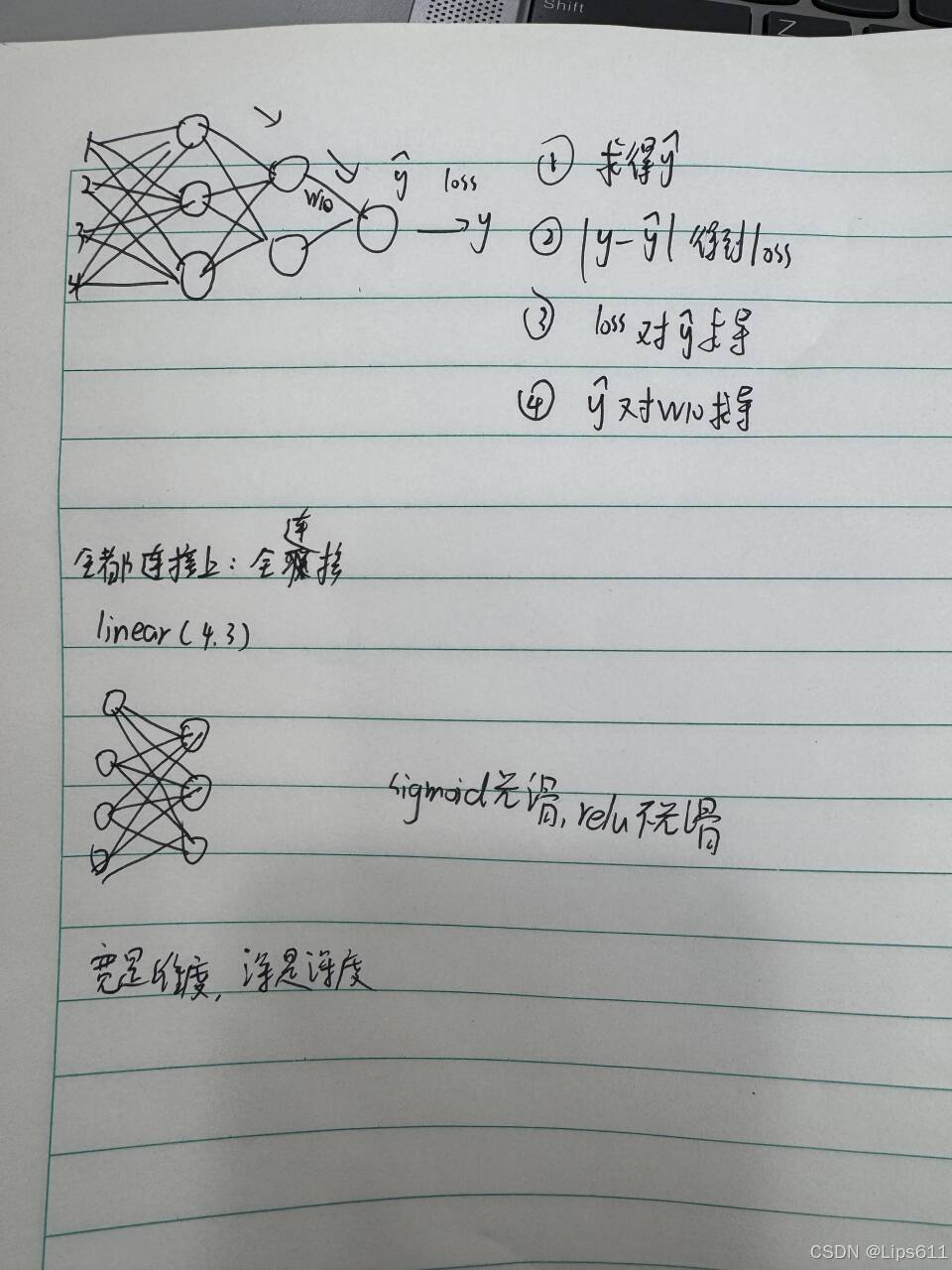

继续就上图说道,神经网络的学习需要训练的内容有a(学习率)序列、b(偏差)序列、w(权重)序列等,不断地进行训练调整,生成好模型。

图中为深度学习的训练过程,梯度回传的过程就是不断地链式求导过程,进而优化模型,一列黄色球数量是维度,黄红球的总共的列数是神经网络的深度,在一定范围内通常来说深度越大,精度越好。

今日笔记:

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?