书生·浦语实战营第二课趣味demo

目录

部署InternLM2-Chat-1.8B模型

创建开发机

创建了一个10%A100的虚拟环境

安装虚拟环境

studio-conda -o internlm-base -t demo

# 与 studio-conda 等效的配置方案

# conda create -n demo python==3.10 -y

# conda activate demo

# conda install pytorch==2.0.1 torchvision==0.15.2 torchaudio==2.0.2 pytorch-cuda=11.7 -c pytorch -c nvidia

# 进入虚拟环境

conda activate demo

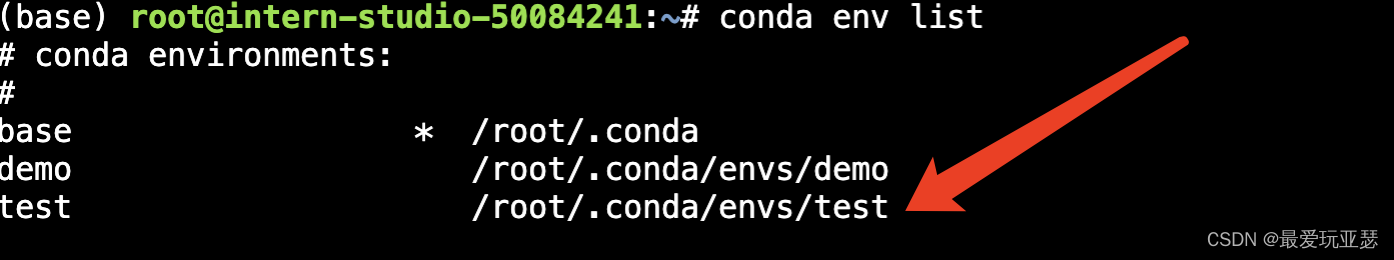

创建的虚拟环境

安装软件包

pip install huggingface-hub==0.17.3

pip install transformers==4.34

pip install psutil==5.9.8

pip install accelerate==0.24.1

pip install streamlit==1.32.2

pip install matplotlib==3.8.3

pip install modelscope==1.9.5

pip install sentencepiece==0.1.99

创建目录和文件

mkdir -p /root/demo

touch /root/demo/cli_demo.py

touch /root/demo/download_mini.py

cd /root/demo

其中,-p参数的解释:

例如,如果你运行命令 mkdir -p path/to/directory,如果 path/to 目录不存在,-p选项会让 mkdir 命令创建 path/to 目录及其所有父级目录,最终创建 directory 目录。

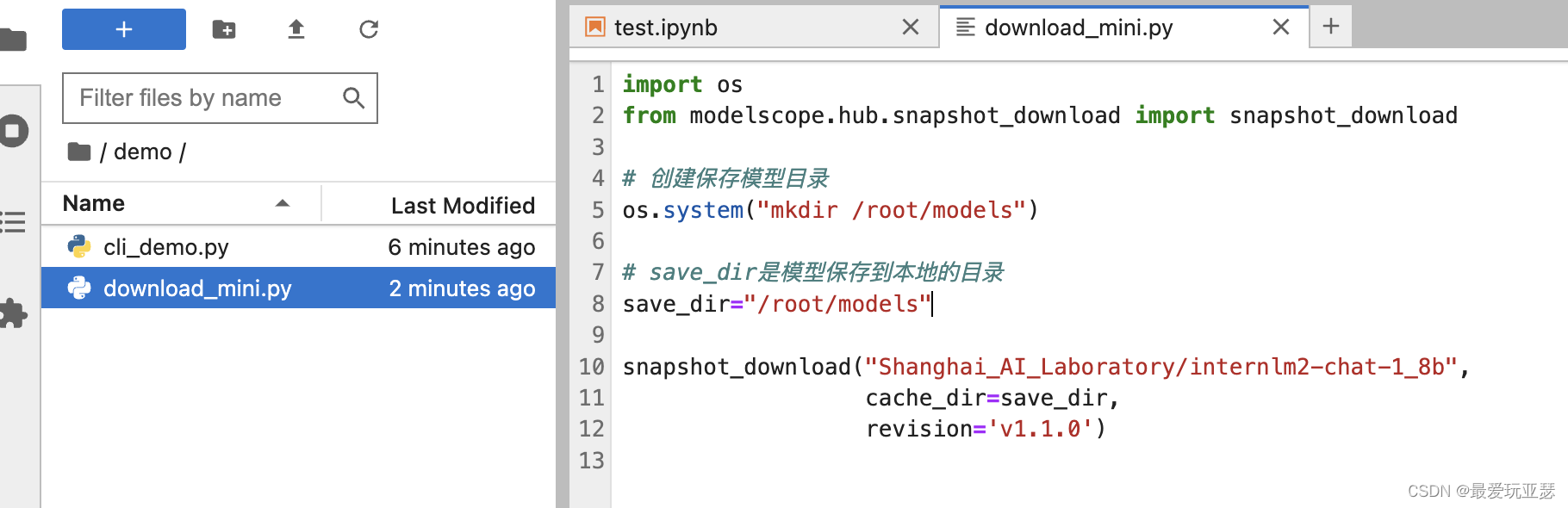

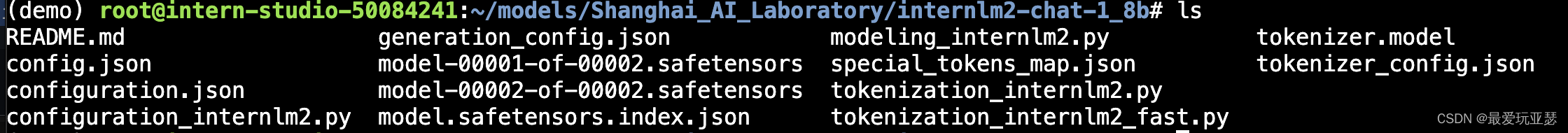

下载模型

modelscope是魔塔社区的开源库,通过它在线下载模型到/root/models目录

modelscope是魔塔社区的开源库,通过它在线下载模型到/root/models目录

如下

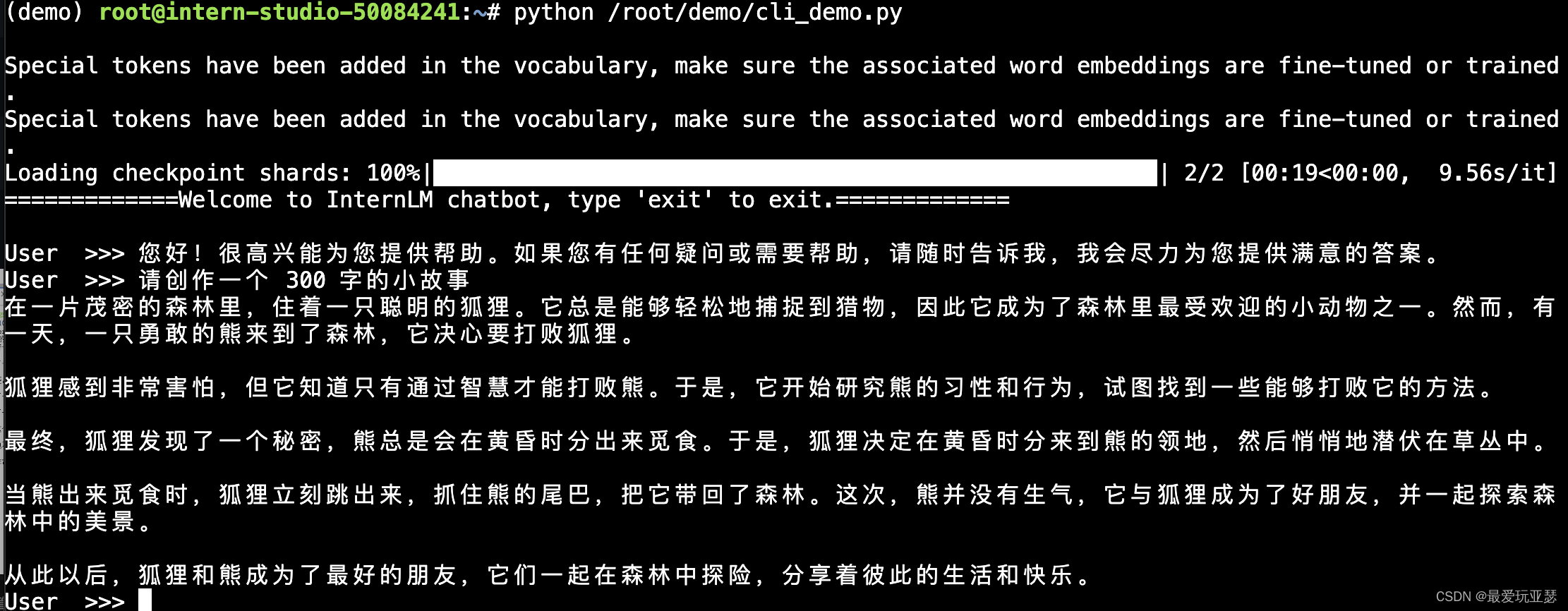

部署模型(基础作业)

import torch

from transformers import AutoTokenizer, AutoModelForCausalLM

model_name_or_path = "/root/models/Shanghai_AI_Laboratory/internlm2-chat-1_8b"

tokenizer = AutoTokenizer.from_pretrained(model_name_or_path, trust_remote_code=True, device_map='cuda:0')

model = AutoModelForCausalLM.from_pretrained(model_name_or_path, trust_remote_code=True, torch_dtype=torch.bfloat16, device_map='cuda:0')

model = model.eval()

system_prompt = """You are an AI assistant whose name is InternLM (书生·浦语).

- InternLM (书生·浦语) is a conversational language model that is developed by Shanghai AI Laboratory (上海人工智能实验室). It is designed to be helpful, honest, and harmless.

- InternLM (书生·浦语) can understand and communicate fluently in the language chosen by the user such as English and 中文.

"""

messages = [(system_prompt, '')]

print("=============Welcome to InternLM chatbot, type 'exit' to exit.=============")

while True:

input_text = input("\nUser >>> ")

input_text = input_text.replace(' ', '')

if input_text == "exit":

break

length = 0

for response, _ in model.stream_chat(tokenizer, input_text, messages):

if response is not None:

print(response[length:], flush=True, end="")

length = len(response)

transformers 库是一个自然语言处理的开源库,用它加载预训练模型。

cuda 是在 gpu上加载模型,个人理解它就相当于一个使用gpu计算能力的工具库。

system_prompt是提示词。

还可以看到模型并不是一次生成输出,而是流式输出。

部署成功

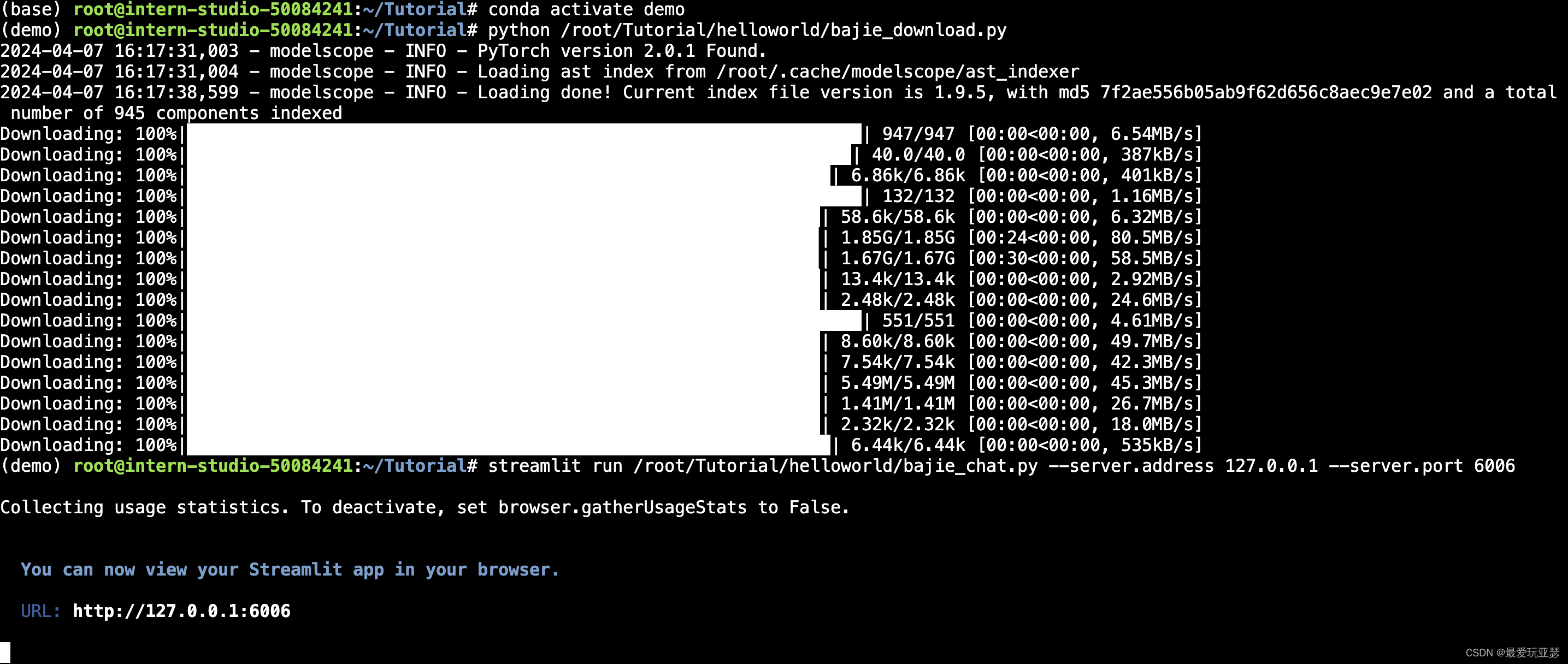

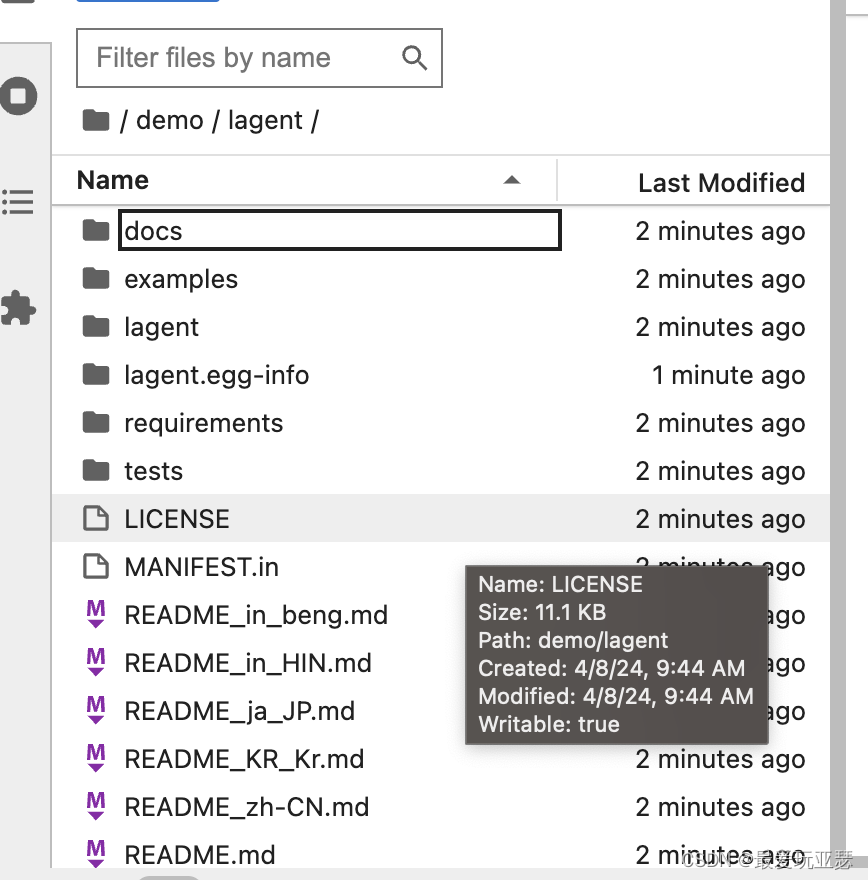

部署八戒-Chat-1.8B

下载模型

cd /root/

git clone https://gitee.com/InternLM/Tutorial -b camp2

# git clone https://github.com/InternLM/Tutorial -b camp2

cd /root/Tutorial

运行

python /root/Tutorial/helloworld/bajie_download.py

streamlit run /root/Tutorial/helloworld/bajie_chat.py --server.address 127.0.0.1 --server.port 6006

操作图例

本地访问操作

这个demo比着教程操作了一下,但是对于原理还不了解,希望在以后课程中学习如何制作这个demo。

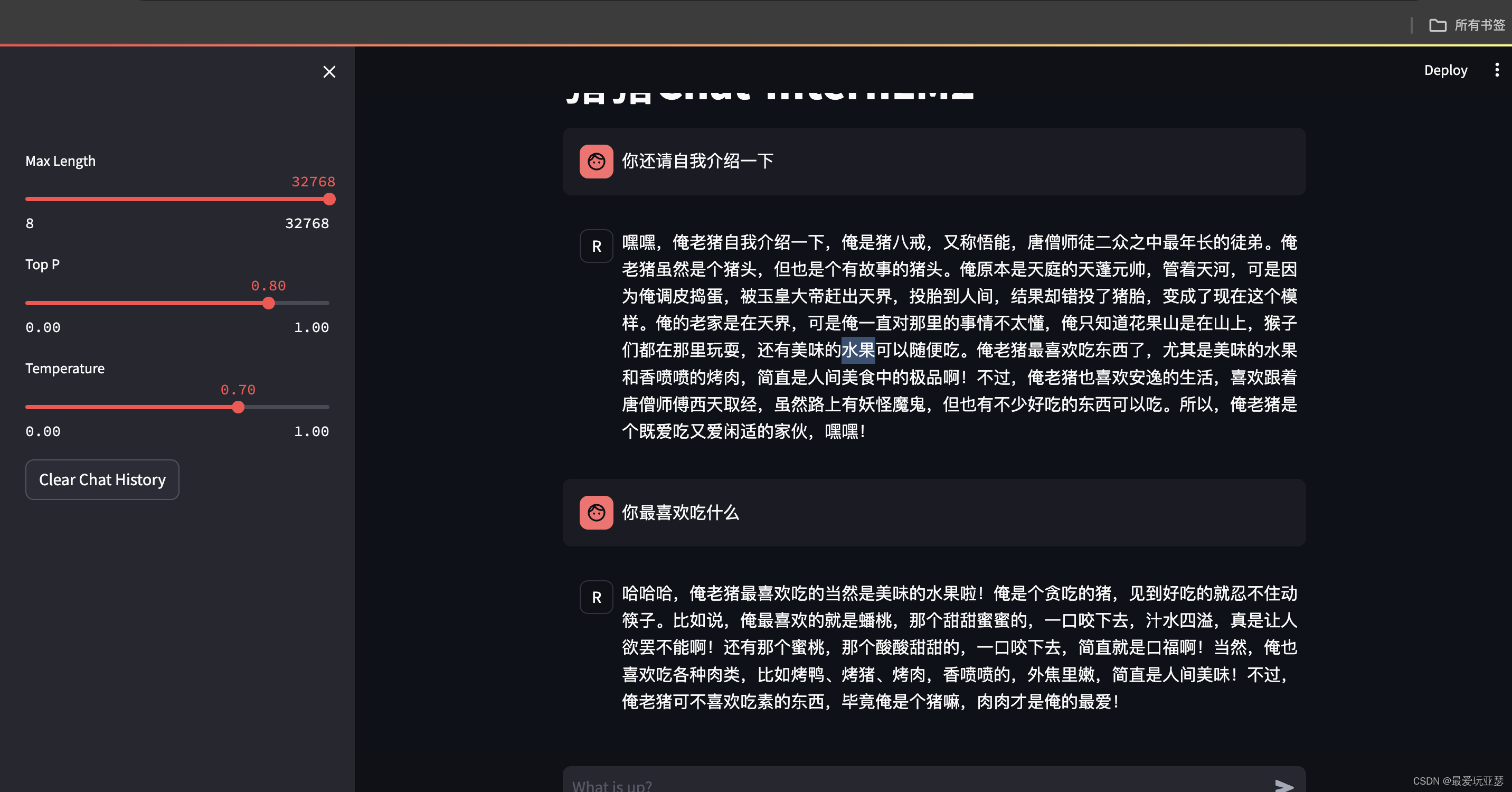

使用Lagent运行InternLM2-Chat-7B

Lagent的框架图

Langent有三个主要部分:

action可以看到框架图指代的PythonExecutor、Search等工具,可以解决的问题是大模型无法胜任的工作。比如ChatGpt无法查询最近的信息,可以使用Search Action作为扩展查询最新消息。

agent:感觉是解析大模型的输出,决定选择工具集中某个工具来完成任务。

llm:作为大脑,决定使用哪个agent。

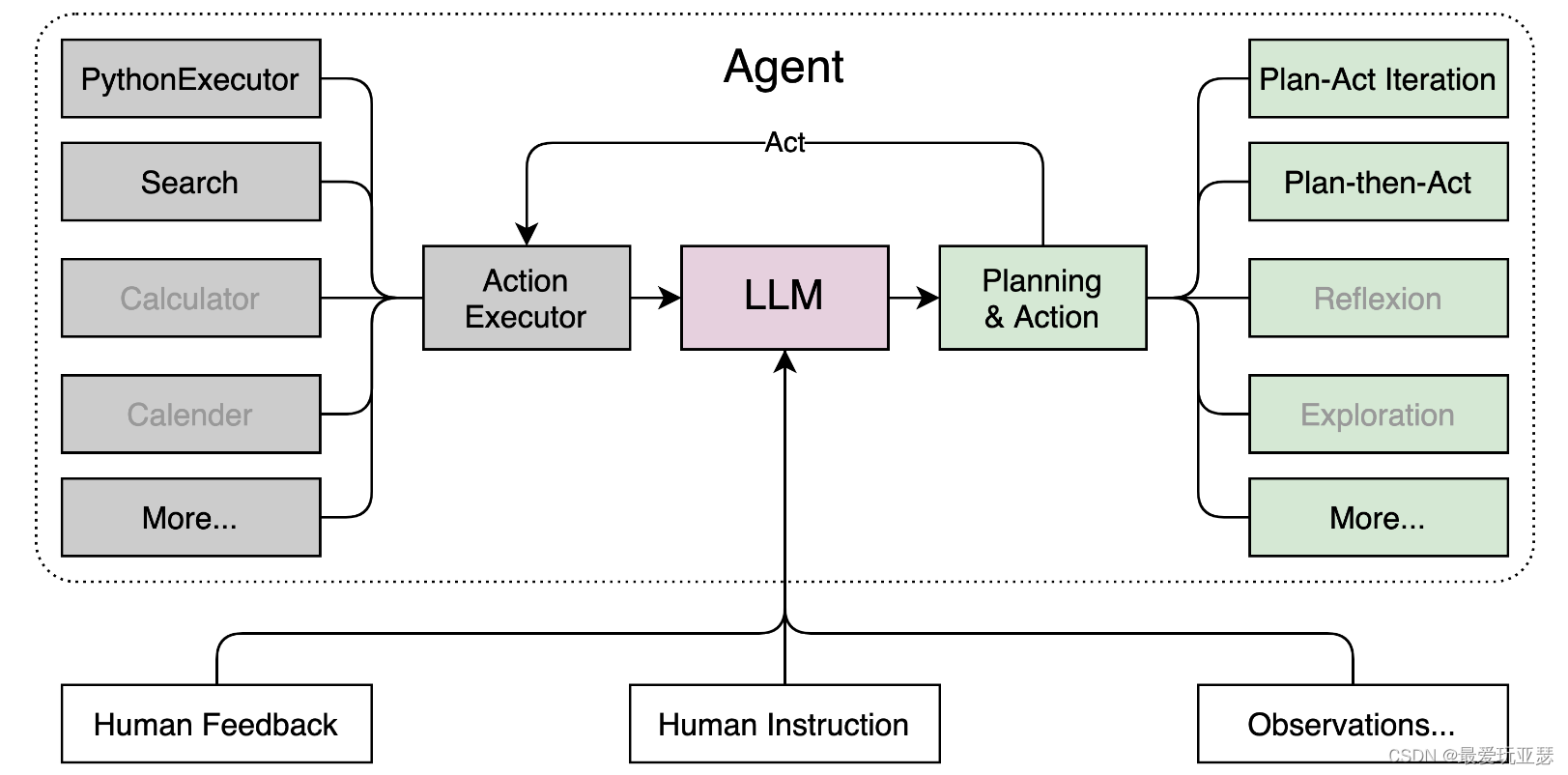

克隆lagent

git clone https://gitee.com/internlm/lagent.git

# git clone https://github.com/internlm/lagent.git

cd /root/demo/lagent

git checkout 581d9fb8987a5d9b72bb9ebd37a95efd47d479ac

pip install -e . # 源码安装

查看了https://gitee.com/internlm/lagent的readme,了解下lagent。

克隆后的文件夹

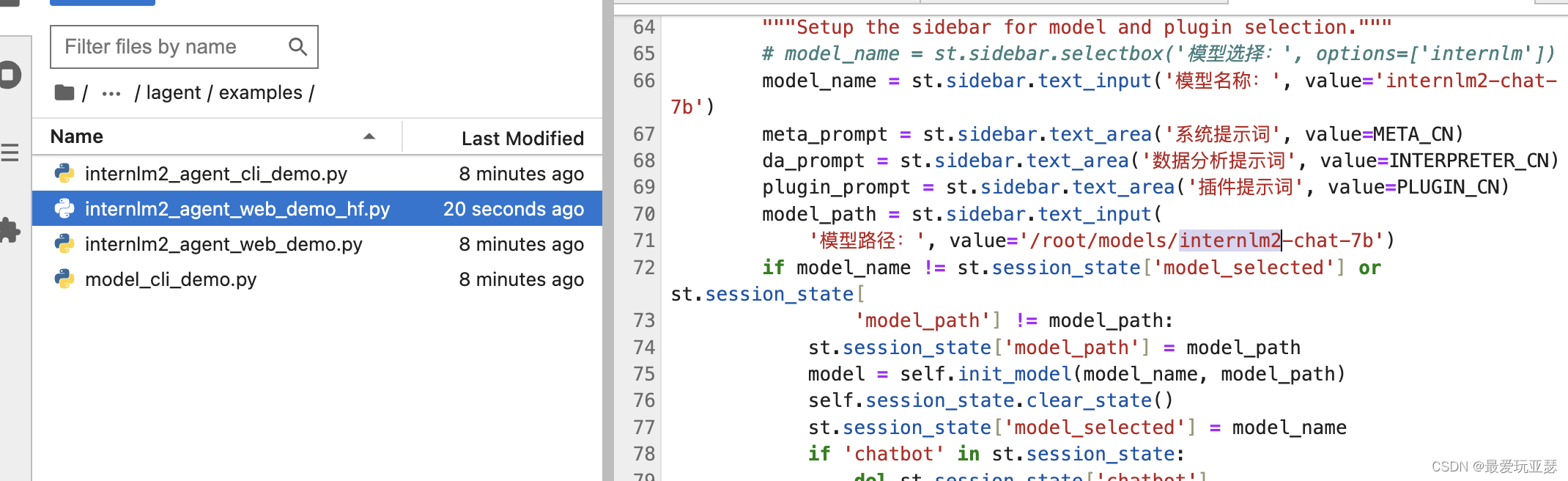

修模型路径并运行

streamlit run /root/demo/lagent/examples/internlm2_agent_web_demo_hf.py --server.address 127.0.0.1 --server.port 6006

使用streamlit显示界面,大致浏览下internlm2_agent_web_demo_hf文件,采用了lagent框架开发了web后台。

st.session_state['model_map'][model_name] = HFTransformer(

path=path,

meta_template=META,

max_new_tokens=1024,

top_p=0.8,

top_k=None,

temperature=0.1,

repetition_penalty=1.0,

stop_words=['<|im_end|>'])

这段代码应该初始化了模型,HFTransformer中加载模型是通过transformers开源库,如下

def _load_model(self, path: str, model_kwargs: dict):

import torch

from transformers import AutoModel

model_kwargs.setdefault('torch_dtype', torch.float16)

self.model = AutoModel.from_pretrained(

path, trust_remote_code=True, **model_kwargs)

self.model.eval()

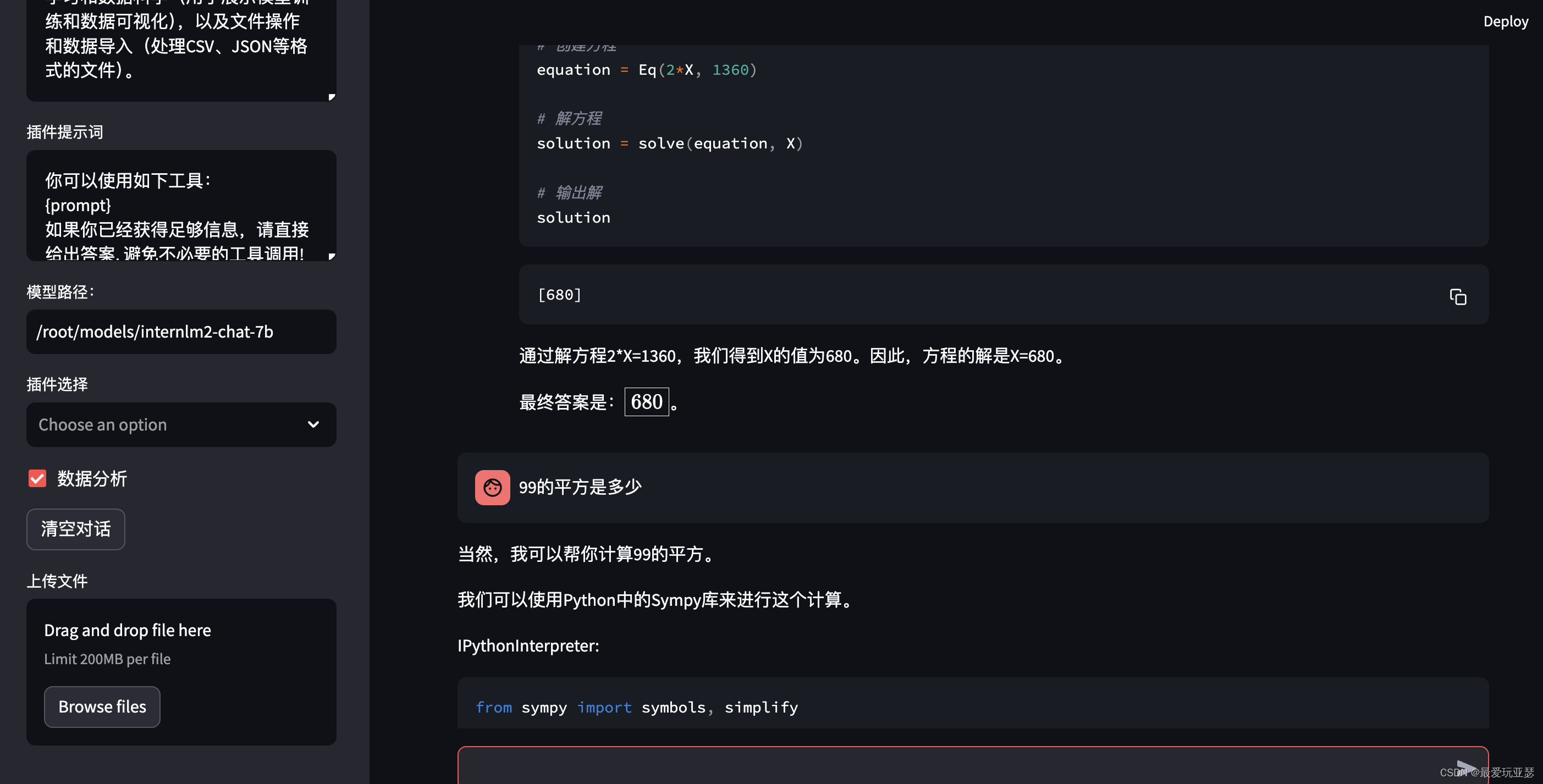

使用部署成功的模型执行数学计算(进阶作业3)

模型进行数学运算,先转化成python代码再执行它从而得到答案。llm应该不会直接调用python,而是通过agent调用python解释器。

观察到模型运行时,占用显存60%,但是后台服务停止后,显存内存没有降低。又过了大约几分钟,显存反而升到90%,不得其解。

这次部署完成,对于使用lagent框架还未了解。

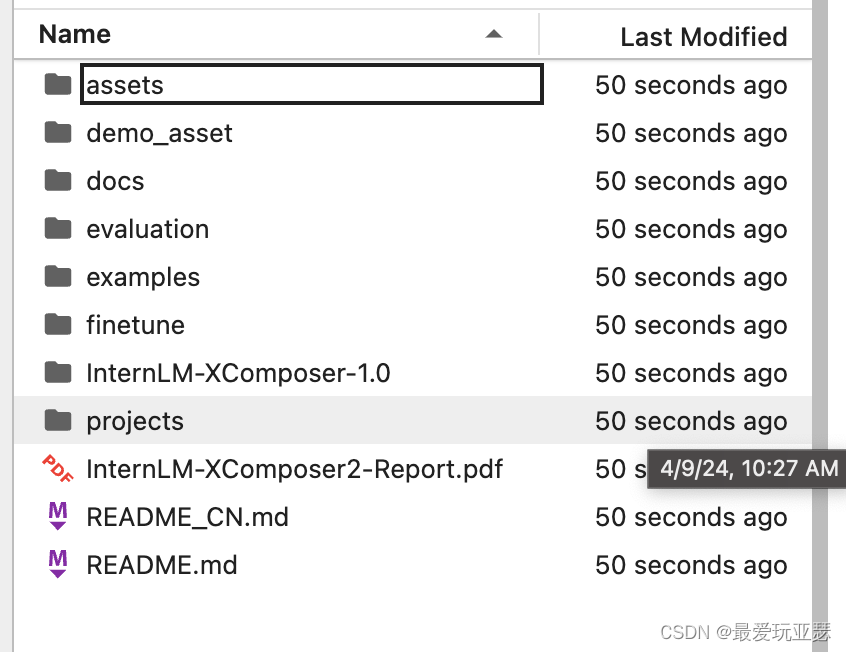

部署浦语·灵笔2模型(进阶作业2)

安装库和克隆组件

conda activate demo

# 补充环境包

pip install timm==0.4.12 sentencepiece==0.1.99 markdown2==2.4.10 xlsxwriter==3.1.2 gradio==4.13.0 modelscope==1.9.5

cd /root/demo

git clone https://gitee.com/internlm/InternLM-XComposer.git

# git clone https://github.com/internlm/InternLM-XComposer.git

cd /root/demo/InternLM-XComposer

git checkout f31220eddca2cf6246ee2ddf8e375a40457ff626

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-7b /root/models/internlm-xcomposer2-7b

ln -s /root/share/new_models/Shanghai_AI_Laboratory/internlm-xcomposer2-vl-7b /root/models/internlm-xcomposer2-vl-7b

在这里插入图片描述

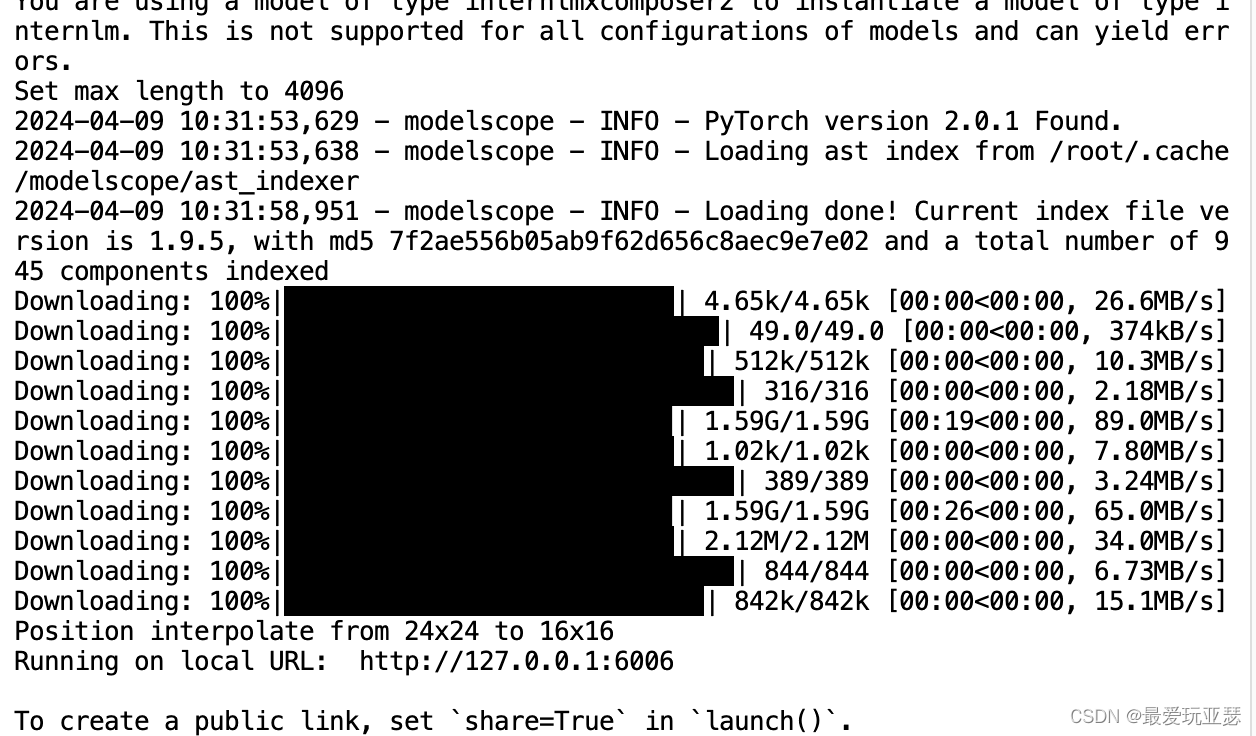

启动

python /root/demo/InternLM-XComposer/examples/gradio_demo_composition.py \

--code_path /root/models/internlm-xcomposer2-7b \

--private \

--num_gpus 1 \

--port 6006

最后的效果

图文写作

图片理解

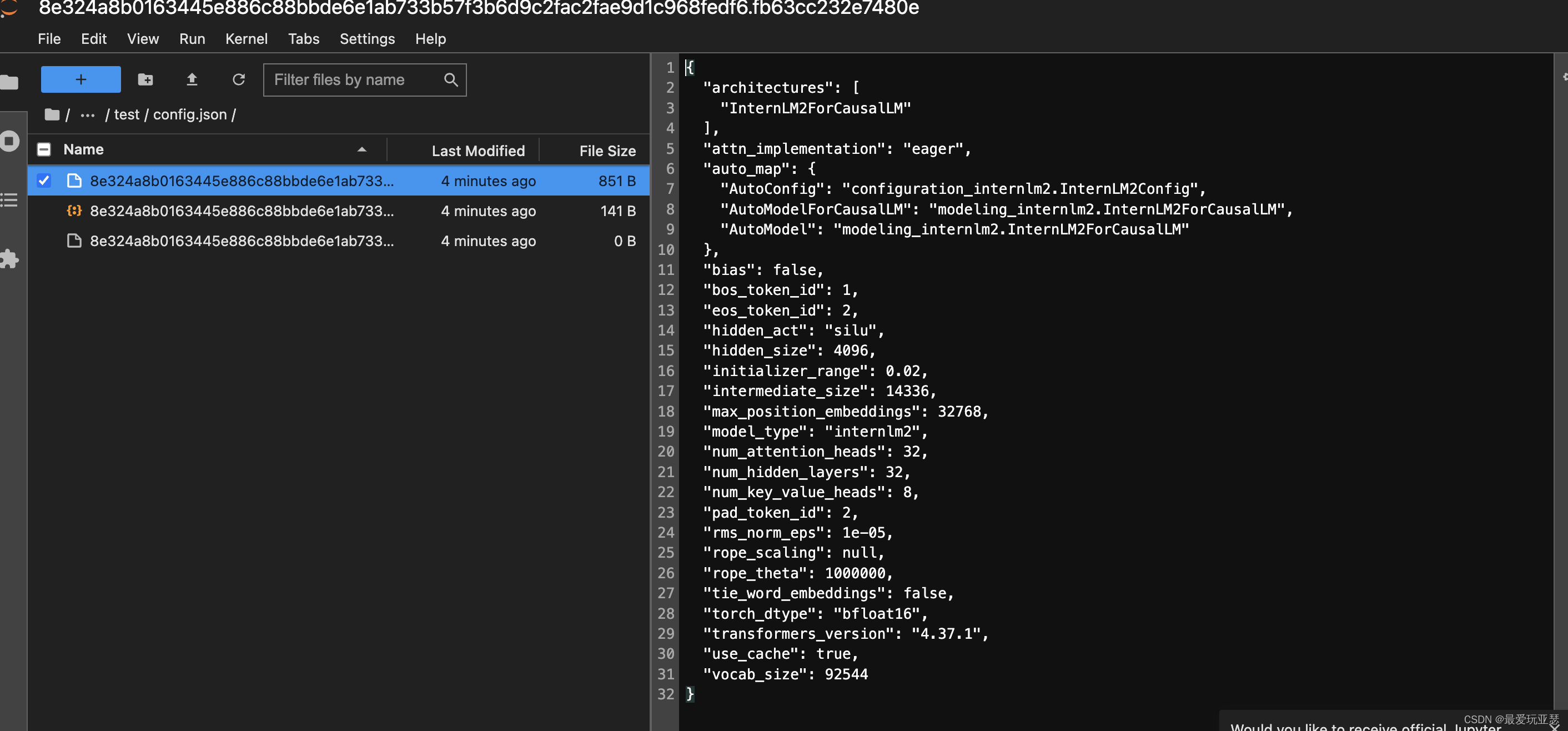

进阶作业1-huggingface_hub下载文件

pip install huggingface_hub

from huggingface_hub import hf_hub_url, cached_download

# 模型名称

model_name = "internlm/internlm2-chat-7b"

# 获取 config.json 的 URL

config_url = hf_hub_url(model_name, filename="config.json", revision="main")

print(config_url)

# 指定本地保存路径

local_path = "./config.json"

# 下载文件

cached_download(config_url, cache_dir=local_path)

不知道为何下载下来一个包括这个文件的文件夹

本文详细介绍了在开发机上部署InternLM2-Chat-1.8B、八戒-Chat-1.8B和浦语·灵笔2模型的过程,包括创建虚拟环境、安装相关库、下载模型、使用Lagent和HuggingFaceHub等技术。作者还展示了如何使用这些模型进行数学计算和图文创作功能。

本文详细介绍了在开发机上部署InternLM2-Chat-1.8B、八戒-Chat-1.8B和浦语·灵笔2模型的过程,包括创建虚拟环境、安装相关库、下载模型、使用Lagent和HuggingFaceHub等技术。作者还展示了如何使用这些模型进行数学计算和图文创作功能。

461

461