ICML22 arixv目前:Structural and Semantic Contrastive Learning for Self-supervised Node Representation

最新推荐文章于 2025-12-08 20:30:54 发布

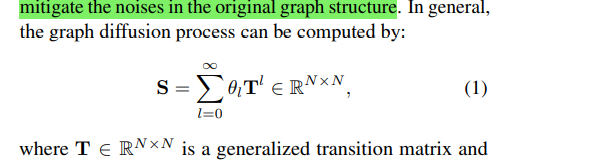

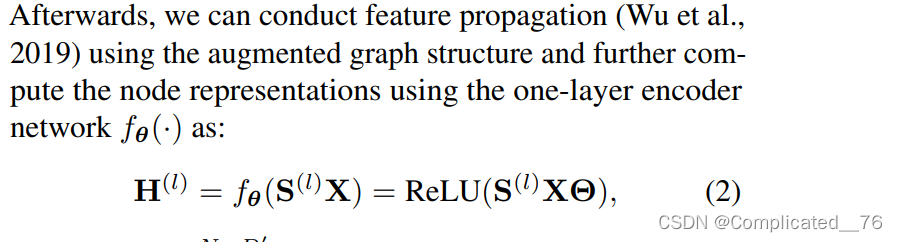

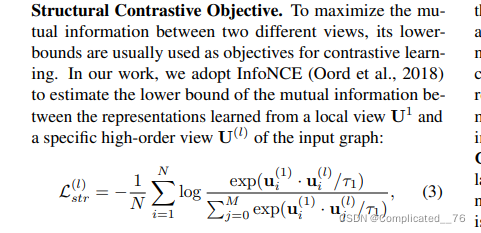

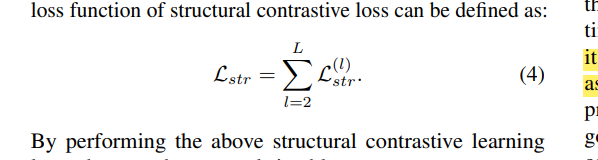

本文结合对比学习、标签传播和原型网络,提出了一种自监督节点表示的方法。通过图扩散进行结构化对比学习,利用多跳获取全局结构关系。同时,采用无参贝叶斯原型推断进行语义对比学习,通过标签传播微调原型。实验结果显示该方法在半监督节点分类和聚类中表现出优秀的性能。

本文结合对比学习、标签传播和原型网络,提出了一种自监督节点表示的方法。通过图扩散进行结构化对比学习,利用多跳获取全局结构关系。同时,采用无参贝叶斯原型推断进行语义对比学习,通过标签传播微调原型。实验结果显示该方法在半监督节点分类和聚类中表现出优秀的性能。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1757

1757