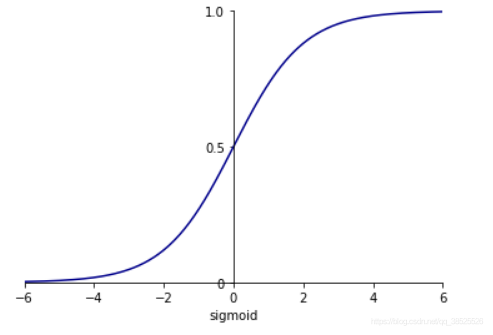

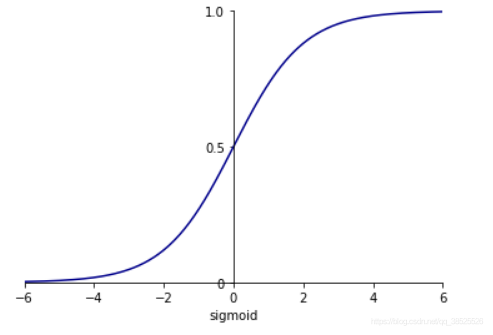

使用一个神经网络时,需要决定使用哪种激活函数用隐藏层上,哪种用在输出节点上。之前逻辑回归输出节点使用的激活函数是sigmoid激活函数,图像如下,

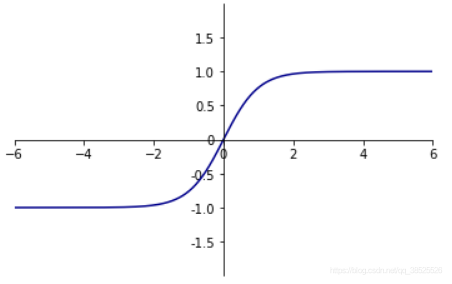

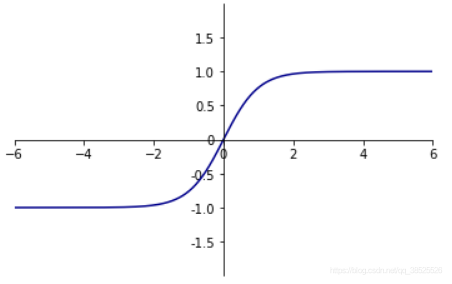

但是,有时其他的激活函数效果会更好。tanh函数或者双曲正切函数是总体上都优于sigmoid激活函数。

如图,y=tan(x)=ex−e−xex+e−xy=tan(x)=\frac{e^x-e^{-x}}{e^x+e^{-x}}y=tan(x)=

使用一个神经网络时,需要决定使用哪种激活函数用隐藏层上,哪种用在输出节点上。之前逻辑回归输出节点使用的激活函数是sigmoid激活函数,图像如下,

但是,有时其他的激活函数效果会更好。tanh函数或者双曲正切函数是总体上都优于sigmoid激活函数。

如图,y=tan(x)=ex−e−xex+e−xy=tan(x)=\frac{e^x-e^{-x}}{e^x+e^{-x}}y=tan(x)=

2047

2047

10万+

10万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?