Softmax Loss等价于在负对数方向上极小化MLE。

设总体(X,Y)~P,为概率密度分布,

为从总体X中抽取的样本,对应于

类,我们希望在给定样本

条件下,使得

最大,也即此时

为

属于各类的概率,

为

真实在各类上的概率,注意,此时

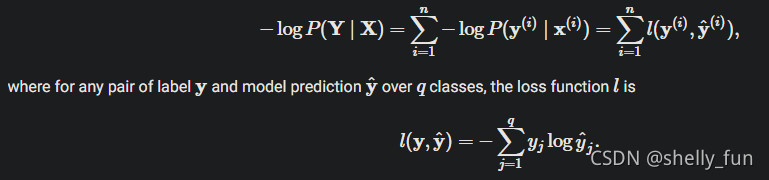

为one-hot编码。所以,我们求其似然函数有:

(1)

表示第

类上的概率,

为第k类对应的one-hot标签,也就是说我们希望在K类上,寻找一个分布能够使该分布尽可能表示各个类。注:这里的

也就是经由softmax函数得到的

。再由极大似然估计的流程,得到

这里的 就是(1)取对数后的结果。

本文解释了SoftmaxLoss如何通过最小化负对数似然估计(MLE)来逼近真实概率分布。通过实例说明,我们展示了如何将似然函数转化为交叉熵形式,并探讨了其在分类问题中的应用。

本文解释了SoftmaxLoss如何通过最小化负对数似然估计(MLE)来逼近真实概率分布。通过实例说明,我们展示了如何将似然函数转化为交叉熵形式,并探讨了其在分类问题中的应用。

838

838

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?