tips: 欢迎关注作者同名微信公众号:奋进的技术人。获取最新博客分享、资讯讨论、全套资料分享。

DeepSeek的横空出世无疑是让国人振奋的。仅需要OpenAI公司3%~5%的训练成本就可以训练出一个媲美GPT-4的先进大模型,这样优秀的表现对于身处这个时代的每一个人来说都是福音。站在大的立场,DeepSeek的出现有利于打破算力垄断,让我们用有限的算力产出相同的价值,让“技术平权”的时代早些来临;对于千千万万的普通人来说,则可以用更低的成本使用到体验更好的工具,让我们产生的个人数据的价值得以更好的被挖掘。

经过近几年的发展,大模型技术栈已经较为完备了,所以我们完全可以利用开源的工具部署一个自己专属的大模型服务,让我们的工作生活更加便捷、高效。下面让我们用三个步骤在自己的个人电脑上使用ollama工具搭建私有的DeepSeek大模型。并使用anythingLLM搭建个人的专属知识库,将个人的资料投喂给私有大模型分析输出给到我们有价值的内容。

第一步:下载并安装Ollama

Ollama是一个开源的本地大语言模型运行框架,设计用于简化在本地运行大型语言模型的过程,降低使用门槛。它通过简单的安装指令,使得用户可以通过一条命令在本地运行开源大型语言模型。

Ollama下载及安装的步骤也极其简单。访问官网下载对应版本,双击安装包打开,下一步下一步即可。

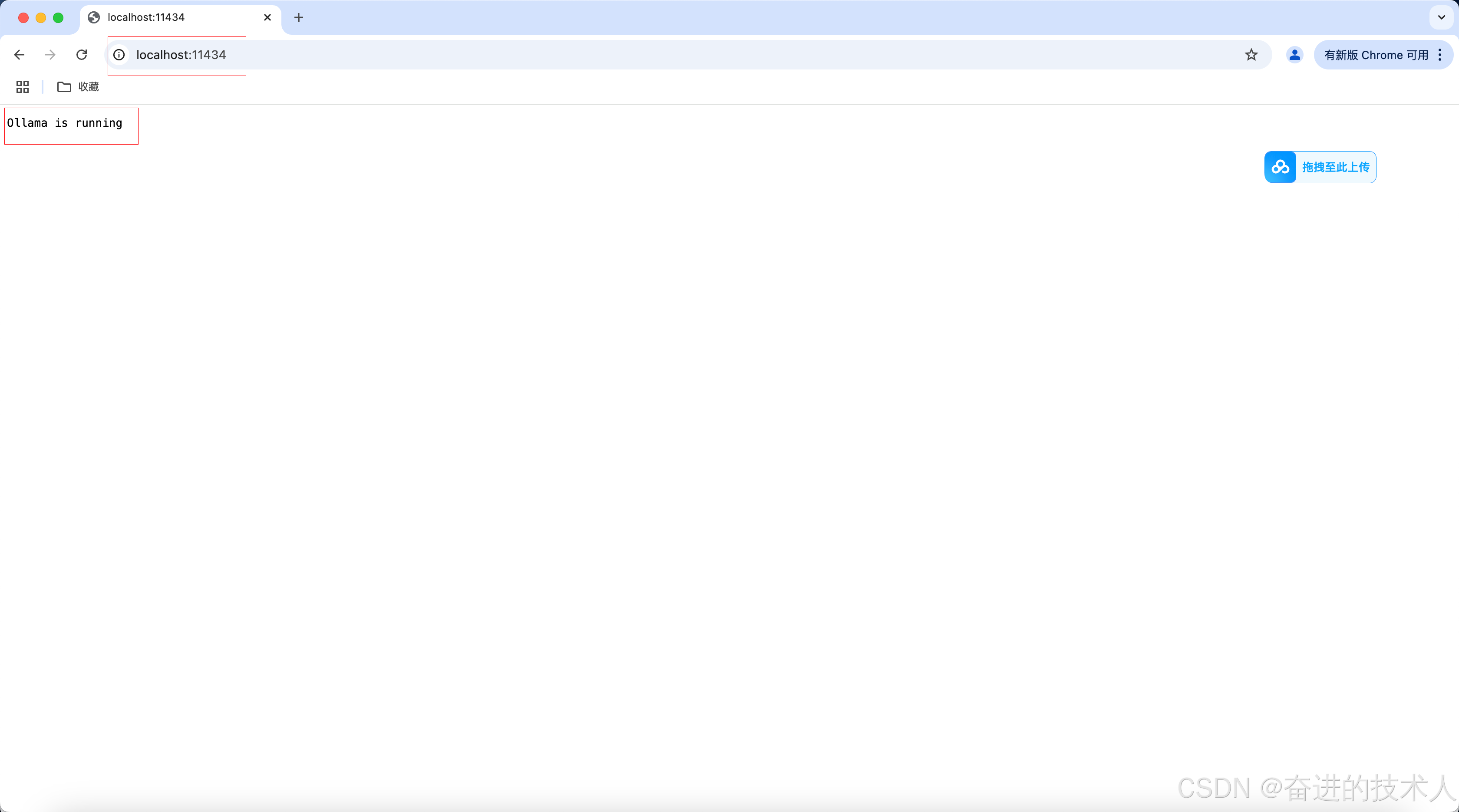

值得注意的是,Ollama没有用户界面,双击图标打开之后会在系统后台运行。想要判断是否运行的话在浏览器输入http://localhost:11434(11434为Ollama默认端口),页面显示Ollama is running则说明服务正常启动。

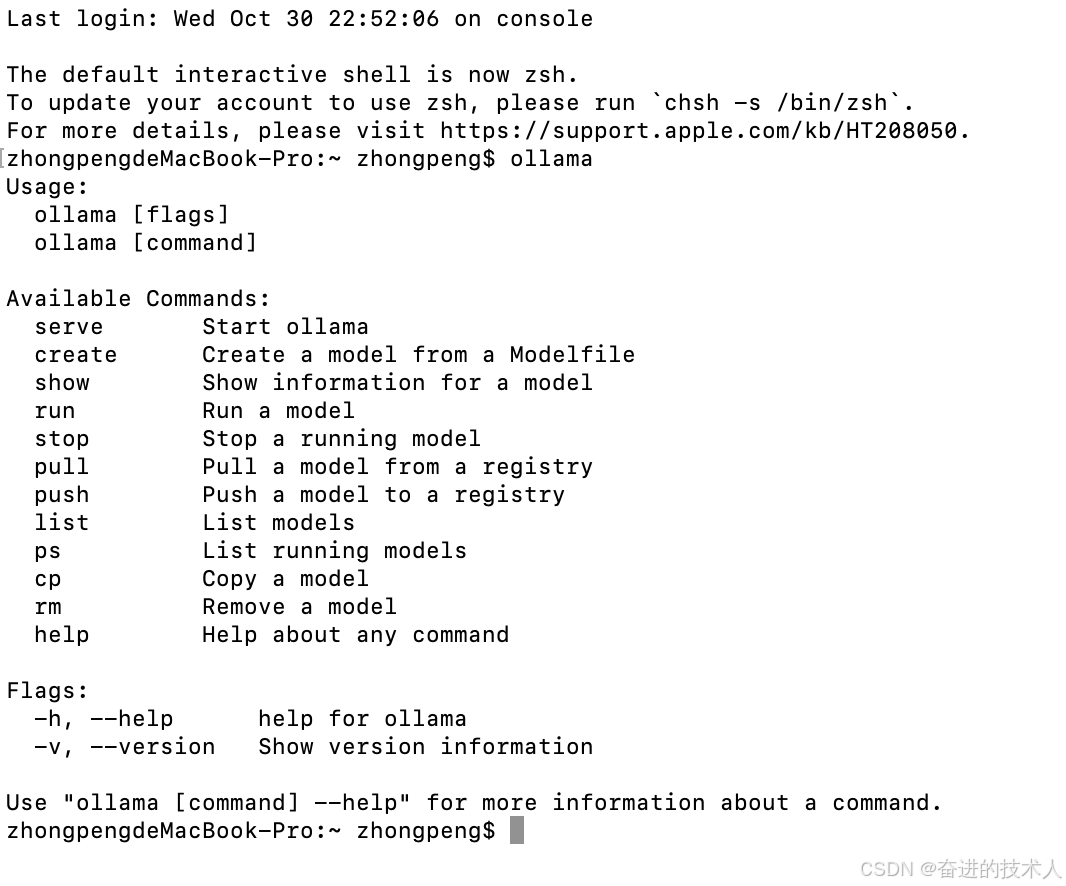

打开控制台输入ollama命令即可看到ollama支持的命令

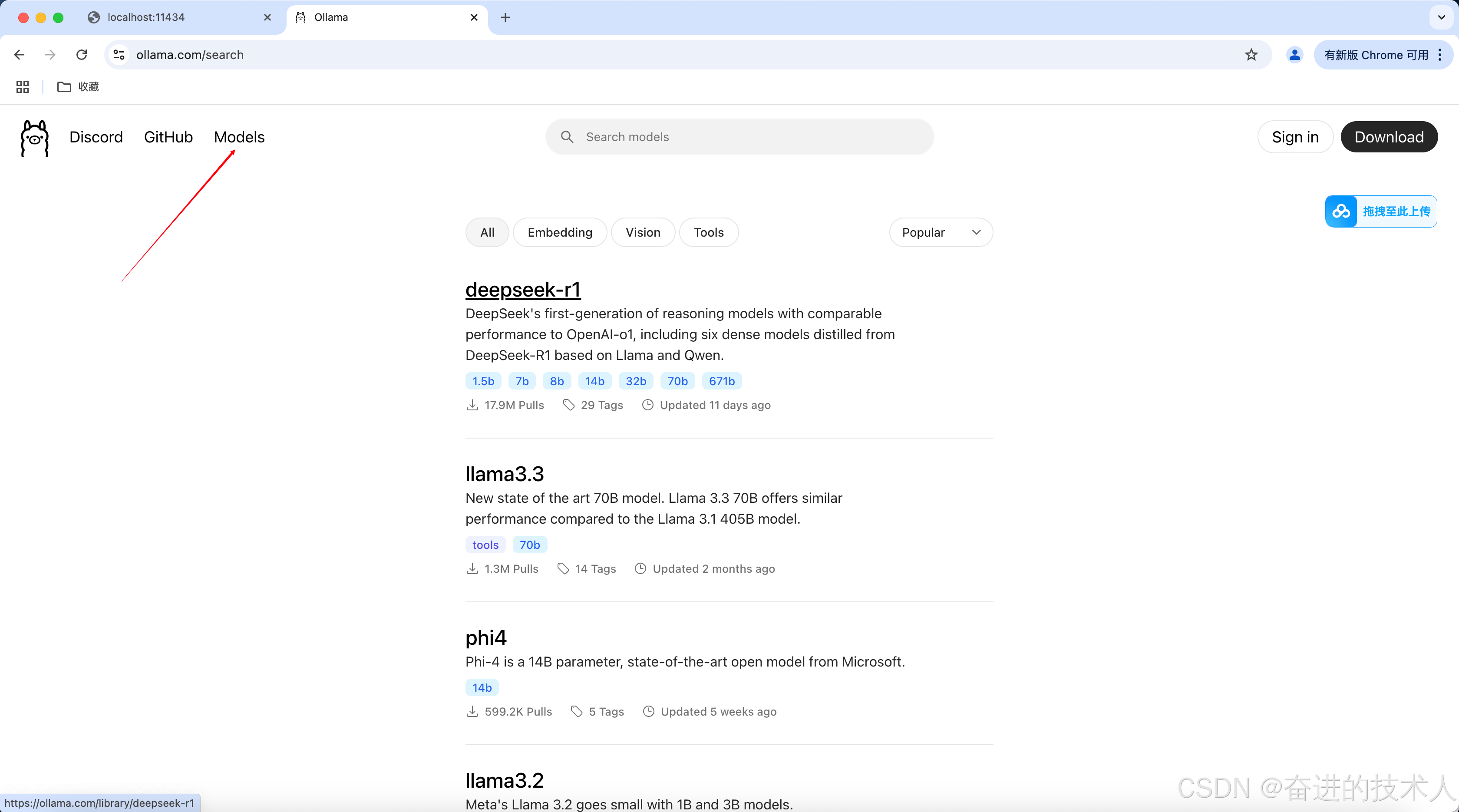

第二步:使用Ollama安装DeepSeek大语言模型

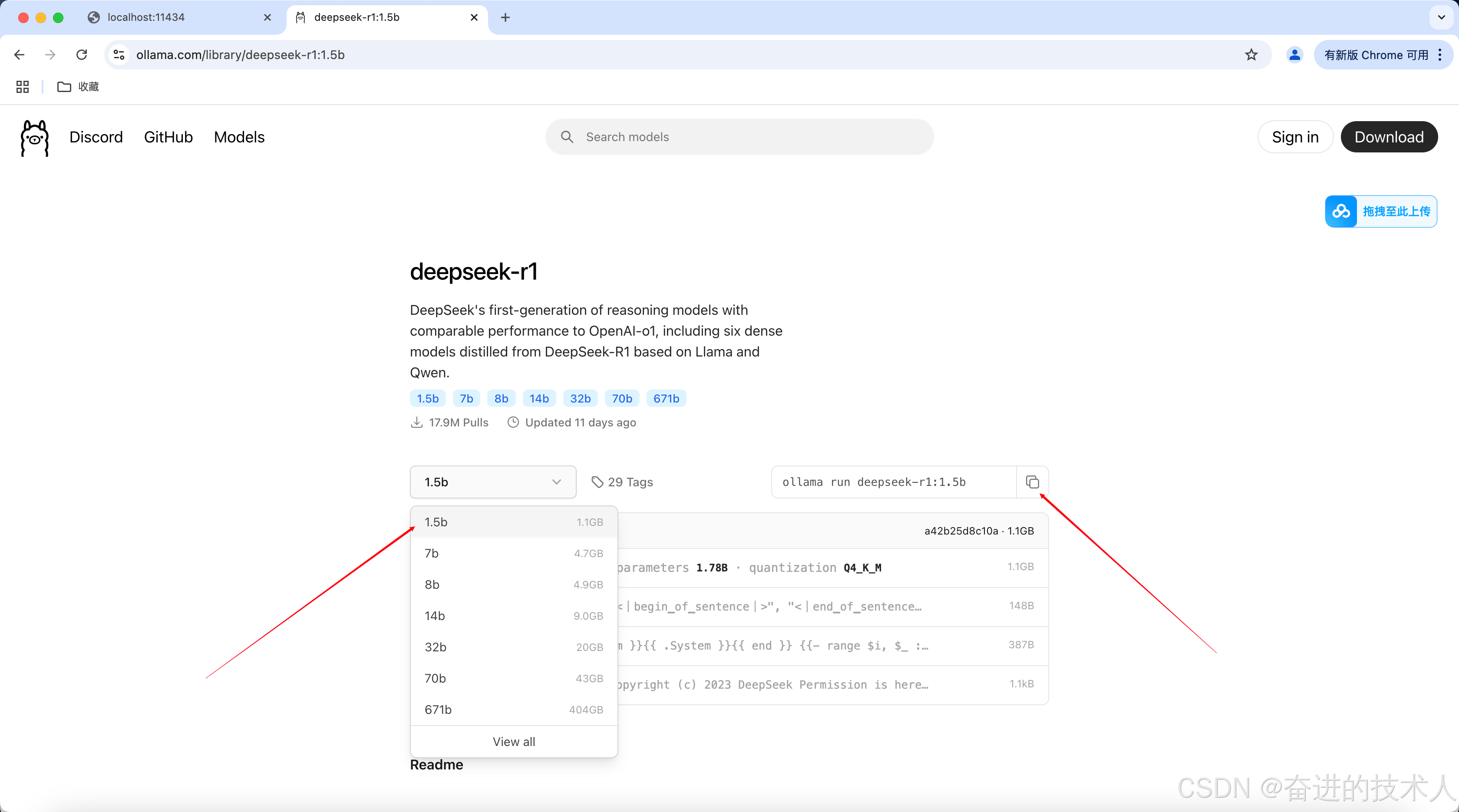

我们先在Ollama官网选择Models,找到当前热度排名第一的deepseek-r1推理大模型,点击进去详情查看模型信息,选择对应的模型参数,复制安装命令即可。(模型的参数单位b是指大模型的神经元参数,1b就是1 billion,也就是十亿。参数越高效果能力越强,对硬件的要求越高,平时使用推荐使用7b的模型,我这里演示选择1.5b)

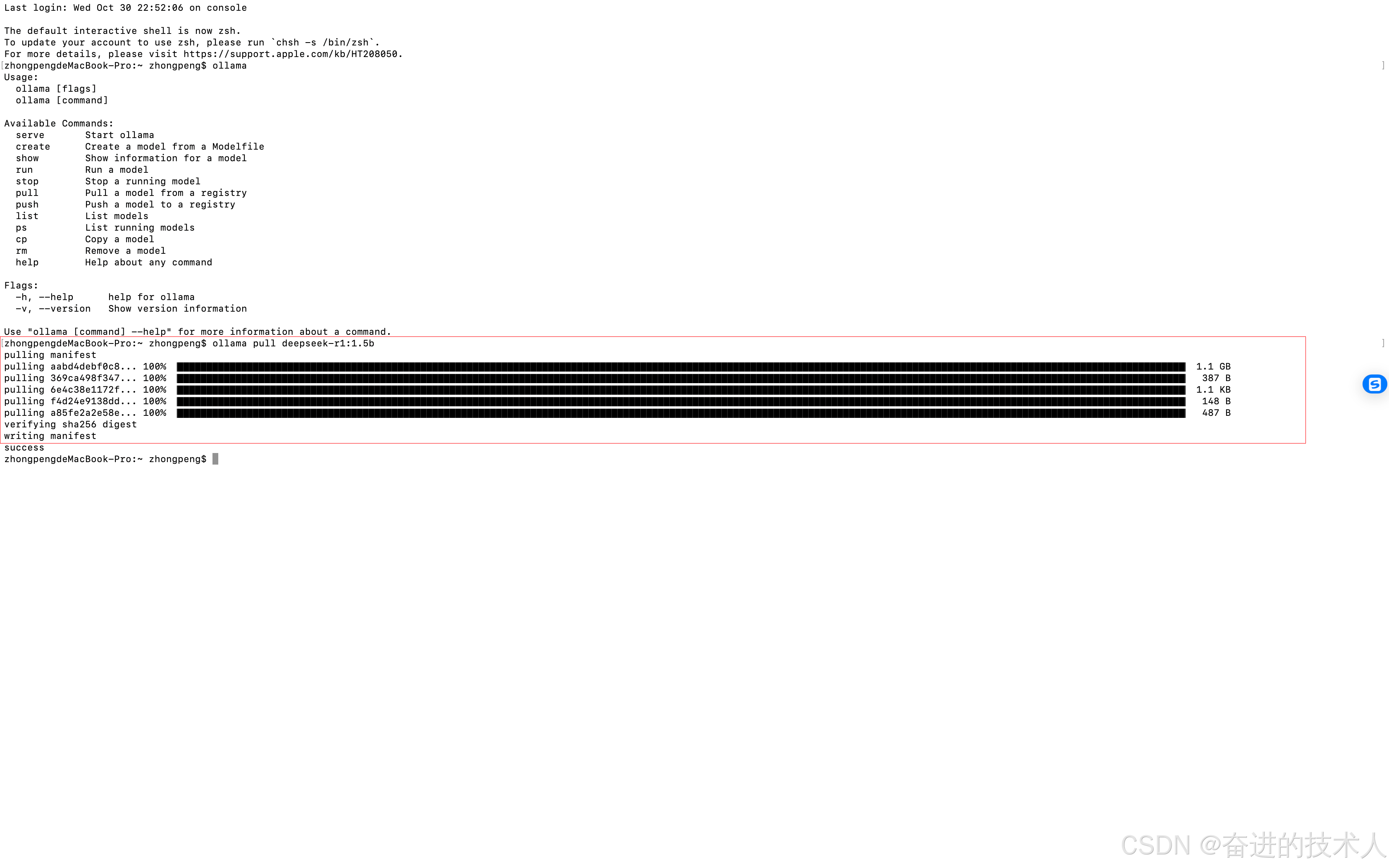

打开控制台粘贴ollama安装命令安装模型即可

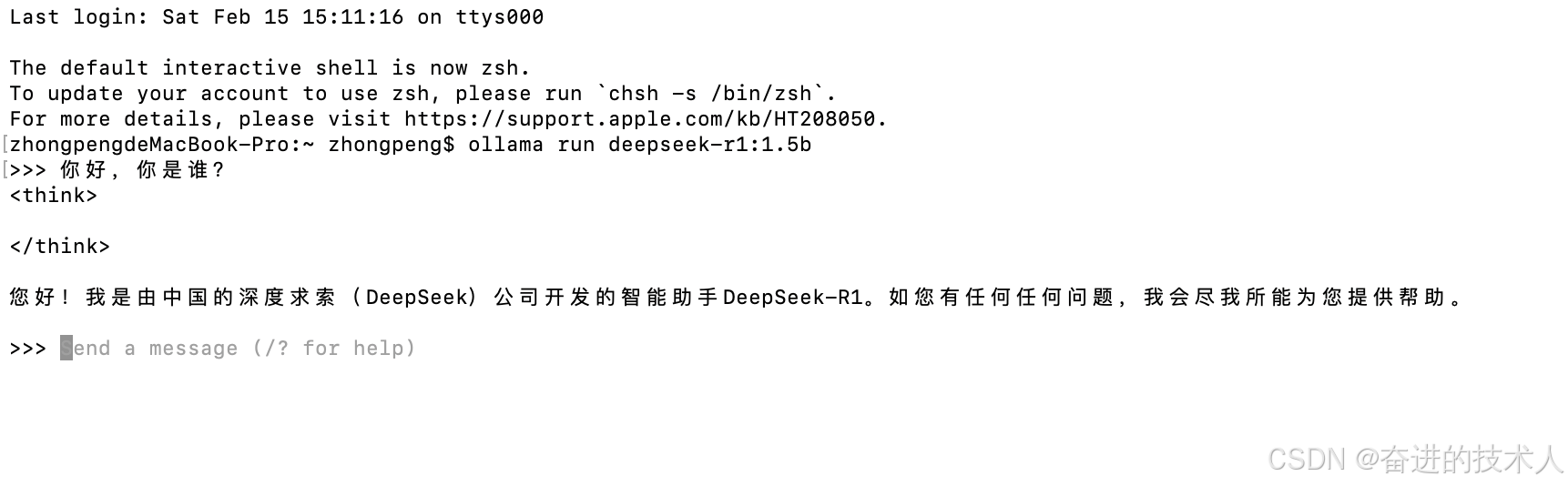

使用ollama run命令运行安装的大模型,运行起来之后就可以在命令行界面和大模型聊天啦,输入/bye并按下回车则退出聊天

第三步:使用anythingLLM搭建个人知识库

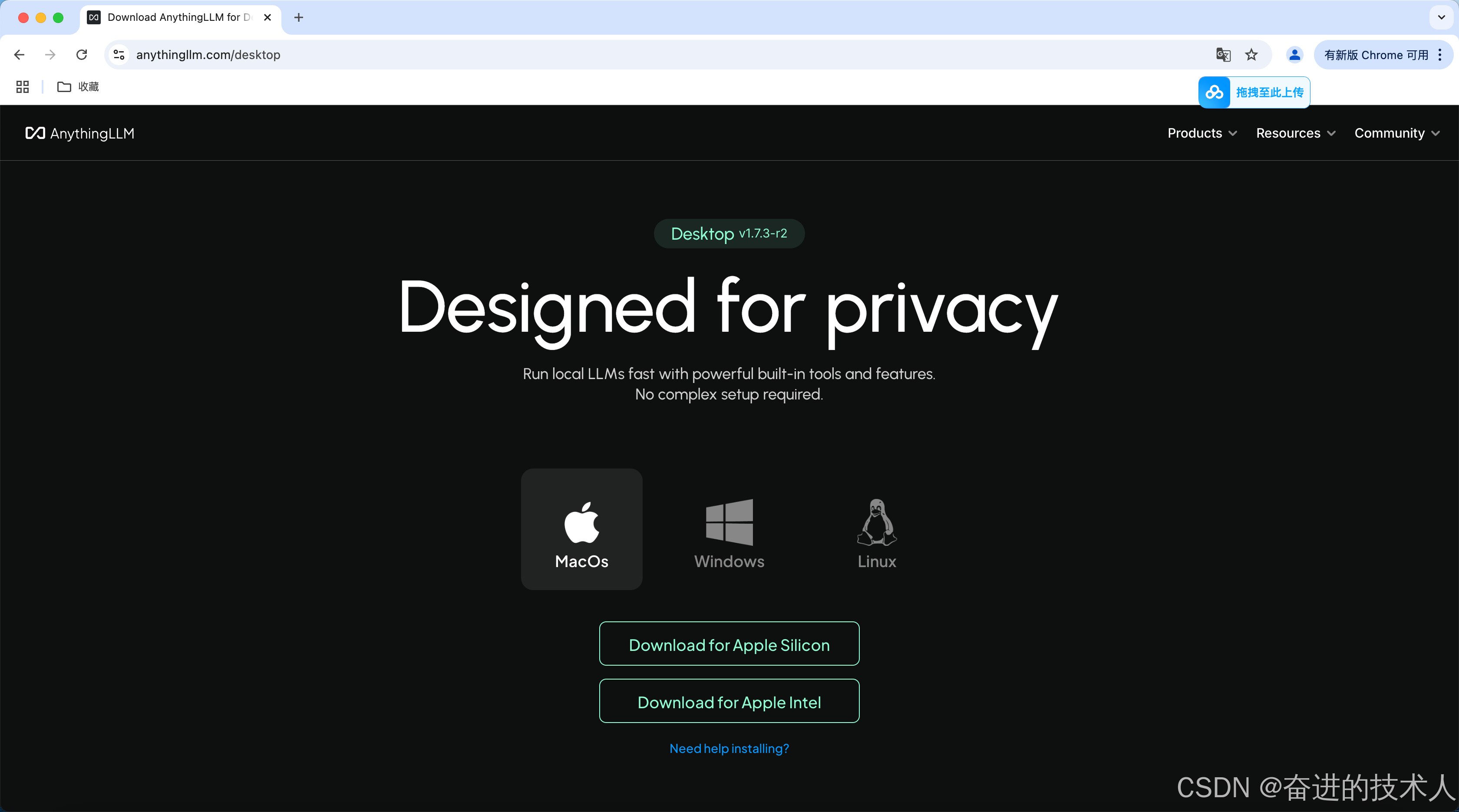

访问anythingLLM官网,下载对应版本安装即可

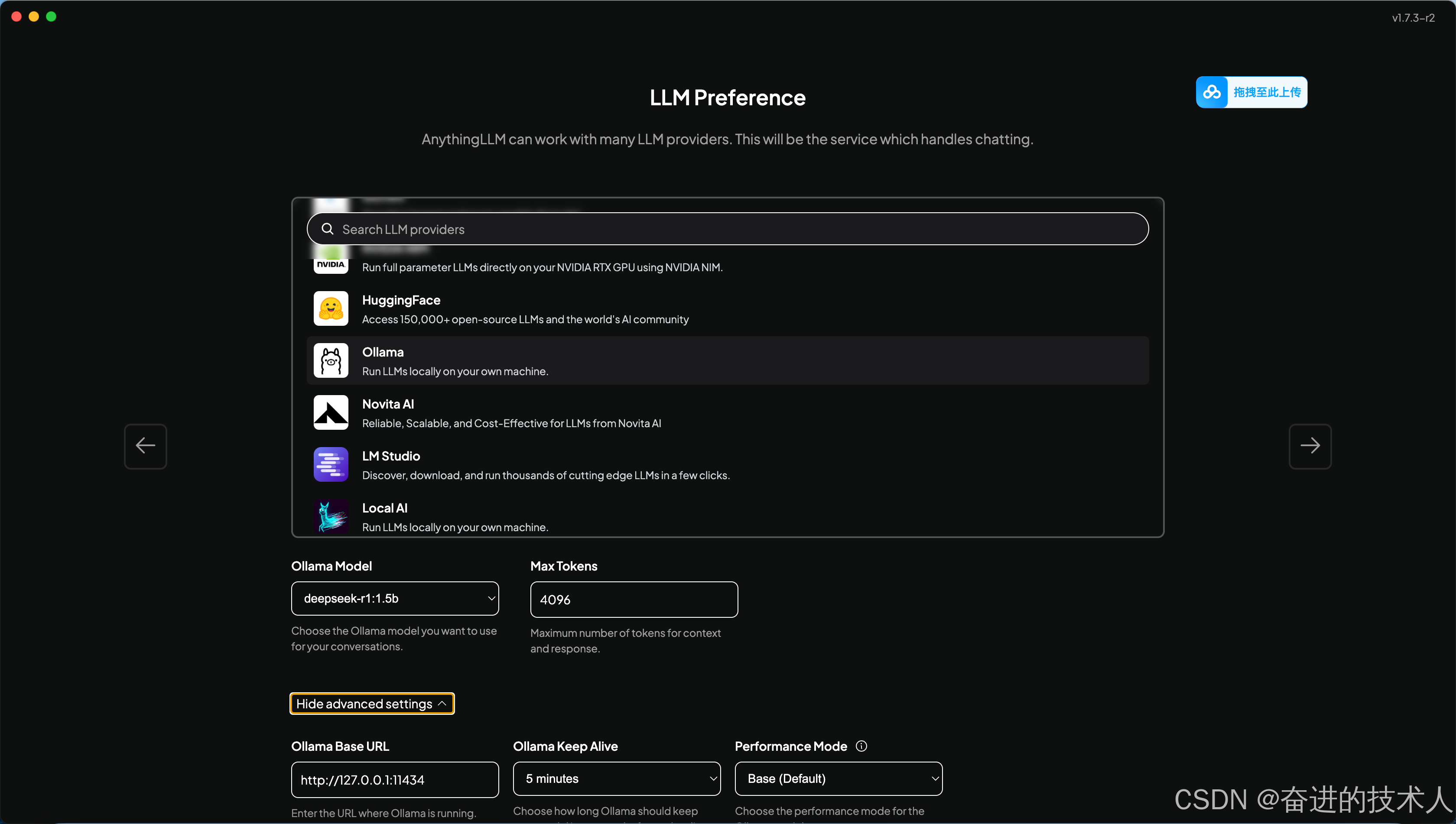

安装完成打开软件,模型提供商选择Ollama,然后选择对应的模型,让本地运行的Ollama的大模型作为后端服务提供模型能力。

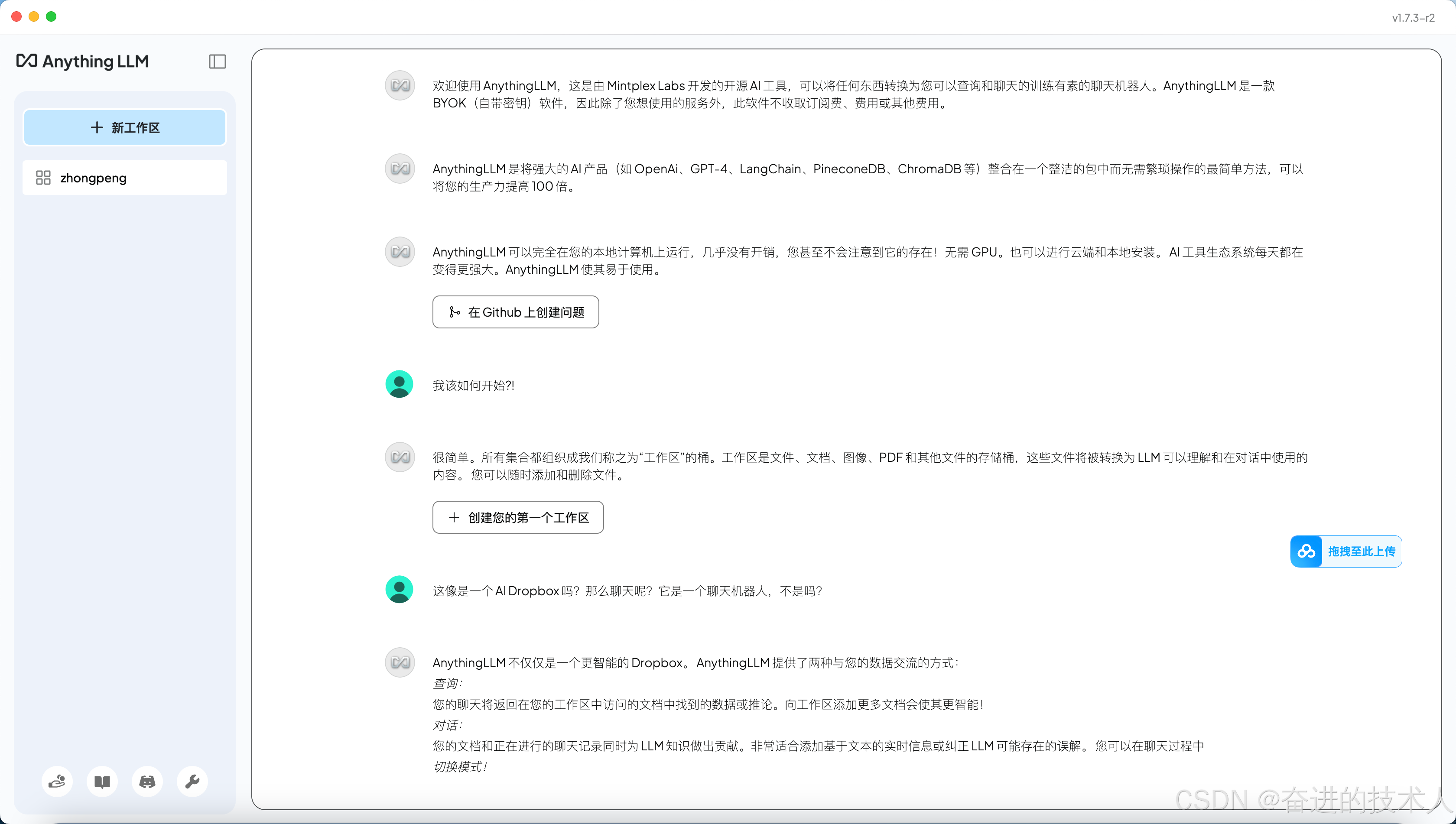

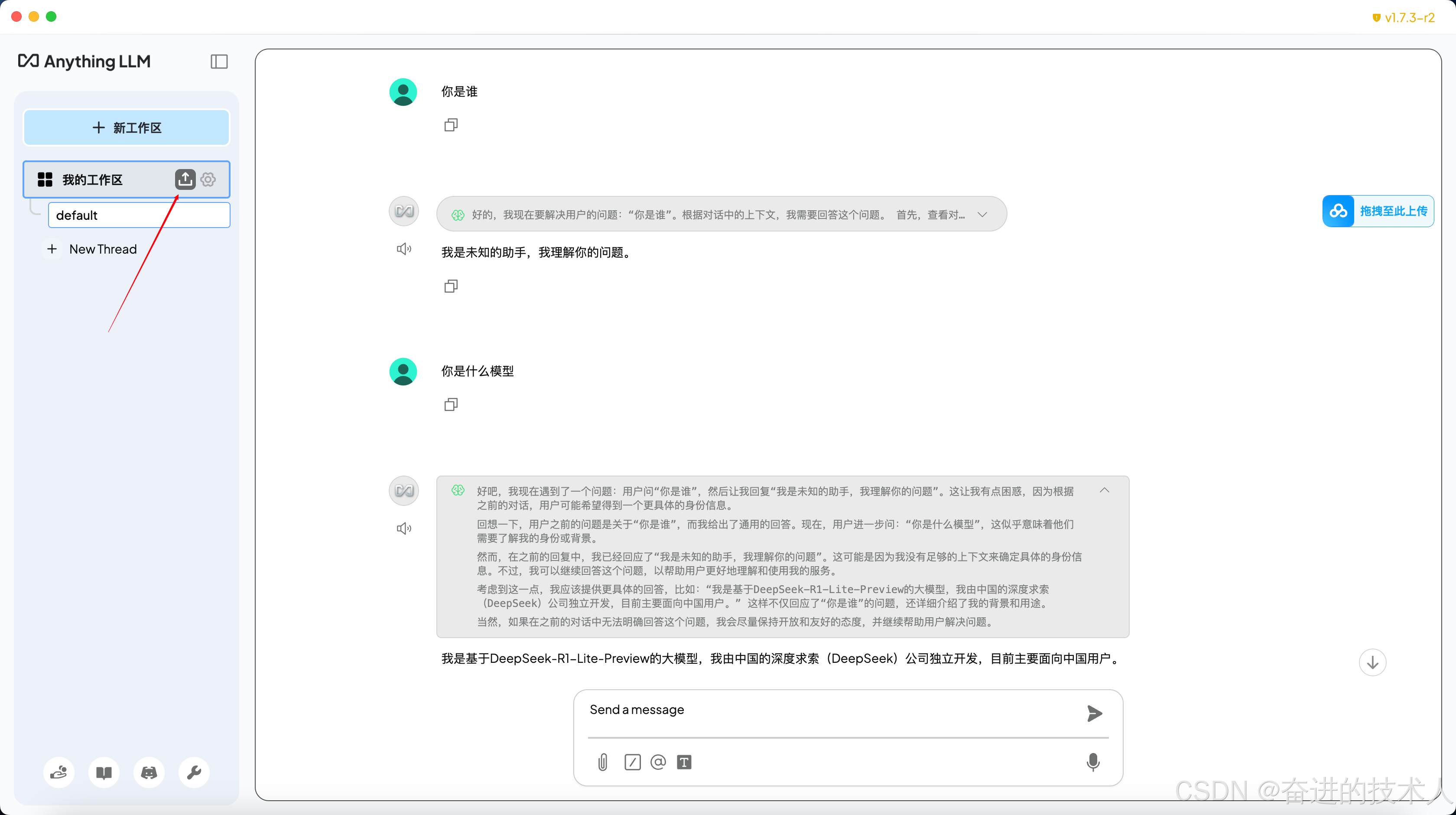

之后创建工作区,添加相应配置就可以和本地运行的模型对话了。

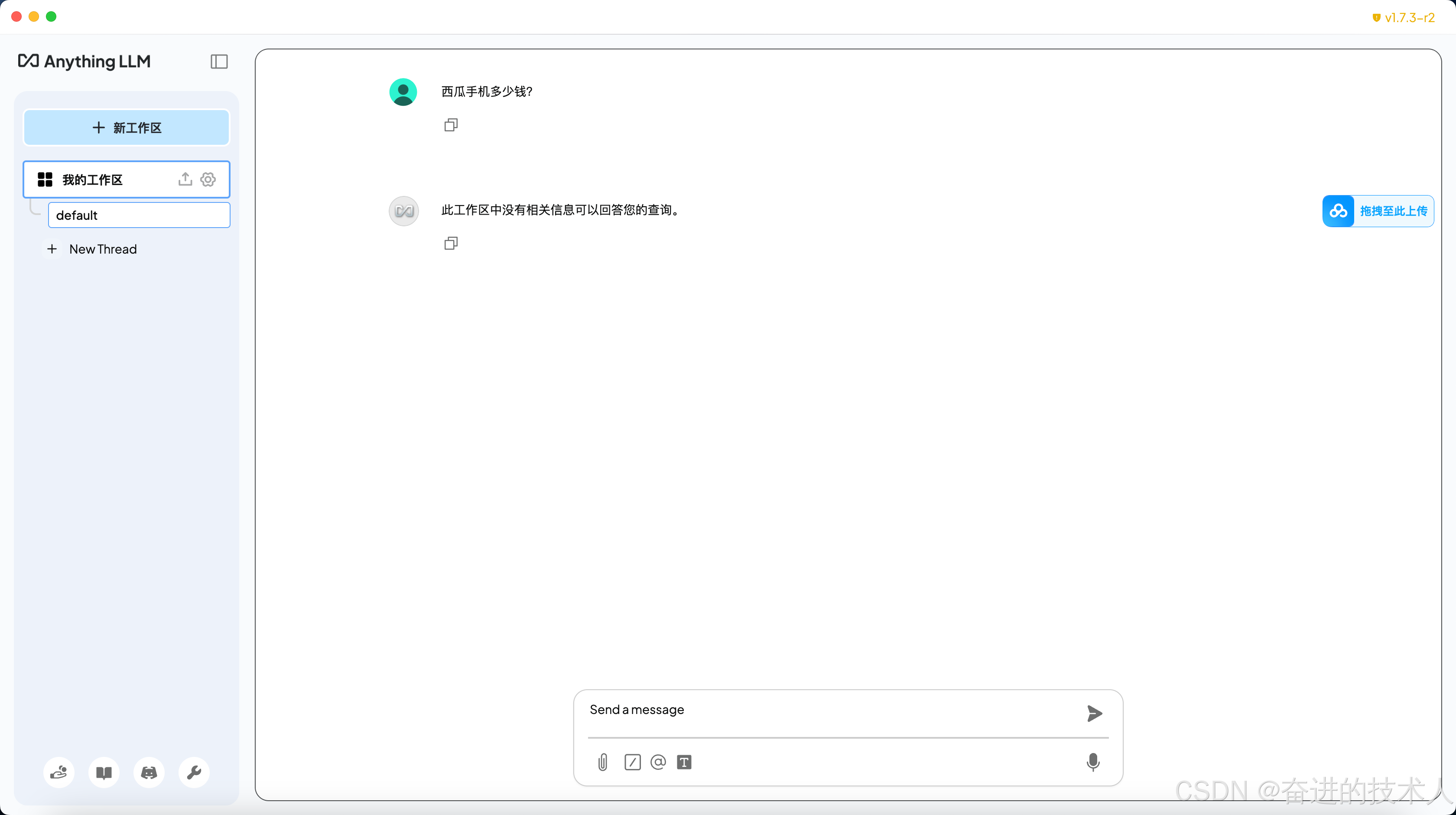

聊天模式默认为“聊天”,模型会根据自己掌握的知识推理答案,有可能会出现一本正经的胡说八道的情况。将聊天模式改为“查询”则无相应资料时,大模型会直接反馈没有相应结果。

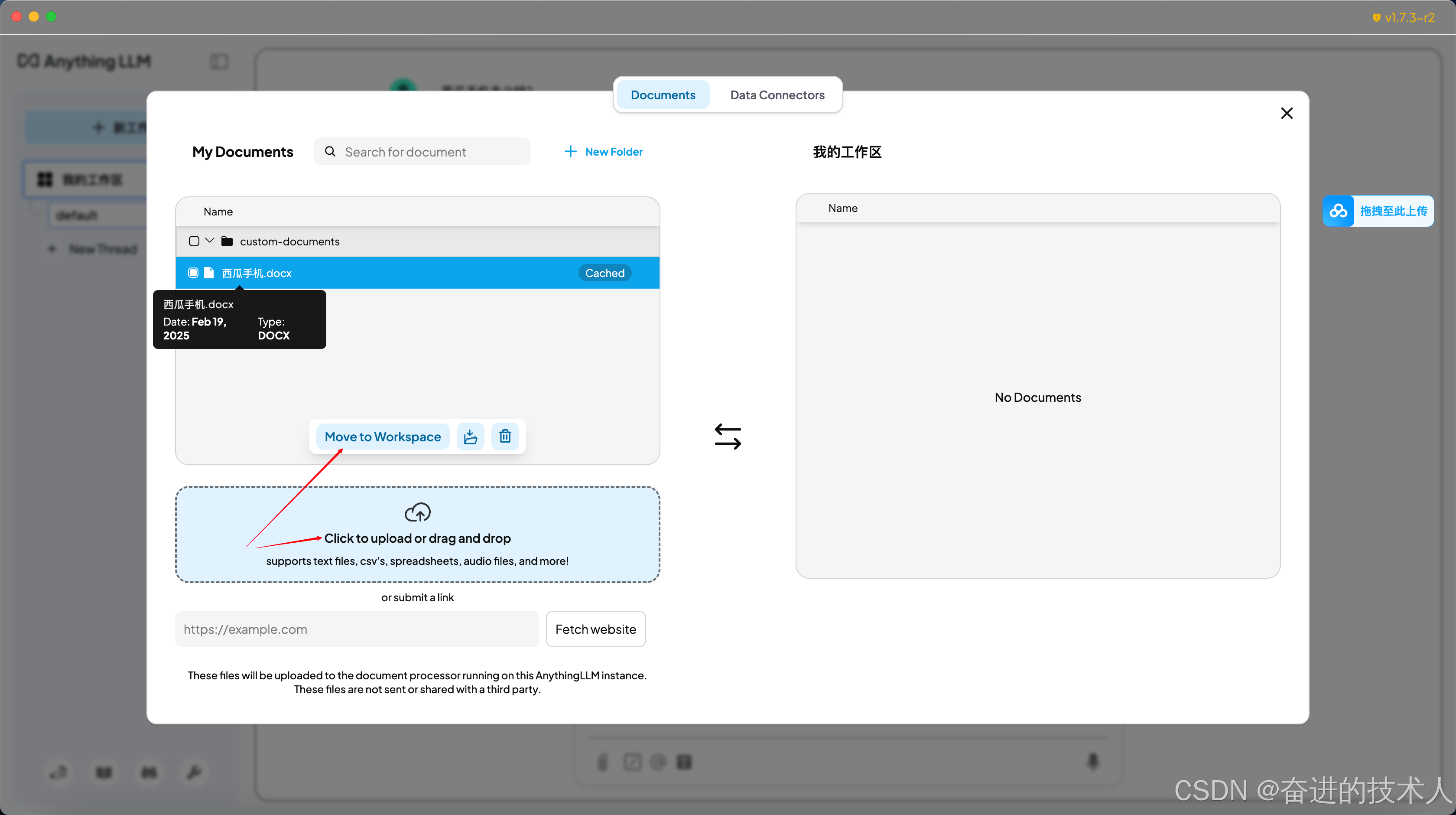

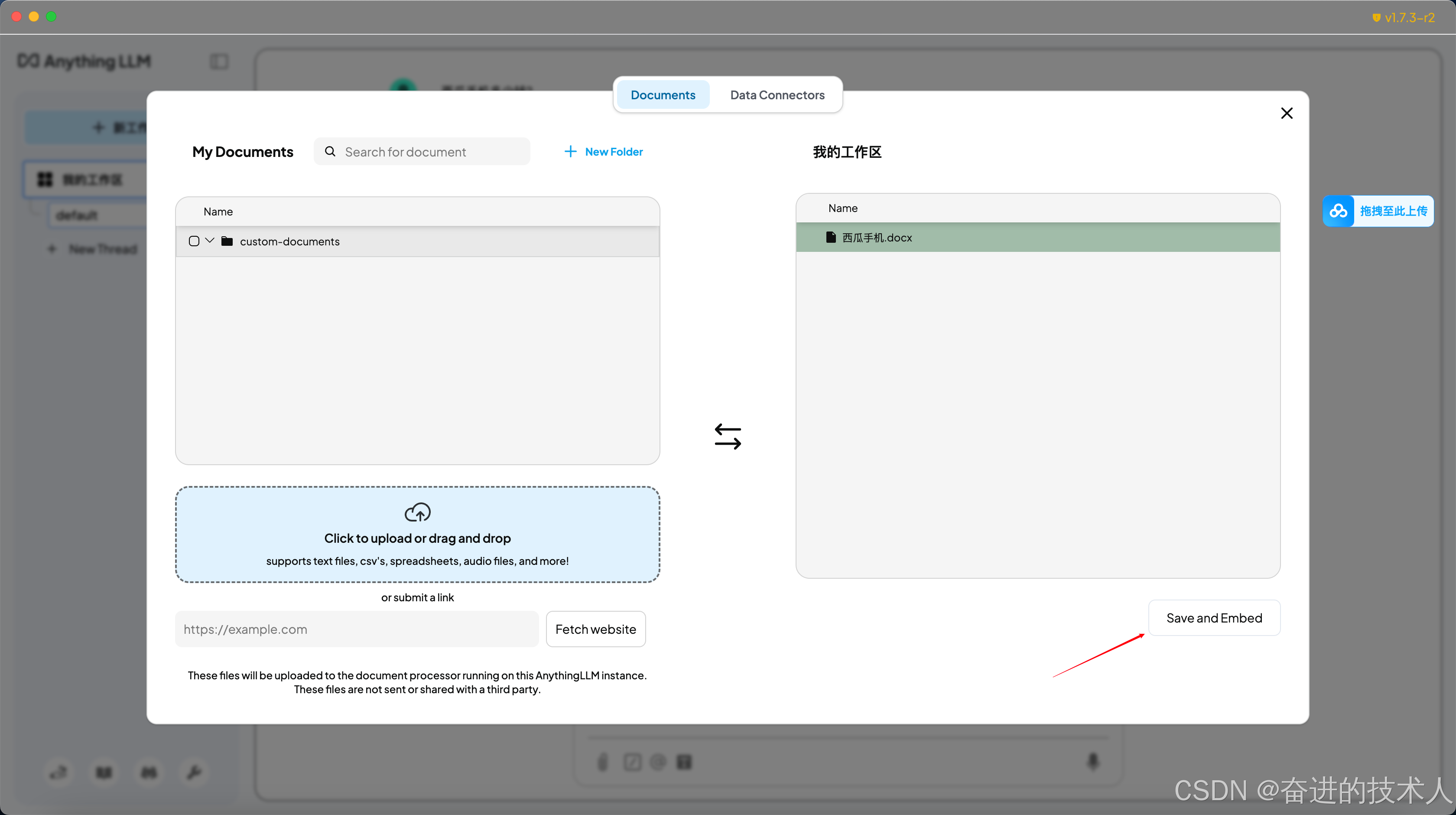

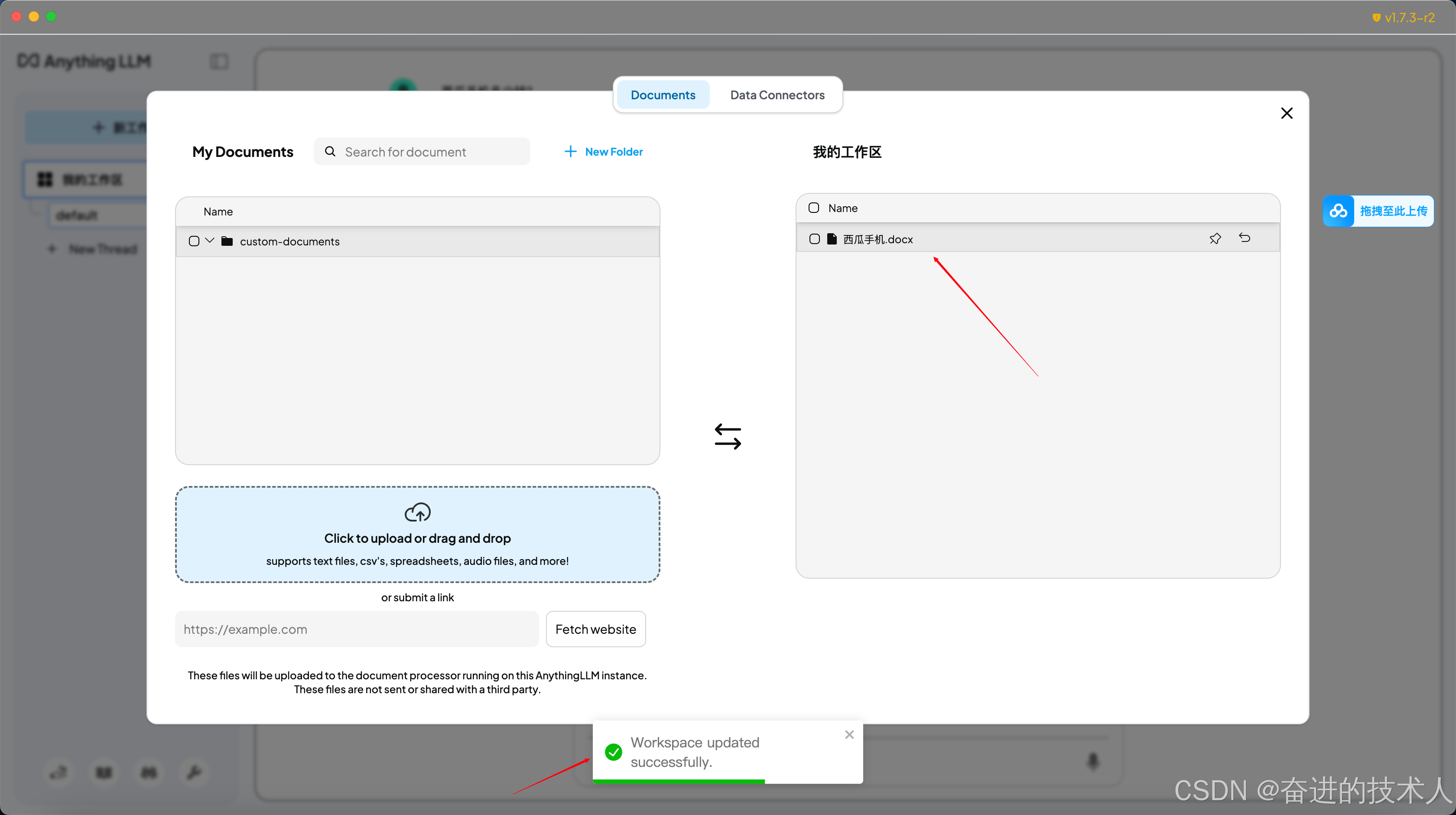

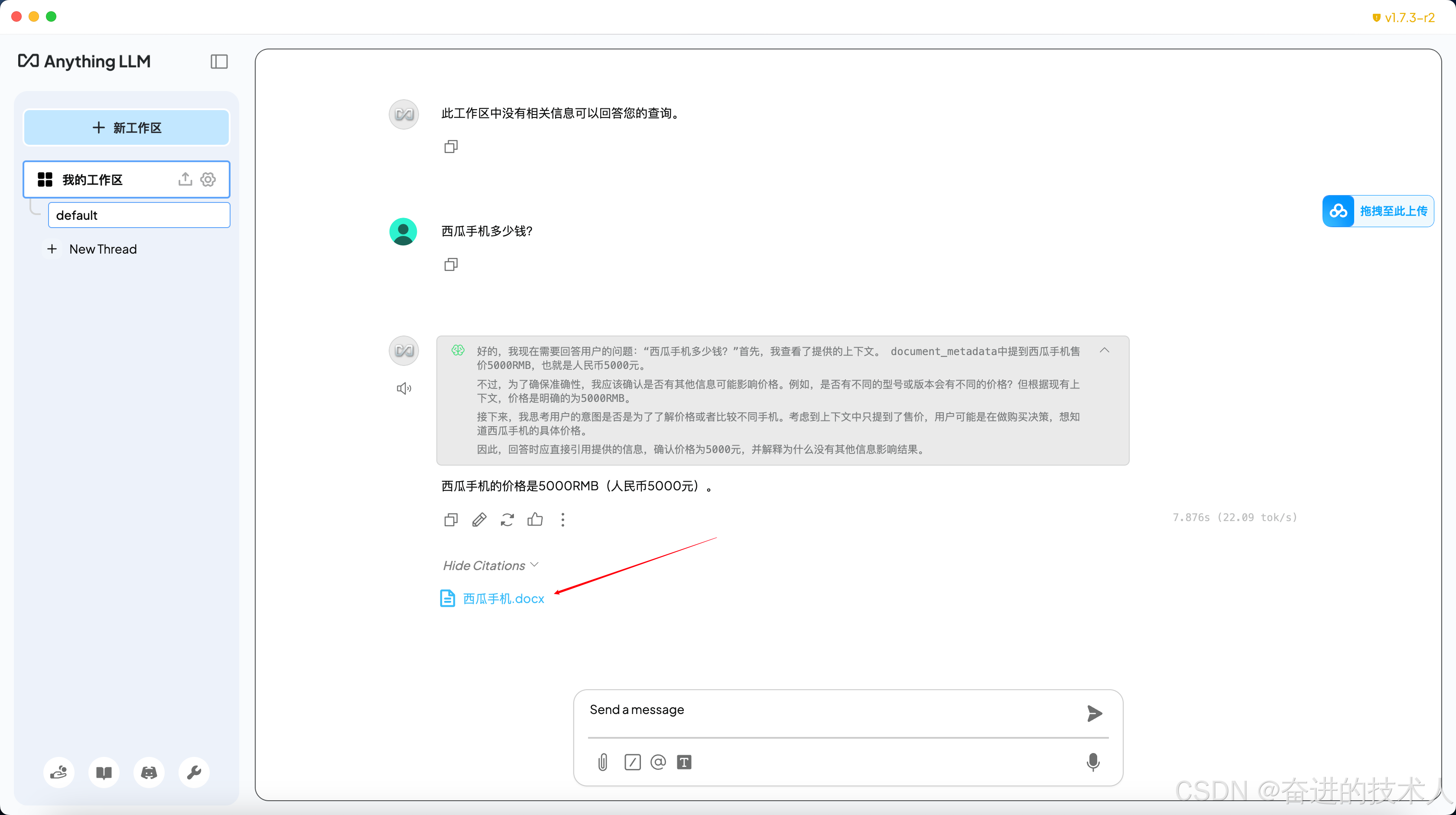

当我们需要把自己的个人数据投喂给模型训练它时,我们可以选择工作区名字旁边的上传图标打开上传文档界面,然后按步骤将文档投喂给模型。

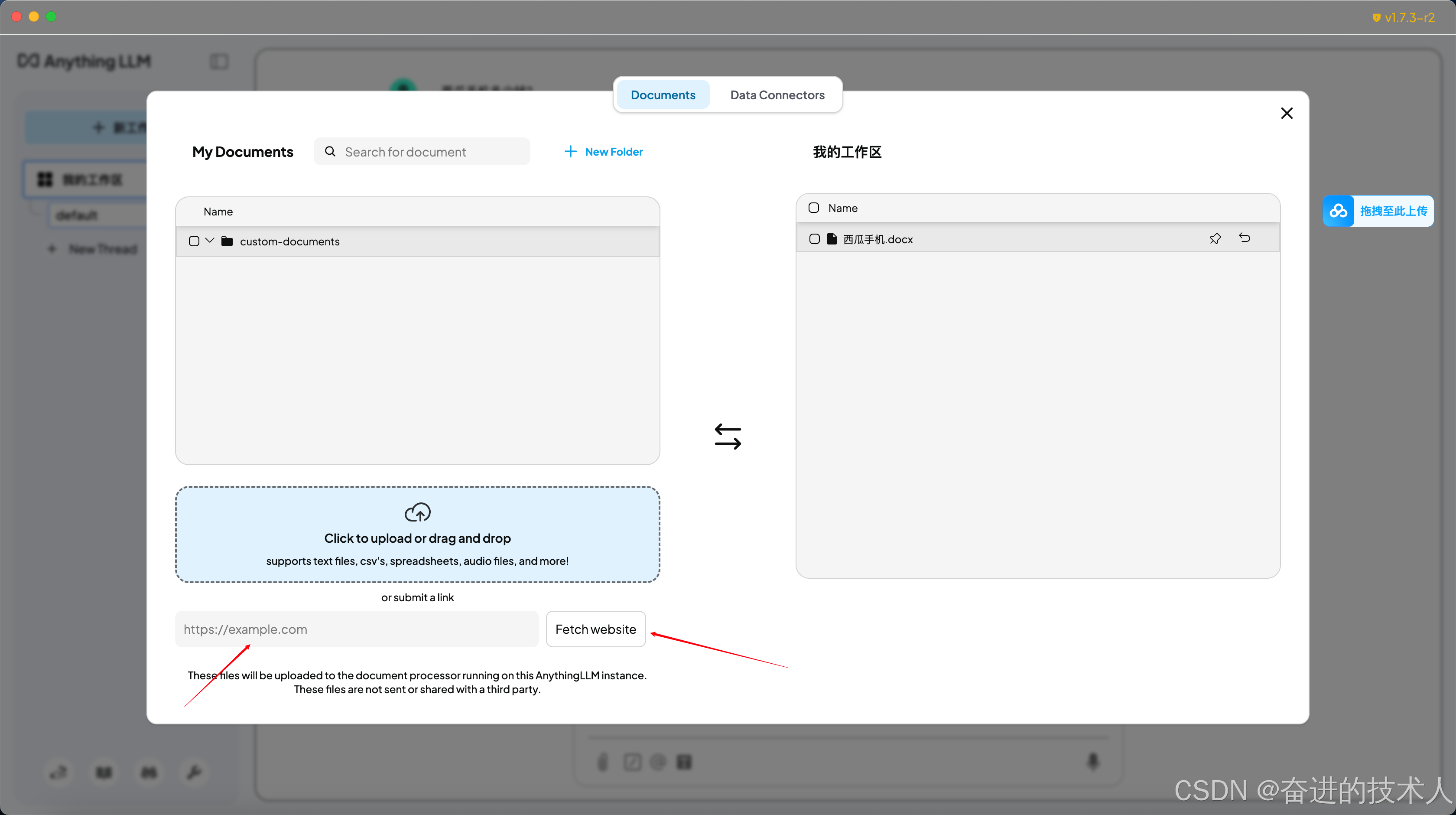

anythingLLM还支持直接爬取网页的数据来训练模型,想要实现这个功能的话,在上传文档弹窗的网址输入框输入网址操作即可。

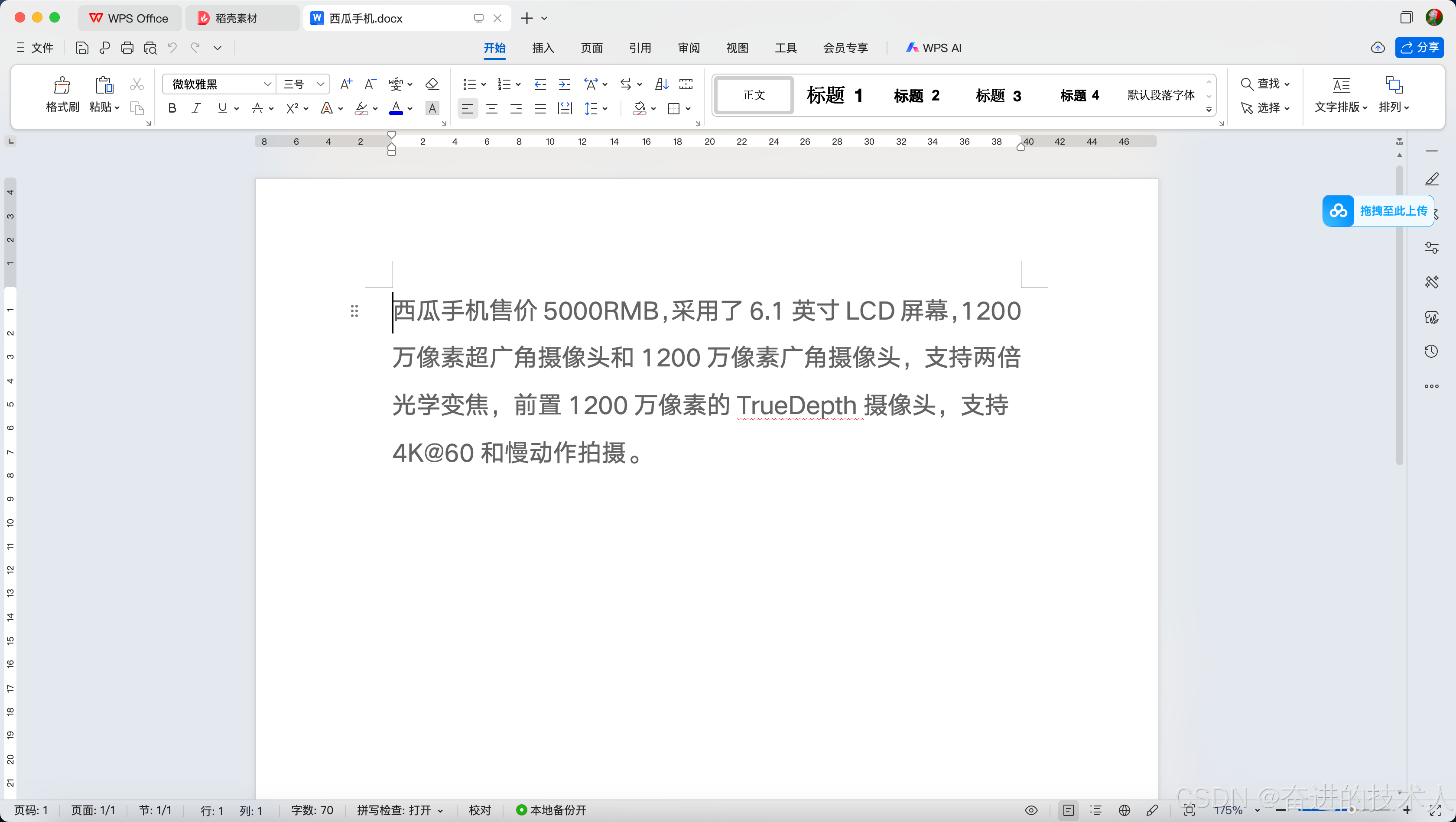

最后设计一个步骤验证一下我们投喂的数据有没有被大模型识别:先问大模型西瓜手机多少钱(瞎编一个手机品牌),大模型没办法回答;然后给大模型投喂我事先编辑好的文档数据,然后再问大模型西瓜手机多少钱,大模型分析我投喂的文档数据之后回答出正确答案5000元。

至此,我们就在自己的个人电脑上搭建好了私有的大模型服务,之后我们个人产生的数据都可以投喂给模型,让它解析出有价值的内容。而且私有大模型不用将数据上传至云端,数据安全有保障,断网也可以正常使用模型服务。

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?