Opinion Word Expansion and Target Extraction through Double Propagation(通过双传播进行意见词扩展和暗语提取)

摘要

意见分析又被称为意见挖掘或情绪分析,由于其具有许多实际应用和具有挑战性的研究问题,近年来受到了广泛的关注。本文主要研究意见词汇扩展和意见目标提取两个重要问题。意见目标(简称意见目标)是表达意见的实体及其属性。在执行任务时,我们发现意见词与目标词之间存在着几种句法关系。这些关系可以通过依赖解析器来识别,然后利用依赖解析器扩展初始意见词汇,提取目标。该方法基于bootstrapping。我们称它为双重传播,因为它在观点词和目标之间传播信息。该方法的一个关键优点是只需要一个初始意见词典就可以启动自举过程。因此,由于使用了意见词种子,该方法是半监督的。在评价中,我们比较所提出的方法与几个最新的方法使用标准产品审查测试集合。结果表明,我们的方法明显优于现有的方法。

1.介绍

基本思想

该方法的基本思想是通过对语法关系的识别,利用已知的和在之前的迭代中提取的意见词和目标,迭代地提取意见词(或目标)。关系的识别是提取的关键。

2.相关工作

我们的主要工作涉及到意见词抽取和意见目标抽取。

2.1 意见词抽取

该方法采用域依赖语料库提取意见词,这样我们就可以找到与领域相关的意见词(不同词在不同领域所表达的情感是不一样的)。

2.2 意见目标提取

通过句法依赖树,抽取名词目标,为了去除噪声,提出了不同的剪枝方法。为了掩盖被遗漏的罕见特征,他们将观点词中最接近的名词/名词短语,由常见特征识别为罕见特征。

3.关系识别

识别意见词/目标与其他意见词/目标之间的关系是我们意见词汇扩展和目标提取方法的关键。在本节中,我们将详细描述关系标识。在此,为了方便起见,我们将意见词与目的词之间的关系称为OT-Rel,意见词之间的关系称为OO-Rel,目的词之间的关系称为TT-Rel。

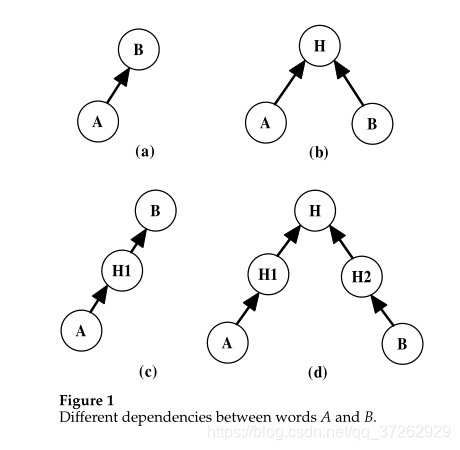

在这项工作中,我们使用依赖语法来描述语法上的关系。在依赖语法中,两个词A和B之间的句法关系可以描述为A(或B)依赖于B(或A)。我们定义了两类来概括两个词在句子中所有可能的依赖关系。

定义1:直接依赖(DD)

直接依赖关系表明一个单词依赖于另一个单词,而在依赖关系路径中没有任何附加的单词或者它们都直接依赖于第三个单词

定义2:间接依赖(IDD)

间接依赖指的是一个词通过一些附加词或者它们都通过附加的单词依赖于第三个单词。

在下图中,(a)(b)表示的是直接依赖,©(d)表示的是间接的依赖

&emsp注意,DDs和IDDs仅描述所有可能依赖关系的拓扑。然后对意见词和目标词进行词性标注的约束,并对依赖路径上的句法关系进行约束。

使用Stanford进行词性标注,使用Minipar2进行句子解析。在这篇文章中,认为意见词是形容词,目标词是名词/名词短语,现在看来,这种识别方法,可能会造成大量的aspect缺失,近年来很多论文对其进行了改进。

4.意见词典扩展和目标提取

利用本文定义的关系,基于传播迭代地执行意见词汇扩展和目标提取任务。为了引导传播,我们只需要一个种子意见词典。

我们的提取方法采用基于规则的策略。

4.1基于关系定义的传播规则

在传播的过程中,有四个子任务。

- 使用意见词提取目标。

- 利用提取的目标提取目标

- 利用提取的目标提取意见词

- 根据给定的意见词和提取的意见词提取意见词(禁止套娃)

可以看出,任务1和3使用OT-Rels(意见词与目标之间),任务2使用的是TT-Rels(目标与目标之间),任务4是OO-Rels(意见词之间)。

本文在当前方法中仅使用了DD依赖关系(IDD更适合正式的文本),注意这里的规则是独立于域的。

目标词和意见词的提取规则。第1列是规则ID,第2列是观察到的依赖项和它必须满足的约束(s.t之后),第3列是输出,第4列是一个示例。在每个示例中,带下划线的单词是已知单词,带双引号的单词是提取的单词。我们还在括号中显示了相应的实例化依赖关系。

在表中,o表示提取意见词,t表示提取目标。{O}是意见词的集合,{T}表示的是目标的集合,H代表任何一个词。pos(o or t )和(O-Dep or T-Dep )分别表示凡是O or T的pos信息和依赖信息。{JJ}和{NN}分别是潜在意见词和目标的POS标签集。{JJ}包含JJ,JJR,JJS;{NN}包含NN,NNS。{MR}由描述观点词与目标词之间关系的依赖关系组成。{CON}只包含conj(连接词)。箭头表示依赖关系。

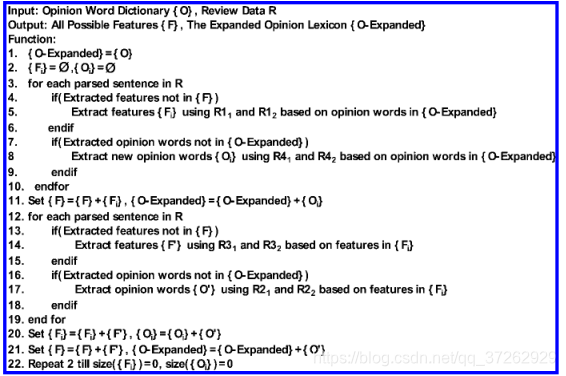

4.2传播算法

在该算法中,提供了关于产品的意见词词典O和评论数据R作为输入。这些步骤按照传播顺序设置。当没有新的意见词或目标可以添加时,它就停止了。该算法已在前面的文本中说明。这里我们就不重复了。

4.3意见词的极性分配

本文提出了一种基于相关证据的极性分配方法。基本的直觉是,人们通常用一致的方法表达他们的观点,除非有明确的想法的词语,如but和however。在实践中,作业实在意见词抽取过程中完成的。在我们描述我们的方法之前,让我们对意见词和目标做一些观察:

- 评审同一目标的相同极性。评审是一个评审人写的文件。通常情况下,审稿人对同一目标有着相同的情感或极性,尽管这个目标在审稿中可能不止一次出现。

- 领域语料库中的同一意见词具有相同的极性。通常情况下,同一意见词在一个领域语料库中具有相同的极性。

根据上述观察,我们通过以下规则对提取的意见词和目标进行极性推断:

- 异构的规则: 对于已知目标提取的意见词和已知意见词提取的目标,我们赋予它们与已知目标相同的极性。(个人感觉,在这里直接赋予情感极性可能会造成误判,现在目标已提取出来了,是不是可以通过其他神经网络的方法进行判断情感极性)。

- 均匀规则。对于由已知意见词提取的意见词和由已知目标提取的意见词,除非它们之间存在相反的词,否则我们将它们分配为与已知意见词相同的极性。

- Intra-review rule 。一些目标从其他评论中提取了一些新的意见词。在目前的审查中,这些目标不应表现出极性,因为它们不符合观察1。因此,意见词不会产生两极分化。如果这些意见只出现在当前的审查中,观察2也不能适用。为了给这样的意见词分配极性,我们利用总体的审查极性来推断。我们假设意见词具有复习的极性,即如果复习是正面的,则评价词具有正极性,反之则具有负极性。评审极性值计算为所含已知意见词的极性值之和(正极性为+1,负极性为- 1)。如果最终和大于0,则评审为正,否则为负。

注意:由于这两种观察结果,一个意见词或目标可能具有多重极性。为了解决冲突,我们将极性值相加。正极性为+1,负极性为- 1。如果和大于0,最后的极性是正的,否则是负的。

4.4 意见目标修剪(删除噪音)

删除噪音(不正确的目标和意见词),文中只给了一个去处目标噪音的方法,并没有对提取的意见进行修剪。

提出了三种删除噪音的方法。

- 基于子句的修剪

- 修剪其他产品和经销商

- 识别暗语短语和全局修剪

5.实验

数据集:Hu and Liu (2004) as the testing data

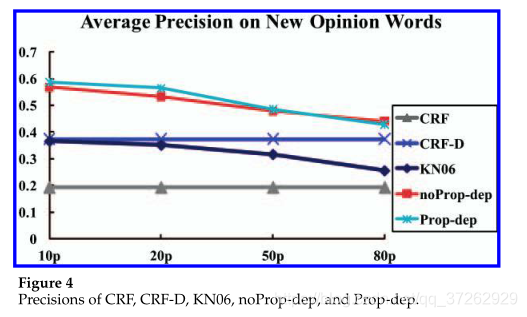

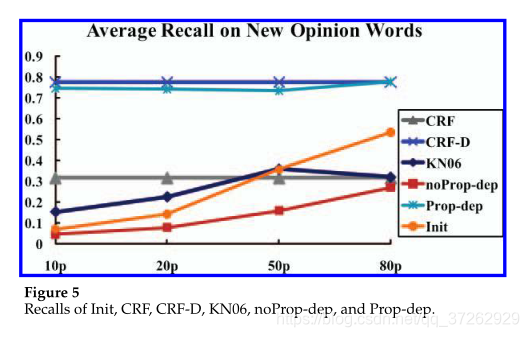

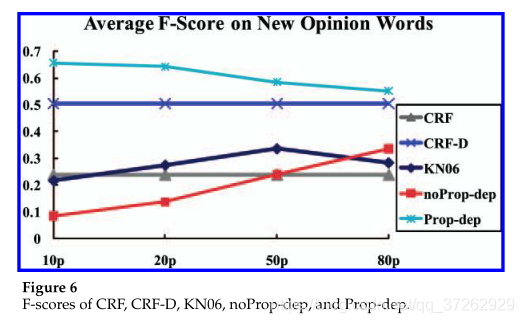

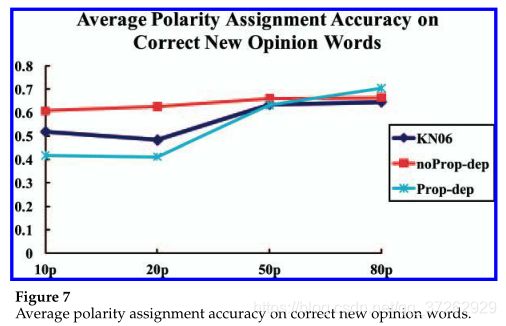

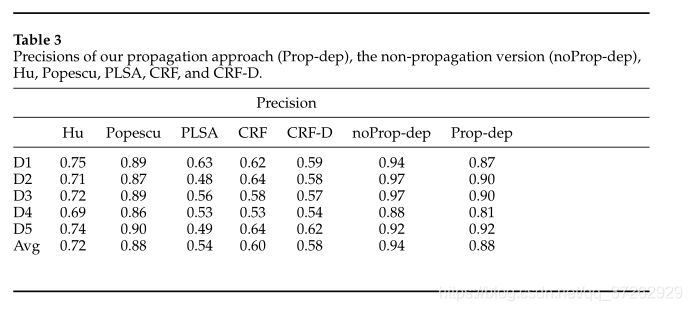

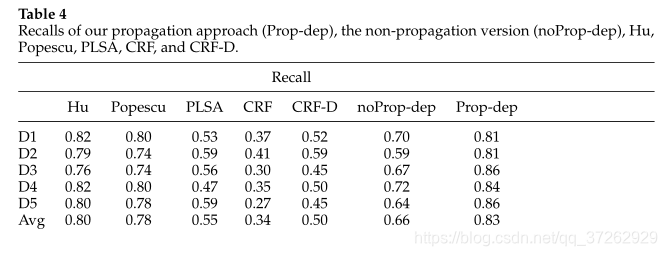

5.1观点词汇扩展的实验

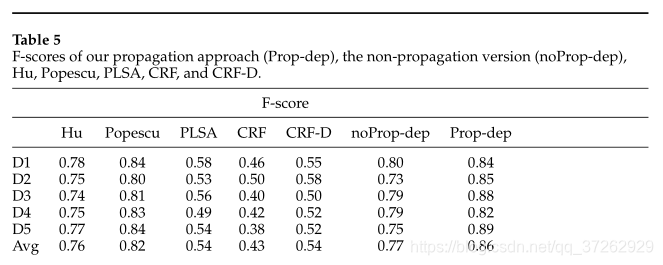

Prop-dep、noProp-dep(非传播版本)是作者提出来的方法。

5.2意见目标提取实验

6.结论

本文主要研究意见挖掘中的两个重要任务,即意见词汇的扩展和目标的提取。我们提出了一种传播方法来迭代地提取意见词和目标,只给出一个较小的种子意见词汇库。通过识别出意见词与目标之间的关系,以及意见词/目标本身的关系来进行提取。基于依赖语法对这些关系进行语法描述。提出了新的意见词极性分配和噪声目标剪枝方法。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?