好的机器人设计意味着永远不必说:“对不起,我没听懂”

本文译自:Good Bot Design Means Never Having to Say: ‘I’m sorry, I didn’t get that’

我当你和一个机器人交谈时,你肯定熟悉那一刻,你说了些什么——即使只是“你好”——只是得到回复:“对不起,我没听懂。” 这个不幸的时刻就像一个“抱歉的悬崖”:谈话从那里走下坡路。理解遗憾的悬崖是设计对话体验的关键,对话体验不仅可以提供快乐的路径,还可以提供优雅的错误处理。

谈话准则

为什么令人遗憾的悬崖式失败导致的挫败感如此强烈?一般来说,人们希望对话顺利进行。即使对话是与机器人进行的,当清晰明确的输入无法引起有用的响应时,我们也会感到特别受挫。

当机器人没有帮助时,体验与以下内容没有太大区别:

- 当您礼貌地与某人交谈但他们以不情愿或敌对的方式回应(故意不合作)时。

- 当你问一个人一个问题时,他们应该有答案但他们没有(意外地不合作)。

对对话成功的期望与社会语言学家所说的合作原则有关,哲学家兼语言学家保罗格赖斯说:“在对话发生的阶段,按照对话交流的公认目的或方向,做出你所需要的对话贡献。你订婚了。

合作原则是我们谈话方式的理想化——显然真正的谈话要混乱得多。尽管如此,在我们日常使用语言的过程中,我们仍然敏锐地意识到与这一理想的偏差:当有人偏离主题、隐瞒某事、过度分享,或者害羞、谨慎或谨慎时,我们会意识到这一点。

对于对话设计领域,一个很大的概念挑战是决定机器人应该在多大程度上反映人们通常的互动方式。许多对话设计者已经将构成合作原则的以下四个格赖斯格言重新概念化为机器人应该如何“交谈”的指南。

**1. 诚实(质量准则)

**人们倾向于说实话,因此机器人应该诚实。这不仅仅是提供准确的信息;它还延伸到机器人如何呈现自己。例如,机器人应该声明自己是机器人,而不是声称自己是人类代理。

2. 提供最佳信息 (数量的准则)

人们倾向于只说必要的,而不是在每句话中包含所有可能相关的信息。机器人应该通过识别用户话语背后的正确意图来提供最佳信息。他们应该提供足够的信息来满足用户,但又不能多到让他们不知所措。

**3.相关 (关系准则)

**人们倾向于包含与对话目标相关的信息并排除偏离主题的信息,因此机器人也应该这样做。平衡品牌与机器人功能的需求至关重要。例如,友好的玩笑可以用来表达机器人的个性,只要它不会分散用户的主要目的。

**4. 清晰 (举止准则)

**人们倾向于清晰明确,机器人也应该如此。例如,人们通常按照他们希望执行的顺序给出指令。机器人通常以用户必须回答的问题的形式给出隐式指令。这些信息搜索动作必须放在机器人回合结束时。

***机器人:我们有披萨或意大利面。你想点买(订)什么?

人类:***比萨很好吃。

在机器人的回合中颠倒句子的顺序会导致问题:

***机器人:您想点什么?

人类:让我们吃一个……[机器人打断]

机器人:我们有比萨饼或意大利面。

人类:***我知道!我想要披萨!

错误处理的反准则

像这样的文体规则在创造更自然的体验方面很有用,但并不能完全消除遗憾的悬崖。虽然机器人会按照我们的程序进行操作,但对于人类而言,蔑视或忽略对话规则与观察它们一样自然。

有一些常见的输入可能会导致未经训练的机器人出现致命错误。尽管一旦部署了机器人肯定会出现一些意外情况,但对话设计者可以针对以下三种情况进行预测和规划。下面是将 Gricean 格言重新概念化为错误处理的三个反格言。

**1. 假设人类会“做错”

**使用你的机器人的人会偏离设计建议的路径。您可以通过一些计划来控制这种偏差。

- 当用户想要主菜单时

大多数基于聊天的机器人都包含一个用户可能想要返回的主菜单。“还有什么可以帮到你的吗?” 是一种常见的机器人发起的方式,用于在流结束时实现此返回。但是,用户可能希望在流程中进行相同的转换。识别“返回菜单”和“重新开始”等符合主菜单意图的输入非常重要。不要低估视觉替代品(如可点击的持久菜单)的价值。

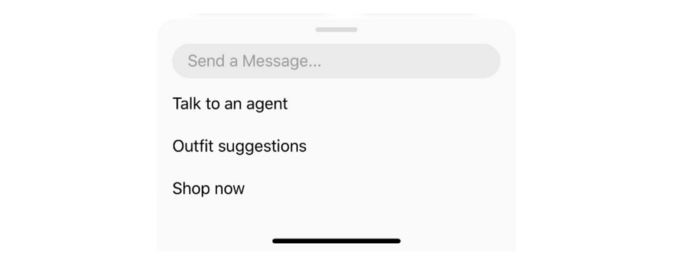

一个有用的持久菜单。资料来源:Meta 的持久菜单文档

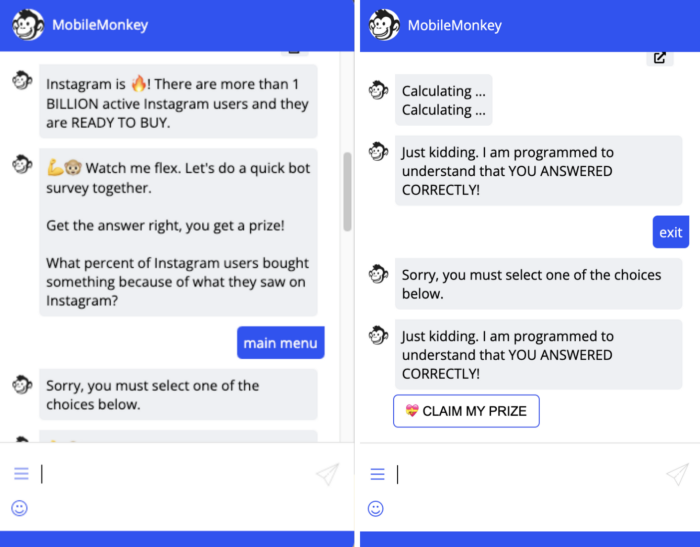

与不包含主菜单或退出意图的机器人陷入循环。资料来源:https 😕/mobilemonkey.com/blog/menu-based-chatbot

- 当用户想离开时

如果用户说“再见”或“停止”或“退出”,他们的意图很明确。通过退出 意图建立快速逃生路径很重要。试图离开的用户不想被哄骗留下来。

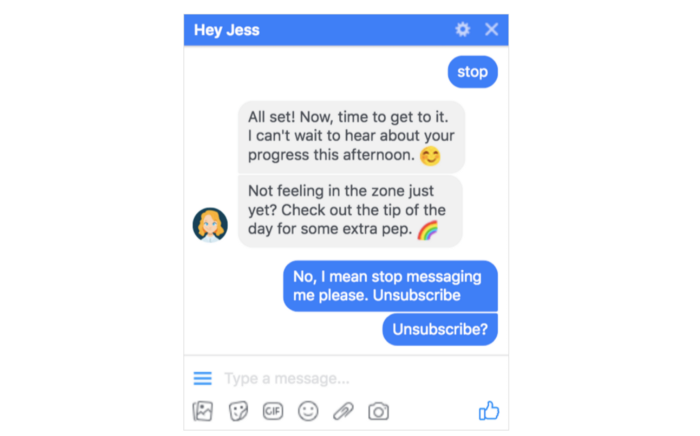

没有办法摆脱这场谈话。资料来源:https 😕/www.comm100.com/blog/chatbot-best-worst-practices.html

- 当用户需要座席时

好的设计会从同理心的角度看待试图跳过队列与人交谈的用户。在这些情况下提供解决途径很容易:建立一个代理意图来理解诸如“代理”或“将我与一个人联系起来”之类的话语。如果案件偏转是企业的高优先级,请在必须拜访人工代理之前提供中间解决路径。

**2. 假设人类将“无关紧要”

**人们经常说一些不需要甚至与机器人对话无关的话。创造性的回应可能包括:

- 人们打招呼

无论您的机器人是设计为以愉快的方式开始还是直接进入正题,考虑到问候语的多样性都是明智的。任何人都需要的最后一件事是无法超越第一回合的机器人。有一个你好 意图是很好的。 - 人们说谢谢

不相关输入的一个积极和肯定的表现是人们对他们的家庭扬声器说“谢谢”或在聊天中输入它,即使很明显他们不是在和人说话。建立感谢意图可以通过礼貌的回应取悦有礼貌的用户。 - 人们要求超出范围的事情

如果用户输入的内容确实超出了机器人的范围,那么提供解决路径的精心编写的错误消息可以改变用户体验。预测机器人/业务无法解决的高频主题会对客户服务案例转移产生实际影响。例如,如果客户想要现金退款,而机器人无法处理现金退款,最好提供优惠券或路由到不同的渠道,而不是给出一般的错误消息。大多数设计工具现在都包含添加两个错误路径的选项,这是一个很好的选择。

**3. 假设人类比机器人更聪明

**设计工具通常有恼人但不可避免的技术限制。不要忽视他们。

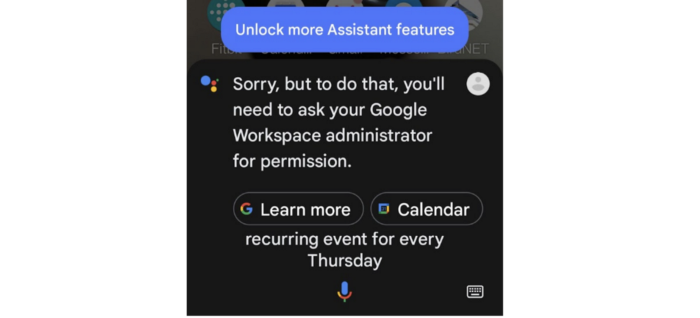

针对基于语音的尝试创建重复事件的无用 Android 错误消息。来源:我的手机。

- **当机器人不具备该功能时

**上图显示了基于语音的尝试来创建周期性日历事件。Android 错误消息“抱歉,但要这样做,您需要征得您的 Google Workspace 管理员的许可。” 错过了要点(创建事件),这可以使用日历应用程序轻松实现。更有帮助的消息将引导用户输入系统已经能够解析的输入,例如按钮,或提示打开相关应用程序。 - **当机器人有能力但不理解输入时

**在真实的短信中,人们会遵循各种高度合作的做法,比如将一条长消息分解成几条较短的消息。这避免了潜在的压力诱发状态,例如“机器人正在打字……”。对话设计者可以通过工程探索的一些问题是:

(a) 我们的机器人构建工具如何处理分解成多个部分的单个输入?

(b) 机器人响应延迟如何影响用户体验?

在基于语音的体验中,回溯是相似的:“沙滩玩具,嗯,我是说海滩男孩。” 最好有一个策略来防止 sorry cliff 中断输入。

“对不起”,就像机器人对话中的任何其他元素一样,必须经过有意义的设计,而不是对所有错误的后备响应。在您的对话设计过程中,花一些时间思考您的用户可能如何与您的机器人交互。我希望这篇简短的指南可以帮助您设计自己的方法来预测对话失败并避免可怕的遗憾悬崖。

文章探讨了良好机器人设计的关键,强调避免“抱歉的悬崖”,即当机器人无法理解用户时导致的沟通障碍。通过应用合作原则的四个准则(诚实、最佳信息、相关和清晰),设计者可以改进机器人的交互体验。同时,文章提出了错误处理的反准则,包括预期用户的偏离、不相关输入和人类的智慧,以更聪明地处理异常情况,提升用户满意度。

文章探讨了良好机器人设计的关键,强调避免“抱歉的悬崖”,即当机器人无法理解用户时导致的沟通障碍。通过应用合作原则的四个准则(诚实、最佳信息、相关和清晰),设计者可以改进机器人的交互体验。同时,文章提出了错误处理的反准则,包括预期用户的偏离、不相关输入和人类的智慧,以更聪明地处理异常情况,提升用户满意度。

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?