这是天池该比赛链接:

http://fashionai.alibaba.com/?spm=a2c41.aliyun_email.0.0#home

1. 比赛任务描述:(以下图片部分参考Top4 @_@队)

在这次比赛中有24个服装关键点,以下五种类别的服饰,因此不是每张图中出现24个关键点。

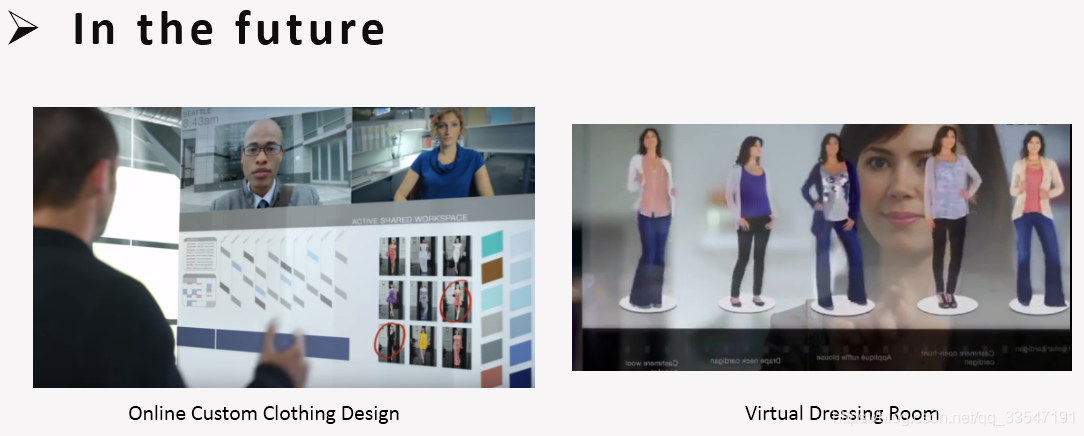

2. 未来应用场景:服饰关键点检测,在未来可能应用的场景:在线定制服装设计和虚拟试衣间。

关键点检测是计算机视觉中的一个普遍问题,我们在其中检测物体的位置和方向。 这通常意味着检测描述对象的关键点位置。

3.目前相关的研究方向:人体姿态检测、人脸面部关键点定位

数据的格式是图像和标签分开的,总结服装关键点检测和人脸,人体关键点检测类似。

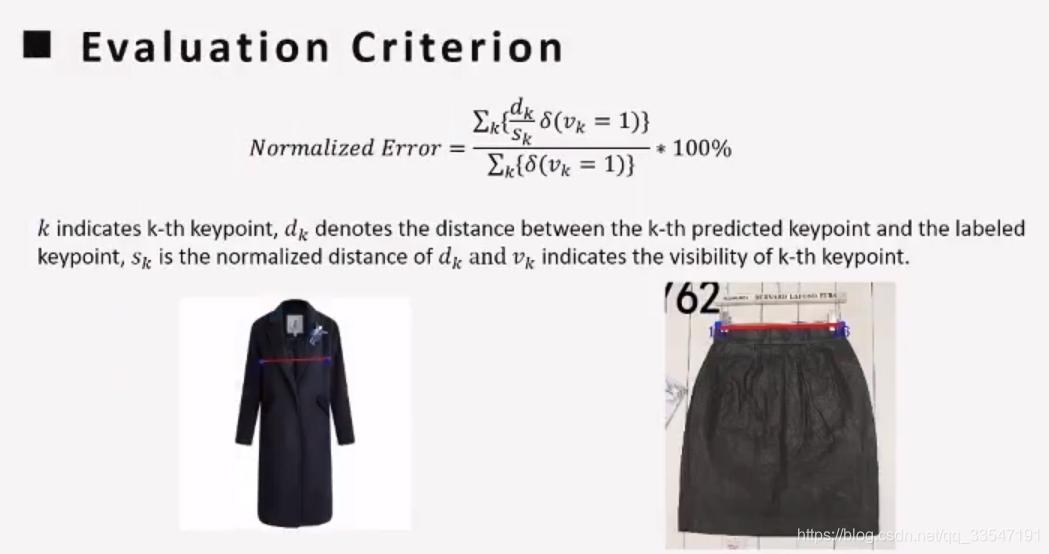

4. 性能评价指标:通过预测点和真实关键的距离计算。因为不同服饰之间的不同,通过腋窝点和腰点的距离做归一化。

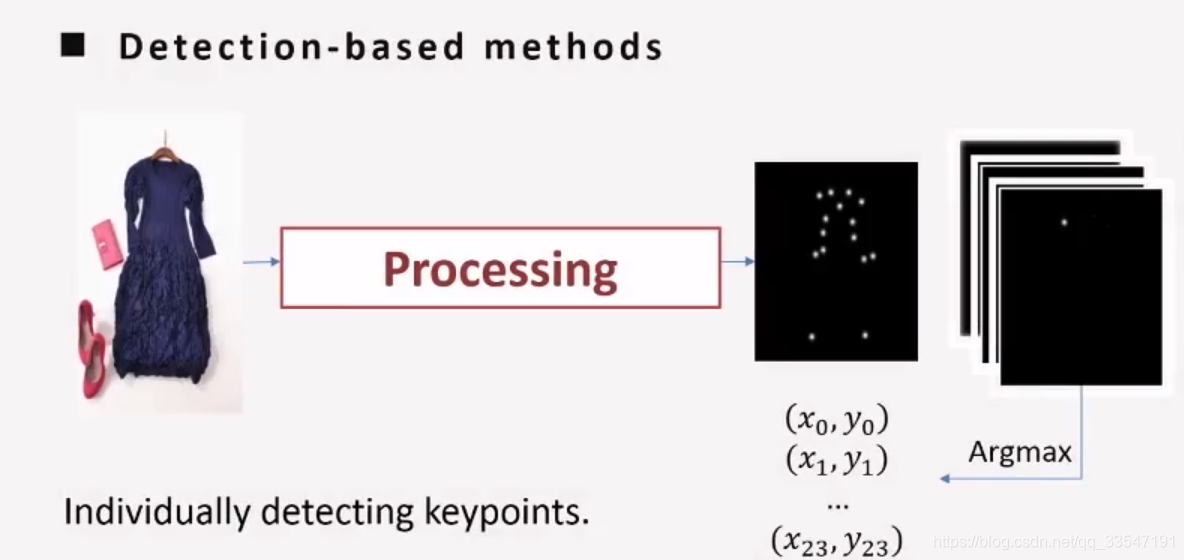

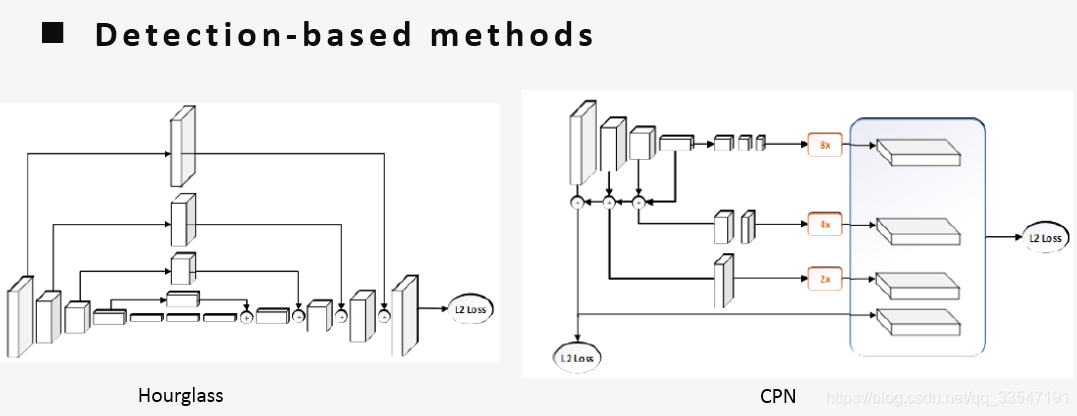

5.基本方法: 关键点检测目前主要有两种方法:(基于目标检测的方法和基于回归的方法)

Detection-based methods

通过生成独立的热度图,经过argmax得到关键点坐标。

Regression-based methods.

而基于目标检测的方法主要采用两种网络:CPN和Houglass,比赛中大部分队伍采用的CPN或者CPN融合Hourglass结构。

人脸关键点检测比赛:

https://www.kaggle.com/c/facial-keypoints-detection/data?login=true

我们的方案:

Github code:https://github.com/HqWei/FashionAI_keypoint_detection

方法介绍:

我们的网络整体结构是CPN,把CPN用了两次,第一个stage使用CPN网络1提取粗略关键点,第二个stage在stage1的提取的关键点基础上得到大致目标区域,然后再用CPN网络2提取细致的关键点。

换句话说,stage1功能是目标检测,stage2功能是进行关键点定位。我们相当于用CPN做了目标检测,正常思路应该是使用Faster-RCNN等目标检测网络进行目标检测,提取目标区域再进行关键点定位。

只采用一次CPN结果再6%左右,也就是使用globalnet+refinenet的结构。使用第一次提取关键点,再进行一次精细关键点定位能提升到4.5%。

实现细节:

数据增强方法:旋转,scale,并只对可见点的误差进行回传,比赛的评价标准中不对不可见点进行计算。

测试增强:进行翻转,scale取平均

在热度图中使用高斯滤波、向次高点偏移

图像大小从384增大到512能提升0.3个点。

本文介绍了一种服饰关键点检测技术,包括24个服装关键点的检测方法,应用于在线定制服装设计和虚拟试衣间。文章详细介绍了使用的CPN网络结构,通过两个阶段的检测与定位提高精度。

本文介绍了一种服饰关键点检测技术,包括24个服装关键点的检测方法,应用于在线定制服装设计和虚拟试衣间。文章详细介绍了使用的CPN网络结构,通过两个阶段的检测与定位提高精度。

1202

1202