Maven管理项目在JavaEE普遍使用,开发Spark项目也不例外,而Scala语言开发Spark项目的首选。因此需要构建Maven-Scala项目来开发Spark项目,本文采用的工具是IntelliJ IDEA 2018,IDEA工具越来越被大家认可,开发java, python ,scala 支持都非常好

下载链接 : https://www.jetbrains.com/idea/download/ 安装直接下一步即可

安装scala插件,File->Settings->Editor->Plugins,搜索scala即可安装

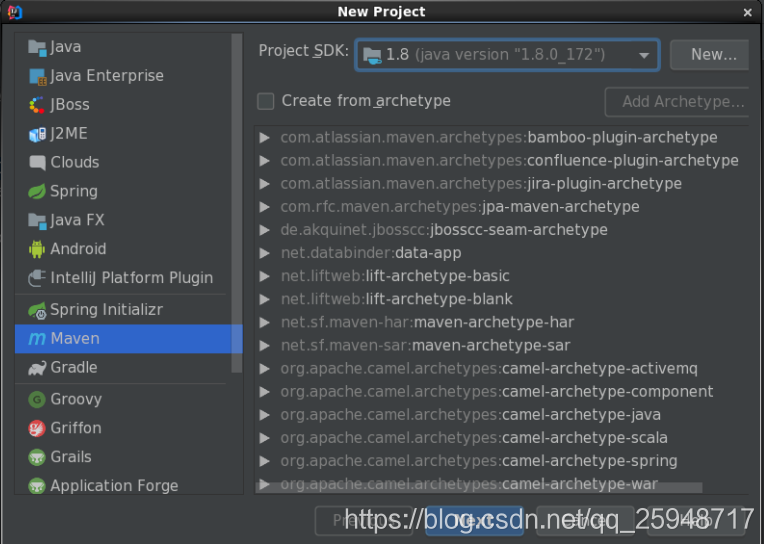

创建Maven工程,File->New Project->Maven 选择相应的JDK版本,直接下一步

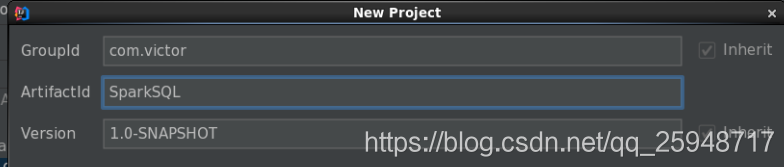

设定Maven项目的GroupId及ArifactId

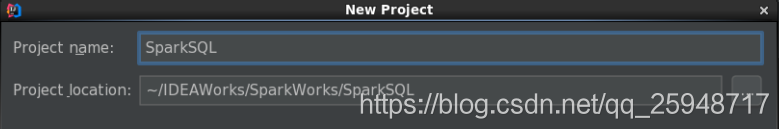

创建项目的工程名称,点击完成即可

创建Maven工程完毕,默认是Java的,没关系后面我们再添加scala与spark的依赖

修改Maven项目的pom.xml文件,增加scala与spark的依赖

<?xml version="1.0" encoding="UTF-8"?>

<project xmlns="http://maven.apache.org/POM/4.0.0"

xmlns:xsi="http://www.w3.org/2001/XMLSchema-instance"

xsi:schemaLocation="http://maven.apache.org/POM/4.0.0 http://maven.apache.org/xsd/maven-4.0.0.xsd">

<modelVersion>4.0.0</modelVersion>

<groupId>com.victor</groupId>

<artifactId>SparkSQL</artifactId>

<version>1.0-SNAPSHOT</version>

<properties>

<project.build.sourceEncoding>UTF-8</project.build.sourceEncoding>

<spark.version>2.3.0</spark.version>

<scala.version>2.11</scala.version>

<hadoop.version>2.9.1</hadoop.version>

</properties>

<dependencies>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-core_${scala.version}</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-sql_${scala.version}</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-hive_${scala.version}</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-streaming_${scala.version}</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>org.apache.hadoop</groupId>

<artifactId>hadoop-client</artifactId>

<version>2.9.1</version>

</dependency>

<dependency>

<groupId>org.apache.spark</groupId>

<artifactId>spark-mllib_${scala.version}</artifactId>

<version>${spark.version}</version>

</dependency>

<dependency>

<groupId>mysql</groupId>

<artifactId>mysql-connector-java</artifactId>

<version>5.7</version>

</dependency>

<dependency>

<groupId>junit</groupId>

<artifactId>junit</artifactId>

<version>4.12</version>

</dependency>

</dependencies>

<repositories>

<repository>

<id>central</id>

<name>Maven Repository Switchboard</name>

<layout>default</layout>

<url>http://repo2.maven.org/maven2</url>

<snapshots>

<enabled>false</enabled>

</snapshots>

</repository>

</repositories>

<build>

<sourceDirectory>src/main/scala</sourceDirectory>

<testSourceDirectory>src/test/scala</testSourceDirectory>

<plugins>

<plugin>

<groupId>org.apache.maven.plugins</groupId>

<artifactId>maven-compiler-plugin</artifactId>

<version>3.5</version>

<configuration>

<source>1.8</source>

<target>1.8</target>

<encoding>UTF-8</encoding>

</configuration>

</plugin>

</plugins>

</build>

</project>

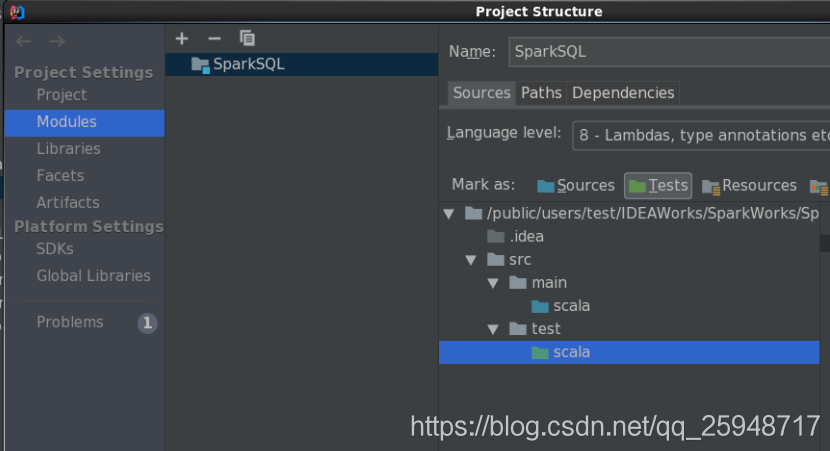

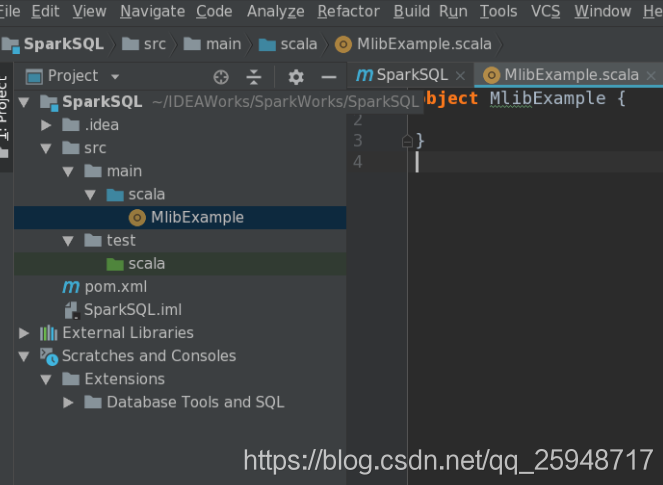

删除项目的java目录等,新建scala并设置源文件夹

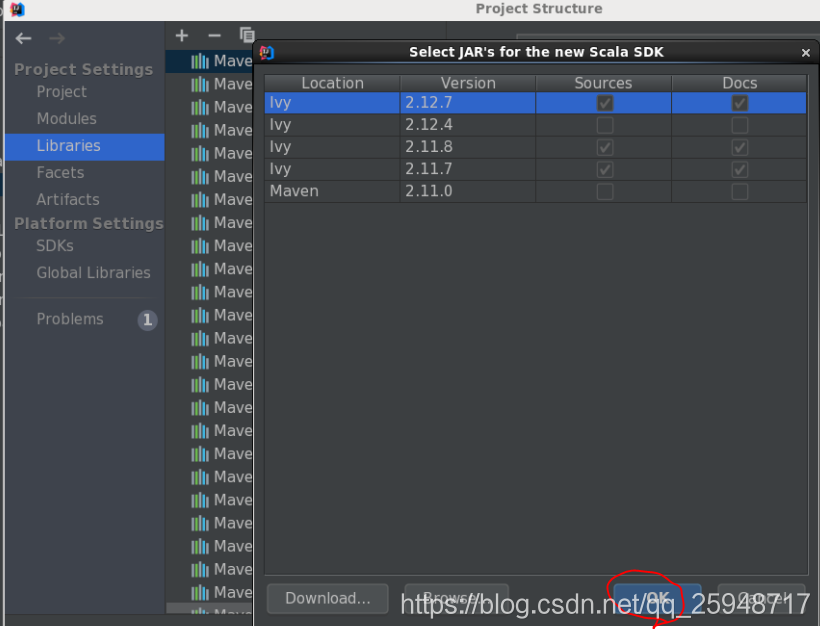

添加scala的SDK

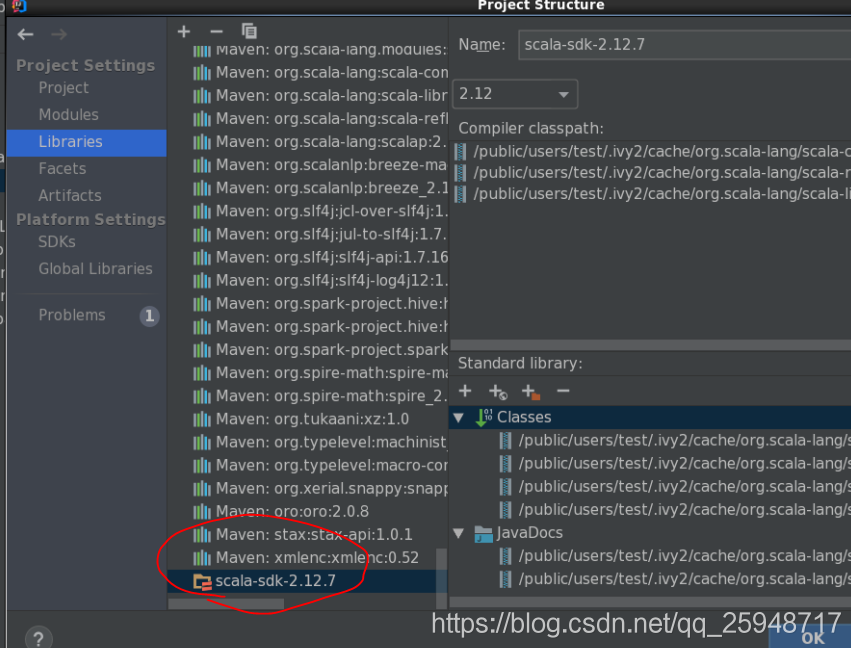

添加scala的SDK成功

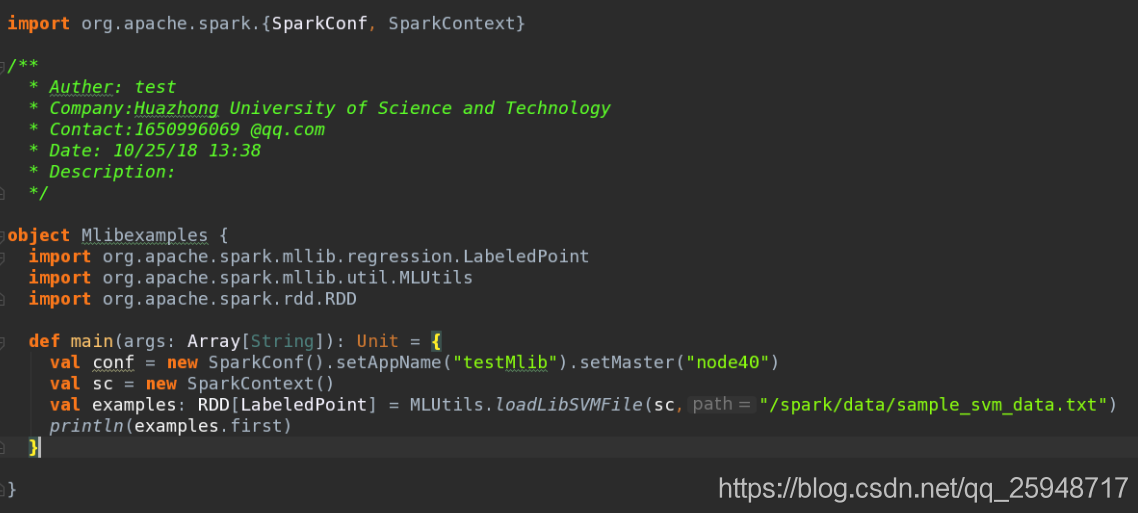

开发Spark实例

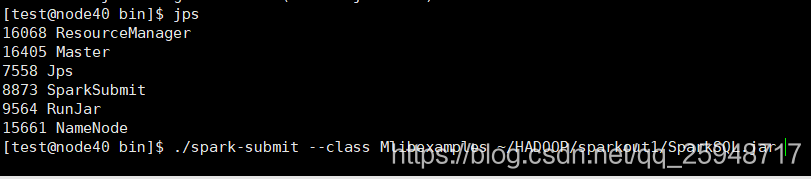

注意这里的路径指HDFS下的。

测试通过

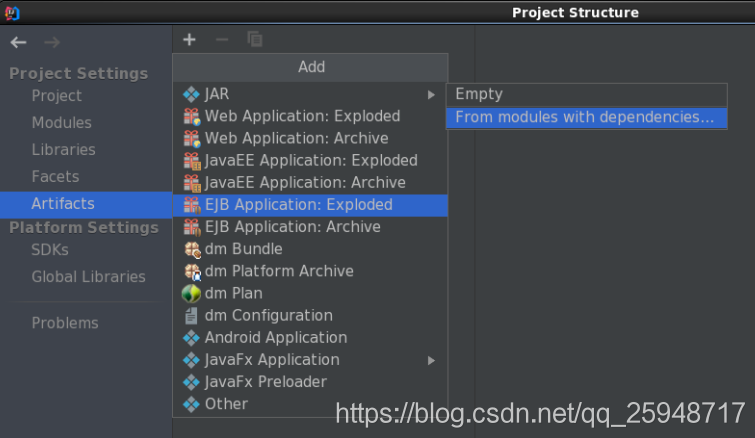

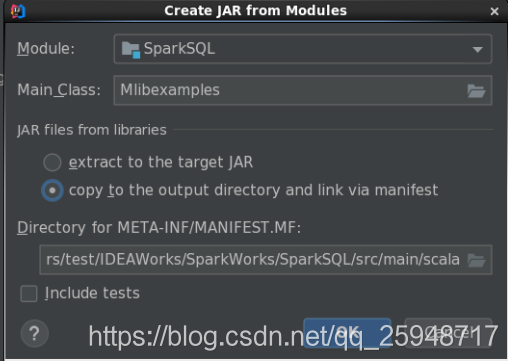

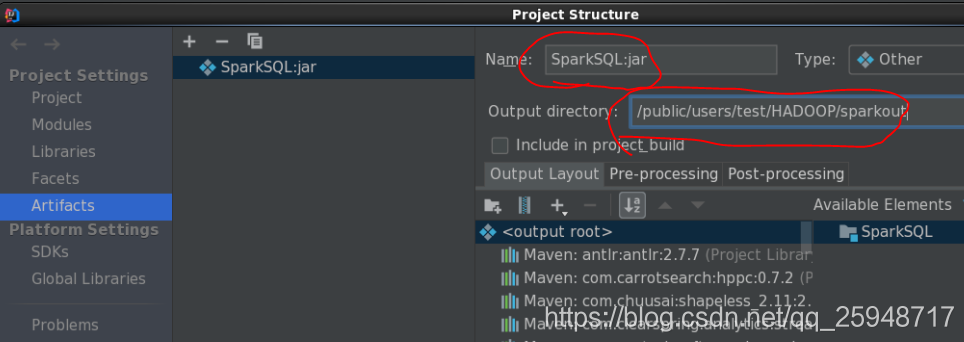

打包编译

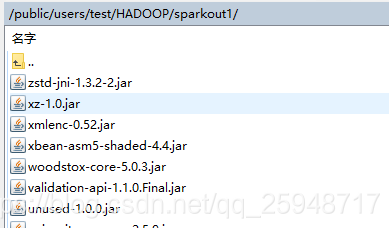

导出:

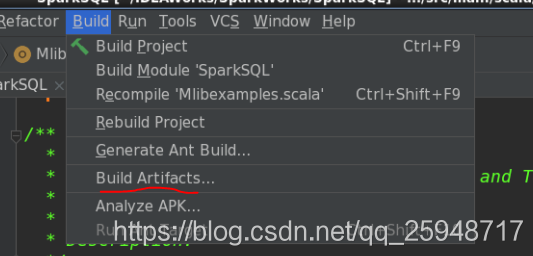

再编译:

本文介绍如何在IntelliJ IDEA中使用Maven构建Scala Spark项目,包括安装配置、添加依赖、设置源文件夹及开发测试过程。

本文介绍如何在IntelliJ IDEA中使用Maven构建Scala Spark项目,包括安装配置、添加依赖、设置源文件夹及开发测试过程。

4782

4782

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?