利用业余时间写一下自己看书的感受,就当作随笔把,这样也能帮助自己记忆,同时关于kaldi的章节我选择先停一停,我感觉把这个问题理解透再去查看kaldi可能会事半功倍。我选取的章节来源于"The Application of Hidden Markov Models in Speech Recognition",英文版的,有兴趣的可以去看看。废话不多说,我们直接进入主题。

下图显示了大型连续语音词汇识别的主要部分:

说实话看这图要不是我会语音增强的部分知识的话,我会认为很简单,的确,图看上去确实很简单,不过任何一个细节拿出来都足以让我们翻阅无数资料。如图,输入的波形(语音)被转化固定长度的语音响亮序列:

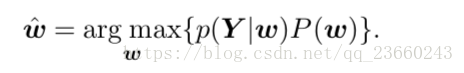

这个过程称之为特征提取,也就是著名的Feature Extraction(不要看到公式就害怕,就是有序的向量的排列)。那么解码器(Decoder)就会尝试去寻找最可能产生如上Y的字:w1:L=w1,....wL 的序列,假如decoder尝试寻找

(PS:哇,看到这里我突然想到了为什么要训练模型了)。然而,由于P(w|Y)直接建模是十分困难的,我们对上述式子使用贝叶斯准则就会得到如下的相等式子:

这里其实有朋友会像我刚开始一样迷惑:这TM是瞎说呀,当我们不会贝叶斯准则吗,朋友

本文介绍了基于HMM的语音识别原理,探讨了声学模型和语言模型在解码器中的作用,以及如何通过N-gram模型估计参数。解码器通过搜索找到最可能的词序列,实现语音到文本的转换。

本文介绍了基于HMM的语音识别原理,探讨了声学模型和语言模型在解码器中的作用,以及如何通过N-gram模型估计参数。解码器通过搜索找到最可能的词序列,实现语音到文本的转换。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

1630

1630