一、本地知识库对比

为了进行一个清晰的横向对比,我们将从多个维度对MaxKB、AnythingLLM、Dify、FastGPT和Ragflow这些工具或平台进行比较。以下是基于现有信息整理的一个对比表格:

| 特性/平台 | MaxKB | AnythingLLM | Dify | FastGPT | Ragflow |

| 主要用途 | 知识库管理与检索 | 大规模语言模型的应用开发 | AI应用快速开发与部署 | 快速构建和部署GPT模型 | 基于检索增强生成(RAG)的工作流 |

| 支持的模型 | 自定义 | 支持多种开源及私有LLMs | 主要支持轻量级本地运行的模型 | GPT系列模型 | 支持通过API集成的各种模型 |

| 硬件要求 | 适中,根据模型大小变化 | 高,特别是对于大型模型 | 较低,优化用于本地部署 | 根据模型大小变化,可能较高 | 中等到高,取决于使用的模型 |

| 用户友好度 | 提供图形界面(GUI),易于使用 | 对开发者友好,但需要一定的技术背景 | 提供CLI和API接口,相对易用 | 提供简化工具,适合快速原型设计 | 需要一定的配置和技术知识 |

| 集成能力 | 可以与其他系统集成 | 强大的集成能力,支持多环境 | 良好的集成能力 | 专注于GPT模型的快速集成 | 强调与外部数据源和模型的集成 |

| 扩展性 | 支持扩展,但有限 | 高度可扩展 | 具有一定的扩展性 | 适用于快速扩展的小型到中型项目 | 设计为高度可扩展 |

| 适用场景 | 知识管理、文档检索 | 复杂的语言处理任务,如对话系统 | 快速开发AI应用,适合初创公司和个人开发者 | 快速原型设计和小型项目的GPT模型部署 | 需要深度文本理解和检索的场景 |

| 社区和支持 | 社区较小,官方支持有限 | 活跃的开源社区 | 新兴平台,社区正在增长 | 相关资源丰富,尤其是关于GPT的内容 | 开源项目,有一定活跃度 |

二、环境准备:

docker环境准备、ollama环境准备,部署好本地deepseek-r1

参考:DeepSeek R1本地化部署及应用_deepseek-r1 能否将计算数值传递给别的本地应用-优快云博客

三、安装Dify

Dify介绍:可参考官网文档欢迎使用 Dify | Dify

获取项目安装包:https://github.com/langgenius/dify

git clone https://github.com/langgenius/dify.git修改配置环境变量,环境变量参数客参考:环境变量说明 | Dify

cd dify/docker

cp .env.example .env

vim .env安装运行Dify

#版本是 Docker Compose V2,使用以下命令

docker compose up -d

#更新Dify,进入 dify 源代码的 docker 目录,按顺序执行以下命令:

cd dify/docker

docker compose down

git pull origin main

docker compose pull

docker compose up -d注意:

-

如果

.env.example文件有更新,请务必同步修改你本地的.env文件。 - 检查

.env文件中的所有配置项,确保它们与你的实际运行环境相匹配。你可能需要将.env.example中的新变量添加到.env文件中,并更新已更改的任何值。

四、访问 Dify,关联本地deepseek-r1

你可以先前往管理员初始化页面设置设置管理员账户:

登录地址:http://主机ip/install

将本地deepseek-r1模型和Dify关联

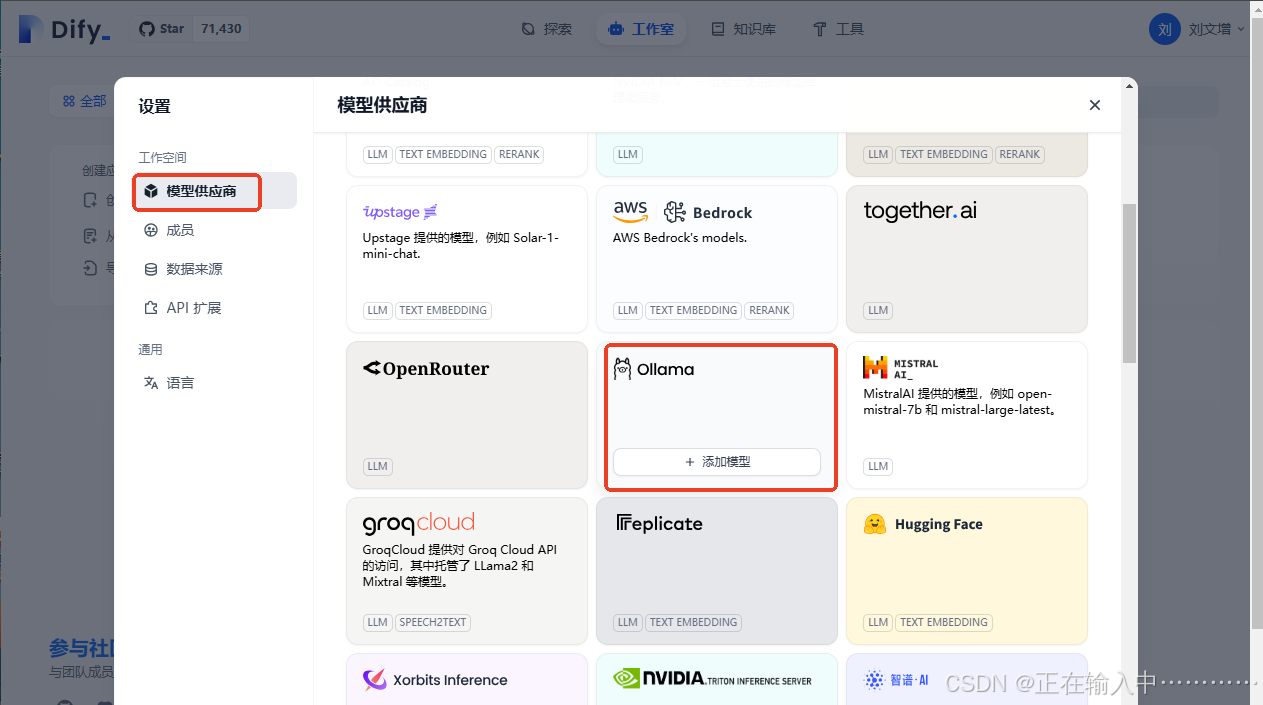

登录后,点击用户→设置→模型供应商→选择ollama,添加模型

五、使用Ollama安装文本嵌入模型

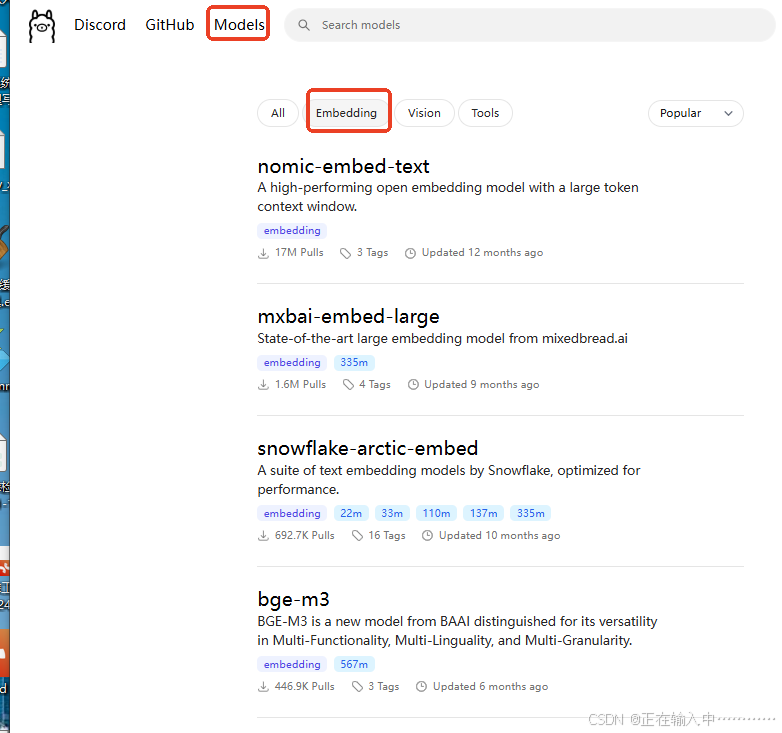

打开Ollama官网:Ollama,点击上方的Models,选择Embedding

| 模型名称 | 性能特点(检索准确率等) | 训练速度 | 推理速度 | 最低内存需求 | 推荐内存需求 | GPU支持 | 其他要求(如存储空间) |

| nomic-embed-text | 高精度检索,适合简短问题 | 中等 | 中等 | 8GB | 16GB+ | 支持 | 存储空间取决于模型大小,通常需要几GB到几十GB不等 |

| mxbai-embed-large | 快速处理大规模数据 | 快 | 快 | 8GB | 16GB+ | 支持 | 需要至少8GB内存,但推荐更多以处理大规模数据集 5 |

| snowflake-arctic-embed | 实用且平衡的选择 | 中等到快 | 中等到快 | 4GB | 8GB+ | 可选 | 依赖于具体应用场景,但通常需要足够的磁盘空间来存储训练数据 |

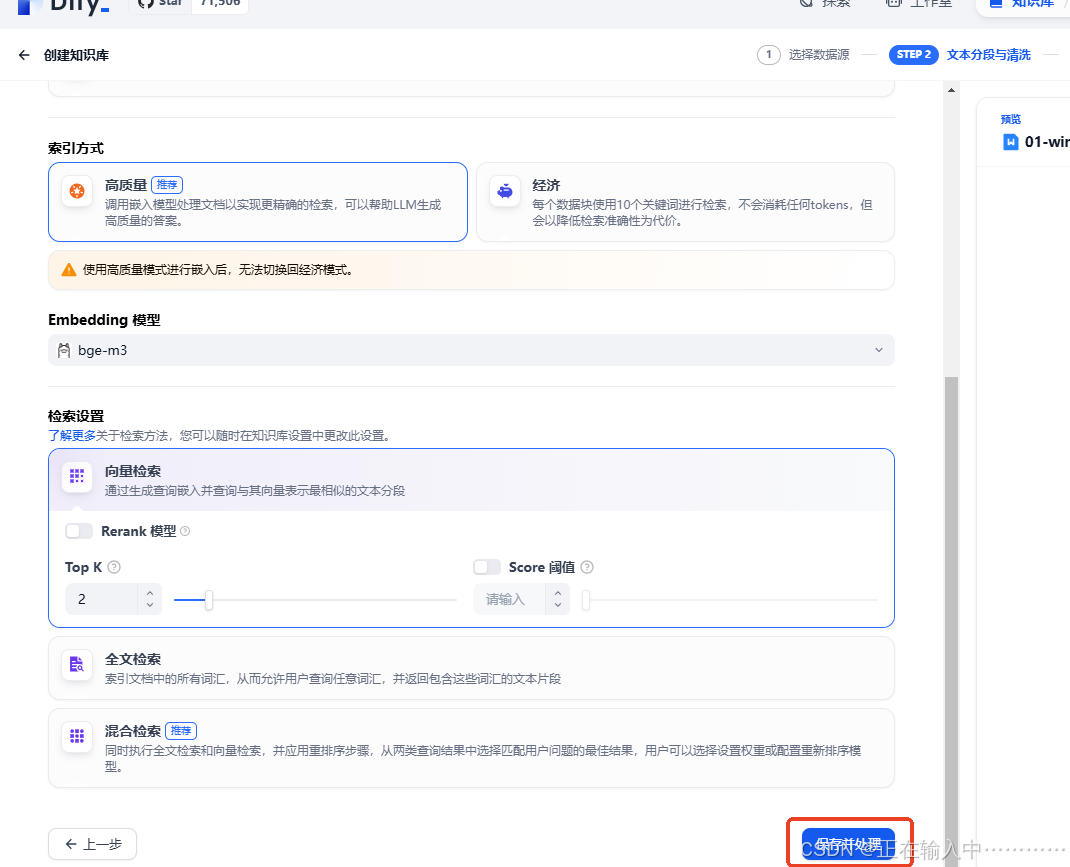

根据自己的硬件配置选择一个合适的模型,这里我选择bge-m3来做演示。

14:36 root@deepseek:~

$ollama pull bge-m3

pulling manifest

pulling daec91ffb5dd... 100% ????????????????????????????????????????????????????????????????????????????????????????????????????

pulling a406579cd136... 100% ????????????????????????????????????????????????????????????????????????????????????????????????????

pulling 0c4c9c2a325f... 100% ????????????????????????????????????????????????????????????????????????????????????????????????????

verifying sha256 digest

writing manifest

success

14:39 root@deepseek:~

$六、Dify中添加文本嵌入模型

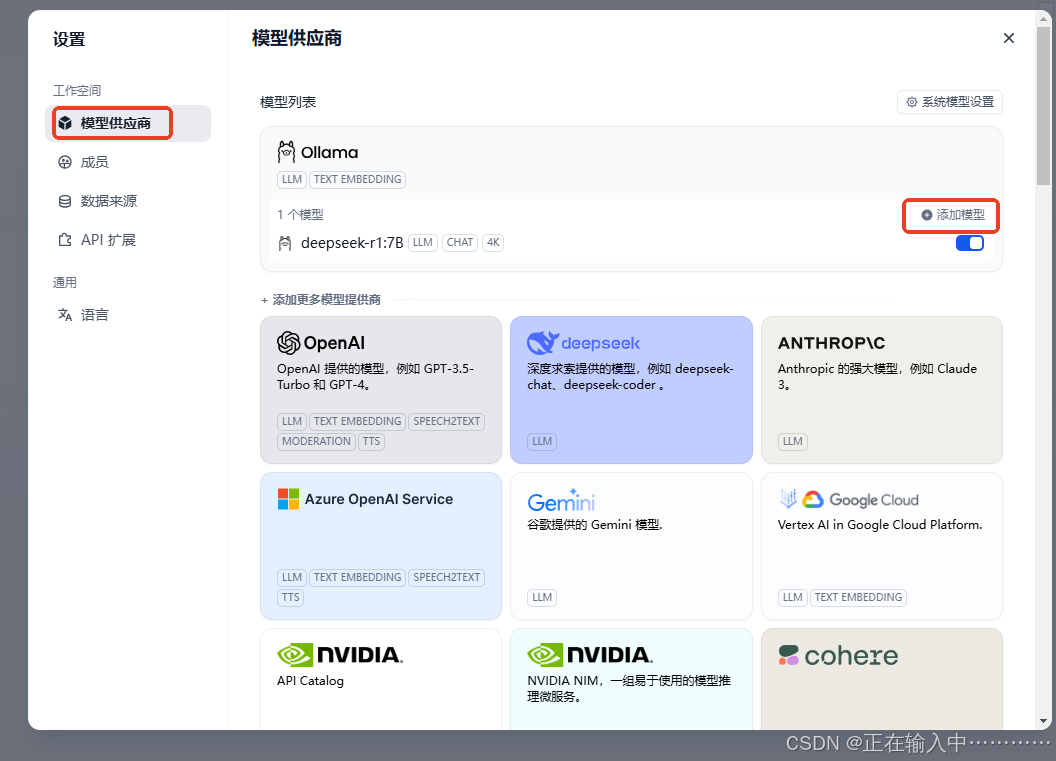

在Dify控制台点击头像,在弹出菜单中选择设置→模型供应商→选择ollama,添加模型

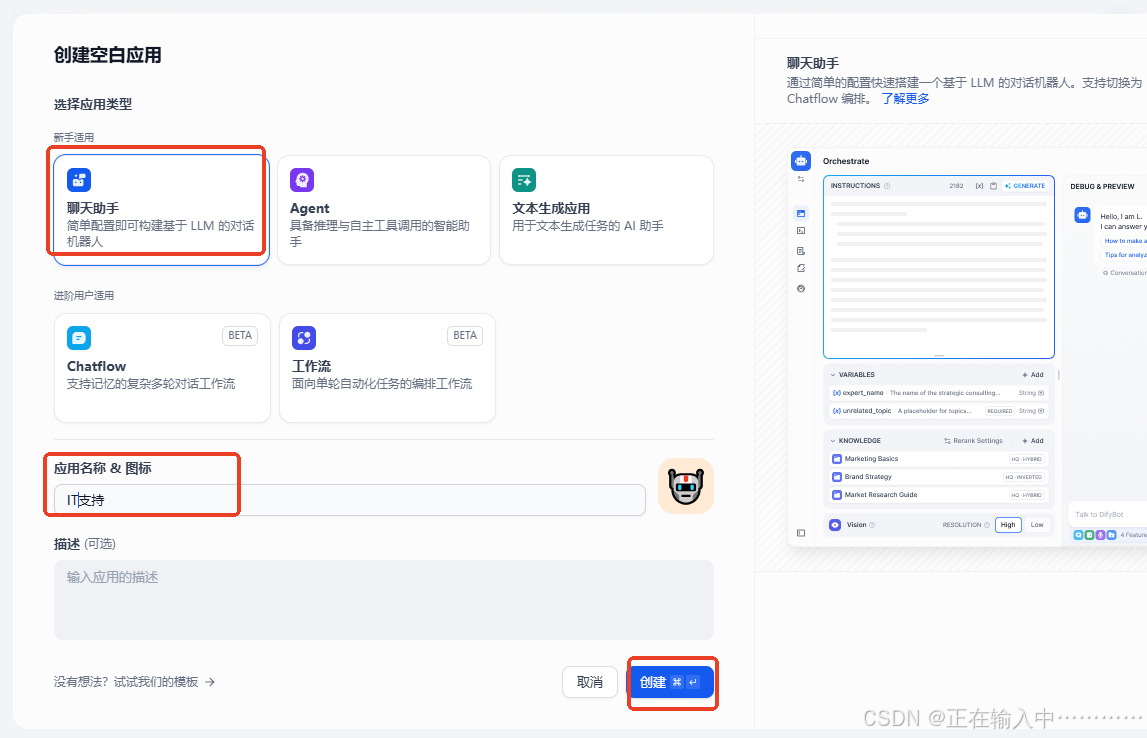

Dify中创建聊天应用

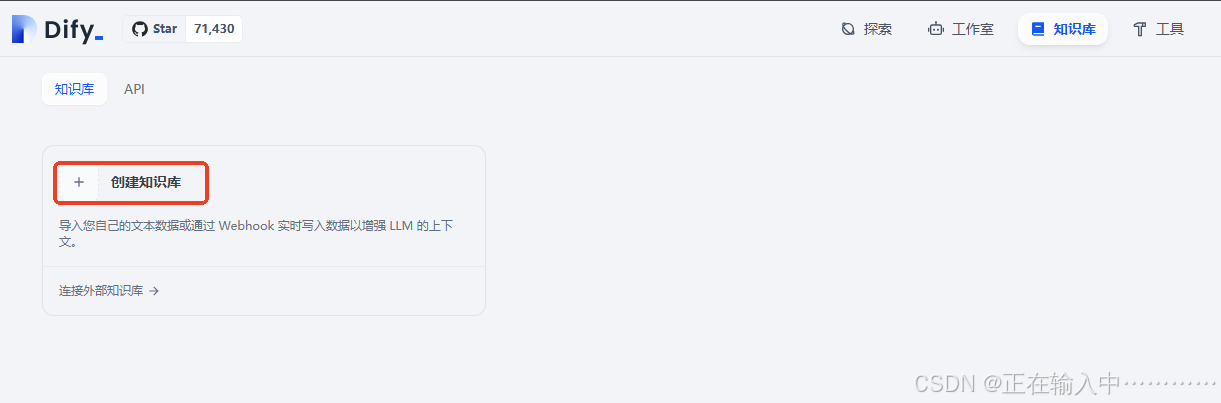

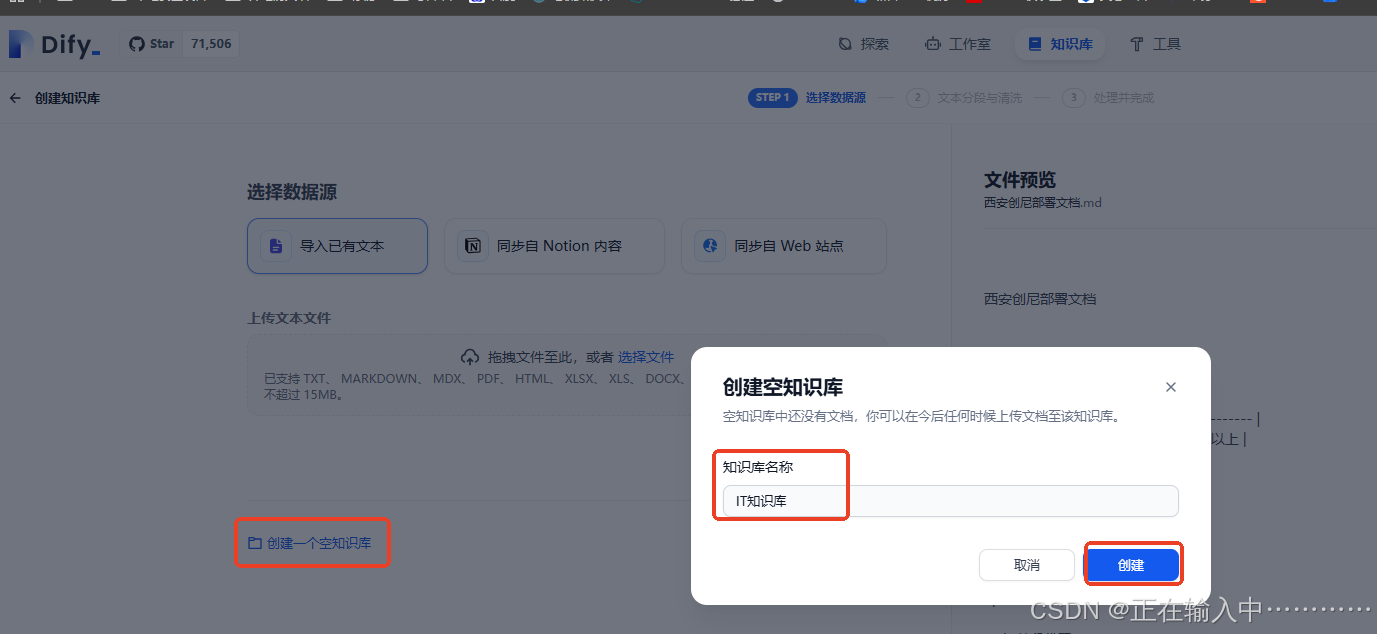

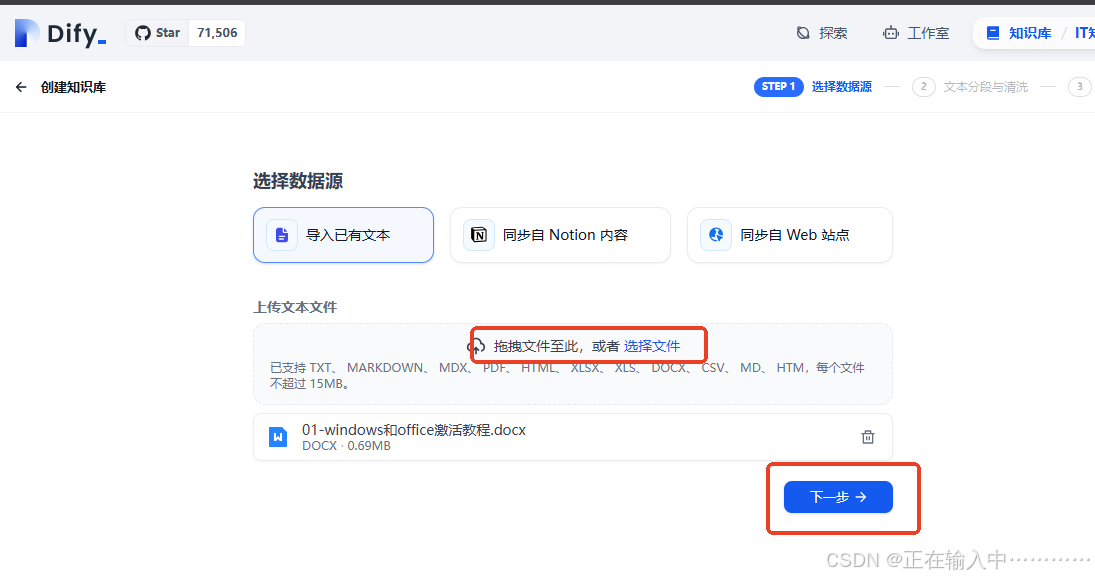

创建知识库,上传文档

为应用添加上下文,并测试知识库

参考资料:

-

Ollama官方文档: https://www.ollama.com/docs

-

DeepSeek官网:DeepSeek

-

Dify官网:Dify.AI · 生成式 AI 应用创新引擎

-

Dify官方文档:欢迎使用 Dify | Dify

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?