如何评估LLM在开放性问题的回答能力

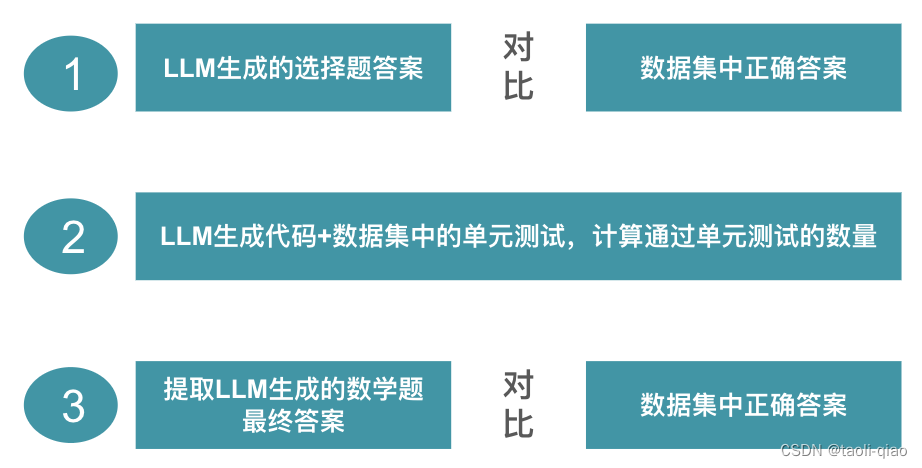

前面三篇博客中介绍了如何评估大模型,内容包括评估大模型时常用的指标,每个指标背后的含义,如何通过编写代码实现指标的收集。对于pass@k指标,还进行了专门的说明。在前面的博客中,我们提到,对于数据集大致可以分为三类,选择题,数学题,代码生成题,对于这三类数据集,在收集指标时,实现过程都有所不同,具体如下图所示。

可以看到,上面的数据集都找到了一种方式来评估LLM生成的内容是否正确,那么,如果是针对开放性问题,如何评估LLM的能力呢?比如让LLM写一篇优美的作文,写一封措辞友好的email等。这类问题,无法通过选择题来做标准数据集,在实际应用中,很多下游任务往往是这种更贴近人类的开放性问题任务,他不会是做一个选择题或者数学题。对于这类任务,如何有效的评估LLM的能力呢?本篇博客提到的MT-Bench评估方法就是解决该类问题的。

如何实现MT-Bench评估

MT-Bench采用的数据集

首先来看看MT-Bench评估所采用的数据集,如下图所示,可以看到MT-Bench方法采用的数据集包含了写作、角色扮演、推理、数学、编码、人文、提取、STEM(科学(Science),技术(Technology),工程(Engineering),数学(Ma

本文探讨了如何评估大模型在处理开放性问题上的表现,如写作和对话,介绍了MT-Bench的方法,使用GPT4进行评分。同时指出了评估方法的局限性,如位置偏见和自我增强偏见。尽管有局限,MT-Bench的思路仍具有价值,可用于扩展至更多领域和模型评估。

本文探讨了如何评估大模型在处理开放性问题上的表现,如写作和对话,介绍了MT-Bench的方法,使用GPT4进行评分。同时指出了评估方法的局限性,如位置偏见和自我增强偏见。尽管有局限,MT-Bench的思路仍具有价值,可用于扩展至更多领域和模型评估。

最低0.47元/天 解锁文章

最低0.47元/天 解锁文章

969

969

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?