针对任意空间分辨率和曝光次数的静态图像序列,本文介绍一种快速多曝光图像融合(MEF)方法,即MEF-Net。与传统的MEF方法不同,MEF-Net通过在全分辨率训练序列数据库上优化感知校准MEF结构相似性(MEF-SSIM)索引来进行端到端训练。

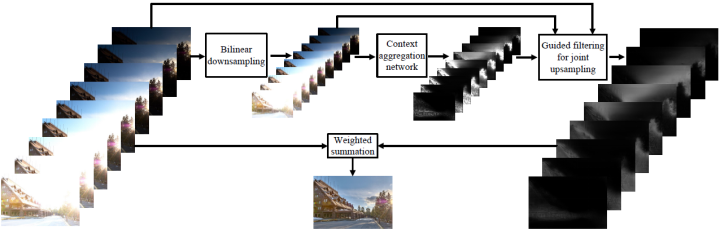

如下图所示,MEF-Net由双线性下采样器、CAN、引导滤波器和加权融合模块所组成。首先输入序列下采样,向CAN提供低分辨率序列来预测低分辨率权重图。将CAN、低分辨率序列和低分辨率权重图共同作为输入,通过引导滤波器得到高分辨率权重图,该操作在计算机视觉中也称为联合上采样。最后,使用加权融合得到最终图像。

MEF-Net的核心模块是一个卷积网络(CAN),它将低分辨率的输入序列转换为相应的权值图。该网络必须允许任意空间大小和曝光数的输入序列,并产生相应大小和数量的权值图。为此,使用全卷积网络来处理所有的曝光(即不同曝光的图像共享相同的权重生成网络),这可以通过batch维度分配输入序列来高效实现。CAN的主要优点是它在不牺牲空间分辨率的前提下具有较大的接收场,它在更深层次上逐渐聚合上下文信息,完成全局图像统计的计算,从而更好地进行图像建模。

如下图所示,我们对连拍得到的两张指示灯图片基于MEFNet算法进行融合,测试结果为:

连拍图像:

融合结果图:

MEFNet在广泛的内容和亮度变化范围内产生了高质量的融合图像,减少了曝光失调和细节丢失,并兼顾了灵活性和实时性,该算法为进一步提升指示灯识别率奠定了基础。

598

598

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?