一、TensorFlow介绍。

TensorFlow 是由Google推出的世界上最受欢迎的开源机器学习框架,它能够灵活适用于各类应用,能够让所有开发者和研究者

都能使用人工智能来解决多样化的挑战。

顾名思义,Tensor的意思是张量,代表N维数组;Flow的意思是流,代表基于数据流图的计算。TensorFlow把N维数字从数据流

图的一端流动到另一端的过程,就是人工智能进行分析和处理的过程。

随着Android系统移动软件开发的广泛应用,Google 推出开源的TensorFlow,希望能够将AI结合到Android开发中,引领未来的人

工智能趋势。

TensorFlow作为一个深度学习框架,支持Linux、Windows、Mac、以及移动端的Android平台。TensorFlow提供了丰富的深度学

习相关API,包括基本的向量矩阵计算、各种优化算法、各种卷积神经网络和循环神经网络基本单元的实现、以及可视化的辅助

工具。正因为TensorFlow 具有如此便捷和强大的功能,在短短几年的时间内,已经在各领域有了广泛的应用。

目前TensorFlow 已经在Nvidia、Google、Intel、Ebay、京东、网易、新浪、联想等世界知名IT企业所广泛应用。

二、TensorFlow的工作流程

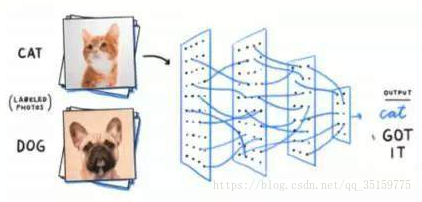

图片来源网络

假设要判断一张图片里面动物是猫还是狗。以传统的编程方法要实现这样的识别是非常困难的。因为要判断动物,需要识别它的

品种、身形、颜色各种特征。

图片来源网络

利用TensorFlow,可以构建一个模拟人脑神经元的神经网络。这些神经元以层为集合单位,从输入的图片到判断的输出关联起

来。经过浏览大量猫狗的图片的训练,进行预测。一开始,所有这些神经元都被随机地初始化,完全凭猜。

之后计算猜测与正确结果的误差。然后使用误差,来调整神经元之间的连接强度。经过反复的训练以及调整无法后,基本就可以

实现对猫狗的正确识别。

因此只需要用户给出一张图片,即使模型从未见过这张图,也能够正确判断中图中的是猫还是狗。

TensorFlow能够在大型神经网络中表现地如此高效的原因是它能把代码转换成操作图,对操作图进行操作和分析。

三、安装与使用。

1、TensorFlow 安装。

见博文 windows python3.6 安装 tensorflow

2、基本用法。

使用 TensorFlow, 你必须明白 TensorFlow:

- 使用图 (graph) 来表示计算任务。

- 在被称之为 会话 (Session) 的上下文 (context) 中执行图。

- 使用 tensor 表示数据。

- 通过 变量 (Variable) 维护状态。

- 使用 feed 和 fetch 为任意操作输入和输出数据。

3、综述

TensorFlow 是一个编程系统,使用图来表示计算任务。图中的节点被称之为op(operation 的缩写)。一个 op 获得 0 个或多个

Tensor,执行计算产生 0 个或多个 Tensor。每个 Tensor 是一个类型化的多维数组。例如,你可以将一小组图像集表示为一个四

维浮点数数组,这四个维度分别是 [batch, height, width, channels]。

一个 TensorFlow 图(graph) 描述了计算的过程。为了进行计算,图必须在 会话(session) 里被启动。会话 将图的 op 分发到诸如

CPU 或 GPU 之类的 设备 上,同时提供执行 op 的方法。这些方法执行后,将产生的 tensor 返回。在 Python 语言中, 返回的

tensor 是 numpy ndarray 对象;在 C 和 C++ 语言中,返回的 tensor 是 tensorflow::Tensor 实例。

4、计算图

TensorFlow 程序通常被组织成一个构建阶段,和一个执行阶段。在构建阶段,op 的执行步骤 被描述成一个图;在执行阶段, 使

用会话执行执行图中的 op。

例如,通常在构建阶段创建一个图来表示和训练神经网络,然后在执行阶段反复执行图中的训练 op。

TensorFlow 支持 C、C++、Python 编程语言。目前,TensorFlow 的 Python 库更加易用,它提供了大量的辅助函数来简化构建

图的工作,这些函数尚未被 C 和 C++ 库支持。

三种语言的会话库 (session libraries) 是一致的。

5、构建图

构建图的第一步, 是创建源 op (source op)。源 op 不需要任何输入,例如 常量 (Constant)。源 op 的输出被传递给其它 op 做运算。

Python 库中,op 构造器的返回值代表被构造出的 op 的输出,这些返回值可以传递给其它 op 构造器作为输入。

TensorFlow Python 库有一个 默认图 (default graph) ,op 构造器可以为其增加节点。这个默认图对 许多程序来说已经足够用

了。

import tensorflow as tf

# 创建一个常量 op, 产生一个 1x2 矩阵. 这个 op 被作为一个节点

# 加到默认图中.

#

# 构造器的返回值代表该常量 op 的返回值.

matrix1 = tf.constant([[3., 3.]])

# 创建另外一个常量 op, 产生一个 2x1 矩阵.

matrix2 = tf.constant([[2.],[2.]])

# 创建一个矩阵乘法 matmul op , 把 'matrix1' 和 'matrix2' 作为输入.

# 返回值 'product' 代表矩阵乘法的结果.

product = tf.matmul(matrix1, matrix2)默认图现在有三个节点, 两个 constant() op, 和一个 matmul() op. 为了真正进行矩阵相乘运算, 并得到矩阵乘法的 结果, 你必须在会话里启动这个图.

6、在一个会话中启动图。

构造阶段完成后, 才能启动图. 启动图的第一步是创建一个 Session 对象, 如果无任何创建参数, 会话构造器将启动默认图.

# 启动默认图.

sess = tf.Session()

# 调用 sess 的 'run()' 方法来执行矩阵乘法 op, 传入 'product' 作为该方法的参数.

# 上面提到, 'product' 代表了矩阵乘法 op 的输出, 传入它是向方法表明, 我们希望取回矩阵乘法 op 的输出.

#

# 整个执行过程是自动化的, 会话负责传递 op 所需的全部输入. op 通常是并发执行的.

#

# 函数调用 'run(product)' 触发了图中三个 op (两个常量 op 和一个矩阵乘法 op) 的执行.

#

# 返回值 'result' 是一个 numpy `ndarray` 对象.

result = sess.run(product)

print(result) # ==> [[ 12.]]

# 任务完成, 关闭会话.

sess.close()Session 对象在使用完后需要关闭以释放资源. 除了显式调用 close 外, 也可以使用 "with" 代码块 来自动完成关闭动作

with tf.Session() as sess:

result = sess.run([product])

print(result)在实现上, TensorFlow 将图形定义转换成分布式执行的操作, 以充分利用可用的计算资源(如 CPU 或 GPU). 一般你不需要显式指定使用 CPU 还是 GPU, TensorFlow 能自动检测. 如果检测到 GPU, TensorFlow 会尽可能地利用找到的第一个 GPU 来执行操作.

如果机器上有超过一个可用的 GPU, 除第一个外的其它 GPU 默认是不参与计算的. 为了让 TensorFlow 使用这些GPU, 你必须将 op 明确指派给它们执行. with...Device 语句用来指派特定的 CPU 或 GPU 执行操作:

with tf.Session() as sess:

with tf.device("/gpu:1"):

matrix1 = tf.constant([[3., 3.]])

matrix2 = tf.constant([[2.],[2.]])

product = tf.matmul(matrix1, matrix2)

...

备用字符串进行标识. 目前支持的设备包括:

- "/cpu:0" : 机器的 CPU.

- "/gpu:0" : 机器的第一个 GPU, 如果有的话.

- "/gpu:1" : 机器的第二个 GPU, 以此类推

7、交互式使用

文档中的 Python 示例使用一个会话 Session 来 启动图, 并调用 Session.run() 方法执行操作.

为了便于使用诸如 IPython 之类的 Python 交互环境, 可以使用 InteractiveSession 代替 Session 类, 使用Tensor.eval() 和 Operation.run() 方法代替 Session.run() . 这样可以避免使用一个变量来持有会话.

# 进入一个交互式 TensorFlow 会话.

import tensorflow as tf

sess = tf.InteractiveSession()

x = tf.Variable([1.0, 2.0])

a = tf.constant([3.0, 3.0])

# 使用初始化器 initializer op 的 run() 方法初始化 'x'

x.initializer.run()

# 增加一个减法 sub op, 从 'x' 减去 'a'. 运行减法 op, 输出结果

sub = tf.subtract(x, a)

print(sub.eval()) # ==> [-2. -1.]

sess.close()8、Tensor

TensorFlow 程序使用 tensor 数据结构来代表所有的数据, 计算图中, 操作间传递的数据都是 tensor. 你可以把 TensorFlow tensor 看作是一个 n 维的数组或列表. 一个 tensor 包含一个静态类型 rank, 和 一个 shape。

9、变量

Variables for more details. 变量维护图执行过程中的状态信息. 下面的例子演示了如何使用变量实现一个简单的计数器。

# 简单的计数器

import tensorflow as tf

# 创建一个变量, 初始化为标量 0.

state = tf.Variable(0, "counter")

# 创建一个 op, 其作用是使 state 增加 1

one = tf.constant(1)

new_value = tf.add(state, one)

update = tf.assign(state, new_value)

# 启动图后, 变量必须先经过`初始化` (init) op 初始化,

# 首先必须增加一个`初始化` op 到图中.

init_op = tf.initialize_all_variables()

# 启动图, 运行 op

with tf.Session() as sess:

# 运行 'init' op

sess.run(init_op)

# 打印 'state' 的初始值

print(sess.run(state))

# 运行 op, 更新 'state', 并打印 'state'

for _ in range(3):

sess.run(update)

print(sess.run(state))

# 输出:

# 0

# 1

# 2

# 3

代码中 assign() 操作是图所描绘的表达式的一部分, 正如 add() 操作一样. 所以在调用 run() 执行表达式之前, 它并不会真正执行赋值操作.

通常会将一个统计模型中的参数表示为一组变量. 例如, 你可以将一个神经网络的权重作为某个变量存储在一个tensor 中. 在训练过程中, 通过重复运行训练图, 更新这个 tensor.

10、Fetch

为了取回操作的输出内容, 可以在使用 Session 对象的 run() 调用 执行图时, 传入一些 tensor, 这些 tensor 会帮助你取回结果. 在之前的例子里, 我们只取回了单个节点 state , 但是你也可以取回多个 tensor:

import tensorflow as tf

input1 = tf.constant(3.0)

input2 = tf.constant(2.0)

input3 = tf.constant(5.0)

intermed = tf.add(input2, input3)

mul = tf.multiply(input1, intermed)

with tf.Session() as sess:

result = sess.run([mul, intermed])

print(result)

# 输出:

# [21.0, 7.0]

需要获取的多个 tensor 值,在 op 的一次运行中一起获得(而不是逐个去获取 tensor)。

11、Feed

上述示例在计算图中引入了 tensor, 以常量或变量的形式存储. TensorFlow 还提供了 feed 机制, 该机制 可以临时替代图中的任意操作中的 tensor 可以对图中任何操作提交补丁, 直接插入一个 tensor.

feed 使用一个 tensor 值临时替换一个操作的输出结果. 你可以提供 feed 数据作为 run() 调用的参数. feed只在调用它的方法内有效, 方法结束, feed 就会消失. 最常见的用例是将某些特殊的操作指定为 "feed" 操作,标记的方法是使用 tf.placeholder() 为这些操作创建占位符.

import tensorflow as tf

input1 = tf.placeholder(tf.dtypes.float32)

input2 = tf.placeholder(tf.dtypes.float32)

output = tf.multiply(input1, input2)

with tf.Session() as sess:

print(sess.run([output], {input1:[7.], input2:[2.]}))

# 输出:

# [array([ 14.], dtype=float32)]

【一起学习】

本文详细介绍了TensorFlow,一个由Google推出的开源机器学习框架。它适用于各类应用,为开发者和研究者提供了解决多样化挑战的工具。文章涵盖了TensorFlow的工作原理、安装与使用方法,以及如何构建神经网络进行猫狗图片识别的示例。

本文详细介绍了TensorFlow,一个由Google推出的开源机器学习框架。它适用于各类应用,为开发者和研究者提供了解决多样化挑战的工具。文章涵盖了TensorFlow的工作原理、安装与使用方法,以及如何构建神经网络进行猫狗图片识别的示例。

658

658

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?