先在官网下载Ollama

模型下载

ollama run qwen2:0.5b

如果ollama是部署在docker上

docker exec -it ollama ollama run qwen2:0.5b

可以快速部署很多模型 方便

可以替换openai api key

from openai import OpenAI

client = OpenAI(

base_url = 'https://127.0.0.1:11434/v1',

api_key='ollama', # required, but unused

)

response = client.chat.completions.create(

model="llama2",

messages=[

{"role": "system", "content": "You are a helpful assistant."},

{"role": "user", "content": "Who won the world series in 2020?"},

{"role": "assistant", "content": "The LA Dodgers won in 2020."},

{"role": "user", "content": "Where was it played?"}

]

)

print(response.choices[0].message.content)

对接Dify

第二次登录有的连接会大圈进不去,使用下面这个链接

localhost/install

127.0.0.1/install

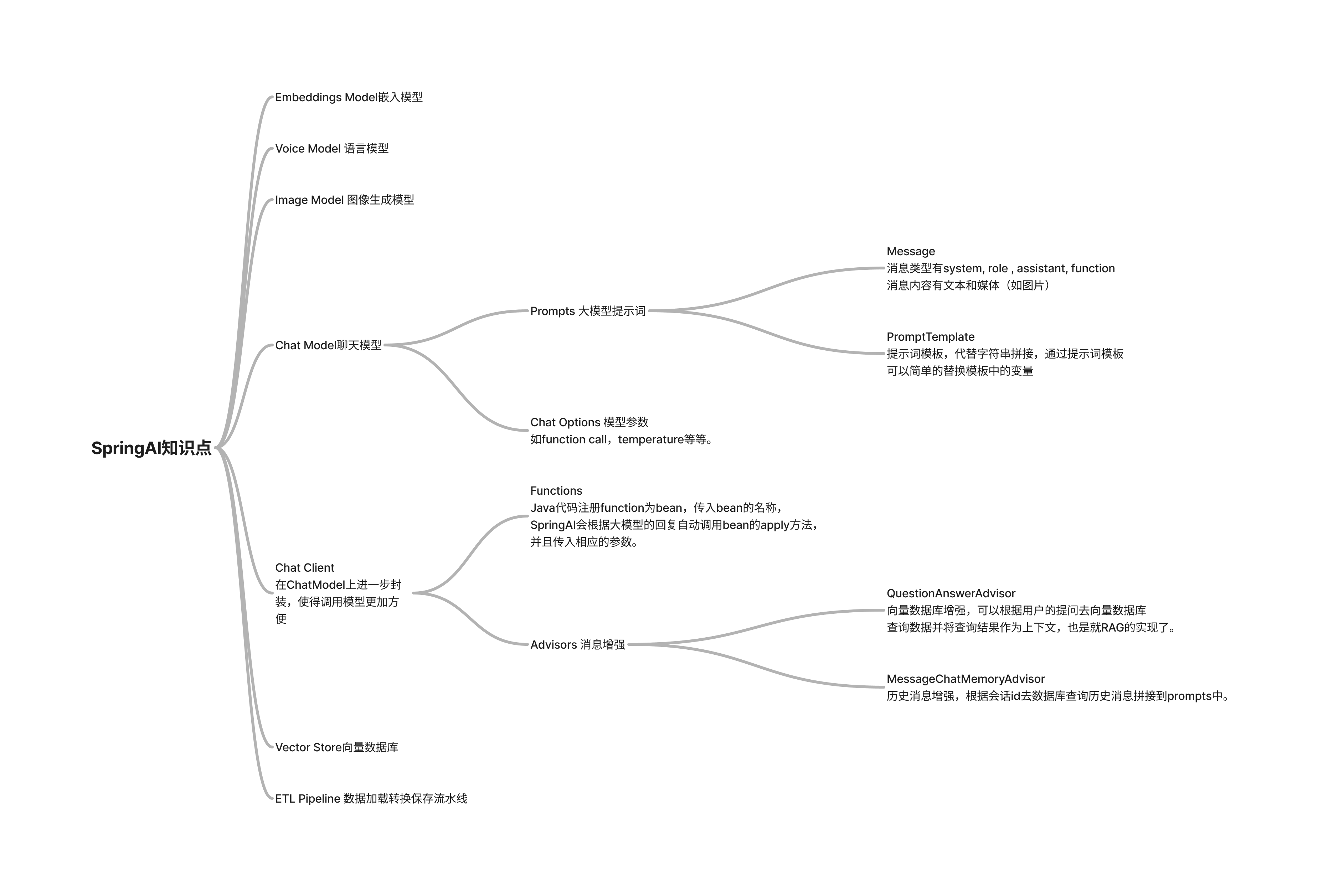

可以整合Spring AI

这个JDK 和SpringBoot的版本要比较高

官网的航班退订demo

AI返回的内容有一些不确定性的东西在里面,有点难处理

Dify开发

工作流节点

1730

1730

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?