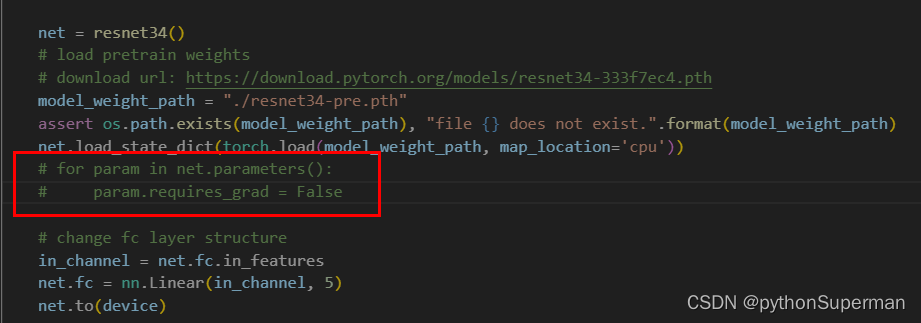

冻结除最后全连接层以外的所有权重,只去单独训练它最后一层的的权重,这个方法,冻结了所有网络的权重。

for param in net.parameters():

param.requires_grad = False

如果要训练网络中的所有参数,注释掉这两句话就可以了。

文章讨论了一种技术,即在训练神经网络时,将除最后一层外的所有权重固定,仅调整最后一层的权重,以此来加速学习过程或防止过拟合。只需临时禁用`requires_grad`属性即可实现这一目标。

文章讨论了一种技术,即在训练神经网络时,将除最后一层外的所有权重固定,仅调整最后一层的权重,以此来加速学习过程或防止过拟合。只需临时禁用`requires_grad`属性即可实现这一目标。

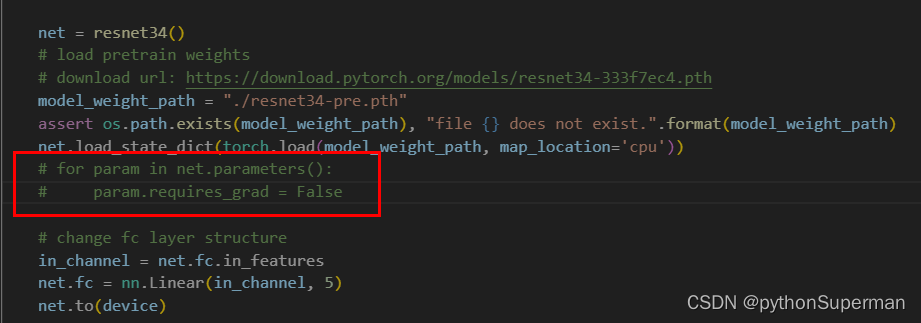

冻结除最后全连接层以外的所有权重,只去单独训练它最后一层的的权重,这个方法,冻结了所有网络的权重。

for param in net.parameters():

param.requires_grad = False

如果要训练网络中的所有参数,注释掉这两句话就可以了。

2367

2367

2799

2799

3760

3760

717

717

365

365

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?