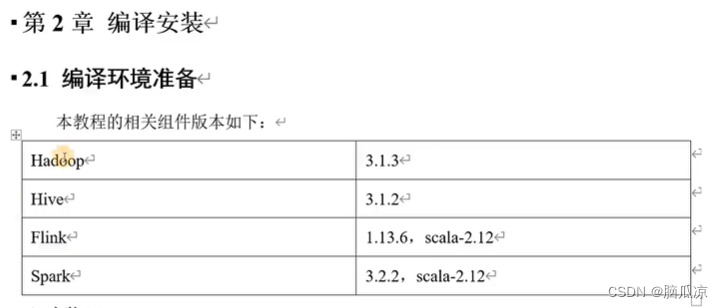

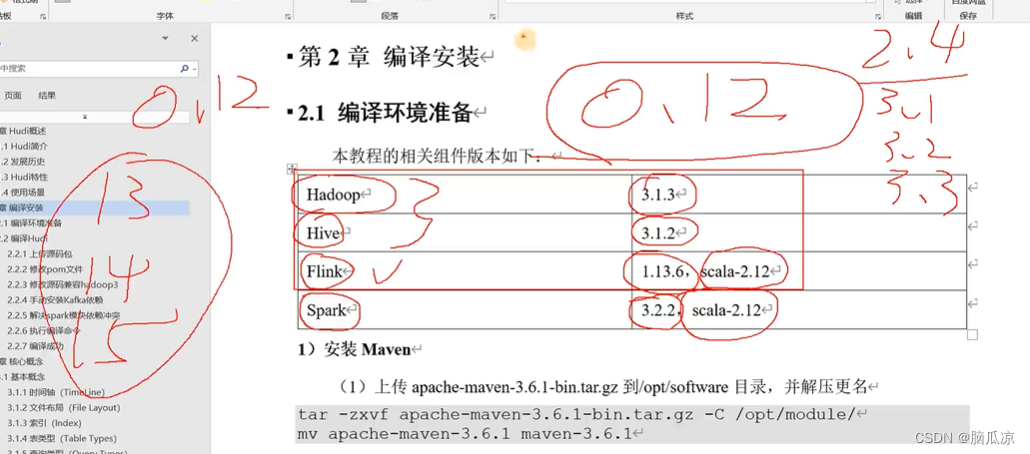

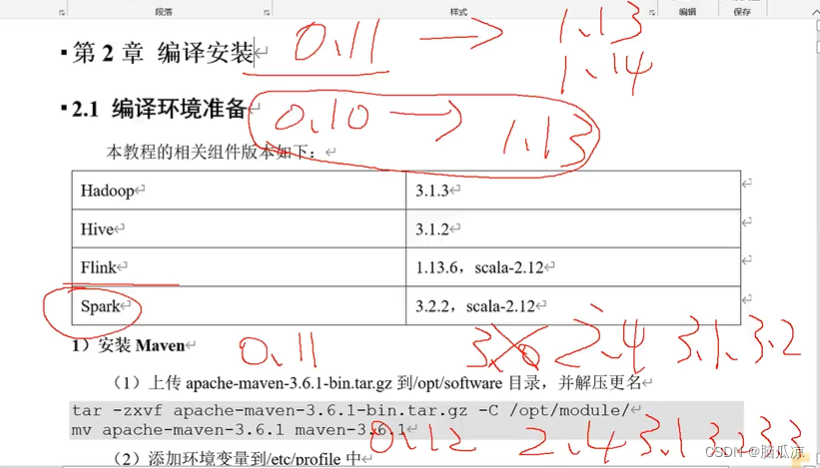

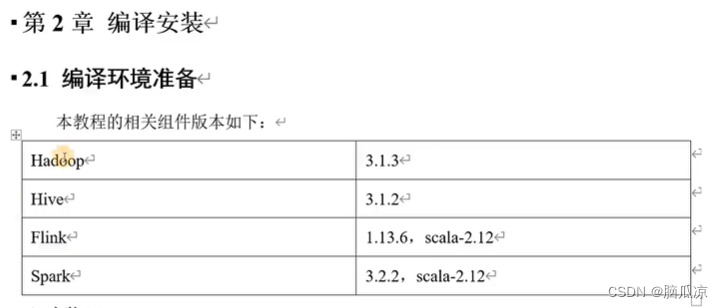

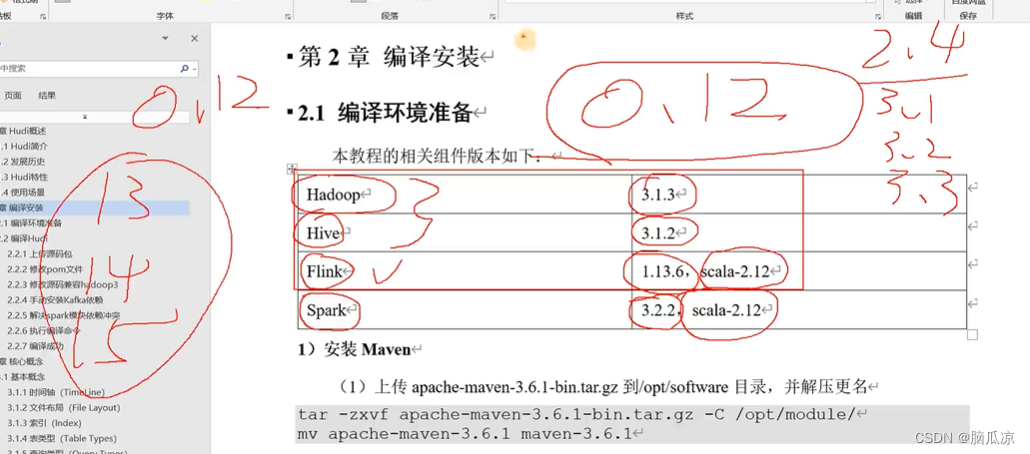

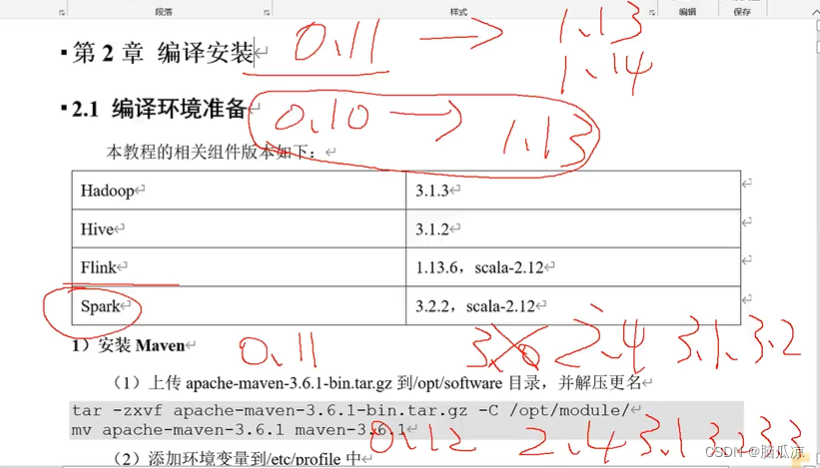

然后我们来看一下,hudi我们这次安装的时候,各个组件的版本信息

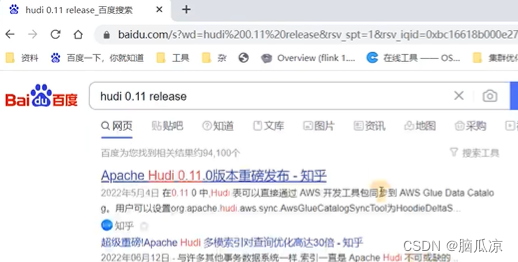

这个hudi对各个版本的支持还是很多的,需要在安装的时候查一下

具体的

可以这样查一下

去看一下具体的hudi对spark的支持是多少,对flink的支持的版本是多少等等可以很容易查到

然后我们来看一下,hudi我们这次安装的时候,各个组件的版本信息

这个hudi对各个版本的支持还是很多的,需要在安装的时候查一下

具体的

可以这样查一下

去看一下具体的hudi对spark的支持是多少,对flink的支持的版本是多少等等可以很容易查到

282

282

3656

3656

2512

2512

1748

1748

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?