决策树的划分依据:信息增益

特征A对训练数据集D的信息增益g(D,A),定义为集合D的信息熵H(D)与特征A给定条件下D的信息条件熵H(D|A)之差,公式为:

g(D,A) = H(D) - H(D|A)

注:信息增益表示得知特征X的信息而使得类Y的信息的不确定性减少的程度

决策树的优缺点

优点:可视化——可解释能力强

缺点:容易产生过拟合

代码如下:

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.tree import DecisionTreeClassifier,export_graphviz

def decision_iris():

#1)获取数据集

iris = load_iris()

#2)划分数据集

x_train, x_test, y_train, y_test = train_test_split(iris.data,iris.target,random_state=22)

#3)决策树预估器

estimator = DecisionTreeClassifier(criterion="entropy")

estimator.fit(x_train,y_train)

#4)模型评估

#方法1 直接比对真实值和预测值

y_predict = estimator.predict(x_test)

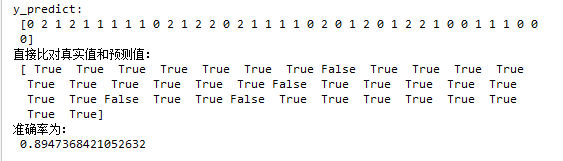

print("y_predict:\n",y_predict)

print("直接比对真实值和预测值:\n",y_test==y_predict)

#方法2 计算准确率

score = estimator.score(x_test,y_test)

print("准确率为:\n",score)

return None

if __name__ =="__main__":

decision_iris()结果如下:

若要进行可视化操作,需要在最后加入如下代码:

#可视化决策树

export_graphviz(estimator,out_file="iris_tree.dot",feature_names=iris.feature_names)运行完程序会生成一个iris_tree.dot文件,将文件内信息复制到http://webgraphviz.com/进行可视化转换。

博客介绍了决策树划分依据为信息增益,即集合D的信息熵与特征A给定条件下D的信息条件熵之差。还阐述了决策树优缺点,优点是可视化、可解释能力强,缺点是易过拟合。最后给出代码及可视化操作方法,可将生成文件信息复制到指定网站转换。

博客介绍了决策树划分依据为信息增益,即集合D的信息熵与特征A给定条件下D的信息条件熵之差。还阐述了决策树优缺点,优点是可视化、可解释能力强,缺点是易过拟合。最后给出代码及可视化操作方法,可将生成文件信息复制到指定网站转换。

6219

6219

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?