Windows 系统 Ollama 导入本地 gguf 模型文件报错

Error: neither ‘from’ or ‘files’ was specified

原因:

Windows系统

where ollama

macOS系统需要运行:

which ollama

输出:

D:\testOllama>where ollama

E:\Ollama\ollama.exe

C:\Users\xxx\AppData\Local\Programs\Ollama\ollama.exe

解决方案二选一即可,我直接把其中一个版本的ollama卸载了,卸载时会自动删除对应版本的系统环境变量。不想删除其中一个版本的话可以选择解决方案二,删除对应的系统环境变量,只保留一个,用哪个版本的时候就保留哪个。

解决方案一:

发现Ollama有两个版本,系统装了两次,找到其中一个安装路径,卸载掉其中的一个即可:

解决方案二:

或者也可以在系统环境变量,把其中的一个配置的系统环境变量删掉:

清理系统环境变量

-

检查 PATH 变量:

-

按下

Win + R,输入sysdm.cpl打开系统属性。 -

切换到“高级”选项卡 → 点击“环境变量”。

-

在“系统变量”中找到

Path,编辑并检查是否有指向C:\Users\xxx\AppData\Local\Programs\Ollama\ 或 E:\Ollama的条目。 -

若有,选中其中一个后点击“删除”以清理残留路径。

-

检查一下是否解决了报错,本地挂载gguf模型文件到ollama流程:

第一步:

在当前目录下新建一个名为 Modelfile.txt 的文本文件,写入 FROM ./大模型文件名.gguf,保存并关闭。

第二步:

将 Modelfile.txt 的文件后缀 .txt 删除,使其变成 Modelfile。

第三步:

之后在 gguf 模型文件夹目录下cmd输入

ollama create 模型名称 -f ./Modelfile

第四步:

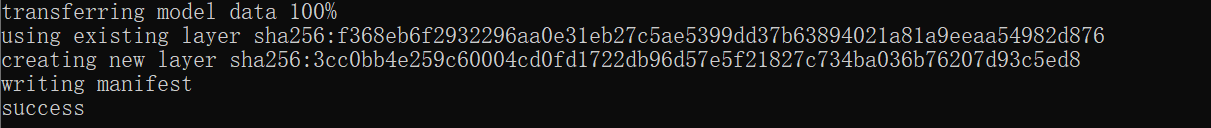

可以看到已经解决报错,没有问题了

第五步:

可以通过ollama命令正常调用模型了,展示挂载的模型

ollama list

第六步:

通过ollama run 命令来运行你选择的模型进行对话

ollama run xxx:latest

630

630

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?