基于树莓派和执行器网络的智能驾驶辅助系统

摘要

车辆在开发后的测试与认证通常在底盘测功机试验台上进行。本文提出一种基于云计算、嵌入式工具和电动执行器的智能实时驾驶辅助系统,适用于手动变速传动系统车辆的测试。针对车辆离合器驱动,采用连接至高扭矩步进电机的机械腿执行器,由运行在树莓派4上的Python代码控制,并通过智能网络连接,实现用户界面仪表板和数字化工作系统的远程控制,从而借助云计算实现数据连接。通过应用该网络结构,研究了利用免费云基础设施实现智能驾驶辅助系统的可行性,其中硬件设置在马来西亚,而控制来自德国。该原型所依赖的框架涵盖了数据处理、制造、机械学、网络、嵌入式系统和执行器等多个工程领域,可应用于在底盘测功机上测试车辆的智能驾驶辅助系统,且延迟低于1秒。

1. 引言

通常,底盘测功机用于在新开发的车辆完全组装后进行测试和认证,主要用于评估发动机和动力总成性能的不同方面[1],[2]。噪声排放、尾气排放、发动机性能、燃油消耗和电磁兼容性是试验中常见的测试参数[3]。近年来,由于经济因素、操作简便性、可靠性、可重复性,以及随着技术进步实现完全自动化的可能性,底盘测功机相较于道路测试更受研究和工业领域的青睐[4]。此外,当测试在气候室或高原模拟舱内进行时,底盘测功机还可在不同且预设的环境条件下进行瞬态试验[5]。另外,与道路测试相比,底盘测功机更容易集成多种设备,如排放测量设备、负载控制和数据采集系统[6]。

试验通常通过使用机器人装置来实现自动化,该装置可替代驾驶员[4],[7]的功能。机器人装置的任务通常包括操作制动器、控制施加到加速踏板的力以及离合器踏板的接合,并在一定程度上操纵换挡杆以进行换挡。通常在运行时,必须遵循预定义的速度曲线以及相应的换挡策略,以在底盘测功机试验台上进行自动化测试试验,其中控制工程面临的挑战在于将执行器作为车辆与驾驶员控制器闭环中的操纵变量加以考虑。驾驶员控制器需要被开发以处理构成多个叠加控制器的不同任务,这些控制器负责处理诸如起步、加速、换挡、减速和停车等程序。整个远程程序的控制可以通过实施物联网(IoT)方法来实现。这对于开发团队来说可能是有益的,使其能够访问测试设施而无需亲自到达试验台。这一点非常重要,可以实现跨国合作,而跨国合作正是推动该领域技术变革的主要驱动力。

本研究提出了一种概念框架,旨在通过云计算、传输机制、嵌入式工具和电动执行器,在测试中的手动变速传动系统车辆上实现智能实时驾驶辅助系统。该嵌入式工具作为客户端,用于从云代理获取信号,并处理这些信号以控制机械腿的运动和速度,从而实现离合器踏板的接合与分离。在亚洲进行的硬件设置试验,通过与位于欧洲的数据物联网代理交换数据来完成。

2. 方法论

2.1. 消息队列遥测传输(MQTT)消息协议

本文实现的传输机制使用了消息队列遥测传输(MQTT)消息协议,该协议允许系统通过一种称为发布-订阅的知名范式来减少发送的总数据量。对于在汽车实验室中具有受限设备、低带宽、高延迟和可靠网络(如底盘测功机)的系统而言,MQTT协议非常适用,因为它是一种非常简单且轻量级信息传输机制[8]。由于MQTT的设计旨在最小化网络带宽和设备资源需求,同时确保可靠性以及一定程度的传输保障,因此将MQTT应用于对延迟敏感且电池电量消耗较低的驾驶辅助系统被认为是理想的。

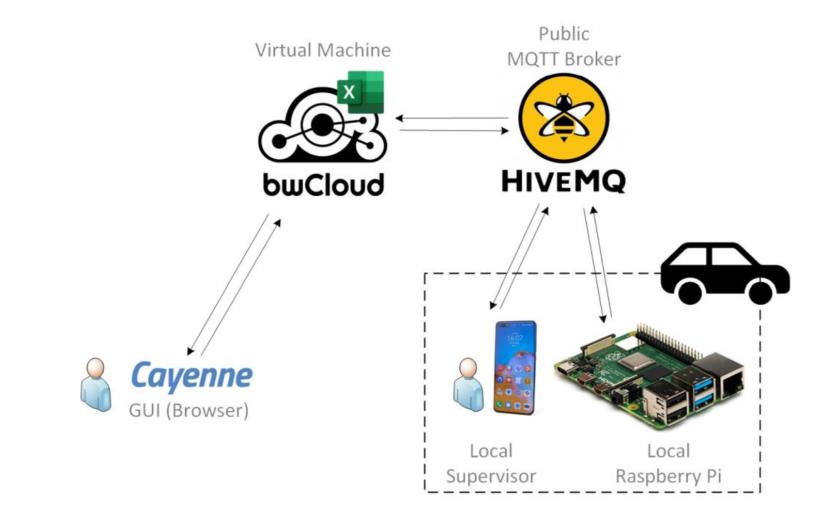

用于发送数据的设备可以在特定主题上发布数据,而对这些信息感兴趣的设备或服务则可以订阅相关主题。在这两类实体之间还存在另一个称为代理服务器的实体,负责将消息更新传递给订阅者。如图1所示,该框架由多个组件构成:作为发布者的GUI浏览器Cayenne、作为订阅者的本地监控器和树莓派,以及位于云中的HiveMQ作为代理服务器。树莓派作为MQTT客户端,其通信协议采用Python编程语言编写。实现了Python MQTT客户端类,提供了发布消息和订阅主题所需的函数。代码中使用了paho mqtt客户端类中的方法,如connect、disconnect、subscribe、unsubscribe和publish。

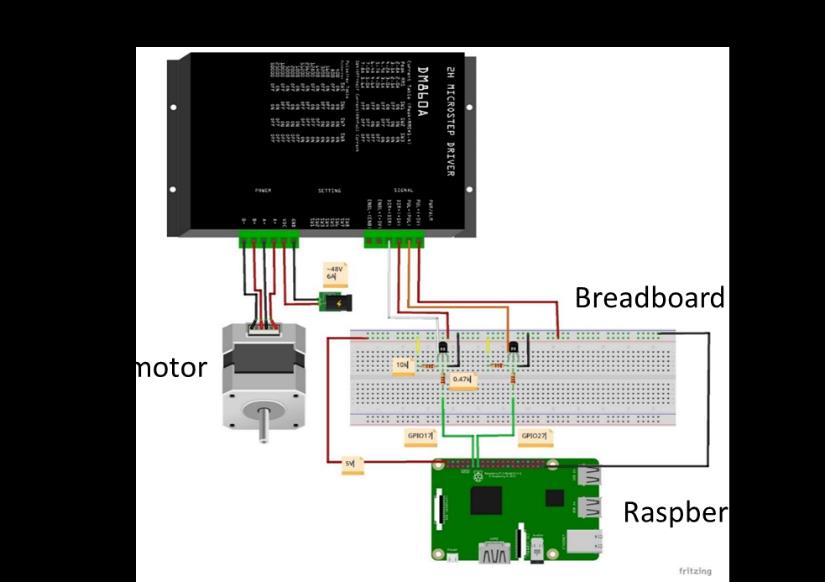

本项目中使用的树莓派4需要订阅通信协议中创建的主题,以便发送和接收数据,即目标速度、离合器位置,并回传车载诊断系统(OBD)数据,如实际速度和每分钟转数(RPM)。树莓派操控的MQTT信号将用于控制一个步进电机,该步进电机通过图2所示的电路连接至离合器踏板。

2.2. 机械腿

机械腿机构由高扭矩步进电机驱动。本项目采用步进电机型号Nema 34,以克服将离合器踏板推至最高点所需的扭矩τ。当离合器踏板在不同角度被踩下时,扭矩的测量与计算结果列于表1中。Fm 为踩下离合器踏板至最大位置时测得的垂直于离合器踏板的测量力,而Fx 和Fy 是将力分解后的两个力的分量矢量。杠杆角度和推杆长度是连杆机构的几何参数,通过运动学将步进电机的力传递至离合器踏板,模拟人类驾驶员的步态。

| 踏板角度 (°) | Fx (N) | Fy (N) | 杠杆角度 (°) | 推杆长度 (mm) | Fm (N) | τ(Nm) |

|---|---|---|---|---|---|---|

| 30 | 129.90 | 75.00 | 60 | 175 | 173 | 30.28 |

| 40 | 114.90 | 96.42 | 50 | 136 | 175 | 26.52 |

| 45 | 106.06 | 106.06 | 45 | 124 | 212 | 26.29 |

| 60 | 75.00 | 129.90 | 30 | 101 | 300 | 30.30 |

2.3. 实时监控

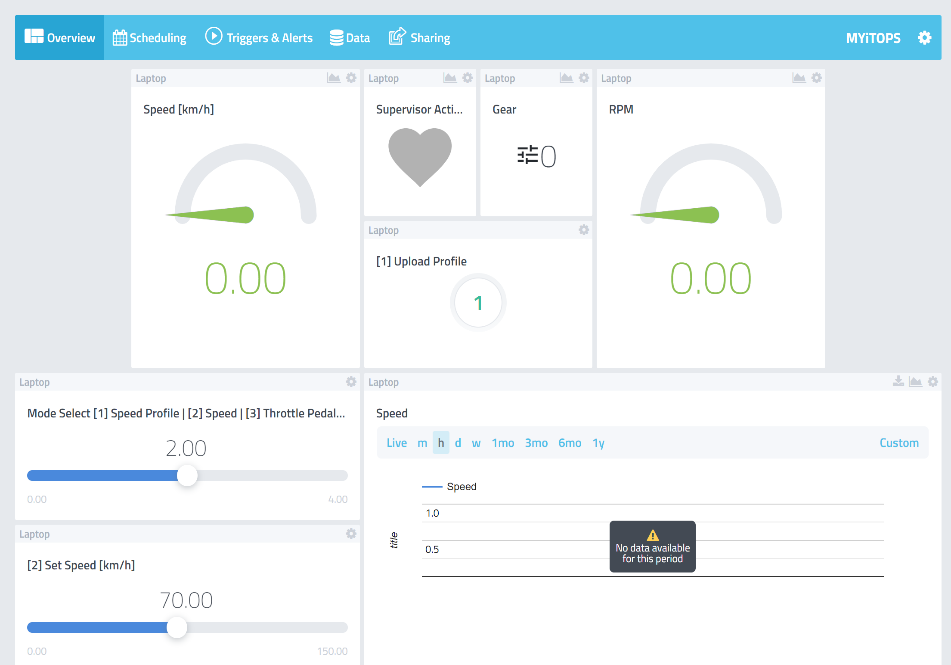

所开发的驾驶辅助系统通过基于Web的图形用户界面(GUI)Cayenne实现。通过拖放功能生成的仪表板包含用于离合器位置控制的滑块和用于车速的仪表,如图3所示。

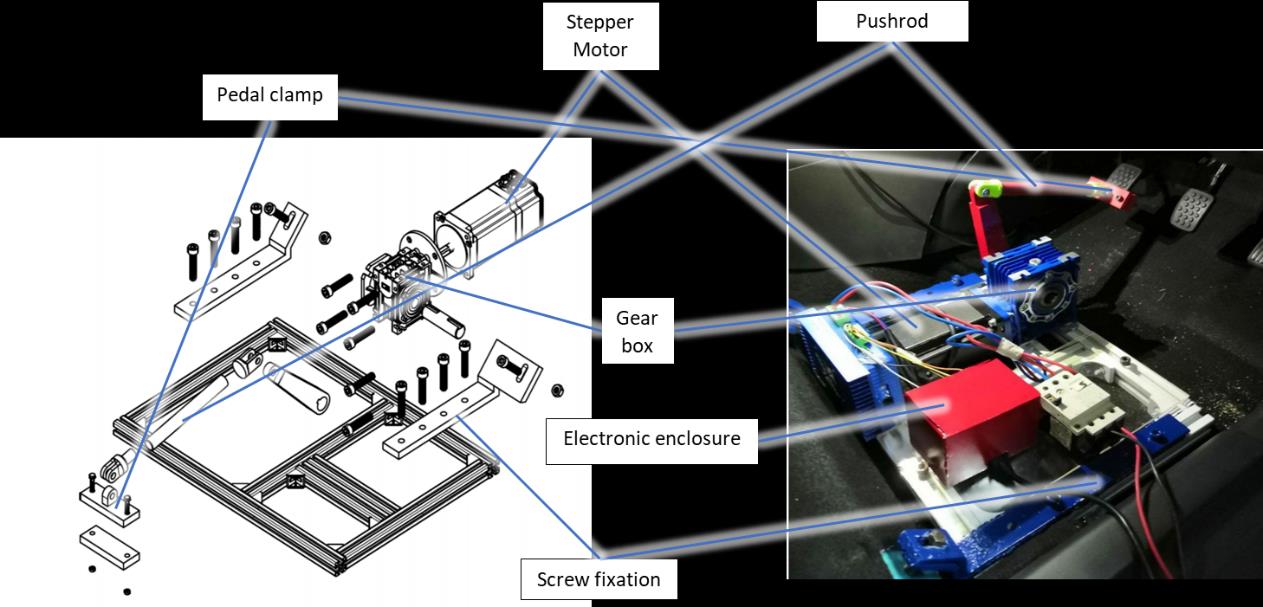

为了使底盘测功机配备驾驶辅助系统,应制造如图4所示的平台,以容纳所有子系统,即包含树莓派4和电子元件的电子外壳、由110伏直流电驱动并配有10:1传动比齿轮箱的电机机构(步进电机)以及连杆机构(推杆和踏板夹具)。该硬件平台被组装起来,以便在手动变速传动系统车辆上实现系统的改装能力,而无需进行可能损坏汽车物理结构的重大改装。

表2提供了测试车辆(Perodua Myvi 1.3升手动挡汽车)的规格。该车参考质量为955公斤,最大质量为1,015公斤。总排量为1298立方厘米,额定最大功率和扭矩输出分别为69千瓦 @6000转/分钟和121牛·米@3200转/分钟。

| 车型 | Perodua Myvi,5速手动变速箱,前轮驱动 |

|---|---|

| 生产年份 | 2017年(标准汽油95辛烷值) |

| 参考/最大质量 | 955 / 1,015公斤 |

| 发动机类型 | 1.3升 1NR-VE |

| 额定最大功率 | 69千瓦(93马力) |

| 额定最大扭矩 | 121牛·米 |

| 气缸数 | 直列四缸 |

2.4. 案例研究

实验在马来西亚彭亨州北根的UMP汽车卓越中心(AEC)进行了实验,该底盘测功机已通过欧洲标准认证。测试车辆固定在一台17.8英寸滚筒野马测功机上。本研究为概念性研究,车辆在无驾驶循环条件的情况下进行驾驶,因为本研究的目的仅仅是考察安装在被测车辆上的驾驶辅助系统在底盘测功机上的功能表现。图5展示了在野马底盘测功机试验台上的实验设置。实验试验中聘请持证驾驶员执行切换和加速操作。实验过程中记录了MQTT客户端与MQTT代理之间通信协议的延迟情况。

3. 结果与讨论

实验结果在两个子章节中呈现,分别是(1)通信协议框架的功能和(2)驾驶辅助系统在底盘测功机试验台上进行驾驶循环测试的可靠性。

通过分析MQTT在代理端的订阅者节点的延迟性能,对MQTT的性能进行了评估,以突出所提出通信协议的效率。结果如表3所示。

| 实体 | 设备 | 位置 |

|---|---|---|

| 发布者 | Cayenne | 德国卡尔斯鲁厄 |

| 订阅者 | 树莓派4 | 马来西亚彭亨州北根 |

| 代理服务器 | HiveMQ | BW Cloud |

延迟:765 毫秒

实验结果表明,使用Python语言编写的MQTT通信协议能够执行油门踏板按压程序,并实现低于1秒的延迟,这与Mukherjee、Dey和De[9]发布的结果相似,他们在增强型MQTT-SN(传感器网络)情况下获得了平均消息传输性能提升30%,在增强型MQTT情况下获得了17%的性能提升,延迟为15.5毫秒。Cayenne Web服务器仪表板上显示的数据还表明,可以实时准确地获取与速度曲线、速度、油门踏板、离合器位置相关的可靠信息。

在测试车辆内改装驾驶辅助系统的试验结果得出了推杆的位置和行程距离,如图6所示。硬件平台的固定装置基于有限元分析进行设计,用于研究当在推杆末端(连接脚踏板)施加轴向力时,以及硬件在与驾驶员座椅现有固定位置对齐的硬件框架不同位置上固定时,平台的变形情况。实验表明,若推杆在待机状态下的位置为0°,则中点为6°,终点为52°。而在推杆推动过程中,其行程距离在待机状态、中点和终点分别为0 mm、105.2 mm和210.4 mm。

离合器完全接合时的结束位置。)

离合器完全接合时的结束位置。)

4. 结论

本文提出了一种概念框架,旨在通过MQTT通信协议、Python、树莓派4以及与带齿轮的步进电机相连的推杆,实现针对配备手动变速传动系统的车辆在底盘测功机测试中的离合踏板控制智能实时驾驶辅助系统。结果表明,位于不同大洲(即亚洲和欧洲)的MQTT客户端之间采用MQTT通信协议通信时存在高延迟(< 1秒)。该系统可通过车辆驾驶员座椅现有的固定装置进行改装,从而轻松应用于手动变速传动系统的车辆排放研究或发动机性能评估。未来,可通过增加加速踏板的电动系统,实现被测车辆在底盘测功机上的完全物联网驾驶辅助系统。此外,还可对硬件、软件及车载诊断系统(OBD)实现实时MQTT应用,以验证该系统的效率。

2320

2320

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?