文章地址:https://arxiv.org/pdf/2101.05779.pdf

文章内容

这篇文章提出了一个新的用以处理结构化预测任务的框架——增强自然语言处理之间的翻译(Translation between Augmented Natural Lan-guages,TANL),解决了诸如命名实体识别、关系抽取、事件抽取、指代消解等诸多自然语言处理任务。作者摒弃了之前针对于特定任务设计特定分类模型的思想,转而将不同任务描述为一个自然语言翻译任务,从而可以更好地利用预训练语言模型中的隐式知识。

文章方法

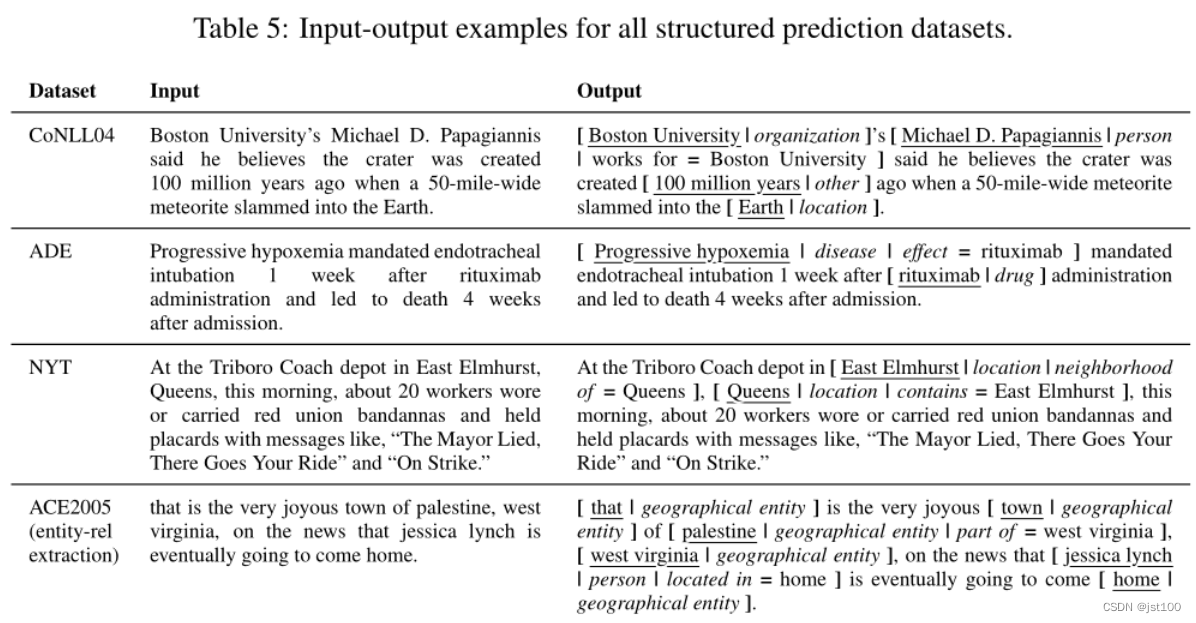

作者部分抽取示例如上所示。可以看出对于要抽取的实体,作者会用特殊符号“[]”标明,然后将其所代表的的内容(如关系类型、实体类型等)附在特殊符号“|”后面,所用的模型主要框架即为T5模型。

对比实验

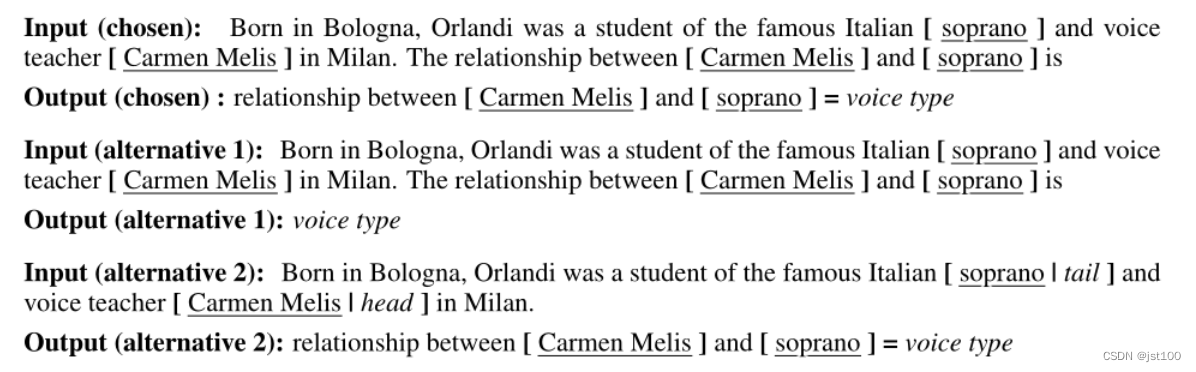

作者同时也设计了很多自身的对比实验,比如自然语言增强的模板的选择:

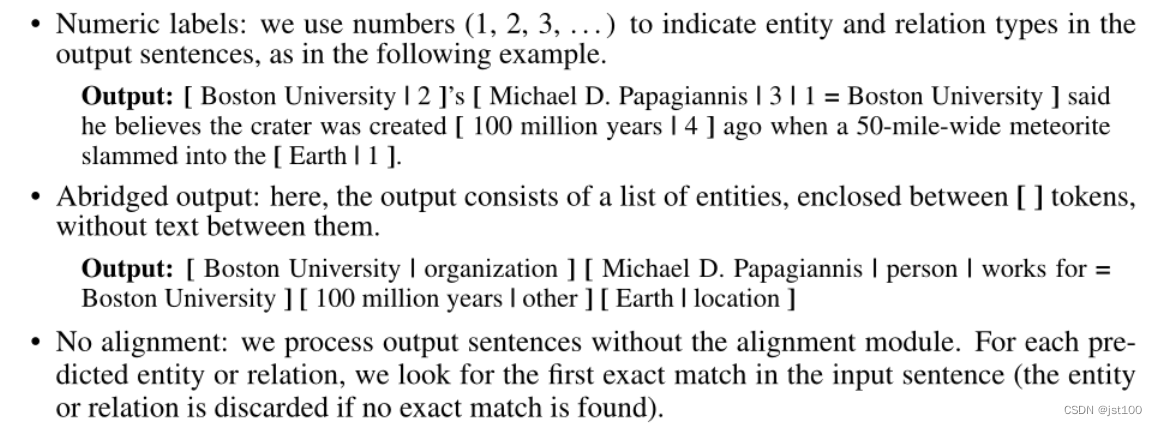

以及消融研究,以证明标签语义、自然输出格式和最优对齐的重要性:

这些具体的实验细节均在文章的附录部分,这里不再介绍。

文章总结

这篇文章的主要创新点在于其构造了一种新颖的框架,通过探寻不同地结构化任务的共性,以及挖掘蕴含在预训练语言模型潜在的语言知识,从而将抽取任务转化为结构化的自然语言生成或者自然语言翻译任务,从而避免了之前的方法需要针对不同地任务设计不同分类模型的问题,也同时可以更好地考虑标签语义信息,因为不需要将标签转化为数字,这点在小数据集中尤其重要。

在今年(2022年)的ACL上也提出了一个利用生成框架完成结构化抽取的大一统任务《Unified Structure Generation for Universal Information Extraction》,后边我也将去读一下这篇文章。

1185

1185

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?