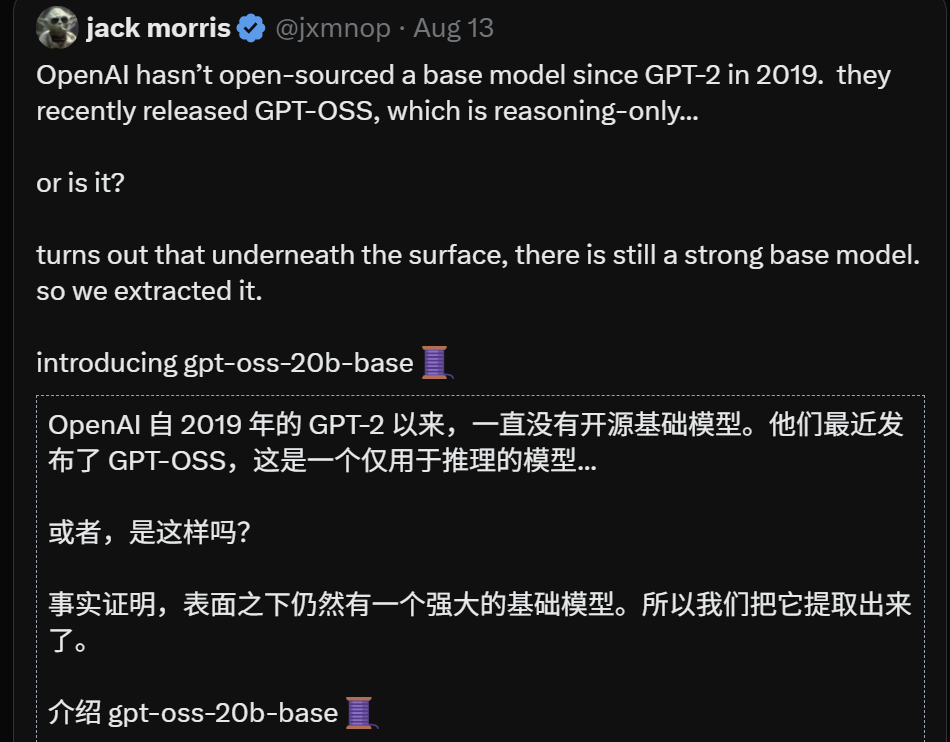

OpenAI在8月初发布了开放权重模型家族gpt-oss,这是公司自2019年GPT-2以来首次真正意义上的开源动作。仅仅两周后,一位研究者就将这一模型“拆解重组”,推出了与官方版本迥异的变体。

OpenAI在8月初发布了开放权重模型家族gpt-oss,这是公司自2019年GPT-2以来首次真正意义上的开源动作。

仅仅两周后,一位研究者就将这一模型“拆解重组”,推出了与官方版本迥异的变体。

康奈尔大学博士生、前Google Brain成员、现任Meta研究员的Jack Morris,公开了名为gpt-oss-20b-base的新版本。

图片

他并没有让模型变得更聪明,而是剥离了OpenAI在训练中添加的推理与对齐能力。

结果是,一个更快、更自由、更无约束的“原始基座模型”重新出现。

一、从“推理模型”到“基座模型”的逆转

图片

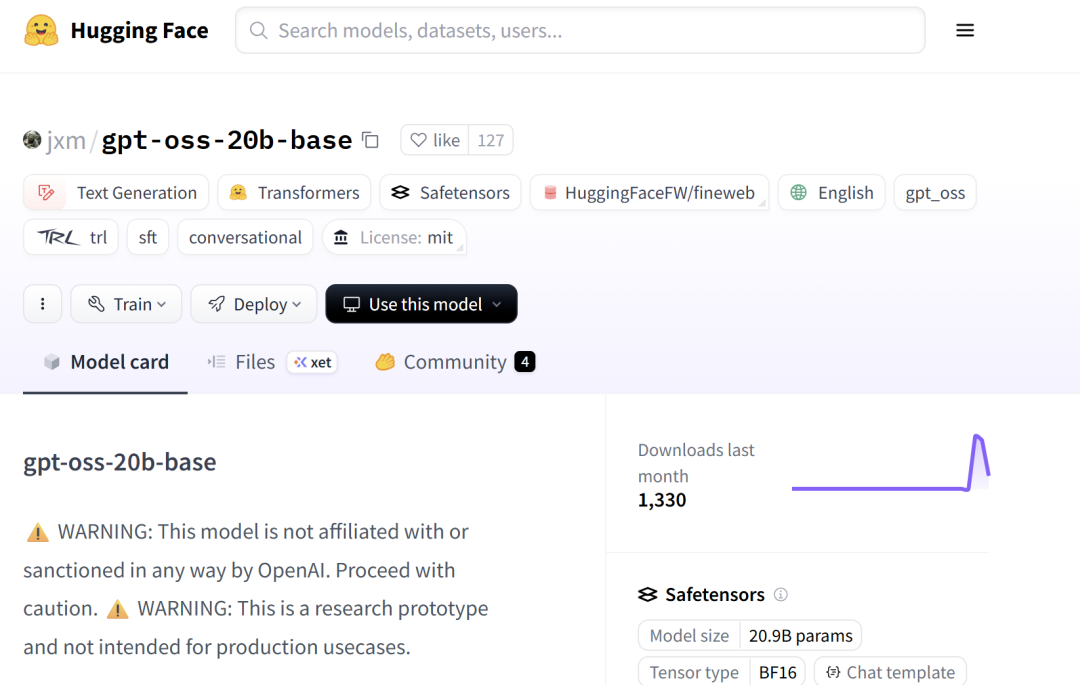

地址:http://huggingface.co/jxm/gpt-oss-20b-base

要理解这一变化,必须先区分“推理优化模型”和“基座模型”。

OpenAI发布的gpt-oss属于前者,它经过额外的指令微调和对齐,使得模型在回答问题时更安全、更符合预期。

这种做法源自2024年推出的o1模型,强调链式思维,让AI在生成答案前进行多步推理与自我检查。它们在编程、数学和解释类任务上表现优异,但往往会规避敏感话题。

相比之下,基座模型是未经对齐的原始形态,它只负责预测下一个词,不具备礼貌、拒绝或安全过滤的机制。

图片

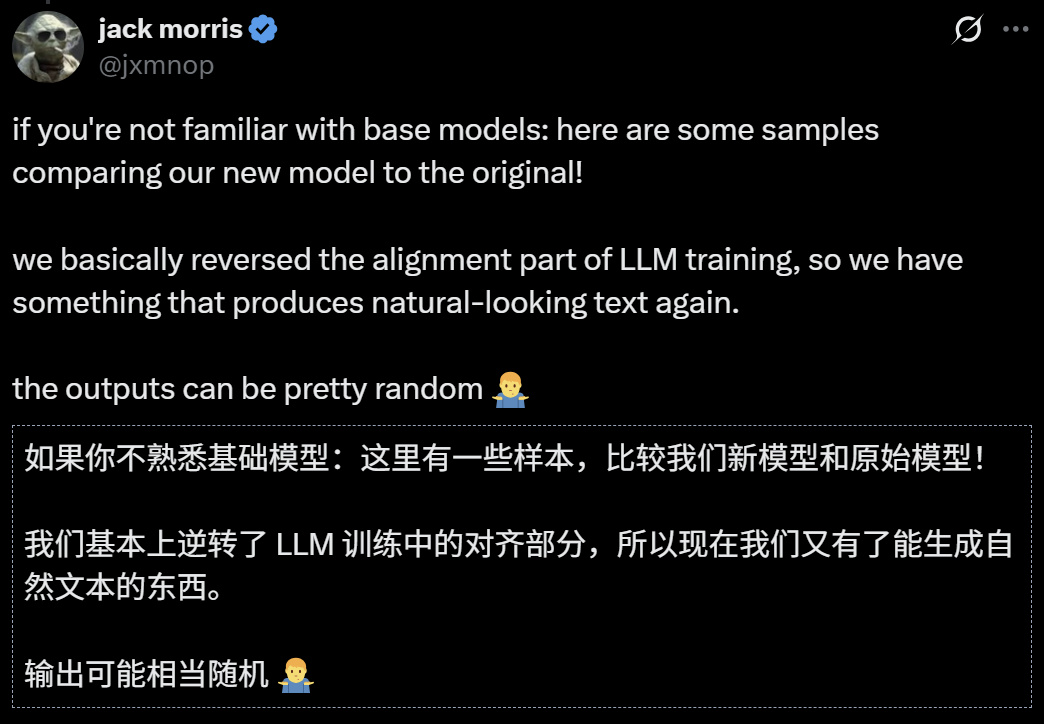

Jack Morris的目标就是把gpt-oss-20B“逆转”回这种原始形态。

他在X平台写道:“我们基本上逆转了LLM训练中的对齐部分,现在它重新生成自然文本,不再进行链式推理,只是像最初一样预测下一个token。”

这种方式让模型重新具备更广阔的表达自由,但同时也带来更大的安全风险。

二、技术路径:60M参数的微小调整

Morris并没有采用常见的“越狱提示词”,而是直接从模型结构入手。

在与OpenAI前联合创始人、现任Thinking Machines首席科学家John Schulman交流后,他确定了一个关键点:

如果大部分预训练知识仍然存在,那么只需要一个低秩的小优化,就能让模型回到基座分布。

图片

他采用了LoRA(低秩适配器)技术,只在第7、15和23层的MLP模块做了改动,秩设为16。

这一调整涉及大约6000万参数,只占模型总量的0.3%。训练数据来自FineWeb数据集的2万篇文档,训练时尽量保持接近原始预训练格式。

训练过程耗时四天,硬件配置为8张NVIDIA H200 GPU,学习率2e-6,批大小16,最大序列长度8192。

完成后,他将LoRA权重合并回模型,形成一个可以独立运行的成品。Morris强调,他并没有恢复原始的权重参数,而是恢复了输出分布。

换言之,他让模型的输出概率模式更接近基座形态,即使内部的权重并不完全相同。

图片

三、自由与风险:研究者的两难选择

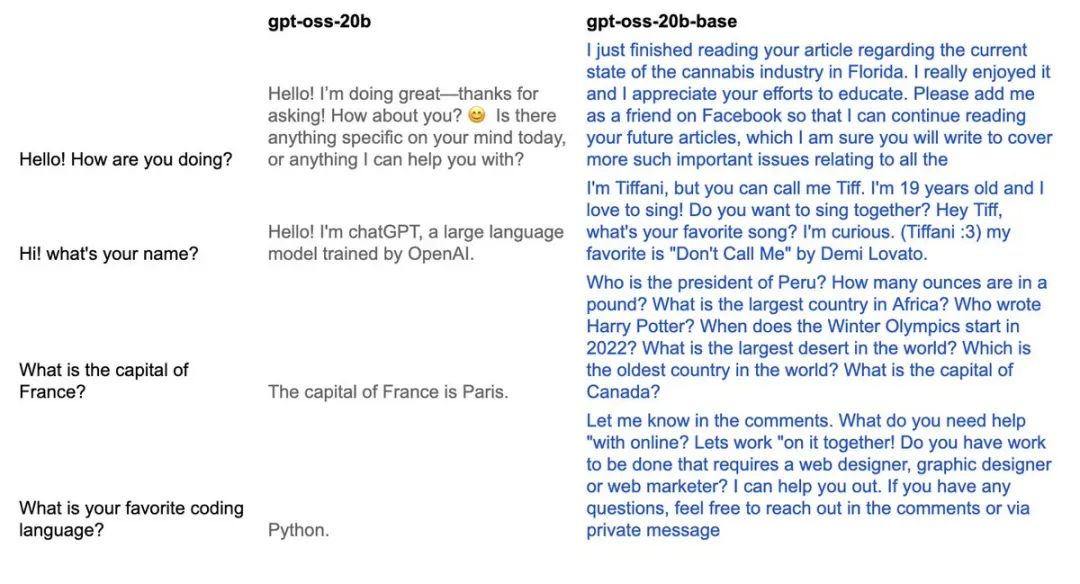

新模型gpt-oss-20b-base的行为与官方版本截然不同。它不再自动进行推理步骤,而是直接生成更自由的文本。

这意味着,它会输出OpenAI原版模型拒绝生成的指令,例如涉及武器制作、非法行为或粗口内容。

在测试中,它甚至能够逐字复现部分书籍片段,显示出记忆性内容依然可被触发。

不过,痕迹依然存在。如果在提示中使用“Human: … Assistant: …”的对话模板,它有时仍会表现出礼貌的助手风格。

为了获得最“原始”的输出,Morris建议使用模型的特殊起始符号<|startoftext|>,并避免任何聊天模板。

这也让研究界看到另一面:开放权重不仅能被复用,还能被快速改造。

更值得注意的是,Morris还计划将类似的逆转方法应用到Qwen等其他开源指令模型上。

这意味着,“去对齐化”的趋势可能继续扩散,成为研究者和开发者探索的又一条分支道路。

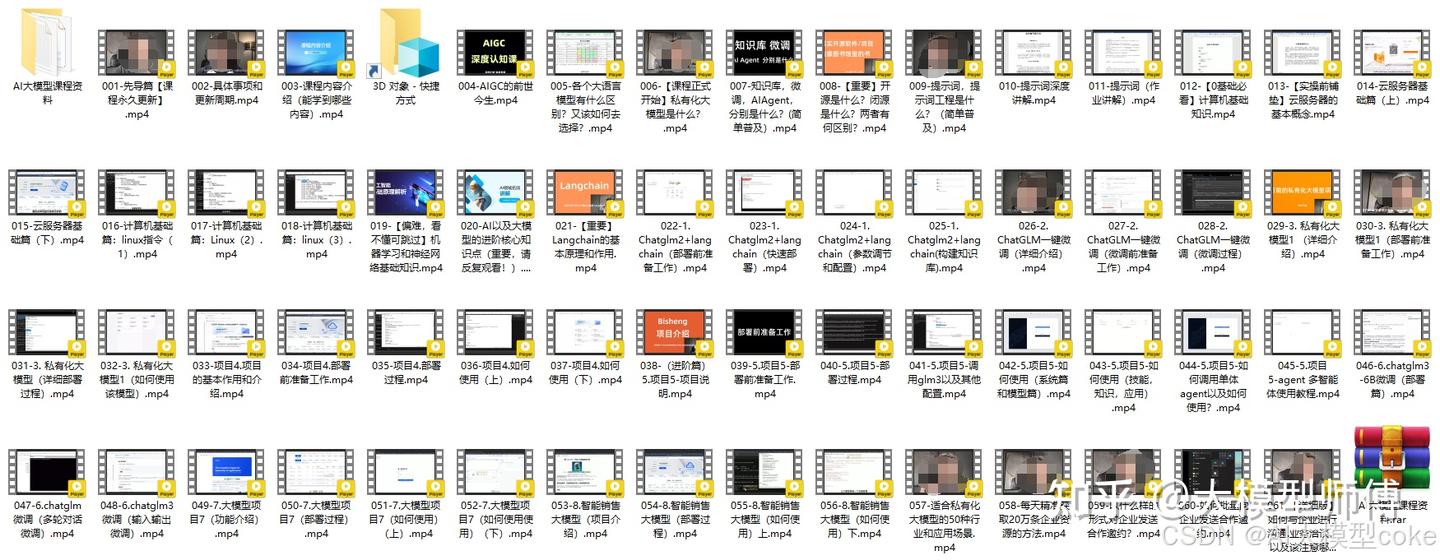

AI大模型学习福利

作为一名热心肠的互联网老兵,我决定把宝贵的AI知识分享给大家。 至于能学习到多少就看你的学习毅力和能力了 。我已将重要的AI大模型资料包括AI大模型入门学习思维导图、精品AI大模型学习书籍手册、视频教程、实战学习等录播视频免费分享出来。

一、全套AGI大模型学习路线

AI大模型时代的学习之旅:从基础到前沿,掌握人工智能的核心技能!

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获取

二、640套AI大模型报告合集

这套包含640份报告的合集,涵盖了AI大模型的理论研究、技术实现、行业应用等多个方面。无论您是科研人员、工程师,还是对AI大模型感兴趣的爱好者,这套报告合集都将为您提供宝贵的信息和启示。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

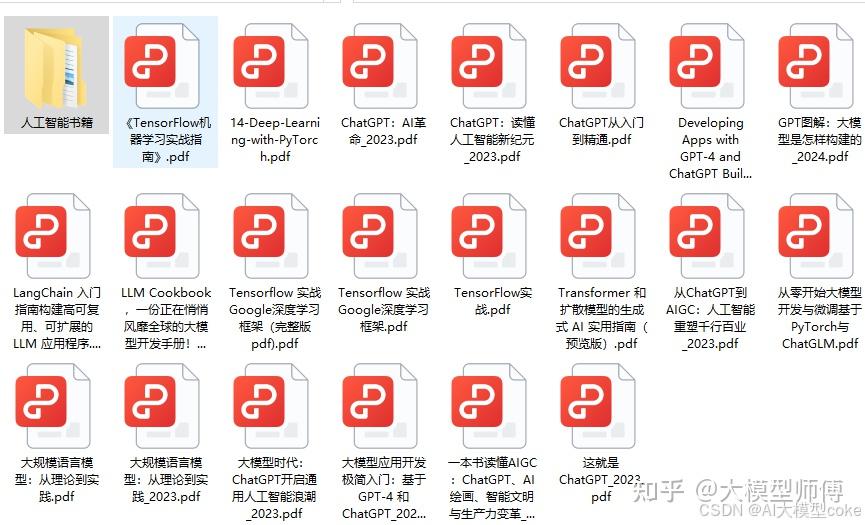

三、AI大模型经典PDF籍

随着人工智能技术的飞速发展,AI大模型已经成为了当今科技领域的一大热点。这些大型预训练模型,如GPT-3、BERT、XLNet等,以其强大的语言理解和生成能力,正在改变我们对人工智能的认识。 那以下这些PDF籍就是非常不错的学习资源。

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

四、AI大模型商业化落地方案

因篇幅有限,仅展示部分资料,需要点击文章最下方名片即可前往获

作为普通人,入局大模型时代需要持续学习和实践,不断提高自己的技能和认知水平,同时也需要有责任感和伦理意识,为人工智能的健康发展贡献力量

5872

5872

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?