一、说明

研究了两天了,没有合适的环境,最后找到源码安装,而不是docker的玩法,因为白嫖腾讯cloud studio不支持docker 安装,可愁坏了我了,最后我们找到大佬直接源码安装玩法。那就弄弄。

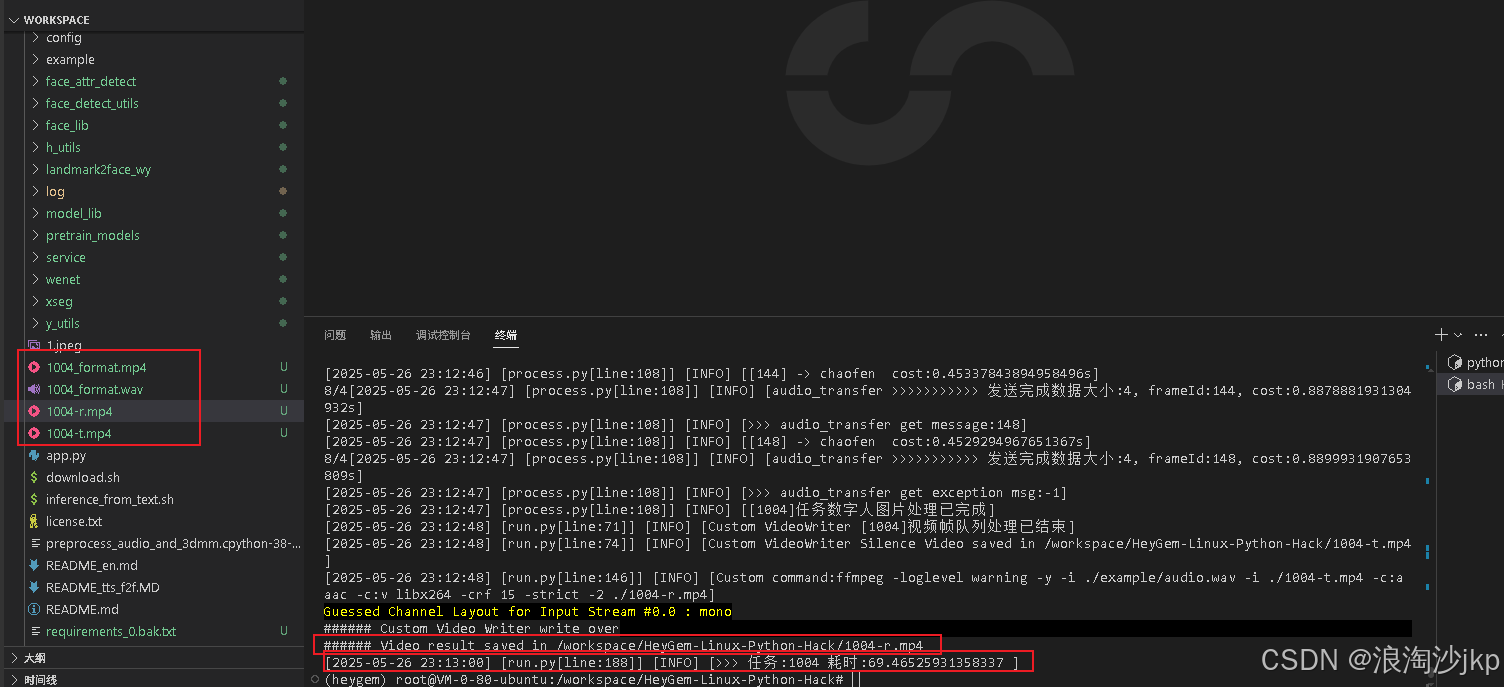

1004-r-优快云直播heygem 由文本生成视频,https://live.youkuaiyun.com/v/478880

1004-r

1、简介

Heygem 是由 硅基智能 推出的一款开源AI数字人模型,专为 Windows系统 设计。Heygem的主要功能包括秒级克隆、高效推理、高质量输出、多语言支持等,能够在本地高效运行各类开源AI数字人模型,无需依赖云服务。

2、主要功能和技术特点

- 秒级克隆:仅需1秒视频或1张照片,30秒内完成数字人形象和声音的克隆,60秒内合成4K超高清视频

- 高效推理:推理速度达到1:0.5,视频渲染合成速度达到1:23。

- 高质量输出:支持4K超高清、32帧/秒的视频输出,超越好莱坞电影24帧的标准。

- 多语言支持:克隆后的数字人支持8种语言输出,满足全球市场需求。

- 100%口型匹配:在复杂光影、遮挡或侧面角度下,实现高度逼真的口型匹配。

- 低配可跑:支持Docker一键部署,最低只需NVIDIA 1080Ti显卡即可运行。

3、应用场景

Heygem适用于多种场景,包括:

- 内容创作:快速生成动画、教育视频等,降低制作成本。

- 在线教育:创建虚拟教师,支持多语言教学,提升趣味性。

- 直播营销:用于虚拟直播、产品推广,降低人力成本。

- 影视特效:生成虚拟角色或特效镜头,简化制作流程。

- 智能客服:创建虚拟客服,提供自然的人机交互体验。

二、准备

1、源码准备

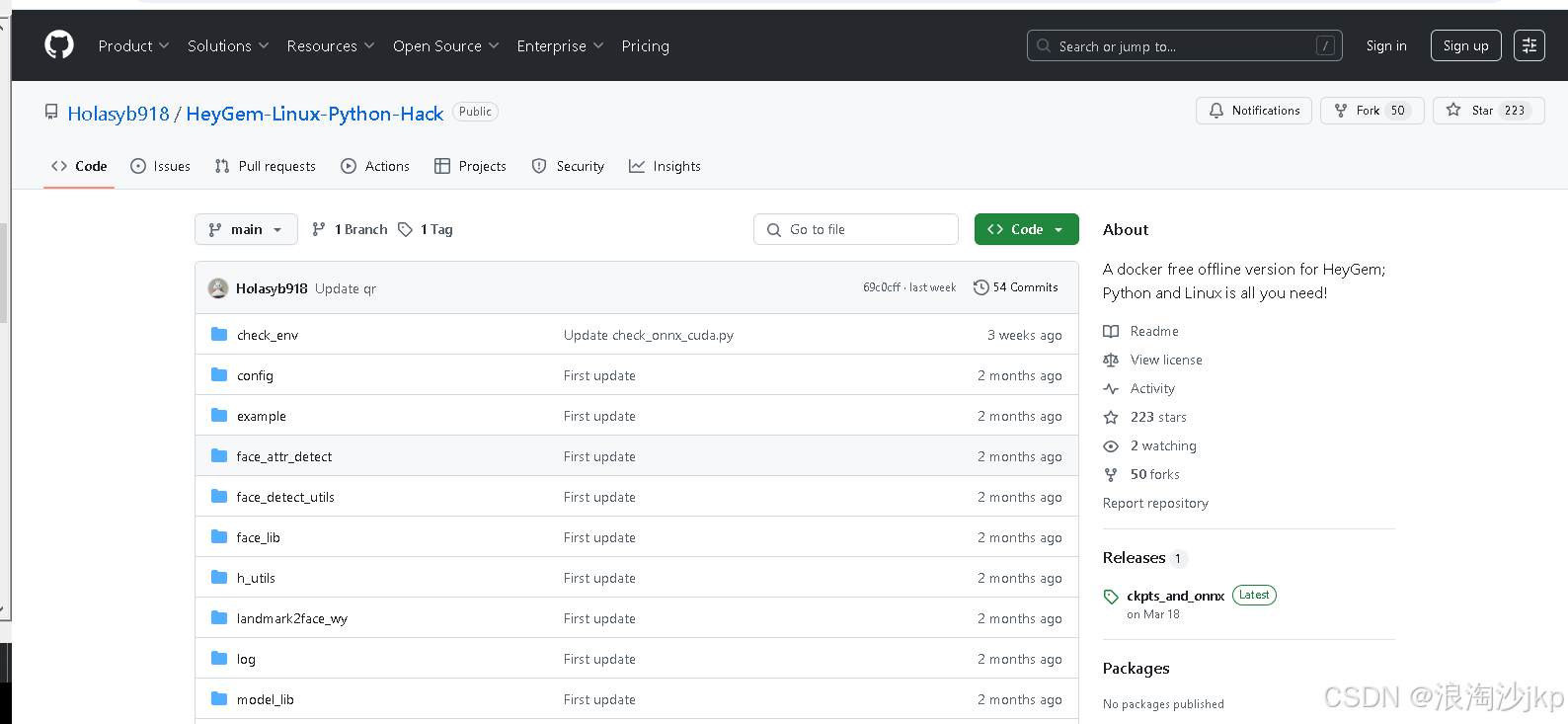

用这位大佬的安装源码

HeyGem-Linux-Python-Hack 是一个基于 Python 的数字人项目,它从 HeyGem.ai 中提取出来,它能够直接在 Linux 系统上运行,摆脱了对 Docker 和 Windows 系统的依赖。我们的目标是提供一个更易于部署和使用的数字人解决方案

2、硬件准备

作者建议:

本项目支持且仅支持 Linux & python3.8 环境

请确保你的 Linux 系统上已经安装了 Python 3.8。然后,使用 pip 安装项目依赖项

备用 同时也提供一个备用的环境 requirements_0.txt,遇到问题的话,你可以参考它来建立一个新的环境。

具体的 onnxruntime-gpu / torch 等需要结合你的机器上的 cuda 版本去尝试一些组合,否则仍旧可能遇到问题。

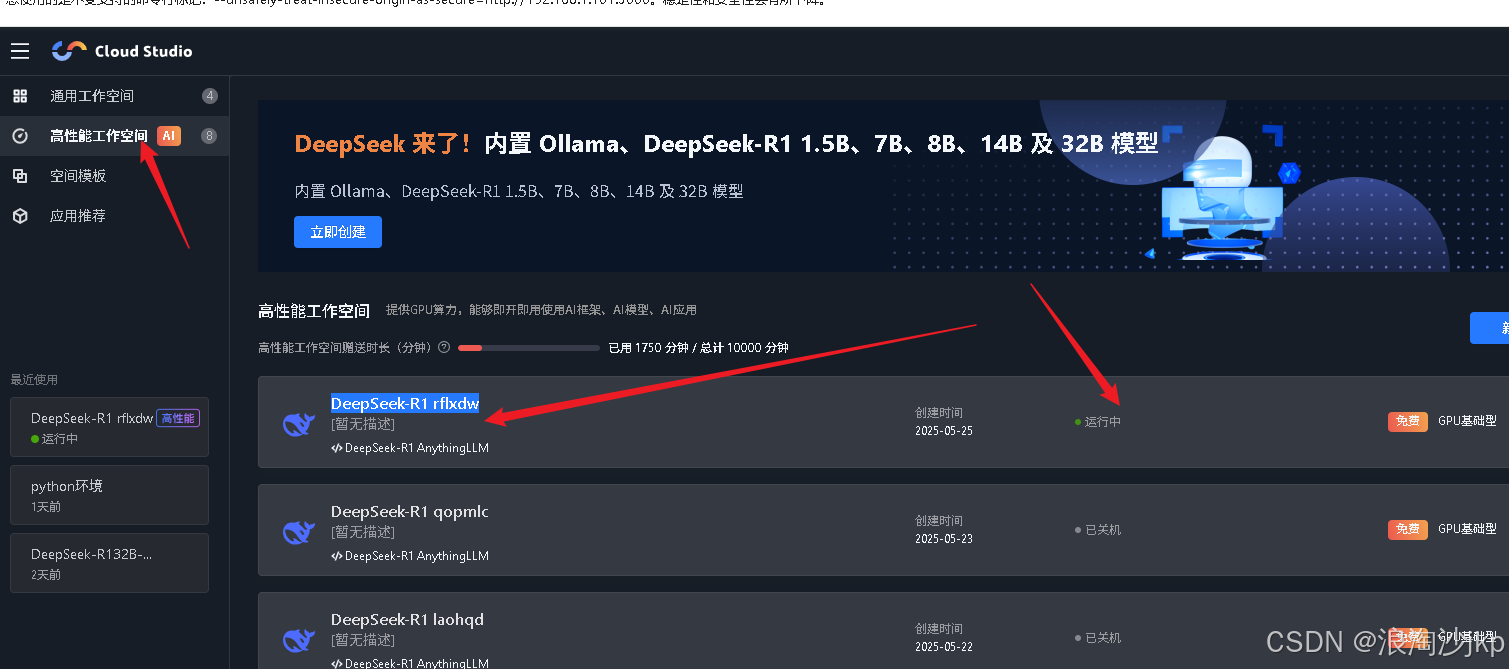

我们用腾讯cloud studio 上的高性能工作空间

三、安装与运行

1、下载源码

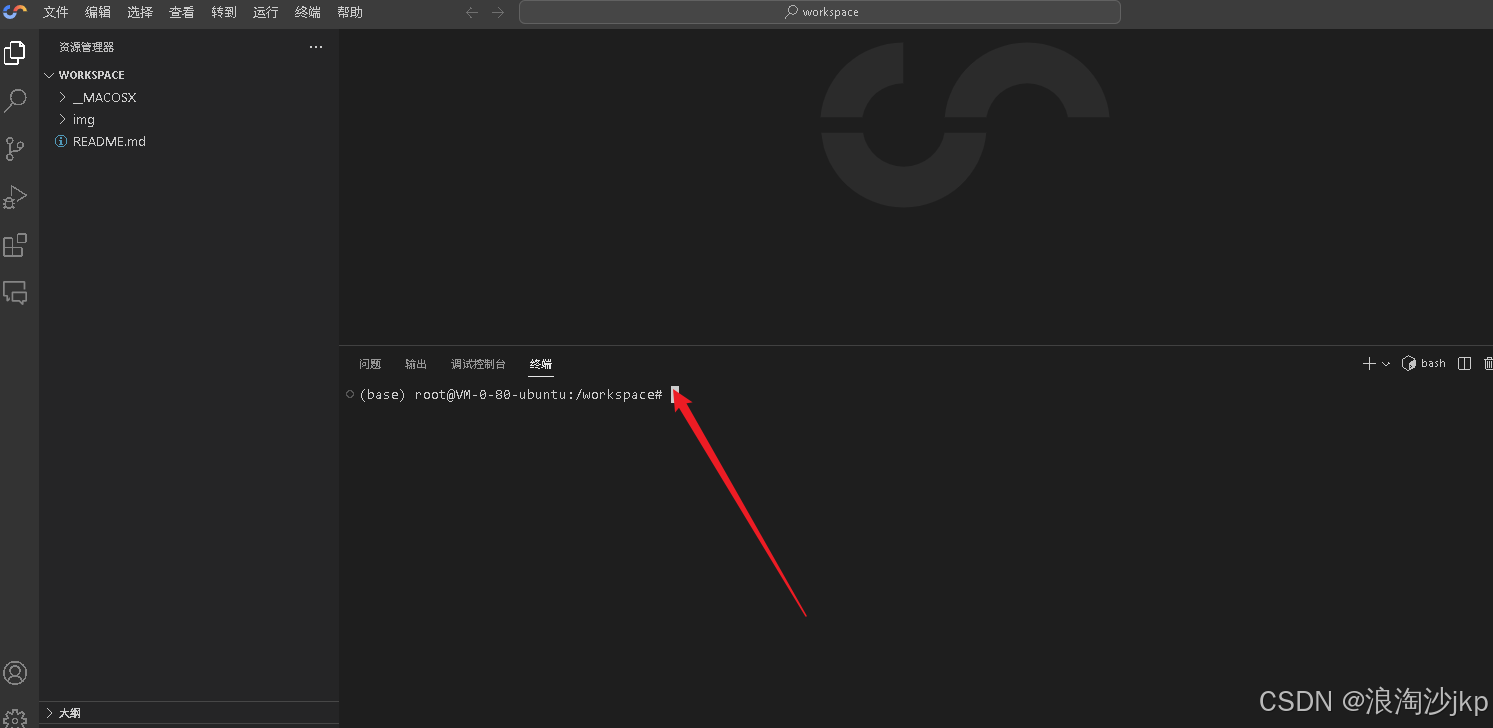

cd /workspace

git clone https://github.com/Holasyb918/HeyGem-Linux-Python-Hack

cd HeyGem-Linux-Python-Hack/2、安装Python 虚拟环境

conda create -n heygem python=3.8 -y

conda activate heygem

nvcc --version

Cuda compilation tools, release 11.7, V11.7.99 #应该是11.7

pip install torch==1.13.1+cu117 torchvision==0.14.1+cu117 torchaudio==0.13.1 --extra-index-url https://download.pytorch.org/whl/cu117

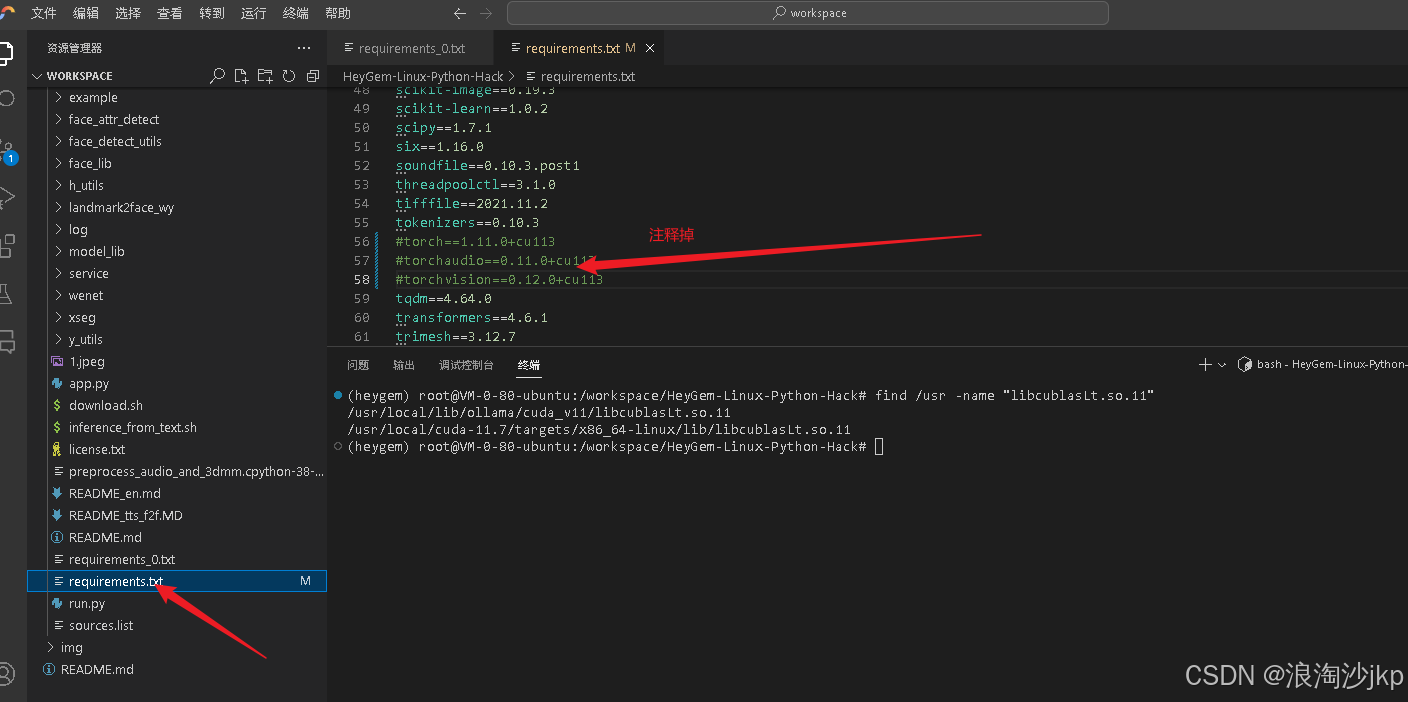

3、修改HeyGem-Linux-Python-Hack/requirements.txt

mv requirements.txt requirements_bak.txt

cp requirements_0.txt requirements_0.bak.txt

mv requirements_0.txt requirements.txt

5、 library.so 找不到

find /usr -name "libcublasLt.so.11"

nano ~/.bashrc

export HF_ENDPOINT=https://hf-mirror.com

export LD_LIBRARY_PATH=/usr/local/cuda-11.7/targets/x86_64-linux/lib:$LD_LIBRARY_PATH

source ~/.bashrc6、安装ffmeg

apt-get update

apt-get install libsndfile1

apt-get install ffmpeg

ffmpeg -version7、安装依赖

pip install -r requirements.txt8、下载模型

bash download.sh

wget https://github.com/Holasyb918/HeyGem-Linux-Python-Hack/releases/download/ckpts_and_onnx/scrfd_10g_kps.onnx

mv face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx.bak

mv scrfd_10g_kps.onnx face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx9、安装gradio(根据需要)

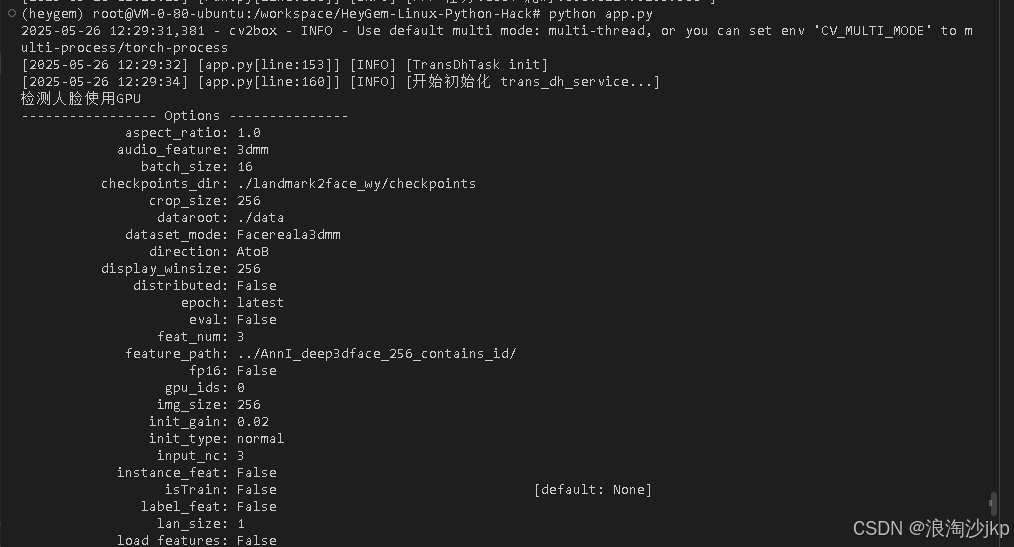

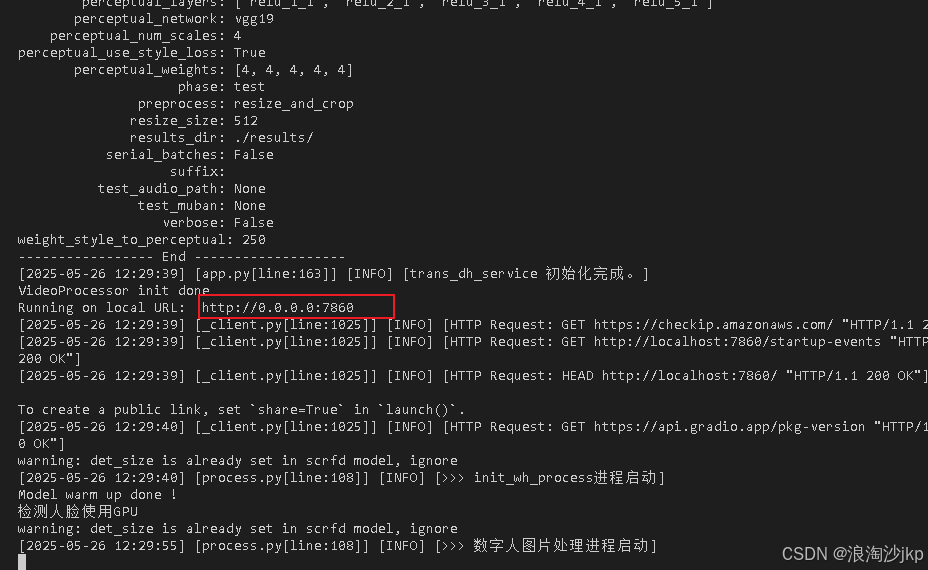

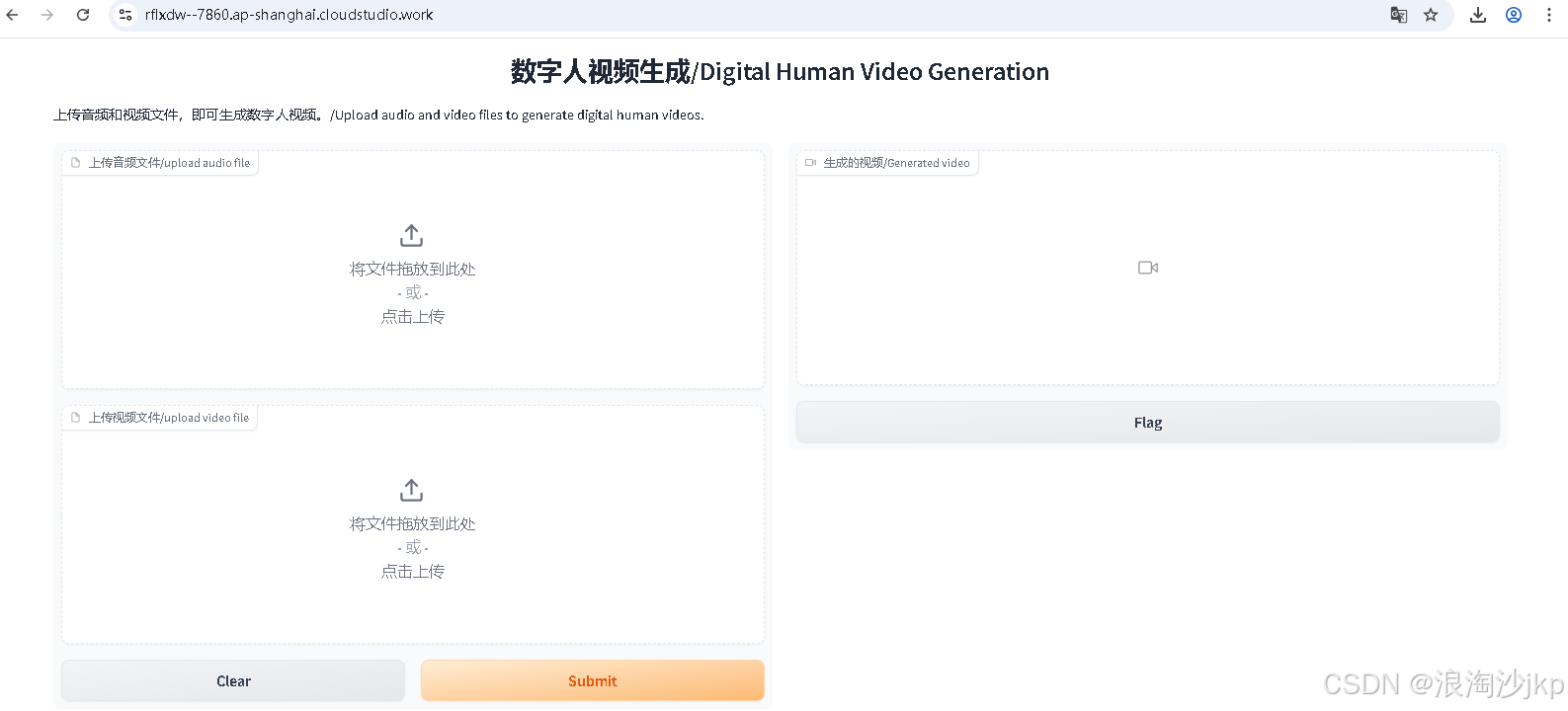

pip install gradio10、运行

# 需要安装gradio

python app.py

# 直接运行

python run.py

python run.py --audio_path example/audio.wav --video_path example/video.mp411、人脸检测失败(放在8、下载模型安装)

wget https://github.com/Holasyb918/HeyGem-Linux-Python-Hack/releases/download/ckpts_and_onnx/scrfd_10g_kps.onnx

mv face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx.bak

mv scrfd_10g_kps.onnx face_detect_utils/resources/scrfd_500m_bnkps_shape640x640.onnx

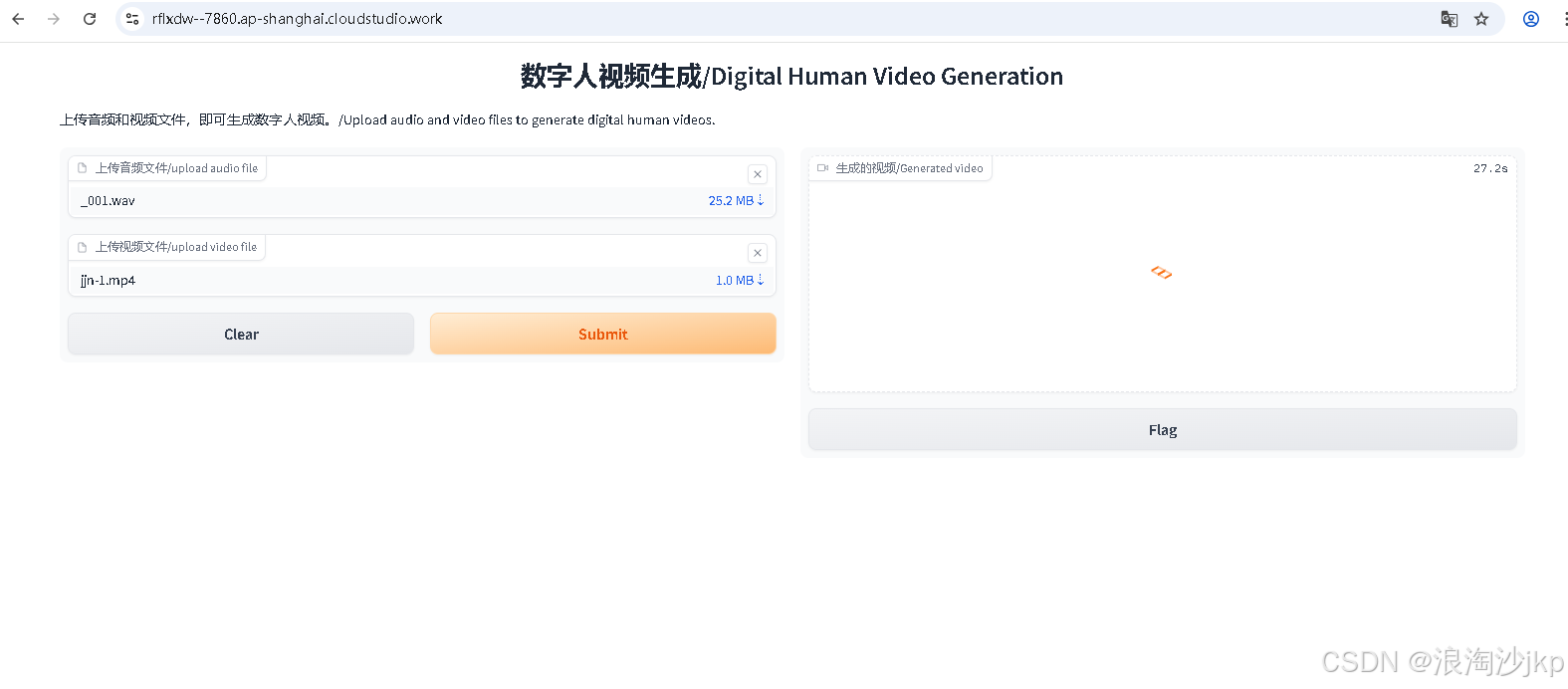

12、运行app.py会有界面

四、文字生成数字人

文字生成数字人需要3个文件,还要添加一个tts,没找到有界面的,有python版本不兼容,所以比较麻烦,需要分开处理,先生成txt转语音,然后在制作数字人,原因是python环境不同

# 到工作目录下

cd /workspace

# tts

git clone https://github.com/Holasyb918/tts-fish-speech

cd tts-fish-speech

conda deactivate # 退出heyget 虚拟环境

# 创建新的环境用来有文本生成声音

conda create -n tts python=3.10 -y

conda activate tts

# 安装pyaudio时会出错

apt-get install portaudio19-dev python-all-dev python3-all-dev

# 直接按下面安装

pip install -e .

mv requirements.txt requirements_bat.txt

# 后面就可以用 pip install -r requirements.txt 安装

pip freeze > requirements.txt

# 下载 tts 模型

huggingface-cli download fishaudio/fish-speech-1.5 --local-dir checkpoints/fish-speech-1.5/

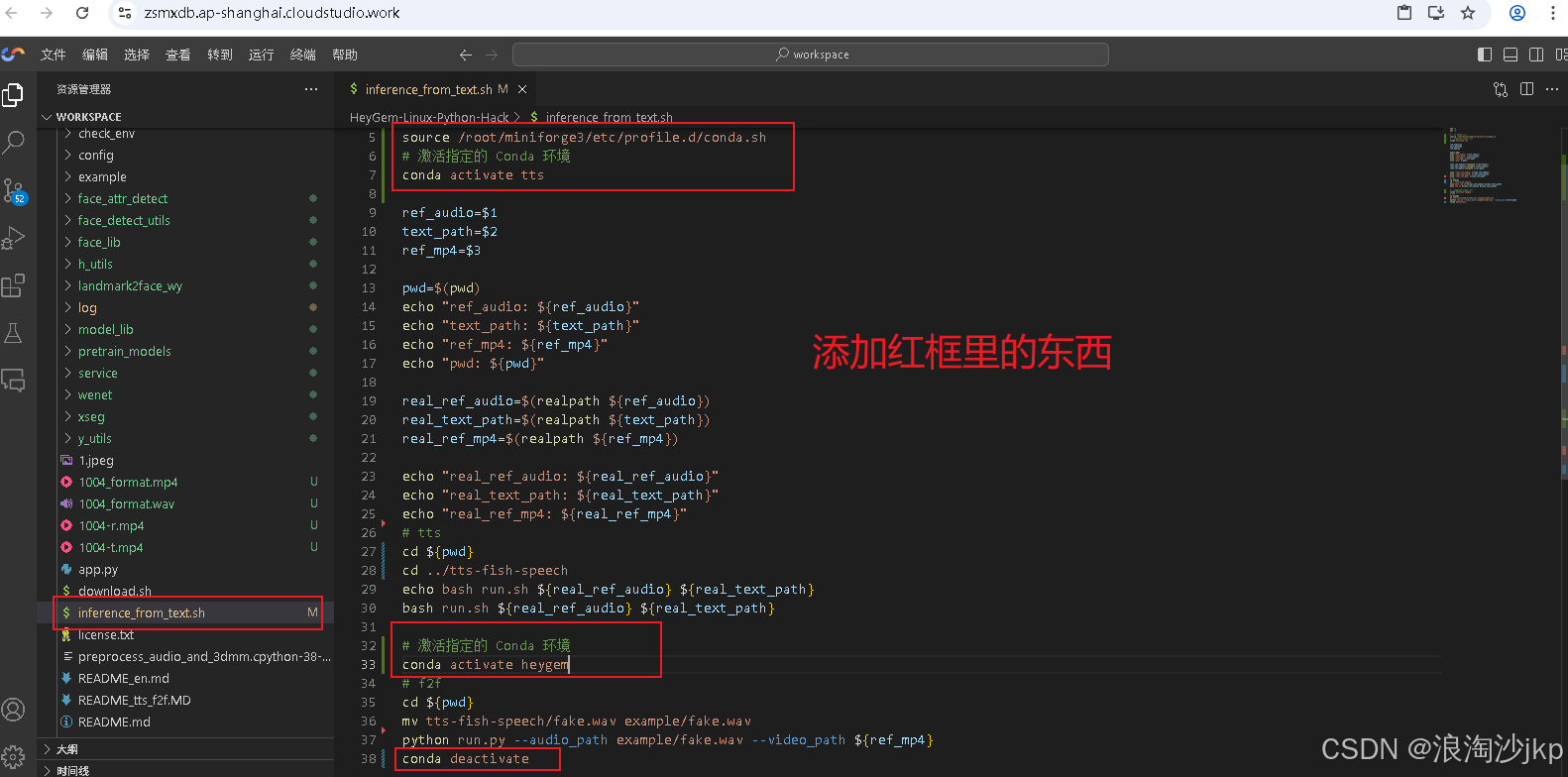

修改/workspace/HeyGem-Linux-Python-Hack/inference_from_text.sh

inference_from_text.sh 文件内容,以这个为准,测试过的

set -e

set -u

# 加载 Conda 环境

source /root/miniforge3/etc/profile.d/conda.sh

# 激活指定的 Conda 环境

conda activate tts

ref_audio=$1

text_path=$2

ref_mp4=$3

pwd=$(pwd)

echo "ref_audio: ${ref_audio}"

echo "text_path: ${text_path}"

echo "ref_mp4: ${ref_mp4}"

echo "pwd: ${pwd}"

real_ref_audio=$(realpath ${ref_audio})

real_text_path=$(realpath ${text_path})

real_ref_mp4=$(realpath ${ref_mp4})

echo "real_ref_audio: ${real_ref_audio}"

echo "real_text_path: ${real_text_path}"

echo "real_ref_mp4: ${real_ref_mp4}"

# tts

cd ${pwd}

cd ../tts-fish-speech

echo "pwd00000: $(pwd)"

echo bash run.sh ${real_ref_audio} ${real_text_path}

bash run.sh ${real_ref_audio} ${real_text_path}

echo "pwd1111: $(pwd)"

# 激活指定的 Conda 环境

conda activate heygem

# f2f

cd ${pwd}

echo "pwd2222: $(pwd)"

mv ../tts-fish-speech/fake.wav example/fake.wav

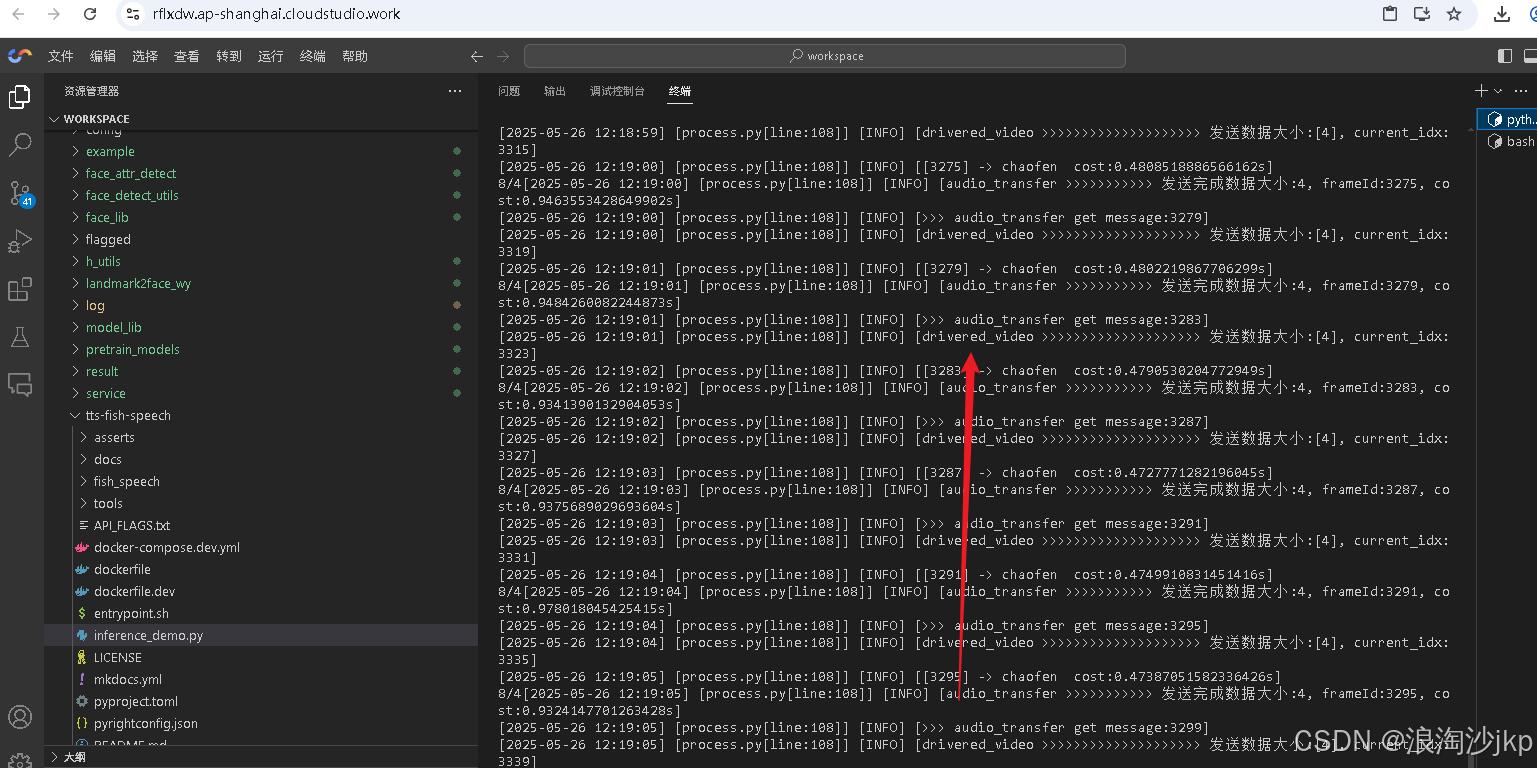

python run.py --audio_path example/fake.wav --video_path ${ref_mp4}

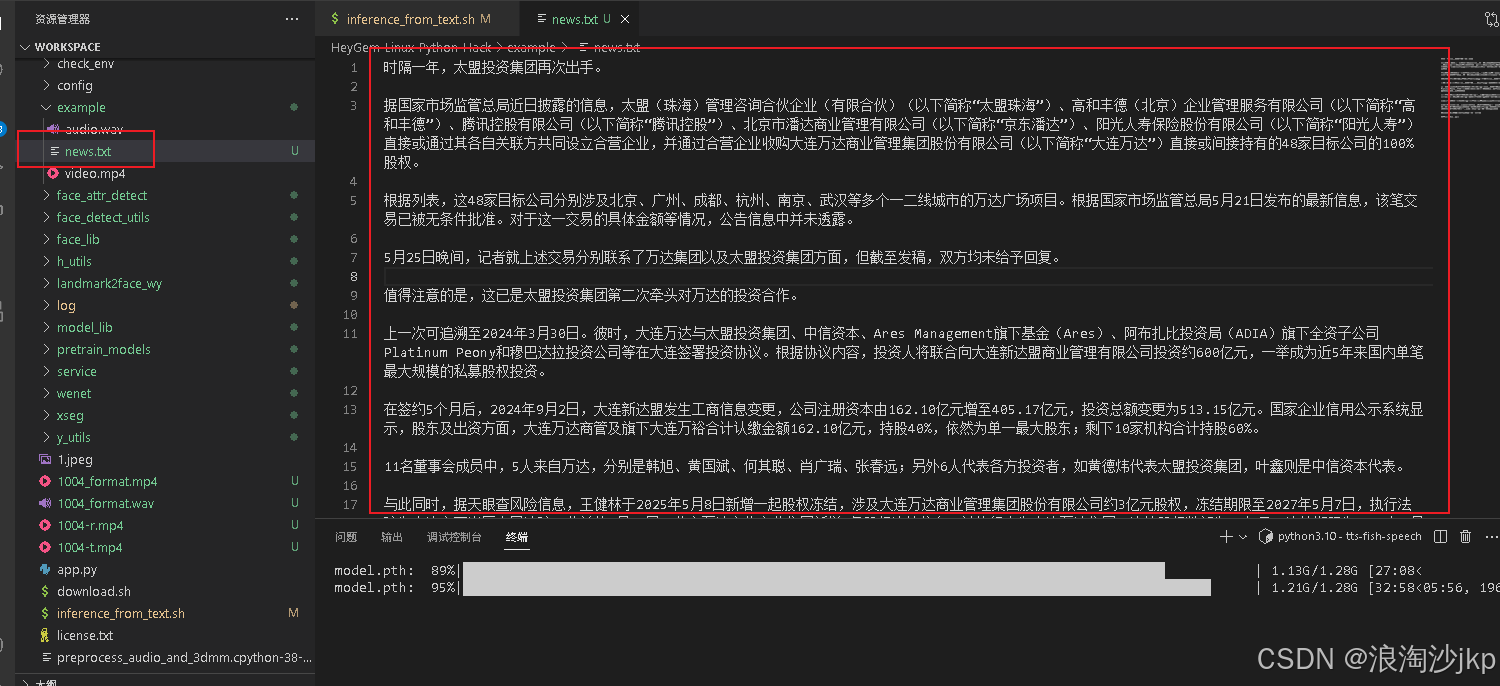

conda deactivatenews.txt文本

时隔一年,太盟投资集团再次出手。

据国家市场监管总局近日披露的信息,太盟(珠海)管理咨询合伙企业(有限合伙)(以下简称“太盟珠海”)、高和丰德(北京)企业管理服务有限公司(以下简称“高和丰德”)、腾讯控股有限公司(以下简称“腾讯控股”)、北京市潘达商业管理有限公司(以下简称“京东潘达”)、阳光人寿保险股份有限公司(以下简称“阳光人寿”)直接或通过其各自关联方共同设立合营企业,并通过合营企业收购大连万达商业管理集团股份有限公司(以下简称“大连万达”)直接或间接持有的48家目标公司的100%股权。

根据列表,这48家目标公司分别涉及北京、广州、成都、杭州、南京、武汉等多个一二线城市的万达广场项目。根据国家市场监管总局5月21日发布的最新信息,该笔交易已被无条件批准。对于这一交易的具体金额等情况,公告信息中并未透露。

5月25日晚间,记者就上述交易分别联系了万达集团以及太盟投资集团方面,但截至发稿,双方均未给予回复。

值得注意的是,这已是太盟投资集团第二次牵头对万达的投资合作。

上一次可追溯至2024年3月30日。彼时,大连万达与太盟投资集团、中信资本、Ares Management旗下基金(Ares)、阿布扎比投资局(ADIA)旗下全资子公司Platinum Peony和穆巴达拉投资公司等在大连签署投资协议。根据协议内容,投资人将联合向大连新达盟商业管理有限公司投资约600亿元,一举成为近5年来国内单笔最大规模的私募股权投资。

在签约5个月后,2024年9月2日,大连新达盟发生工商信息变更,公司注册资本由162.10亿元增至405.17亿元,投资总额变更为513.15亿元。国家企业信用公示系统显示,股东及出资方面,大连万达商管及旗下大连万裕合计认缴金额162.10亿元,持股40%,依然为单一最大股东;剩下10家机构合计持股60%。

11名董事会成员中,5人来自万达,分别是韩旭、黄国斌、何其聪、肖广瑞、张春远;另外6人代表各方投资者,如黄德炜代表太盟投资集团,叶鑫则是中信资本代表。

与此同时,据天眼查风险信息,王健林于2025年5月8日新增一起股权冻结,涉及大连万达商业管理集团股份有限公司约3亿元股权,冻结期限至2027年5月7日,执行法院为大连市西岗区人民法院。此前的3月18日,北京万达文化产业集团新增1条股权冻结信息,被执行人为大连万达集团,冻结股权数额为80亿元,冻结期限为2025年3月18日至2028年3月17日,执行法院为河南省郑州市中级人民法院。

如若此次交易成功,王健林或将再缓一口气。

来源:每日经济新闻然后执行下面命令

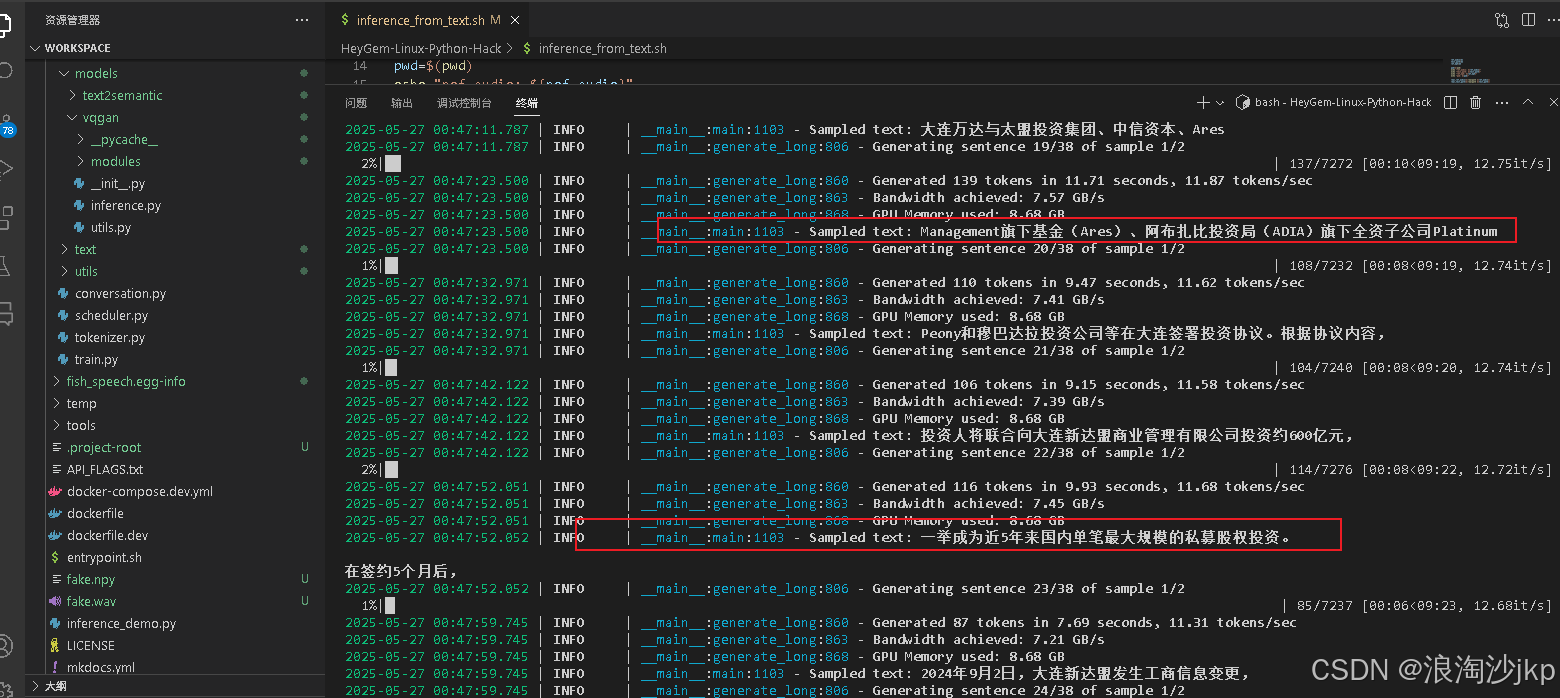

bash inference_from_text.sh example/audio.wav example/news.txt example/video.mp4

FileNotFoundError: Project root directory not found. Indicators: ['.project-root']

touch /workspace/tts-fish-speech/.project-root

就是找不到根目录

时间有点长

2万+

2万+

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?