YOLOv8改进 | 注意力机制 | 添加EMAttention注意力机制(附多个可添加位置)

于 2023-12-31 06:00:00 首次发布

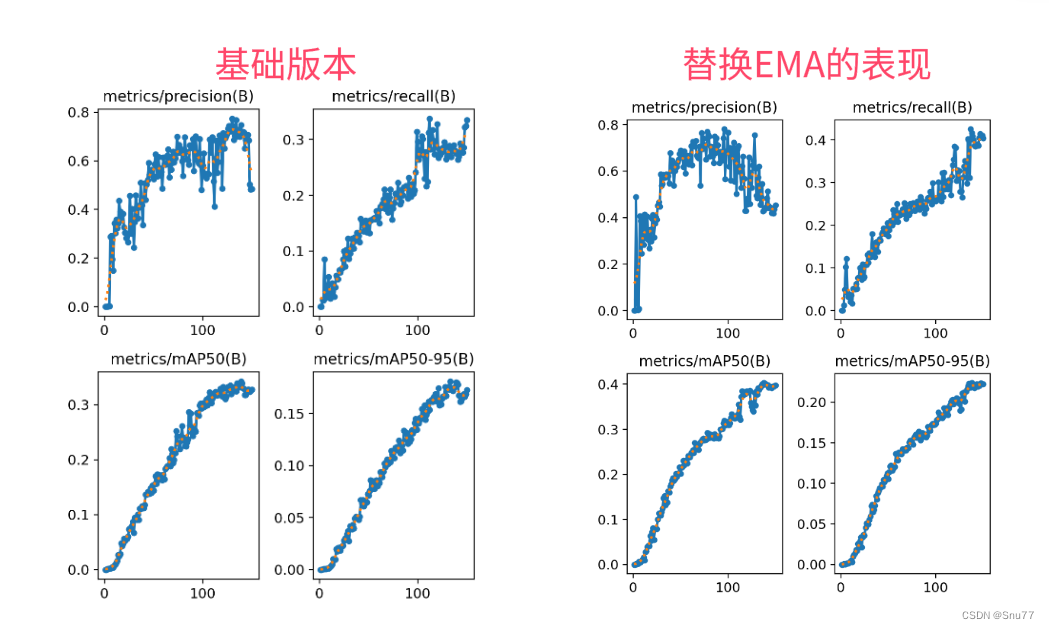

本文详细介绍了如何在YOLOv8中添加EMAttention注意力机制,以提升模型性能。通过理解EMAttention的框架原理,学习核心代码实现,并跟随步骤在YOLOv8中注册和应用该模块。实验表明,EMAttention能够有效增强模型的特征表示能力,提高计算机视觉任务的准确性。

本文详细介绍了如何在YOLOv8中添加EMAttention注意力机制,以提升模型性能。通过理解EMAttention的框架原理,学习核心代码实现,并跟随步骤在YOLOv8中注册和应用该模块。实验表明,EMAttention能够有效增强模型的特征表示能力,提高计算机视觉任务的准确性。

订阅专栏 解锁全文

订阅专栏 解锁全文

5357

5357