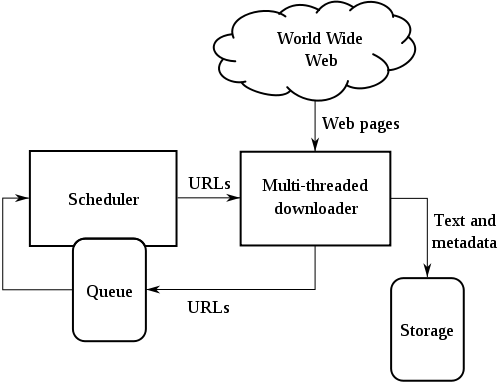

网络爬虫是一个自动提取网页的程序,它为搜索引擎从万维网上下载网页,是搜索引擎的重要组成,其基本架构如下图所示:

传统爬虫从一个或若干初始网页的URL开始,获得初始网页上的URL,在抓取网页的过程中,不断从当前页面上抽取新的URL放入队列,直到满足系统的一定停止条件。对于垂直搜索来说,聚焦爬虫,即有针对性地爬取特定主题网页的爬虫,更为适合。

本文爬虫程序的核心代码如下:

Java代码

- publicvoidcrawl()throwsThrowable{

- while(continueCrawling()){

- CrawlerUrlurl=getNextUrl();//获取待爬取队列中的下一个URL

- if(url!=null){

- printCrawlInfo();

- Stringcontent=getContent(url);//获取URL的文本信息

- //聚焦爬虫只爬取与主题内容相关的网页,这里采用正则匹配简单处理

- if(isContentRelevant(content,this.regexpSearchPattern)){

- saveContent(url,content);//保存网页至本地

- //获取网页内容中的链接,并放入待爬取队列中

- CollectionurlStrings=extractUrls(content,url);

- addUrlsToUrlQueue(url,urlStrings);

- }else{

- System.out.println(url+"isnotrelevantignoring...");

- }

- //延时防止被对方屏蔽

- Thread.sleep(this.delayBetweenUrls);

- }

- }

- closeOutputStream();

- }

整个函数由getNextUrl、getContent、isContentRelevant、extractUrls、addUrlsToUrlQueue等几个核心方法组成,下面将一一介绍。先看getNextUrl:

Java代码

- privateCrawlerUrlgetNextUrl()throwsThrowable{

- CrawlerUrlnextUrl=null;

- while((nextUrl==null)&&(!urlQueue.isEmpty())){

- CrawlerUrlcrawlerUrl=this.urlQueue.remove();

- //doWeHavePermissionToVisit:是否有权限访问该URL,友好的爬虫会根据网站提供的"Robot.txt"中配置的规则进行爬取

- //isUrlAlreadyVisited:URL是否访问过,大型的搜索引擎往往采用BloomFilter进行排重,这里简单使用HashMap

- //isDepthAcceptable:是否达到指定的深度上限。爬虫一般采取广度优先的方式。一些网站会构建爬虫陷阱(自动生成一些无效链接使爬虫陷入死循环),采用深度限制加以避免

- if(doWeHavePermissionToVisit(crawlerUrl)

- &&(!isUrlAlreadyVisited(crawlerUrl))

- &&isDepthAcceptable(crawlerUrl)){

- nextUrl=crawlerUrl;

- //System.out.println("Nexturltobevisitedis"+nextUrl);

- }

- }

- returnnextUrl;

- }

更多的关于robot.txt的具体写法,可参考以下这篇文章:

http://www.bloghuman.com/post/67/

getContent内部使用apache的httpclient 4.1获取网页内容,具体代码如下:

Java代码

- privateStringgetContent(CrawlerUrlurl)throwsThrowable{

- //HttpClient4.1的调用与之前的方式不同

- HttpClientclient=newDefaultHttpClient();

- HttpGethttpGet=newHttpGet(url.getUrlString());

- StringBufferstrBuf=newStringBuffer();

- HttpResponseresponse=client.execute(httpGet);

- if(HttpStatus.SC_OK==response.getStatusLine().getStatusCode()){

- HttpEntityentity=response.getEntity();

- if(entity!=null){

- BufferedReaderreader=newBufferedReader(

- newInputStreamReader(entity.getContent(),"UTF-8"));

- Stringline=null;

- if(entity.getContentLength()>0){

- strBuf=newStringBuffer((int)entity.getContentLength());

- while((line=reader.readLine())!=null){

- strBuf.append(line);

- }

- }

- }

- if(entity!=null){

- entity.consumeContent();

- }

- }

- //将url标记为已访问

- markUrlAsVisited(url);

- returnstrBuf.toString();

- }

对于垂直型应用来说,数据的准确性往往更为重要。聚焦型爬虫的主要特点是,只收集和主题相关的数据,这就是isContentRelevant方法的作用。这里或许要使用分类预测技术,为简单起见,采用正则匹配来代替。其主要代码如下:

Java代码

- publicstaticbooleanisContentRelevant(Stringcontent,

- PatternregexpPattern){

- booleanretValue=false;

- if(content!=null){

- //是否符合正则表达式的条件

- Matcherm=regexpPattern.matcher(content.toLowerCase());

- retValue=m.find();

- }

- returnretValue;

- }

extractUrls的主要作用,是从网页中获取更多的URL,包括内部链接和外部链接,代码如下:

Java代码

- publicListextractUrls(Stringtext,CrawlerUrlcrawlerUrl){

- MapurlMap=newHashMap();

- extractHttpUrls(urlMap,text);

- extractRelativeUrls(urlMap,text,crawlerUrl);

- returnnewArrayList(urlMap.keySet());

- }

- //处理外部链接

- privatevoidextractHttpUrls(MapurlMap,Stringtext){

- Matcherm=httpRegexp.matcher(text);

- while(m.find()){

- Stringurl=m.group();

- String[]terms=url.split("ahref=\"");

- for(Stringterm:terms){

- //System.out.println("Term="+term);

- if(term.startsWith("http")){

- intindex=term.indexOf("\"");

- if(index>0){

- term=term.substring(0,index);

- }

- urlMap.put(term,term);

- System.out.println("Hyperlink:"+term);

- }

- }

- }

- }

- //处理内部链接

- privatevoidextractRelativeUrls(MapurlMap,Stringtext,

- CrawlerUrlcrawlerUrl){

- Matcherm=relativeRegexp.matcher(text);

- URLtextURL=crawlerUrl.getURL();

- Stringhost=textURL.getHost();

- while(m.find()){

- Stringurl=m.group();

- String[]terms=url.split("ahref=\"");

- for(Stringterm:terms){

- if(term.startsWith("/")){

- intindex=term.indexOf("\"");

- if(index>0){

- term=term.substring(0,index);

- }

- Strings="http://"+host+term;

- urlMap.put(s,s);

- System.out.println("Relativeurl:"+s);

- }

- }

- }

- }

如此,便构建了一个简单的网络爬虫程序,可以使用以下程序来测试它:

Java代码

- publicstaticvoidmain(String[]args){

- try{

- Stringurl="http://www.amazon.com";

- QueueurlQueue=newLinkedList();

- Stringregexp="java";

- urlQueue.add(newCrawlerUrl(url,0));

- NaiveCrawlercrawler=newNaiveCrawler(urlQueue,100,5,1000L,

- regexp);

- //booleanallowCrawl=crawler.areWeAllowedToVisit(url);

- //System.out.println("Allowedtocrawl:"+url+""+

- //allowCrawl);

- crawler.crawl();

- }catch(Throwablet){

- System.out.println(t.toString());

- t.printStackTrace();

- }

- }

当然,你可以为它赋予更为高级的功能,比如多线程、更智能的聚焦、结合Lucene建立索引等等。更为复杂的情况,可以考虑使用一些开源的蜘蛛程序,比如Nutch或是Heritrix等等,就不在本文的讨论范围了。

226

226

被折叠的 条评论

为什么被折叠?

被折叠的 条评论

为什么被折叠?